论文解读|KINOVA 双模态 EEG 驱动的机器人智能抓取与放置系统研究

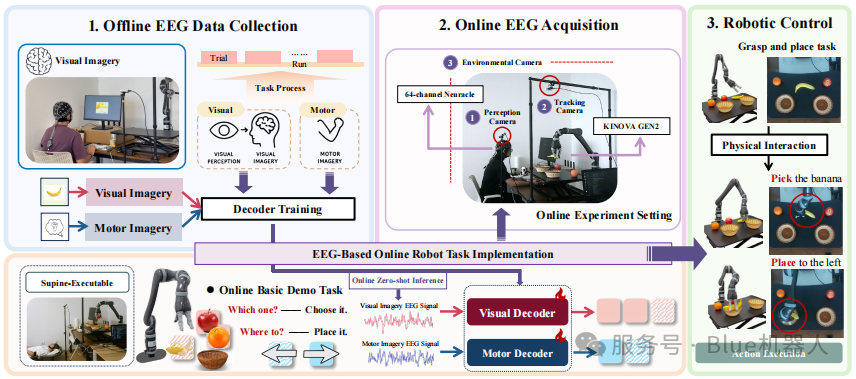

本研究以KINOVA GEN2协作机器人为核心,成功构建了全球首个基于视觉想象+运动想象双模态EEG的意念驱动抓取-放置系统,实现了从高级认知意图到物理机器人动作的直接、自然、无接触转化。实验结果表明,非侵入式脑电信号可稳定驱动机器人完成物体识别、空间定位、精准抓取与安全放置。KINOVA机器人凭借高精度、高柔顺性和高开放性,成为脑机接口技术走向现实应用的关键硬件支撑。

在人机协作与智能机器人快速发展的今天,机器人已具备稳定的物体识别、运动规划与环境交互能力,但理解并执行人类高级认知意图仍是制约其走向自然交互的核心瓶颈。传统机器人控制依赖语音、手势、按键等显式指令,在残障辅助、极端环境作业、无接触交互等场景中适用性受限。脑机接口(BCI)技术为直接打通 “大脑意念” 与 “机器动作” 提供了全新路径,而如何将非侵入式、高噪声的脑电信号(EEG)稳定转化为机器人可执行的精细操作,成为学界与工业界共同关注的焦点。

论文地址:https://arxiv.org/pdf/2603.03181

在此背景下,复旦大学团队提出一套基于EEG视觉想象(VI)与运动想象(MI)混合的脑机认知控制框架,以KINOVA GEN2协作为物理执行平台,完成从离线模型训练、在线零样本推理到真实世界抓取-放置的全流程闭环验证。

该系统不依赖外部闪烁刺激、语音指令或肢体动作,仅通过人类纯粹的心理意象,即可让机器人完成目标选择、空间定位、精准抓取与安全放置,为非侵入式 BCI 在服务机器人、康复医疗、智能助行等领域的实用化落地提供关键技术支撑。

一、技术痛点与研究动机

当前机器人操作技术虽日趋成熟,但在意图理解层面仍存在明显短板:

-

依赖显式交互:语音、手势、眼动等方式易受环境干扰,在嘈杂、黑暗、穿戴设备受限场景下失效。

-

BCI 控制模式单一:主流 P300、SSVEP 等范式需用户紧盯闪烁光源,易疲劳、不自然,仅支持少量预设指令。

-

高级认知难以落地:基于 EEG 的视觉语义解码多停留在离线分析,未能实时转化为机器人可执行动作。

-

硬件适配不足:普通机械臂缺乏柔性、精度与安全协作能力,难以承接脑电信号固有的延迟与噪声带来的控制风险。

为解决上述问题,本研究以自然意图驱动、零提示意象控制、硬件安全稳定为目标,构建双模态脑电解码系统,并选择 KINOVA GEN2 作为执行终端,实现 “想抓什么、抓完放哪” 的全意念式机器人操作。

二、系统整体架构:脑电信号到机器人动作的全链路打通

该系统由离线预训练、在线流式推理、机器人执行三大模块组成,形成从 “意念” 到 “动作” 的完整转化通路。

1. 离线 EEG 采集与解码器训练

研究招募 5 名健康受试者,在严格伦理审批下完成双任务脑电数据采集:

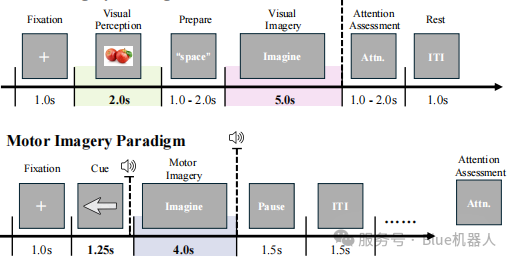

- 视觉想象任务(VI):观察苹果、香蕉、橙子图片后闭眼想象目标物体,共 300 次实验,用于训练 “抓什么” 的物体解码器

- 运动想象任务(MI):根据提示想象左手 / 右手运动,共 100 次实验,用于训练 “放哪边” 的位置解码器。

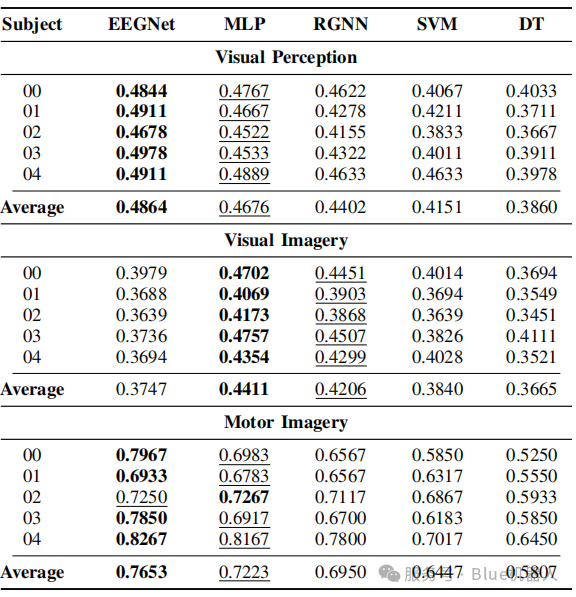

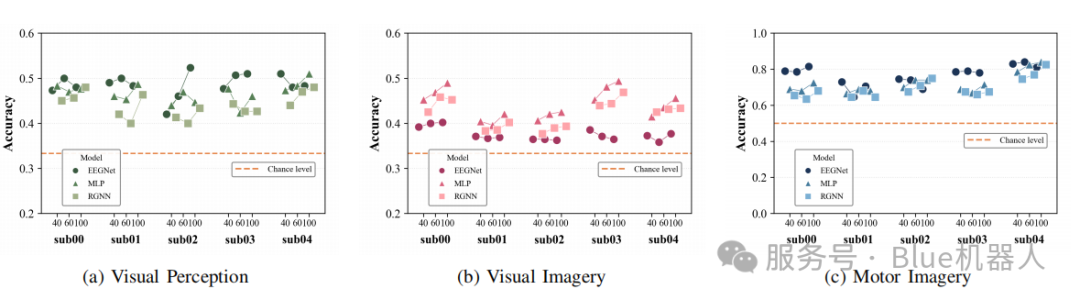

信号采集采用 64 通道 Neuracle EEG 设备,1000Hz 采样率,经带通滤波、独立成分分析(ICA)、伪迹去除等预处理,保留有效认知特征。模型对比 SVM、KNN、MLP、EEGNet、RGNN 等算法后确定:

MLP 在视觉想象任务最优(44.11%),EEGNet 在运动想象任务最优(76.53%)。

2. 在线零样本推理与双通路意图解码

系统将预训练模型直接嵌入实时流式 pipeline,实现零训练、即开即用的

在线部署:

-

视觉想象 EEG → 识别目标物体(苹果 / 香蕉 / 橙子)

-

运动想象 EEG → 识别放置方位(左 / 右)

-

双信号融合 → 输出完整抓取 - 放置指令

全程无需提示、无需注视刺激、无需物理动作,真正实现 “纯意念” 意图输出。

3. KINOVA GEN2 机器人执行与感知系统

作为系统的物理肢体,KINOVA GEN2 承担从指令接收到动作完成的关键角色:

- 多相机感知:搭配两台 Intel RealSense D435 深度相机,实现眼在手外标定,提供物体定位、位姿估计、空间避障能力。

- 6D 精准抓取:根据脑电结果计算最优抓取点,支持不规则物体稳定夹持。

- 安全柔顺控制:具备力矩反馈与碰撞检测,保证人机共融场景下的使用安全。

- 扩展监控:顶部与全局摄像头实时监控任务状态,支持遮挡、仰卧等复杂场景验证。

三、KINOVA GEN2:意念控制系统的理想硬件载体

KINOVA GEN2 协作机器人之所以成为本研究的核心选择,源于其在精度、柔性、开放性、可靠性上的综合优势:

- 控制接口开放易用

支持 ROS、TCP/IP 等多种通信方式,可快速对接脑电解码模块,实时接收位姿、抓取、放置指令,延迟低、响应快。

-

- 1.操作精度高且稳定

重复定位精度高,关节运动平滑,适合水果等小型、易损、不规则物体的精细操作,降低脑电噪声带来的执行误差。

- 2.人机安全协作能力

轻量化机身、柔顺控制与碰撞保护,使系统可在受试者身旁安全运行,适用于康复、助老、家庭服务等近距离场景。

-

3.部署灵活扩展性强

-

结构紧凑、安装简便,可快速适配桌面操作、隐藏物体交互、仰卧控制、直接手递物等多种实验范式,支撑系统鲁棒性验证。

-

4.行业成熟度高作为医疗康复与服务机器人领域的经典平台,KINOVA GEN2 具备长期稳定运行能力,为 BCI 技术从实验室走向实际产品提供可靠硬件基础。

四、实验结果:脑电控制 KINOVA 机器人的真实性能

研究在 4 名受试者上完成在线闭环实验,累计数百次抓取 - 放置任务,核心性能如下:

1. 在线解码性能

-

视觉想象(物体识别)平均准确率:40.23%

-

运动想象(位置识别)平均准确率:62.59%

-

所有结果显著高于随机水平,证明纯意象可稳定驱动高级意图输出。

2. 系统级任务性能

-

物体抓取综合成功率:76.11%

-

苹果:89.83%

-

橙子:84.44%

-

香蕉:55.84%(因形状细长更易受位姿误差影响)

-

-

位置放置成功率:100%(位置解码正确后执行零失误)

-

端到端完整任务成功率:20.88%

-

单次任务总耗时:约107.27 秒,其中机器人执行占比最大,EEG 解码仅占约 16%。

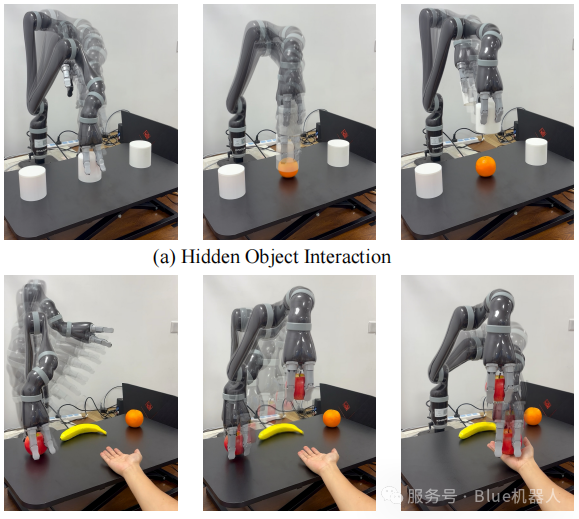

3. 复杂场景验证

系统突破传统 BCI 限制,在无视觉辅助、姿态受限条件下仍可稳定运行:

- 仰卧姿态控制:受试者平躺、无法看到机械臂,仍可完成意念抓取放置。

- 隐藏物体交互:物体被遮挡,仅靠视觉想象即可让 KINOVA 找到并暴露目标。

- 直接人机交互:机器人根据意念将物体直接放入受试者手中,实现自然、无接触协作。

研究创新与学术价值

本研究在脑机接口与人机协作领域实现多项突破:

- 首创双模态纯意象 BCI 范式

将视觉想象(物体)与运动想象(位置)结合,首次实现 “抓什么 - 放哪里” 的任务级意念控制,无需外部提示。

- 离线预训练 + 在线零样本部署

避免在线校准,提升系统实用性,为可穿戴 BCI 机器人提供轻量化部署方案。

- 验证高级视觉认知可驱动机器人

证明非侵入式 EEG 可实时解码物体语义,并转化为 KINOVA 机器人可执行的真实操作。

- 确立 KINOVA 在 BCI 机器人中的硬件价值

通过完整系统验证,证明 KINOVA 系列协作机器人是脑电意念控制的最优载体之一。

六、局限

尽管系统已实现功能闭环,但仍存在提升空间:

- 视觉想象解码精度偏低

受 EEG 信噪比限制,物体分类准确率仍需提升,未来可结合高 γ 波段、注意力机制与更深度模型优化。

- 任务耗时较长

机器人运动与 EEG 推理流程可进一步精简,向实时化、轻量化推进。

- 受试者个体差异较大

模型泛化性与跨被试通用能力需继续增强,以适配更多使用者。

- 任务场景可扩展

未来可融入大语言模型(LLM)与强化学习,让意念机器人支持更复杂的家务、康复、护理任务。

七、总结

本研究以KINOVA GEN2协作机器人为核心,成功构建了全球首个基于视觉想象+运动想象双模态EEG的意念驱动抓取-放置系统,实现了从高级认知意图到物理机器人动作的直接、自然、无接触转化。实验结果表明,非侵入式脑电信号可稳定驱动机器人完成物体识别、空间定位、精准抓取与安全放置。KINOVA机器人凭借高精度、高柔顺性和高开放性,成为脑机接口技术走向现实应用的关键硬件支撑。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)