GSWorld:机器人操作中闭环照片-级真实感仿真套件

25年10月来自UCSD、UCLA和Meta的论文“GSWorld: Closed-Loop Photo-Realistic Simulation Suite for Robotic Manipulation”。GSWorld是一个鲁棒性强、照片级逼真的机器人操作模拟器,它结合3D高斯溅射(GS)和物理引擎。该框架提倡“闭环”策略开发,即通过对从真实机器人数据中学习的策略进行可复现的评估,以及无需

25年10月来自UCSD、UCLA和Meta的论文“GSWorld: Closed-Loop Photo-Realistic Simulation Suite for Robotic Manipulation”。

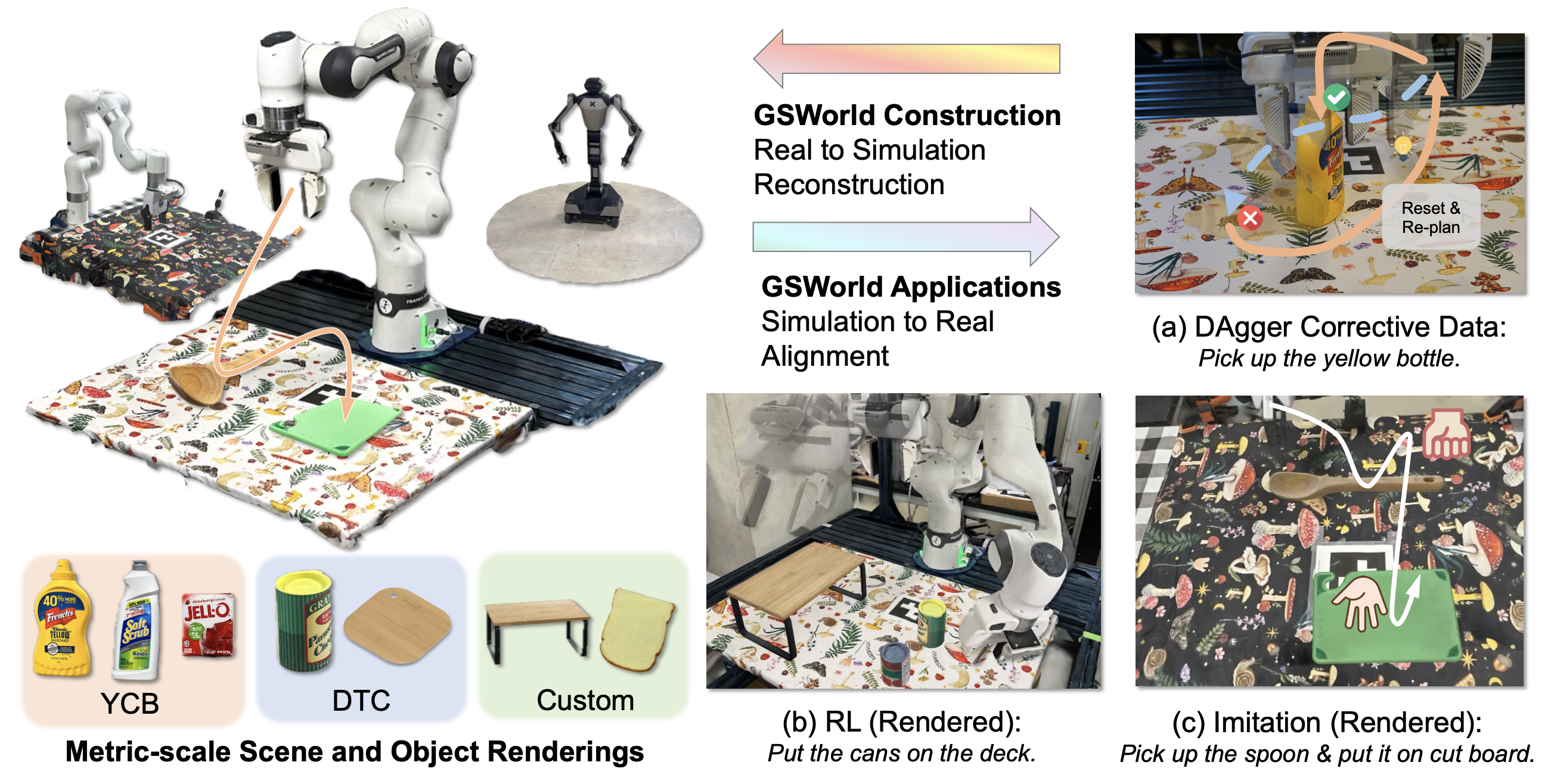

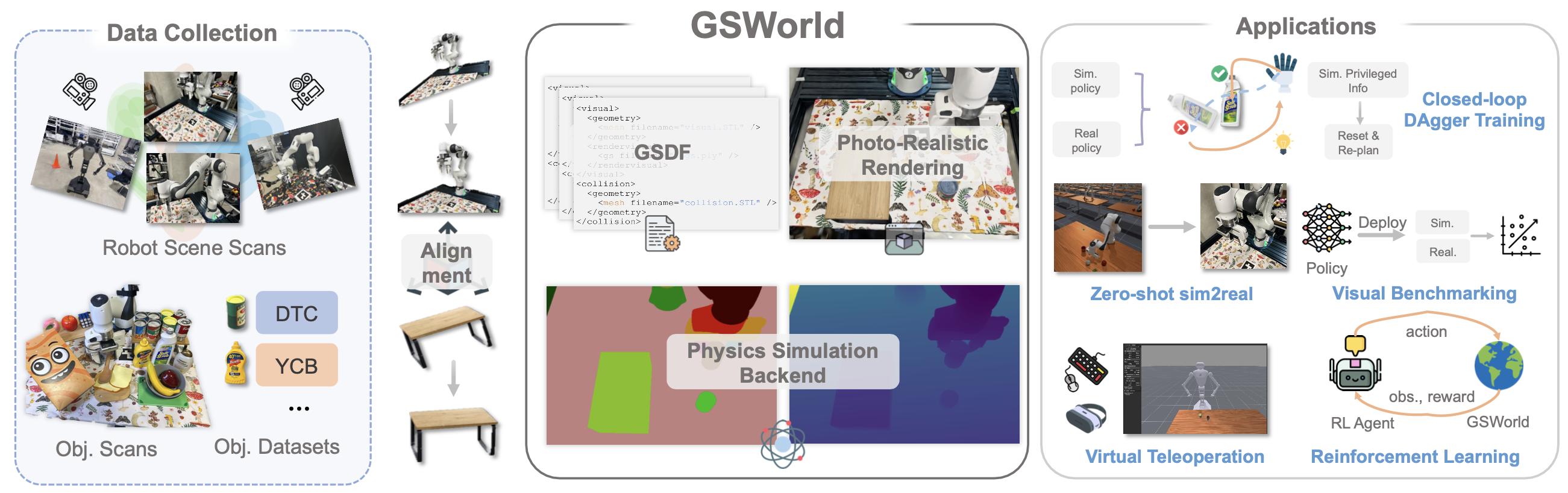

GSWorld是一个鲁棒性强、照片级逼真的机器人操作模拟器,它结合3D高斯溅射(GS)和物理引擎。该框架提倡“闭环”策略开发,即通过对从真实机器人数据中学习的策略进行可复现的评估,以及无需使用真实机器人即可进行sim2real策略训练。为了实现各种场景的照片级逼真渲染,提出一种资源格式,称为GSDF(高斯场景描述文件),它将网格高斯表示与机器人URDF和其他目标融合在一起。通过简化的重建流程,构建一个GSDF数据库,其中包含3种用于单臂和双手操作的机器人模型,以及超过40个目标。结合 GSDF 和物理引擎,展示几个直接有趣的应用:(1)学习零样本 sim2real 像素到动作操作策略,并进行逼真的渲染;(2)自动收集高质量的 DAgger 数据,以使策略适应部署环境;(3)在仿真中对真实机器人操作策略进行可复现的基准测试;(4)通过虚拟远程操作收集仿真数据;以及(5)零样本 sim2real 视觉强化学习。

机器人仿真。随着计算机图形渲染[54]和物体材质仿真[50]技术的进步,机器人领域设计了各种物理引擎[10, 13]和仿真器[47, 56, 60]来支持各种机器人任务。近年来,越来越多的仿真器开始提升效率和保真度。例如,Mujoco-Jax[60]利用即时编译器[18]在Python中实现了令人印象深刻的仿真效率。为了提高渲染保真度并缩小仿真与真实世界之间的视觉差距,近期的研究转向了复杂的光线追踪技术[54]和生成式人工智能工具(Robocasa)[39],以缩小仿真渲染与真实世界之间的视觉观察差距。最近出现的“元-仿真器”Roboverse[15]试图提供一个统一的仿真接口,以充分利用各个仿真器的优势。

GSWorld 是一款闭环式、照片级真实感的仿真套件,它将 3DGS 与物理引擎相结合,从而缩小操作过程中视觉空间和动作空间的差距。“闭环”指的是可以使用同一环境进行训练、评估、故障诊断和重标记,从而实现快速迭代:策略在感知照片级真实感渲染的同时,还能在机器人的原生空间中发出控制指令,所有操作都在一个高度模拟真实场景的仿真器中完成,足以支持零样本迁移和高效适应。GSWorld 支持一系列下游应用,尤其是在模仿学习、强化学习和 DAgger 式数据采集方面,能够实现有效的仿真-到-真实迁移。如图所示:

问题定义

定义从视觉观测中学习机器人策略的问题。令 S_sim 表示模拟场景,G_real 表示由 3DGS 从多个 RGB 视角 V = Σv_i 重建的真实场景 S_real。G_real 可用于渲染新视角 RGB 图像 Igs = G_real(p,s),从而在任意相机姿态 p 和环境状态 s 下实现场景的逼真渲染。目标是用 3DGS 渲染的图像 Igs 替换原始的真实世界 RGB 观测值 I_real,以用于下游机器人学习任务,包括 IL、RL 和 DAgger。

形式上,在每个时间步 t,系统的底层状态表示为 s_t = (q_t, x1_t, …, xn_t),其中 q_t 表示机器人的关节位置,xk_t 表示 S_real 中第 k 个物体的 6D 位姿。主要使用关节位置控制来控制机器人。机器人接收观测值 o_t = Igs_t = G_real(p_t, s_t),该观测值由 G_real 根据当前相机位姿 p_t 和环境状态 s_t 渲染而成。

在强化学习 (RL) 中,策略 π_θ 通过与环境交互并获得奖励来训练。在模仿学习 (IL) 中,专家 E 提供演示 τ_e = {(q_1, o_1, a_1), …, (q_T, o_T, a_T)},这些演示用于监督 π_θ。在 DAgger 中,通过收集先前失败案例中的专家部署结果来迭代地改进 π_θ,从而得到演示 τ_D。在所有情况下,该策略的输入都是 o_t = Igs_t 而不是 I_real,以及机器人本体感觉 q,即 a_t ∼ π_θ(Igs_t, q_t)。

在测试阶段,训练好的策略 π_θ 必须能够泛化到真实世界的观测结果 I_real,以确保 GSWorld 能够弥合模拟到真实的视觉差距。

Real2Sim 重建流程

GSWorld 创建 GSDF 资源以构建逼真的场景,如图所示。与现有专注于在单个场景中构建机器人的工作 [17, 27, 34, 45, 59] 相比,GSWorld 的设计理念是:(1) 采用易于使用的简化流程,减少手动对齐工作量;(2) 融合 3DGS 领域的最新进展,例如几何精度 [19]。

a) 采集训练视图:为了构建包含机器人的场景,同时使用机器人传感器(例如腕部摄像头和第三人称摄像头)和手机摄像头,并在场景捕获过程中保存机器人的当前关节位姿。

b) 对齐尺度以进行度量表示:现有的 real2sim2real 方法 [43, 45] 依赖于 COLMAP [49],这会引入尺度歧义。虽然这种歧义在单个场景中可以手动处理,但它会影响多种机器人形态和场景的可扩展性。为了避免手动进行比例校准,采用一种简单的解决方案:在数据采集过程中,在桌面上放置一个打印的 ArUco 标记 [14, 23]。ArUco 标记检测的关键点被投影到由 3DGS 生成的点云上。然后,用 ArUco 标记的已知比例来缩放点云。此外,ArUco 标记还有助于识别碰撞中的支撑面并估计重力方向。

c) 机器人和工作台的对齐:给定静态机器人 R 的度量尺度 G_real 和仿真 S_sim 中的度量尺度机器人 URDF,将仿真中的关节位置与现实世界对齐。然后,从机器人 URDF 的视觉网格中采样并加密表面点云。然后,执行 ICP 来计算刚体变换 Tgs_R,sim : G_real = Tgs_R,sim · S_sim。与之前的方法 [45] 相比,由于尺度固定,ICP 具有更少的自由度。给定对齐方式,用 K-NN 对 G_real 中的机器人连杆进行分割。

d) 物体资源:之前的重建阶段侧重于背景和机器人扫描。对于可移动物体 O,考虑整合现有的大规模数据集并支持自定义物体以提高泛化能力。具体来说,用 DTC [12] 以获得逼真的视觉效果,以及 YCB [4]。对于自定义物体,用 2DGS [19] 来获得重建 Ogs 和网格重建。质量通过称重来估计。物体底部未观测的区域可以选择性地使用非模态重建 [2, 55] 或 3D 物体生成 [31] 方法进行修复。类似地,用 ICP 来获得第 k 个物体的变换 Tgs_k,sim:Ogs_k = Tgs_k,sim · O_k。

应用 - 闭环视觉操作策略开发

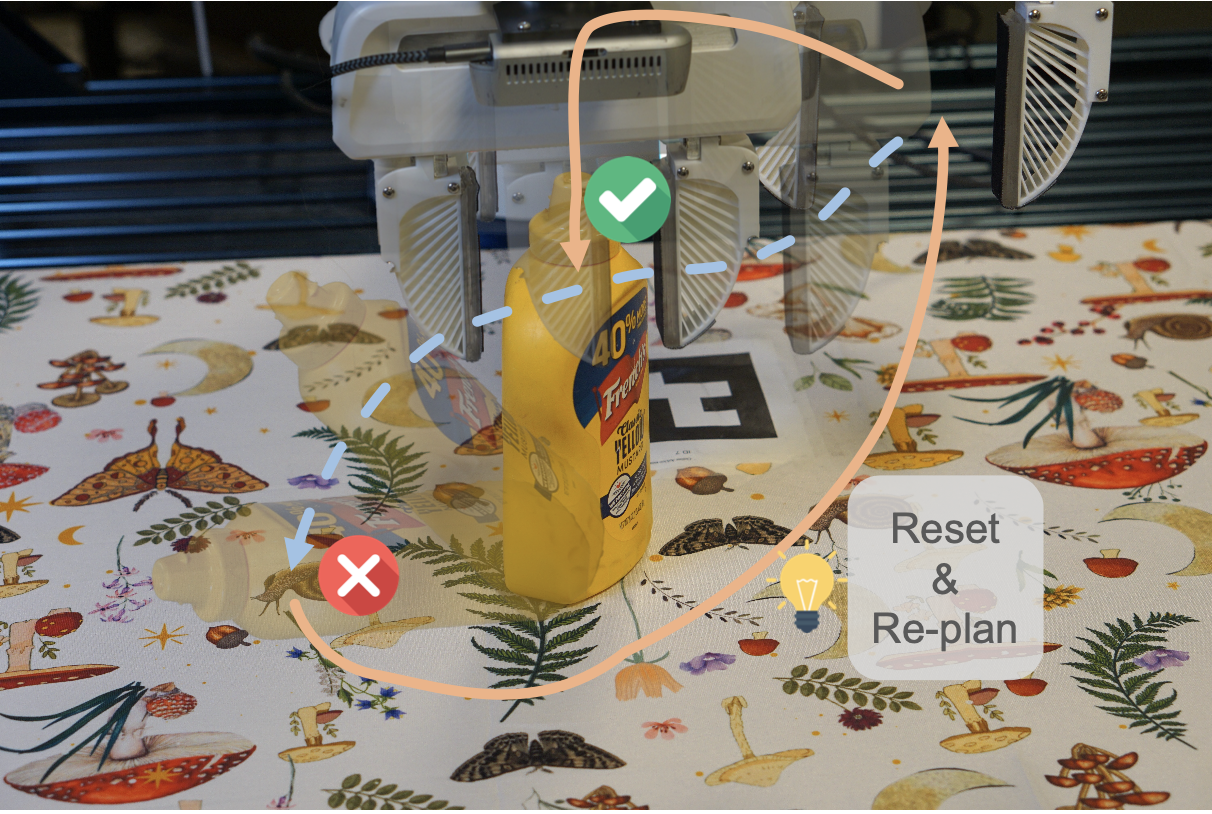

a) 闭环 DAgger 训练:在传统的模仿学习设置中,策略权重在训练和部署后不再更新。部署过程中,策略经常会遇到故障。DAgger [48] 提供一种解决方案,它使用修正数据来训练模型,使其能够适应故障情况。先前的研究表明,DAgger 数据比普通数据具有更高的数据效率。然而,收集 DAgger 数据十分困难,因为它需要重现场景设置,以便模型“重新体验”故障情况。

GSWorld 提供了一个用于在仿真环境中自动收集 DAgger 数据的接口。给定目标部署环境的 GSDF 和具有脚本策略的任务,用 GSWorld 来部署这些策略。对于故障记录 D_f = (s_1 , . . . , s_T),用均匀采样器随机采样恢复状态 s_r ∼ D_f,其中任务在 s_r 中仍然可行,并运行运动规划器以获得修正数据,如图所示。

为了迭代地改进零样本仿真-到-真实环境的策略,收集数据、评估策略、记录故障并进行恢复,从而得到聚合数据集 τ_S:τ_S = Σ_i(Q_s, O_s, A_s)_i,其中 A_s 表示动作标签,O_s = Igs 表示仿真机器人的关节位置,i 表示 DAgger 迭代次数。

为了改进使用真实世界数据训练的策略,首先评估这些策略并重复相同的循环,从而得到数据集 τ_R:τ_R = (Q_r, O_r, A_r) ∪ τ_S,其中 Q_r、O_r 和 A_r 是通过远程操作在真实世界中采集的。

b) 视觉基准测试:最近的VLA [3, 33, 40] 训练适用于多种不同机器人形态的通用策略。这些基础模型通过学习大量的跨形态训练数据,能够以少样本甚至零样本的方式适应未见过的机器人硬件和语言指令 [3, 33]。然而,由于它们在训练过程中依赖于真实机器人数据,因此目前尚无标准化的视觉操作基准测试来研究基础模型的质量及其对新型形态的数据采样效率。

GSWorld 提供一个照片级真实感的渲染界面来解决这一问题。其利用 GSDF 资源,提供各种场景的逼真模拟,涵盖不同的机器人形态和丰富的可交互对象。用 ManiSkill [51] 作为模拟器后端,定义一系列操作任务。此外,还使用图像增强技术进一步缩小了模拟与真实场景之间的视觉差距。

c) 强化学习:强化学习需要智体与环境之间进行大量的交互,通常采用并行计算 [51]。为了更好地支持强化学习,GSWorld 优化其实现,仅并行处理与场景中运动部件(即机器人 R 和物体 O)相关的 3DGS 点,而将其他点缓存为单个副本。这能够使用单个 GPU 运行大规模并行计算,从而加速强化学习的收敛。

a) 硬件平台:尽管 GSWorld 可扩展至多种机器人平台,但选择三种机器人平台进行评估:配备 一个UMI 夹爪的 Franka Research 3 (FR3) 机器人 [9];配备一个并联夹爪的 UF xArm6 机器人;以及配备两个 6 自由度机械臂的 Galaxea R1 双臂机器人。如图所示:

b) 实验方案:总共在 FR3 上评估 4 项操作任务,在 xArm 上评估 3 项操作任务。还使用 R1 机器人来演示 GSWorld 支持虚拟仿真远程操作以采集数据。对于策略实现,用 ACT [62] 和 Pi 0 [3] 来证明 GSWorld 与策略无关。为了进行视觉基准测试,特意使用不同的训练设置和数据量来训练策略,以评估“好”策略和“坏”策略的性能。

c) 操作任务设计:设计以下桌面操作任务来评估性能;

对FR3 如图所示:

对xArm如图所示:

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献211条内容

已为社区贡献211条内容

所有评论(0)