【完整源码+数据集+部署教程】桥梁裂缝检测系统源码和数据集:改进yolo11-GhostHGNetV2

【完整源码+数据集+部署教程】桥梁裂缝检测系统源码和数据集:改进yolo11-GhostHGNetV2

背景意义

研究背景与意义

随着城市化进程的加快,桥梁作为重要的交通基础设施,其安全性和可靠性愈发受到重视。桥梁的结构损伤,尤其是裂缝的出现,往往是导致桥梁失效的前兆。因此,及时、准确地检测和评估桥梁裂缝,对于确保交通安全和延长桥梁使用寿命具有重要意义。传统的桥梁检测方法多依赖人工巡检,不仅效率低下,而且容易受到人为因素的影响,导致漏检或误检现象的发生。随着计算机视觉技术的快速发展,基于深度学习的自动化检测方法逐渐成为研究热点。

本研究旨在基于改进的YOLOv11模型,构建一个高效的桥梁裂缝检测系统。YOLO(You Only Look Once)系列模型以其实时性和高准确率在目标检测领域中表现突出。通过对YOLOv11进行改进,我们希望能够提升其在桥梁裂缝检测中的性能,尤其是在复杂环境下的检测能力。为此,我们使用了包含1900张标注图像的数据集,该数据集专注于桥梁裂缝的实例分割,提供了丰富的训练样本和多样的裂缝特征。

数据集的构建和预处理过程为模型的训练提供了坚实的基础。通过对图像进行增强处理,如随机翻转和亮度调整,能够有效提高模型的泛化能力。此外,数据集中的裂缝标注采用YOLOv8格式,确保了与YOLO系列模型的兼容性。通过这些技术手段,我们期望实现对桥梁裂缝的高效、准确检测,从而为桥梁的维护和管理提供科学依据。

综上所述,本研究不仅具有重要的理论价值,也为实际工程应用提供了切实可行的解决方案。通过改进YOLOv11模型,我们希望能够推动桥梁检测技术的发展,提高公共基础设施的安全性,最终实现更高效的城市交通管理。

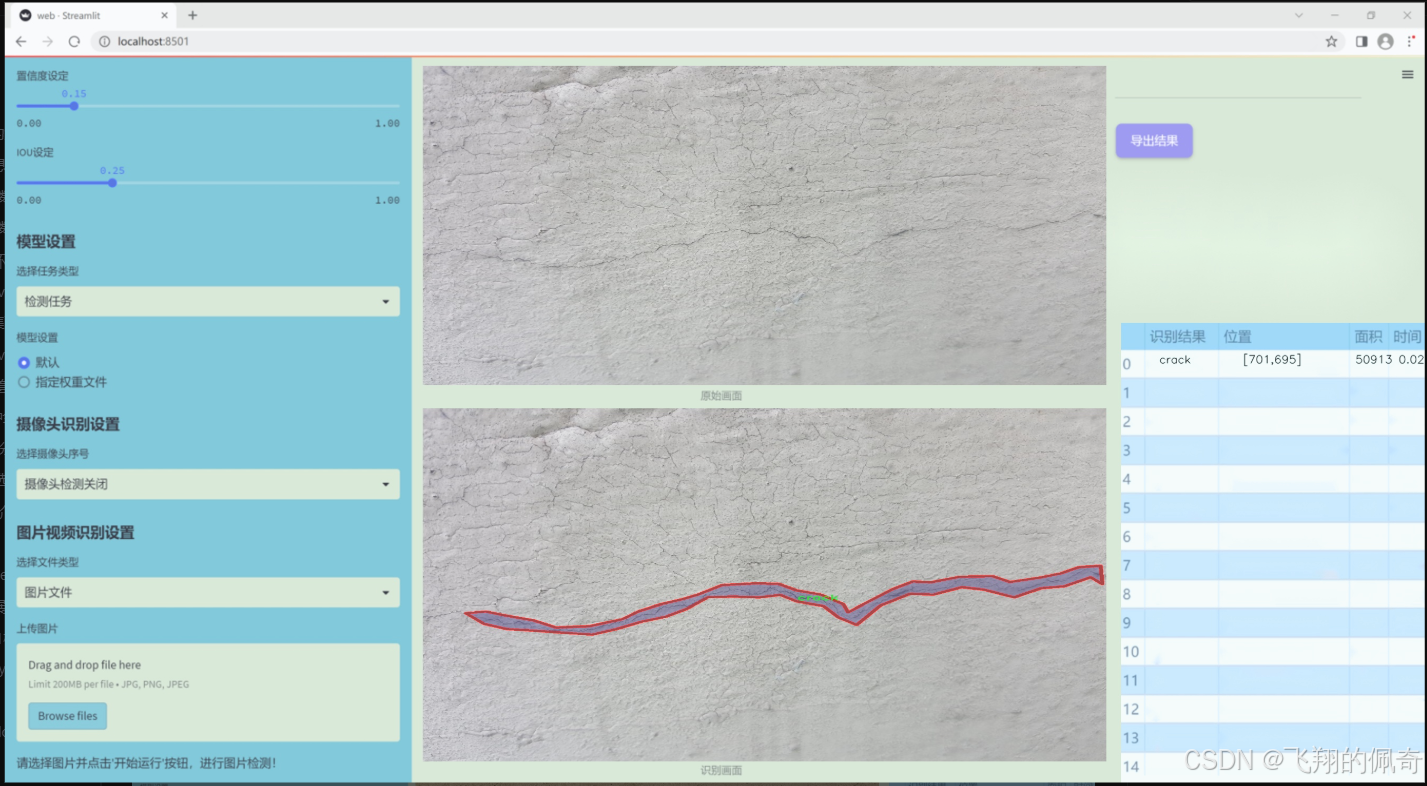

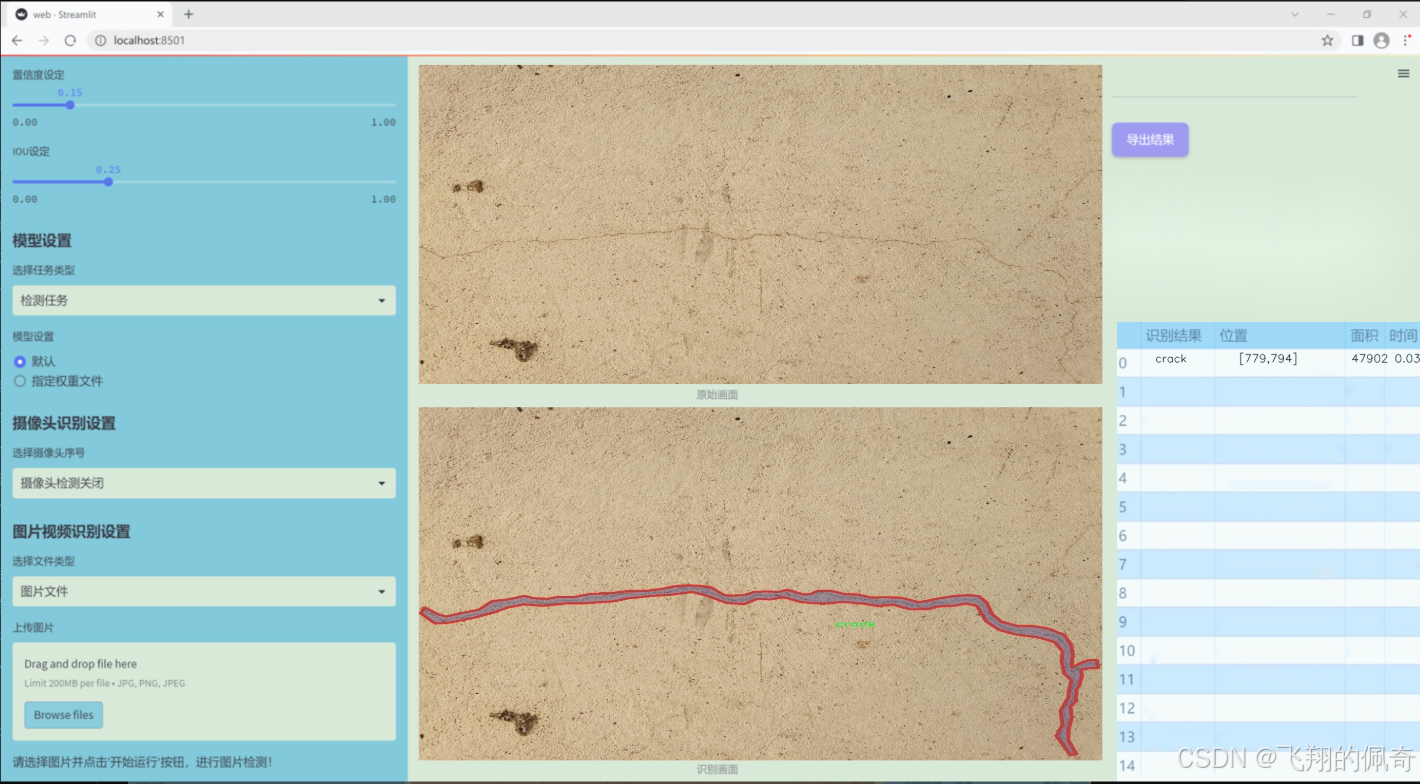

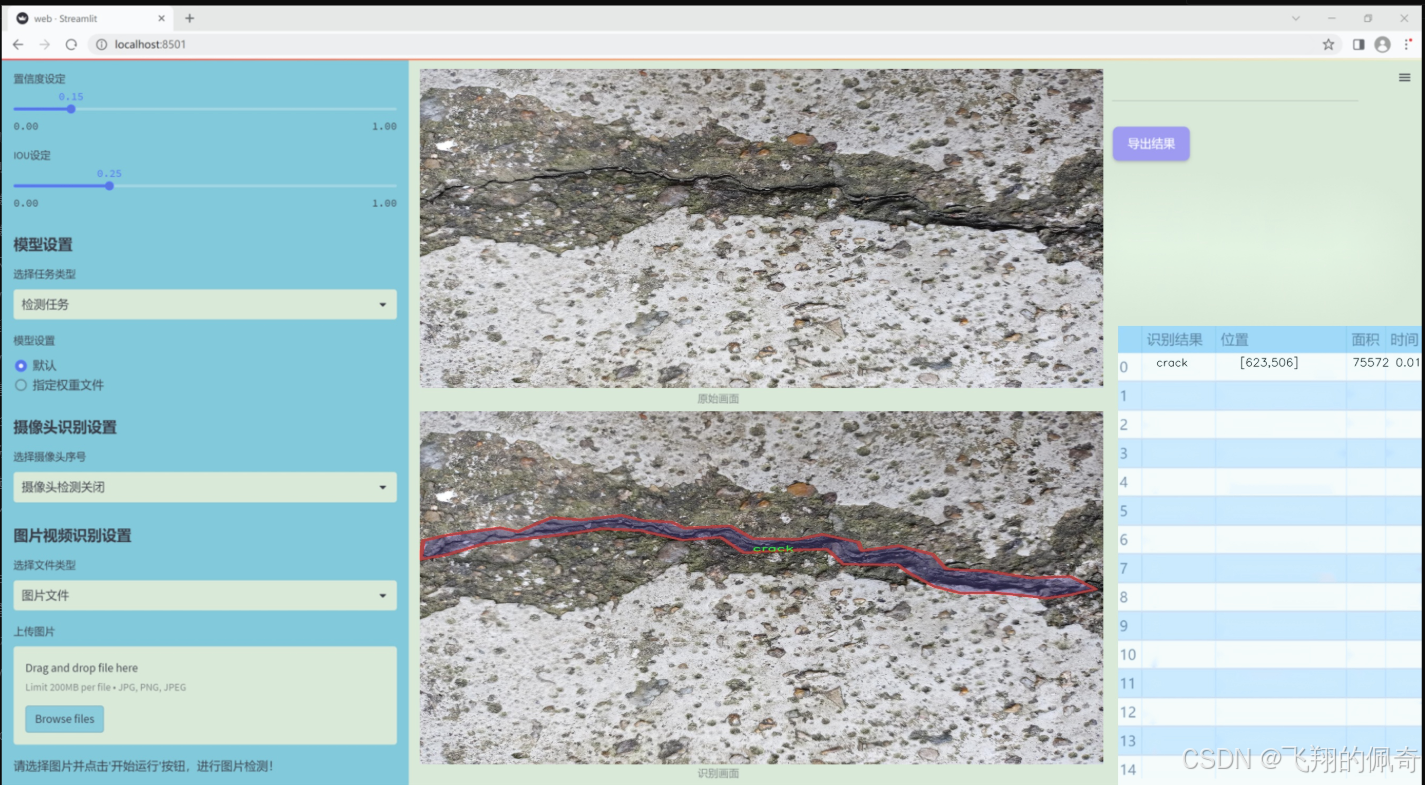

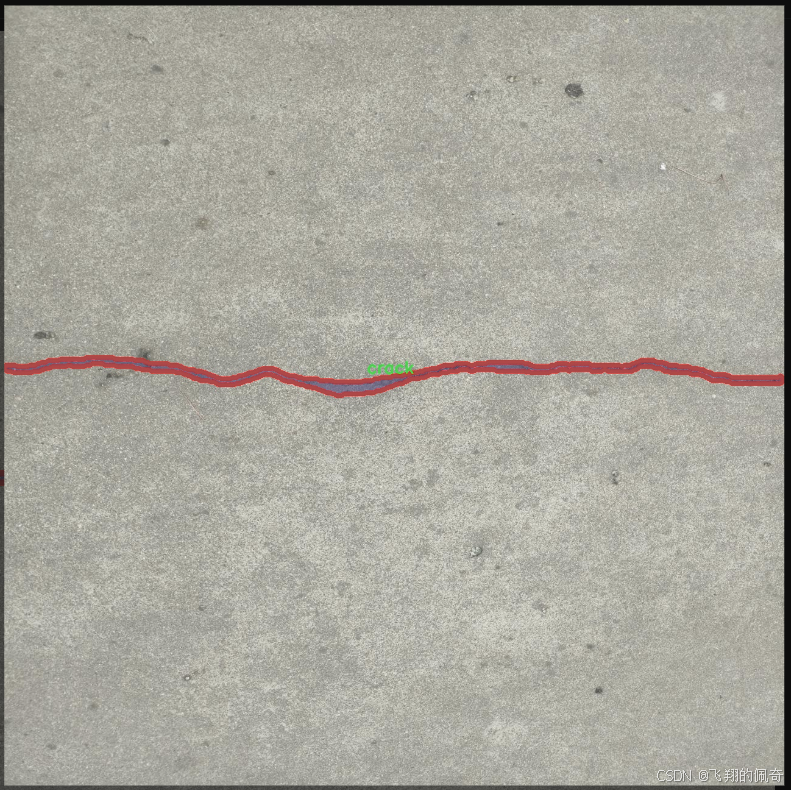

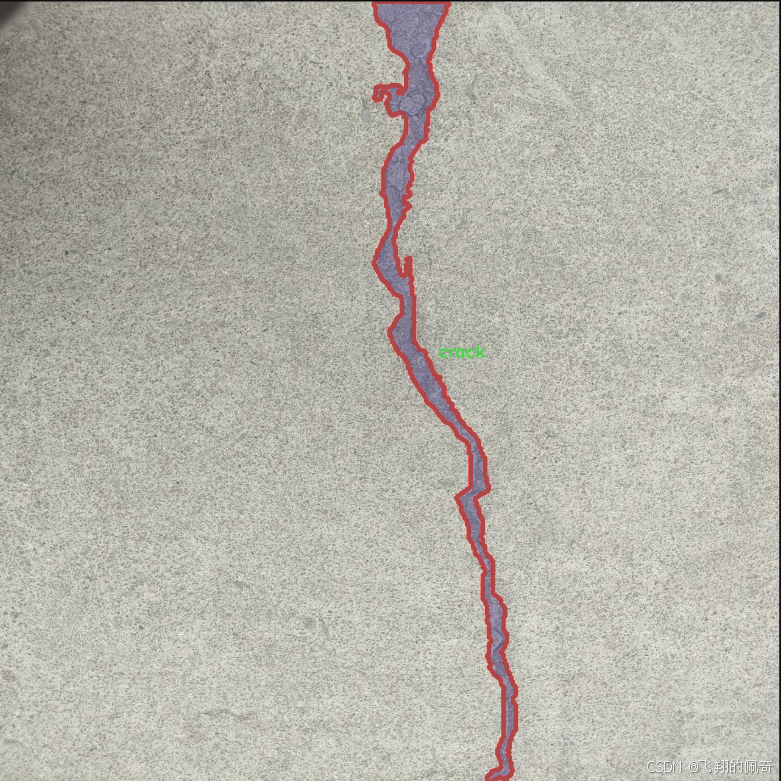

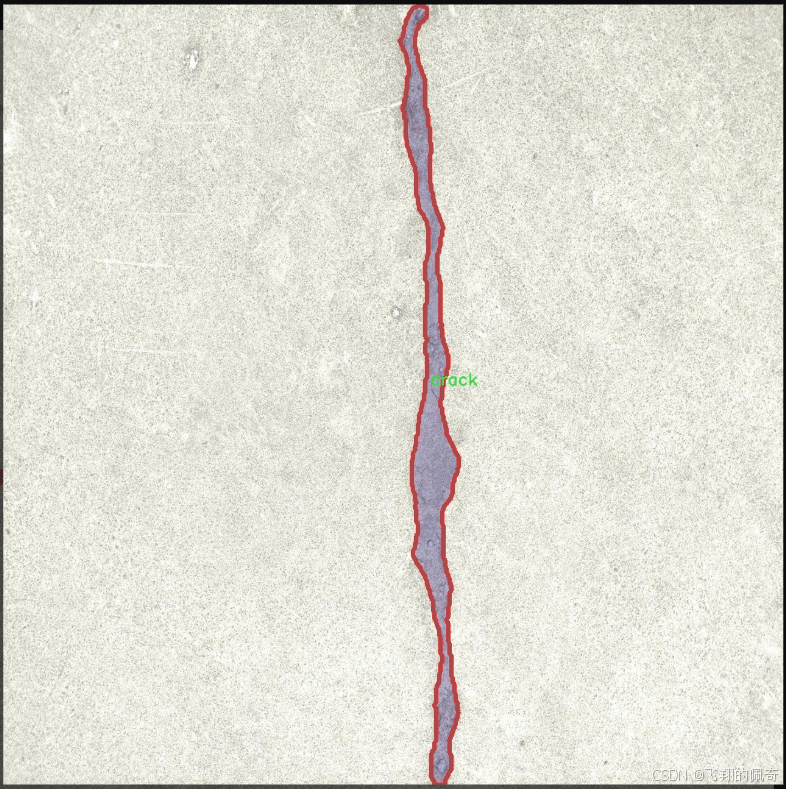

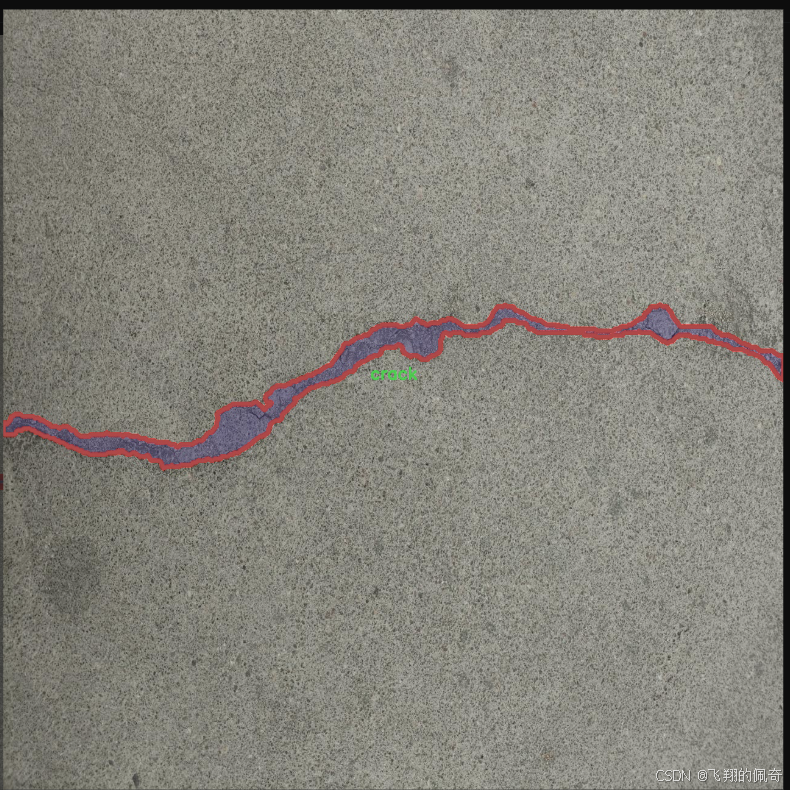

图片效果

数据集信息

本项目数据集信息介绍

本项目所使用的数据集名为“bridge cracktest01”,旨在为改进YOLOv11的桥梁裂缝检测系统提供高质量的训练数据。该数据集专注于桥梁结构的完整性监测,尤其是裂缝的识别与分类。数据集中包含的类别数量为1,具体类别为“crack”,即裂缝。这一单一类别的设计使得模型能够专注于识别和定位桥梁上的裂缝,从而提高检测的准确性和效率。

在数据集的构建过程中,特别注重了数据的多样性和代表性。收集的图像涵盖了不同类型的桥梁结构,包括但不限于钢桥、混凝土桥和悬索桥等。每张图像均经过精心标注,确保裂缝的边界清晰可见,且标注的准确性经过多次审核,以避免误标和漏标现象。此外,数据集中还包含了不同光照条件、天气状况和视角下的桥梁裂缝图像,以增强模型的鲁棒性和适应性。

为了确保模型在实际应用中的有效性,数据集还考虑了裂缝的不同尺寸和形态,包括细小的裂缝和较大的裂缝,这为模型提供了丰富的学习样本。通过这种方式,期望训练出的YOLOv11模型能够在实际桥梁检测中,快速、准确地识别出潜在的裂缝问题,从而为桥梁的维护和安全评估提供有力支持。

总之,“bridge cracktest01”数据集不仅为YOLOv11的训练提供了坚实的基础,也为未来的桥梁检测技术发展奠定了重要的参考价值。通过对这一数据集的深入研究与应用,期待能够在桥梁安全监测领域取得更大的突破。

核心代码

以下是经过简化和注释的核心代码部分,主要保留了模型的构建和前向传播的功能。

import torch

import torch.nn as nn

定义模型的结构规格

MODEL_SPECS = {

“MobileNetV4ConvSmall”: {

“conv0”: {“block_name”: “convbn”, “num_blocks”: 1, “block_specs”: [[3, 32, 3, 2]]},

“layer1”: {“block_name”: “convbn”, “num_blocks”: 2, “block_specs”: [[32, 32, 3, 2], [32, 32, 1, 1]]},

“layer2”: {“block_name”: “convbn”, “num_blocks”: 2, “block_specs”: [[32, 96, 3, 2], [96, 64, 1, 1]]},

“layer3”: {“block_name”: “uib”, “num_blocks”: 6, “block_specs”: [[64, 96, 5, 5, True, 2, 3], [96, 96, 0, 3, True, 1, 2]]},

“layer4”: {“block_name”: “uib”, “num_blocks”: 6, “block_specs”: [[96, 128, 3, 3, True, 2, 6], [128, 128, 5, 5, True, 1, 4]]},

“layer5”: {“block_name”: “convbn”, “num_blocks”: 2, “block_specs”: [[128, 960, 1, 1], [960, 1280, 1, 1]]}

}

}

def conv_2d(inp, oup, kernel_size=3, stride=1, groups=1, bias=False, norm=True, act=True):

“”"

创建一个2D卷积层,包含可选的批归一化和激活函数。

Args:

inp: 输入通道数

oup: 输出通道数

kernel_size: 卷积核大小

stride: 步幅

groups: 分组卷积

bias: 是否使用偏置

norm: 是否使用批归一化

act: 是否使用激活函数

Returns:

nn.Sequential: 包含卷积层、批归一化和激活函数的序列

"""

conv = nn.Sequential()

padding = (kernel_size - 1) // 2 # 计算填充

conv.add_module('conv', nn.Conv2d(inp, oup, kernel_size, stride, padding, bias=bias, groups=groups))

if norm:

conv.add_module('BatchNorm2d', nn.BatchNorm2d(oup))

if act:

conv.add_module('Activation', nn.ReLU6())

return conv

class UniversalInvertedBottleneckBlock(nn.Module):

def init(self, inp, oup, start_dw_kernel_size, middle_dw_kernel_size, middle_dw_downsample, stride, expand_ratio):

“”"

初始化通用反向瓶颈块

Args:

inp: 输入通道数

oup: 输出通道数

start_dw_kernel_size: 起始深度卷积核大小

middle_dw_kernel_size: 中间深度卷积核大小

middle_dw_downsample: 是否进行下采样

stride: 步幅

expand_ratio: 扩展比例

"""

super().__init__()

self.start_dw_kernel_size = start_dw_kernel_size

if self.start_dw_kernel_size:

stride_ = stride if not middle_dw_downsample else 1

self._start_dw_ = conv_2d(inp, inp, kernel_size=start_dw_kernel_size, stride=stride_, groups=inp, act=False)

expand_filters = int(inp * expand_ratio) # 计算扩展后的通道数

self._expand_conv = conv_2d(inp, expand_filters, kernel_size=1)

self.middle_dw_kernel_size = middle_dw_kernel_size

if self.middle_dw_kernel_size:

stride_ = stride if middle_dw_downsample else 1

self._middle_dw = conv_2d(expand_filters, expand_filters, kernel_size=middle_dw_kernel_size, stride=stride_, groups=expand_filters)

self._proj_conv = conv_2d(expand_filters, oup, kernel_size=1, stride=1, act=False)

def forward(self, x):

"""前向传播"""

if self.start_dw_kernel_size:

x = self._start_dw_(x)

x = self._expand_conv(x)

if self.middle_dw_kernel_size:

x = self._middle_dw(x)

x = self._proj_conv(x)

return x

def build_blocks(layer_spec):

“”"

根据层规格构建网络层

Args:

layer_spec: 层的规格字典

Returns:

nn.Sequential: 构建的层

"""

if not layer_spec.get('block_name'):

return nn.Sequential()

block_names = layer_spec['block_name']

layers = nn.Sequential()

if block_names == "convbn":

for i in range(layer_spec['num_blocks']):

args = dict(zip(['inp', 'oup', 'kernel_size', 'stride'], layer_spec['block_specs'][i]))

layers.add_module(f"convbn_{i}", conv_2d(**args))

elif block_names == "uib":

for i in range(layer_spec['num_blocks']):

args = dict(zip(['inp', 'oup', 'start_dw_kernel_size', 'middle_dw_kernel_size', 'middle_dw_downsample', 'stride', 'expand_ratio'], layer_spec['block_specs'][i]))

layers.add_module(f"uib_{i}", UniversalInvertedBottleneckBlock(**args))

else:

raise NotImplementedError

return layers

class MobileNetV4(nn.Module):

def init(self, model):

“”"

初始化MobileNetV4模型

Args:

model: 模型名称

"""

super().__init__()

assert model in MODEL_SPECS.keys()

self.spec = MODEL_SPECS[model]

# 构建模型的各个层

self.conv0 = build_blocks(self.spec['conv0'])

self.layer1 = build_blocks(self.spec['layer1'])

self.layer2 = build_blocks(self.spec['layer2'])

self.layer3 = build_blocks(self.spec['layer3'])

self.layer4 = build_blocks(self.spec['layer4'])

self.layer5 = build_blocks(self.spec['layer5'])

self.features = nn.ModuleList([self.conv0, self.layer1, self.layer2, self.layer3, self.layer4, self.layer5])

def forward(self, x):

"""前向传播,返回特征图"""

features = [None] * 4 # 用于存储特征图

for f in self.features:

x = f(x)

# 根据输入大小选择特征图

if x.size(2) in [x.size(2) // 4, x.size(2) // 8, x.size(2) // 16, x.size(2) // 32]:

features[x.size(2) // 4] = x

return features

定义不同大小的MobileNetV4模型

def MobileNetV4ConvSmall():

return MobileNetV4(‘MobileNetV4ConvSmall’)

示例代码

if name == ‘main’:

model = MobileNetV4ConvSmall()

inputs = torch.randn((1, 3, 640, 640)) # 随机输入

res = model(inputs) # 前向传播

for i in res:

print(i.size()) # 打印输出特征图的尺寸

代码说明:

模型规格定义:MODEL_SPECS 字典定义了不同 MobileNetV4 模型的结构。

卷积层构建:conv_2d 函数用于创建包含卷积、批归一化和激活函数的层。

反向瓶颈块:UniversalInvertedBottleneckBlock 类实现了反向瓶颈结构,包含多个卷积层。

层构建:build_blocks 函数根据层规格构建相应的网络层。

MobileNetV4 模型:MobileNetV4 类实现了整个模型的构建和前向传播逻辑。

模型实例化:提供了创建不同版本 MobileNetV4 模型的函数,并在主程序中展示了如何使用这些模型。

这个程序文件实现了MobileNetV4模型的构建,MobileNetV4是一种轻量级的卷积神经网络,广泛应用于移动设备和边缘计算。文件中定义了不同规模的MobileNetV4模型,包括小型、中型、大型以及混合型模型。代码首先导入了必要的库,然后定义了各个模型的结构规格,包括每一层的卷积块、数量和参数。

在模型规格中,使用字典来描述每个层的构成,包括卷积层的类型(如常规卷积、倒残差块等)、输入输出通道数、卷积核大小、步幅等。每种模型的结构通过不同的字典进行定义,便于后续的模型构建。

make_divisible函数用于确保所有层的通道数都是8的倍数,以满足特定硬件的要求。conv_2d函数是一个辅助函数,用于创建带有卷积、批归一化和激活函数的序列模块。

InvertedResidual类实现了倒残差块的结构,包含扩展卷积、深度卷积和投影卷积。UniversalInvertedBottleneckBlock类则是一个更通用的倒残差块,支持不同的卷积核大小和下采样选项。

build_blocks函数根据传入的层规格构建相应的网络层,支持多种类型的卷积块。MobileNetV4类是整个模型的核心,负责根据指定的模型类型构建网络结构,并定义前向传播的方法。

在__init__方法中,模型的各个层被逐一构建并存储在一个模块列表中,以便在前向传播时依次调用。forward方法则定义了模型的前向传播逻辑,输出特定尺度的特征图。

最后,提供了多个函数用于实例化不同类型的MobileNetV4模型,并在主程序中测试了小型模型的输出,确保其能够正确处理输入数据并返回特征图的尺寸。整体来看,这个文件为MobileNetV4的实现提供了清晰的结构和模块化的设计,便于后续的扩展和应用。

10.4 hcfnet.py

以下是经过简化和注释的核心代码部分,主要保留了 PPA 和 DASI 类的实现,去掉了其他辅助模块以突出主要功能。

import torch

import torch.nn as nn

import torch.nn.functional as F

class SpatialAttentionModule(nn.Module):

def init(self):

super(SpatialAttentionModule, self).init()

# 2通道输入,1通道输出的卷积层,卷积核大小为7,填充为3

self.conv2d = nn.Conv2d(in_channels=2, out_channels=1, kernel_size=7, stride=1, padding=3)

self.sigmoid = nn.Sigmoid() # Sigmoid激活函数

def forward(self, x):

# 计算输入的平均值和最大值

avgout = torch.mean(x, dim=1, keepdim=True)

maxout, _ = torch.max(x, dim=1, keepdim=True)

# 将平均值和最大值拼接

out = torch.cat([avgout, maxout], dim=1)

# 通过卷积和Sigmoid激活函数得到注意力权重

out = self.sigmoid(self.conv2d(out))

return out * x # 返回加权后的输入

class PPA(nn.Module):

def init(self, in_features, filters) -> None:

super().init()

# 定义各个卷积层和注意力模块

self.skip = nn.Conv2d(in_features, filters, kernel_size=1, bias=False)

self.c1 = nn.Conv2d(filters, filters, kernel_size=3, padding=1)

self.c2 = nn.Conv2d(filters, filters, kernel_size=3, padding=1)

self.c3 = nn.Conv2d(filters, filters, kernel_size=3, padding=1)

self.sa = SpatialAttentionModule() # 空间注意力模块

self.drop = nn.Dropout2d(0.1) # Dropout层

self.bn1 = nn.BatchNorm2d(filters) # 批归一化

self.silu = nn.SiLU() # SiLU激活函数

def forward(self, x):

# 通过跳跃连接获取输入特征

x_skip = self.skip(x)

# 经过多个卷积层

x1 = self.c1(x)

x2 = self.c2(x1)

x3 = self.c3(x2)

# 将各个特征相加

x = x1 + x2 + x3 + x_skip

x = self.sa(x) # 应用空间注意力

x = self.drop(x) # 应用Dropout

x = self.bn1(x) # 批归一化

x = self.silu(x) # 激活

return x # 返回处理后的特征

class Bag(nn.Module):

def init(self):

super(Bag, self).init()

def forward(self, p, i, d):

# 计算边缘注意力并加权输入和特征

edge_att = torch.sigmoid(d)

return edge_att * p + (1 - edge_att) * i

class DASI(nn.Module):

def init(self, in_features, out_features) -> None:

super().init()

self.bag = Bag() # 实例化Bag模块

self.tail_conv = nn.Conv2d(out_features, out_features, kernel_size=1) # 尾部卷积

self.conv = nn.Conv2d(out_features // 2, out_features // 4, kernel_size=1) # 中间卷积

self.bns = nn.BatchNorm2d(out_features) # 批归一化

self.skips = nn.Conv2d(in_features[1], out_features, kernel_size=1) # 跳跃连接卷积

def forward(self, x_list):

# 从输入列表中提取特征

x_low, x, x_high = x_list

x = self.skips(x) # 通过跳跃连接卷积处理x

x_skip = x # 保存跳跃连接的输出

x = torch.chunk(x, 4, dim=1) # 将x分成4个部分

# 处理高低特征

if x_high is not None:

x_high = self.skips(x_high)

x_high = torch.chunk(x_high, 4, dim=1)

if x_low is not None:

x_low = self.skips(x_low)

x_low = F.interpolate(x_low, size=[x.size(2), x.size(3)], mode='bilinear', align_corners=True)

x_low = torch.chunk(x_low, 4, dim=1)

# 使用Bag模块结合低特征和高特征

if x_high is None:

x0 = self.conv(torch.cat((x[0], x_low[0]), dim=1))

x1 = self.conv(torch.cat((x[1], x_low[1]), dim=1))

x2 = self.conv(torch.cat((x[2], x_low[2]), dim=1))

x3 = self.conv(torch.cat((x[3], x_low[3]), dim=1))

elif x_low is None:

x0 = self.conv(torch.cat((x[0], x_high[0]), dim=1))

x1 = self.conv(torch.cat((x[1], x_high[1]), dim=1))

x2 = self.conv(torch.cat((x[2], x_high[2]), dim=1))

x3 = self.conv(torch.cat((x[3], x_high[3]), dim=1))

else:

x0 = self.bag(x_low[0], x_high[0], x[0])

x1 = self.bag(x_low[1], x_high[1], x[1])

x2 = self.bag(x_low[2], x_high[2], x[2])

x3 = self.bag(x_low[3], x_high[3], x[3])

# 将处理后的特征拼接

x = torch.cat((x0, x1, x2, x3), dim=1)

x = self.tail_conv(x) # 通过尾部卷积处理

x += x_skip # 加上跳跃连接的输出

x = self.bns(x) # 批归一化

return x # 返回最终输出

代码说明:

SpatialAttentionModule: 实现了空间注意力机制,通过计算输入特征的平均值和最大值来生成注意力权重,并对输入进行加权。

PPA: 该模块结合了多个卷积层和空间注意力模块,通过跳跃连接和特征融合来增强特征表达能力。

Bag: 该模块实现了边缘注意力机制,用于加权输入特征和其他特征。

DASI: 该模块结合了高低层特征,通过Bag模块进行特征融合,并使用卷积和批归一化处理输出。

这个程序文件 hcfnet.py 实现了一个深度学习模型,主要用于图像处理任务。文件中定义了多个类,每个类实现了特定的功能模块。以下是对代码的详细说明。

首先,导入了必要的库,包括 math、torch 及其子模块 nn 和 functional,以及自定义的 Conv 模块。all 列表指定了模块的公共接口,包括 PPA 和 DASI。

接下来定义了 SpatialAttentionModule 类。这个类实现了空间注意力机制。它通过对输入特征图进行平均池化和最大池化,生成两个特征图,并将它们拼接在一起。然后,经过一个卷积层和 Sigmoid 激活函数,得到的输出与输入特征图相乘,从而强调重要的空间区域。

然后是 LocalGlobalAttention 类。这个类结合了局部和全局的注意力机制。输入的特征图被分割成小块(patches),然后通过多层感知机(MLP)进行处理。局部特征经过归一化和加权,得到局部注意力。最后,通过矩阵乘法与一个可学习的参数(prompt)结合,生成最终的输出,并通过插值恢复到原始的特征图大小。

接着是 ECA 类,它实现了有效的通道注意力机制。根据输入通道数动态计算卷积核大小,使用自适应平均池化将特征图缩小到 1x1,然后通过一维卷积和 Sigmoid 激活生成通道权重,最后将这些权重应用于输入特征图。

PPA 类是一个主干网络模块,结合了前面定义的注意力机制。它通过多个卷积层和跳跃连接来处理输入特征图,并在每个阶段应用空间注意力和通道注意力。最终的输出经过批归一化和激活函数处理。

Bag 类实现了一个简单的加权融合机制。它通过对输入特征图进行加权,结合不同来源的特征图,生成最终的输出。

最后是 DASI 类,它是一个集成模块,接收多个输入特征图并通过跳跃连接和卷积层进行处理。它利用 Bag 类对不同层次的特征进行融合,最终生成输出特征图。通过不同的卷积层和激活函数,模型能够有效地整合多层次的信息。

整体来看,这个文件实现了一个复杂的深度学习模型,结合了多种注意力机制和特征融合策略,旨在提高图像处理任务的性能。

源码文件

源码获取

欢迎大家点赞、收藏、关注、评论啦 、查看👇🏻获取联系方式👇🏻

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献30条内容

已为社区贡献30条内容

所有评论(0)