识别物体 3D 位置 + 自动生成机器人抓取位姿」

的 3 条主流实现路径,从到,每条都讲清楚原理、硬件、流程、怎么生成抓取点。

·

工业现场能用、可做成模型部署、能进 ModelZoo 推理的 3 条主流实现路径,从最简单低成本到高精度工业级,每条都讲清楚原理、硬件、流程、怎么生成抓取点。

先讲核心逻辑(万变不离其宗)

要实现两件事:

- 视觉:算出物体真实 3D 坐标 XYZ

- 算法:根据物体形状,自动算出机器人抓取位姿 (X,Y,Z,R,P,Y)

最终输出给机械臂 / MoveIt 直接就能抓。

方案一:深度相机 + 现成 SDK(最快、零训练、直接能用)

硬件

奥比中光、英特尔 RealSense、迈微、驭光 结构光深度相机

原理

相机自带:RGB 图像 + 像素级深度图 + 内置相机内参不用自己训练深度模型。

完整流程

- 深度相机输出:RGB 图 + 深度图 + 点云

- 用 YOLO / 模型识别物体,框出目标

- 截取框内局部点云

- 对点云做:聚类、拟合平面 / 包围盒

- 自动计算:中心点 + 抓取姿态

- 手眼标定 → 转到机器人基坐标系 → 下发抓取

优点

- 不用训练 3D 模型,上手最快

- 点云直接可用,自带深度

- 适合流水线、分拣、普通抓取

缺点

遮挡多、堆叠物体精度一般

方案二:单目普通相机 + 训练深度估计模型(可做成 ModelZoo 推理)

硬件

普通工业 2D 相机即可,不用深度硬件

核心做法(你要的模型方案)

- 训练 YOLO 目标检测模型 → 识别物体

- 训练 / 微调 深度估计模型(MiDaS/DPT) → 单目图预测整图深度

- 结合相机内参,像素反投影生成稠密点云

- 点云聚类、拟合包围盒,算出中心 + 抓取姿态

- 坐标转换到机器人世界坐标系

可以做成模型部署

把 YOLO 检测 + 深度模型 导出 ONNX,放进 ModelZoo,嵌入式 / 地平线都能跑。

优点

只用普通 2D 相机,成本最低;纯 AI 模型方案,可私有化部署。

缺点

比深度相机精度略低,适合规整物体。

方案三:双目相机 + 立体匹配模型(高精度工业级)

硬件

双目工业相机(左右目同步)

原理

双目视差计算 → 生成深度图 → 点云 → 3D 位置 + 抓取位姿

可以用深度学习立体匹配模型(RAFT-Stereo、GMStereo)训练适配你现场场景,做成推理模型。

优点

精度高、抗反光、适合工业杂乱堆叠抓取

缺点

需要标定双目、算法稍复杂

方案四:6DoF 姿态估计模型(直接输出抓取位姿,最顶级)

模型类型

PoseNet、YOLO-6D、PVN3D、GraspNet

能干什么

模型直接训练回归:

- 物体 3D 包围盒

- 中心点 XYZ

- 抓取旋转角 (RPY)不用自己再算姿态,模型直接输出可用抓取位姿。

流程

- 采集物体 RGB + 深度,标注 6DoF 姿态 / 抓取框

- 训练 GraspNet/6D 姿态模型

- 推理直接输出:抓取坐标 + 姿态

- 发给机器人即可执行

优点

最智能,适合异形物体、随意摆放抓取

缺点

标注麻烦、训练数据集要求高

通用:不管哪种方案,生成抓取位置 的标准步骤

- 图像 / 模型识别目标物体

- 获取物体对应点云

- 点云滤波、去噪、聚类分割

- 拟合最小包围盒 → 得到中心 XYZ

- 根据物体长宽高自动生成夹持器开合宽度 + 抓取角度

- 手眼标定矩阵变换 → 转为机械臂基坐标系坐标

- 下发给 MoveIt / 运动控制器 执行抓取

给你最简选型建议

- 想最快落地、不想训练模型 → 选 方案一 深度相机

- 想用普通 2D 相机、做 AI 模型部署进 ModelZoo → 选 方案二

- 工业高精度堆叠抓取 → 方案三 双目立体匹配

- 异形物体、任意姿态抓取 → 方案四 6DoF 姿态模型

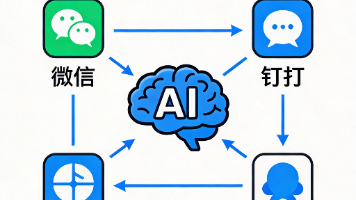

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)