[具身智能-363]:Hugging Face LeRobot 详解:像训练语言模型一样训练机器人

用户群体价值点高校/研究所快速复现 ACT/Diffusion Policy 等顶会算法,降低硬件成本创客/教育者千元级机器人+完整 AI 流水线,适合课程与工作坊机器人初创公司提供可商用的策略基线,缩短从 Demo 到产品周期AI 研究者探索 VLA 模型在具身智能中的 scaling law 与泛化边界LeRobot 不是通用机器人控制系统(如 ROS2 导航/规划栈),而是专注于“感知-决策

LeRobot 是 Hugging Face 于 2024 年 5 月 正式开源的机器人学习框架,专注于模仿学习(Imitation Learning)与视觉-语言-动作基础模型(VLA)。它的核心目标是:降低机器人 AI 的开发门槛,提供从数据采集、模型训练到真实硬件部署的端到端开源流水线,推动“大模型+机器人”技术的民主化。

以下从架构、功能、生态、使用流程及局限性等维度进行系统解析。

📦 一、核心定位与设计理念

| 维度 | 说明 |

|---|---|

| 定位 | 面向模仿学习与基础模型的机器人控制框架 |

| 哲学 | “像训练语言模型一样训练机器人”:数据集标准化、模型开源、训练可复现、一键部署 |

| 开源协议 | Apache 2.0(商业友好) |

| 技术栈 | PyTorch、Hugging Face datasets/transformers/diffusers、ROS2(可选) |

🧩 二、核心架构与模块

LeRobot 采用模块化流水线设计,主要包含以下组件:

GUI/遥操作/VR

ACT/Diffusion/VLA

低延迟推理

数据采集

数据格式化

模型训练

评估与可视化

实机推理部署

HDF5+JSON 标准格式

多GPU/混合精度

真实机械臂控制

1. 数据层

- 标准格式:采用

HDF5存储多模态数据(RGB图像、深度图、关节状态、末端位姿、动作序列、语言指令等),配套meta.json记录机器人构型、采样率、相机内参等。 - HF Datasets 集成:可直接 push/pull 至 Hugging Face Hub,支持版本控制与分片加载。

- 兼容主流数据集:官方提供转换脚本支持

Open X-Embodiment、BridgeData、CALVIN等。

2. 算法层(内置策略)

| 算法 | 原理 | 适用场景 | 官方实现状态 |

|---|---|---|---|

| ACT (Action Chunking with Transformers) | 将动作序列分块预测,Transformer 解码未来 K 步动作 | 精细操作(插拔、折叠、装配) | ✅ 完整训练/评估/部署 |

| Diffusion Policy | 基于扩散模型的动作生成,对噪声鲁棒 | 多模态输入、复杂接触任务 | ✅ 官方优化版 |

| OpenVLA / RT-2 风格 | 视觉-语言-动作基础模型,指令跟随 | 开放词汇任务、跨场景泛化 | ✅ 提供预训练权重与微调脚本 |

| TD-MPC / SAC | 强化学习基线(部分实验性支持) | 仿真环境奖励驱动任务 | 🟡 社区贡献为主 |

3. 部署层

- 推理优化:支持 TensorRT、ONNX 导出,满足 30~50Hz 控制频率需求。

- 硬件抽象层:统一

Robot接口,支持实时读取关节/相机状态,输出动作指令。 - 安全机制:动作裁剪、碰撞检测占位接口、急停信号监听。

🤖 三、官方支持硬件

LeRobot 强调低成本、可复现、易组装,已深度适配以下开源机器人:

| 机器人 | 自由度 | 特点 | 官方支持度 |

|---|---|---|---|

| Koch v1.0/v1.1 | 6 DOF | <¥2000 成本,3D 打印+开源电路,适合入门 | ✅ 完整支持 |

| ALOHA | 双臂各 6 DOF | 斯坦福开源,高精度遥操作,数据集丰富 | ✅ 完整支持 |

| SO-ARM100 | 6 DOF | 轻量级,适合教育/创客 | ✅ 基础支持 |

| 自定义机器人 | 任意 | 需实现 lerobot.robots.Robot 抽象类,提供运动学/驱动接口 |

🟡 需自行开发 |

💡 硬件套件与 3D 打印图纸、BOM 清单均在官方 GitHub 提供,支持国内采购替代件。

🛠 四、典型使用流程(以 ACT + Koch 为例)

1. 环境安装

pip install lerobot

# 依赖:torch>=2.1, diffusers, datasets, opencv-python, numpy2. 数据采集

# 启动遥操作采集 GUI

lerobot-record --robot.type=lerobot.koch_v1.0 \

--dataset.repo_id=myuser/koch_cup_place \

--episodes=50- 支持键盘/游戏手柄/VR 手柄/主从臂遥操作

- 自动验证数据完整性(缺失帧、动作跳变检测)

3. 模型训练

lerobot-train --config-path configs/act_koch_real.yaml \

--dataset.repo_id=myuser/koch_cup_place \

--output_dir outputs/act_koch_v1- 支持多卡分布式训练、梯度累积、学习率调度

- 自动记录 TensorBoard / W&B 日志

4. 评估与部署

# 仿真评估

lerobot-eval --policy.path outputs/act_koch_v1/checkpoint.pt \

--env.type=lerobot.koch_sim

# 实机运行

lerobot-run --policy.path outputs/act_koch_v1/checkpoint.pt \

--robot.type=lerobot.koch_v1.0🌐 五、Hugging Face 生态集成优势

| 能力 | 说明 |

|---|---|

| 模型/数据集 Hub | 一键 push_to_hub,社区可 fork 微调、对比 benchmark |

| Spaces Demo | 提供 WebUI 演示,支持上传视频预测动作流 |

| AutoTrain 兼容 | 未来将支持无代码训练(类似 LLM 微调流程) |

| VLA 模型生态 | 与 openvla、pi0、Octo 等社区模型无缝对接 |

⚠️ 六、当前局限性

| 维度 | 说明 |

|---|---|

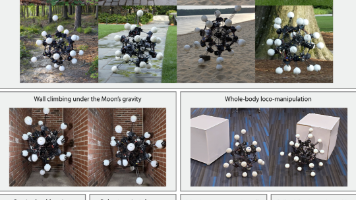

| 任务范围 | 主要面向桌面级抓取/操作任务,移动底盘、多机协同、复杂动态场景支持有限 |

| 实时性瓶颈 | 扩散模型/大 VLA 模型推理延迟较高,需 GPU 或边缘加速芯片(如 Jetson Orin) |

| 泛化边界 | 依赖高质量演示数据,分布外(OOD)场景仍需数据增强或在线微调 |

| 硬件调试门槛 | 电机校准、相机标定、通信同步仍需一定机器人基础 |

🔮 七、未来发展方向(官方路线图)

- 更大规模 VLA 预训练:融合多语言指令、3D 视觉、触觉反馈

- 在线/持续学习:支持实机交互中自动收集失败样本并增量更新

- 安全与约束控制:引入形式化验证、安全屏障函数(CBF)

- 更多开源硬件生态:适配 UFactory、Mech-Mind、国内厂商机械臂

- AutoML for Robotics:自动化超参搜索、数据清洗、策略选择

📚 八、学习资源

| 类型 | 链接 |

|---|---|

| 官方 GitHub | https://github.com/huggingface/lerobot |

| 技术博客(首发) | https://huggingface.co/blog/lerobot |

| 文档 | https://huggingface.co/docs/lerobot |

| 预训练模型 Hub | https://huggingface.co/lerobot |

| 数据集示例 | https://huggingface.co/datasets/lerobot |

| 社区 Discord | https://discord.gg/huggingface(#lerobot 频道) |

💡 总结:适合谁用?

| 用户群体 | 价值点 |

|---|---|

| 高校/研究所 | 快速复现 ACT/Diffusion Policy 等顶会算法,降低硬件成本 |

| 创客/教育者 | 千元级机器人+完整 AI 流水线,适合课程与工作坊 |

| 机器人初创公司 | 提供可商用的策略基线,缩短从 Demo 到产品周期 |

| AI 研究者 | 探索 VLA 模型在具身智能中的 scaling law 与泛化边界 |

LeRobot 不是通用机器人控制系统(如 ROS2 导航/规划栈),而是专注于“感知-决策-动作”端到端学习的 AI 框架。它正在成为具身智能时代最重要的开源基础设施之一。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献48条内容

已为社区贡献48条内容

所有评论(0)