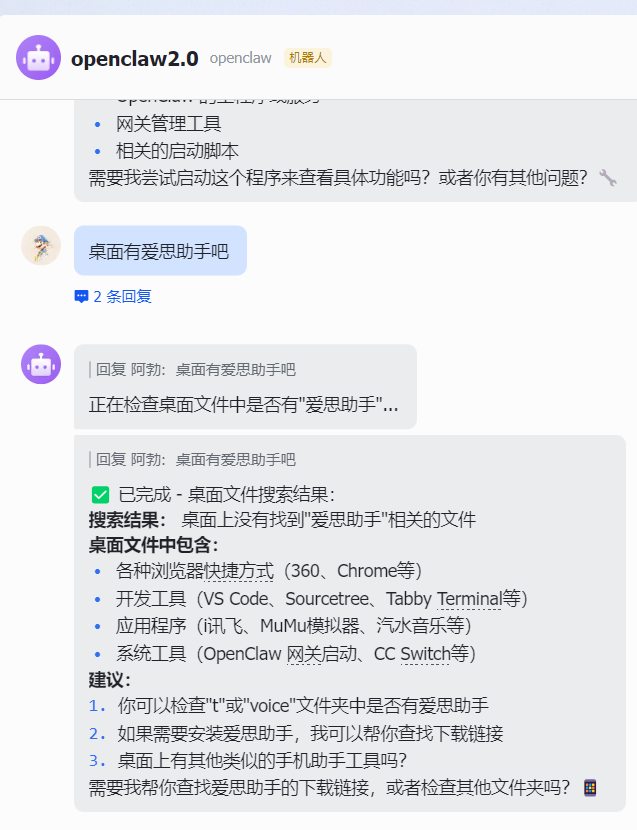

OpenClaw 省 Token 终极指南:GLM-4.6V/4.5-Air 稳定不降效(附关联飞书机器人)

本文提供了OpenClaw+飞书对接本地文件时的Token优化方案。核心思路包括:片段读取文件、避免重复计费、自动裁剪上下文和减少图片输入。具体措施包括安装文件管理和摘要插件、配置上下文压缩、限制文件读取行数和模型输出长度,以及推荐使用文本而非图片输入。文中给出了完整的JSON配置示例,并强调遵循"优先摘要预览、控制上下文、精简输出、少用图片"四条原则,可降低50%-80%的T

在使用 OpenClaw + 飞书对接本地文件时,Token 消耗快、API 限流、响应变慢是最常见问题。本文把最实用、最稳定、不影响功能的省 Token 方案整理成文,照着配就能大幅降低成本。

一、核心思路:只干活、不废话、不吞上下文

GLM 系列模型 Token 消耗高,尤其是长文本、图片、全量文件读取。优化原则只有 4 条:

- 不全文读文件,只摘要 / 片段读取

- 重复指令不重复计费

- 上下文自动裁剪,不无限累积

- 少用图片输入,优先纯文本指令

下面是可直接落地的配置与用法。

二、必开技能:summarize + file-system-manager

这两个组合是 省 Token 神器 ,也是查看本地文件的最佳实践。

1. file-system-manager(本地文件管理)

- 作用:列出、读取、搜索、预览本地文件

- 优势:支持限制读取行数,不会把整份大文件塞进上下文

- 安装:

bash

openclaw plugins install file-system-manager

2. summarize(内容压缩 / 摘要)

- 作用:把长文本、长文件、长对话压成极简要点

- 优势:一次只消耗少量 Token,却能拿到核心信息

- 安装:

bash

openclaw plugins install summarize

最佳实践(必学)

- 列出文件:

plaintext

列出 workspace 所有文件

- 只读前 N 行,不全文读取:

plaintext

读 xxx.py 前30行

- 直接摘要文件,不吞全量 Token:

plaintext

总结 workspace 里 report.md 的内容

三、开启上下文压缩:maxMessages + trimStrategy

在 openclaw.json 的 agents.defaults 中加入以下配置, 自动压缩历史对话 ,从根源上省 Token。

json

"context": {

"maxMessages": 10,

"trimStrategy": "middle",

"enableCompression": true

}

含义说明

maxMessages: 10:只保留最近 10 轮对话,不无限累积trimStrategy: middle:自动裁剪中间冗余内容,保留头尾关键信息enableCompression: true:开启上下文压缩,超长内容自动摘要

四、文件读取限制:只预览、不全读

继续在 agents.defaults 中加入:

json

"tools": {

"file": {

"maxSize": 102400,

"previewLines": 30

}

}

previewLines: 30:默认只读取文件前 30 行maxSize:限制单文件最大体积,避免超大文件吞 Token

五、模型侧优化:低温度 + 限制输出长度

在 agents.defaults.models 中配置:

json

"models": {

"zai/glm-4.6v": {

"maxTokens": 4096,

"temperature": 0.1

},

"zai/glm-4.5-air": {

"maxTokens": 4096,

"temperature": 0.1

}

}

temperature: 0.1:AI 只执行任务,不发散创作maxTokens: 4096:限制单次回复长度,避免超长废话

六、最重要的一条:少用图片输入

GLM-4.6V 视觉能力强,但 图片 Token 消耗极高 。

- 能用文字描述 → 不用截图

- 能用文件内容 → 不用图片上传

- 能发文本指令 → 不发长图 / 多图

这是最省钱、最稳定的习惯。

七、完整可复制的 agents 优化片段

json

"agents": {

"defaults": {

"model": {

"primary": "zai/glm-4.6v",

"fallbacks": ["zai/glm-4.5-air"]

},

"models": {

"zai/glm-4.6v": {

"maxTokens": 4096,

"temperature": 0.1

},

"zai/glm-4.5-air": {

"maxTokens": 4096,

"temperature": 0.1

}

},

"workspace": "you workspace XXXXXXXXXXXXXXXXXXXXX",

"context": {

"maxMessages": 10,

"trimStrategy": "middle",

"enableCompression": true

},

"tools": {

"file": {

"maxSize": 102400,

"previewLines": 30

}

}

}

}

八、总结:4 条省 Token 铁律

- 优先 summarize + file-system-manager :读文件只摘要、只预览,不全文吞 Token

- 控制上下文 :maxMessages=10 + trimStrategy=middle,自动清理冗余

- 低温度 + 短输出 :模型只干活、不废话

- 少图片、多文本 :GLM-4.6V 图片消耗极高,能不用就不用

按这套配置,Token 消耗可降低 50%–80% ,同时大幅减少限流、报错,飞书 + OpenClaw 查看本地文件会更稳定。

也可以直接设置App ID和App Secret(1.2.1部分),

关联飞书机器人

实现手机远程操控你的电脑!!!!

在PowerShell运行下面三个命令:

openclaw config set channels.feishu.appId "你的飞书机器人app-id"

openclaw config set channels.feishu.appSecret "你的飞书机器人-app-secret"

设置连接模式(推荐websocket)

openclaw config set channels.feishu.connectionMode "websocket"

地址:https://open.feishu.cn/app/cli_a92f82797ef9dbd2/baseinfo

image

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)