基于ROS 2架构的RGB-D ORB特征提取技术演进与应用前景深度研究报告

摘要: 随着空间计算时代的到来,视觉SLAM技术正从几何状态估计向高维度语义理解演进。ROS2生态的爆发(下载量增长85%)标志着机器人软件架构进入确定性执行与硬件加速的新纪元。RGB-D传感器(如Orbbec Gemini2)结合ORB特征提取技术,通过物理深度信息解决了传统SLAM的尺度模糊性问题,并在ROS2的零拷贝通信与硬件加速(GPU/FPGA)支持下实现毫秒级延迟。针对动态环境,融合Y

1. 宏观技术背景与空间计算时代的感知范式转移

在现代机器人学、自动驾驶以及增强现实/虚拟现实(AR/VR)的交叉演进中,同步定位与建图(SLAM)技术始终扮演着环境认知与空间计算的基石角色。随着传感器技术的迭代与底层计算架构的重构,视觉SLAM系统正在经历一场深刻的范式转移:从单纯的几何状态估计,向高维度、富语义的物理世界理解迈进。根据2025至2026年度的最新行业指标报告显示,机器人操作系统ROS 2(Robot Operating System 2)的生态系统正处于历史性的爆发阶段,其核心软件包的全球下载量激增了85% 。这一压倒性的数据不仅宣告了ROS 1时代的彻底终结,更标志着整个机器人软件架构已经稳步跨入以确定性执行、分布式高并发网络以及硬件加速为核心特征的现代计算纪元 。

在这一全新的软硬件协同生态中,基于RGB-D(彩色视觉融合红外或结构光深度)传感器的ORB(Oriented FAST and Rotated BRIEF)特征提取技术,凭借其卓越的实时处理能力、优异的旋转与尺度不变性,以及对边缘端算力资源的极致压缩利用,确立了其作为下一代稳健视觉SLAM系统前端感知核心的绝对主导地位 。传统的单目或双目视觉SLAM系统在应对弱纹理墙面、高动态移动物体或光照剧烈变化等极端环境时,往往面临尺度漂移(Scale Drift)、特征关联灾难以及跟踪彻底丢失的严峻挑战 。然而,工业级RGB-D传感器的规模化普及(诸如集成了双目结构光与6轴IMU的Orbbec Gemini 2、Intel RealSense系列以及Luxonis OAK-D等设备)为特征提取直接引入了确定性的绝对物理尺度 。

将这种物理级尺度的感知能力与ROS 2底层基于数据分发服务(DDS)的零拷贝(Zero-Copy)通信管道相结合,再辅以针对特定计算节点(如NVIDIA NITROS或FPGA硬件)的类型适配协议(REP-2007/2009),RGB-D ORB特征提取不仅在纯学术界的基准测试中取得了定位精度的飞跃,更在涵盖智能制造、仓储物流以及家用具身智能(Embodied AI)等广阔的商业落地场景中展现出了不可替代的应用价值 。本报告旨在全景式地深度剖析ROS 2环境下RGB-D ORB特征提取的数学机理、底层软件架构重构、硬件加速机制以及算法在动态非结构化环境中的演进,并对其在未来物理AI(Physical AI)时代的宏大商业应用前景进行严谨的前瞻性量化分析。

2. ORB特征提取的核心机理与RGB-D数据的物理空间锚定

要深刻理解RGB-D ORB特征提取在复杂机器人应用中的优势,必须回溯其底层的数学逻辑与光学成像机制。特征提取是视觉SLAM前端的“视觉皮层”,其效率与质量直接决定了后端优化(如因子图优化或光束法平差)的成败。

2.1 ORB算法的数学重构与极简计算优势

ORB算法本质上是对oFAST(Oriented FAST)角点检测与rBRIEF(Rotation-Aware BRIEF)描述子生成技术的精妙数学结合 。在特征点检测阶段,传统的FAST算法通过比较候选像素点周围特定半径圆上的像素强度分布来快速筛选角点,但其致命弱点在于缺乏方向信息且对图像噪声极为敏感。ORB算法通过引入强度质心法(Intensity Centroid),计算特征点邻域内图像块的零阶矩和一阶矩,从而精确地定义了特征点的主方向,赋予了FAST角点至关重要的旋转不变性 。

在特征描述阶段,ORB摒弃了高计算复杂度的浮点型梯度直方图,转而采用经过机器学习优化的rBRIEF二进制字符串 。它通过预先训练的决策树选择最具区分度的像素对进行灰度比较,并利用oFAST阶段计算出的主方向对这些像素对的采样坐标进行旋转矩阵变换,确保生成的二进制描述子严格具备旋转感知(Rotation-Aware)能力。

这种极简的二进制数学表达带来了工程上的巨大红利。在ROS 2特征匹配节点中,两个ORB描述子的相似度计算被彻底简化为硬件级别的异或(XOR)运算与汉明距离(Hamming Distance)统计。相较于SIFT(尺度不变特征变换)和SURF(加速稳健特征)等依赖于复杂图像高斯金字塔构建和海森矩阵(Hessian Matrix)特征值分解的传统连续型算法,ORB的处理速度实现了数个数量级的跨越 。

| 算法架构维度 | SIFT (Scale-Invariant Feature Transform) | SURF (Speeded-Up Robust Features) | ORB (Oriented FAST and Rotated BRIEF) | 基于深度学习的特征网络 (如 SuperPoint) |

| 描述子数据结构 | 128维高精度浮点向量 | 64维或128维浮点向量 | 256位极简二进制字符串 | 高维密集浮点张量 (通常为256维) |

| 数学理论基础 | 高斯差分金字塔与局部梯度直方图 | 快速Hessian矩阵近似与Haar小波响应 | 强度质心极坐标法与旋转感知随机点对比较 | 卷积神经网络(CNN)或图神经网络(GNN) |

| 尺度与旋转鲁棒性 | 极佳(理论上限最高) | 优秀(针对光照变化有一定抗性) | 良好(依赖图像金字塔实现多尺度适配) | 极佳(通过海量数据增强与跨视角自注意力学习) |

| 算力与硬件资源开销 | 极高(仅适合离线非实时处理) | 较高(实时性处于临界状态) | 极低(完美适配CPU标量计算,功耗极微) | 极高(绝对依赖GPU或NPU等张量加速硬件) |

| 机器人领域典型应用 | 高保真度离线3D点云重建、医学影像配准 | 静态场景下的无人机大画幅图像拼接、离线测绘 | ROS 2实时视觉SLAM、资源受限的边缘微型无人机导航 | 极端弱纹理、剧烈光照突变等高难度环境下的鲁棒位姿估计 |

2.2 RGB-D深度先验对尺度模糊性的彻底降维

尽管ORB算法在二维图像平面上展现出了无与伦比的计算效率,但将其直接应用于纯单目视觉SLAM框架(如基础版ORB-SLAM)时,系统在物理空间映射上存在先天缺陷——尺度不可观测性(Scale Ambiguity) 。在纯单目模式下,机器人相机的平移量是相对于第一帧的相对值,无法与真实的物理公制单位(如米或厘米)建立映射。此外,在机器人发生纯旋转运动(如原地转向)时,由于缺乏视差,系统无法进行深度三角化,极易引发灾难性的尺度漂移甚至跟踪崩溃 。

工业级RGB-D相机的深度介入从物理层面上彻底解决了这一痛点。现代RGB-D相机(例如Orbbec Gemini 2)通过发射红外散斑或特定频率的结构光,并利用片上ASIC芯片实时解算,能够在输出RGB彩色图像的同一微秒级时间戳内,输出完全对齐的密集深度图(Dense Depth Map) 。在ROS 2节点接收到这些对齐的数据后,ORB特征提取流程被重塑:每当在RGB图像上提取到一个二维ORB特征点 $(u, v)$,系统便直接从深度图的对应坐标查询其真实的物理深度 $Z$。通过相机的内参矩阵(焦距 $f_x, f_y$ 和光心 $c_x, c_y$),该二维像素被立即反投影到三维空间,生成带有绝对公制尺度的三维空间点 $(X, Y, Z)$ 。

这种空间锚定机制为SLAM系统带来了实质性的性能跃升:系统实现了真正的“即时初始化(Instant Initialization)”,无需像单目SLAM那样进行繁琐且容易失败的运动基线探测;在后端优化(Bundle Adjustment)阶段,具有确定尺度的三维路标点极大地约束了相机的轨迹漂移,使得六自由度(6-DoF)的位姿估计误差被指数级压缩,即使在狭长走廊或纹理高度重复的特征稀疏区域,RGB-D数据也能作为强大的空间结构先验维持跟踪状态的连续性 。

3. ROS 2中间件重构与高频感知通信管道的深度优化

将RGB-D相机与ORB特征提取算法工程化落地,面临着严峻的数据吞吐量挑战。一台运行在1080p分辨率、60FPS帧率的RGB-D相机,每秒会产生数百兆字节(MB)的未压缩点云与图像流 。在上一代ROS 1架构中,节点间的进程间通信(IPC)基于基于TCP/UDP的TCPROS协议。当图像从相机驱动节点传递至特征提取节点时,需要经历复杂的内存序列化、内核空间拷贝、网络栈封包及反序列化流程 。这种冗余的内存拷贝动作不仅急剧推高了CPU的负载,更引入了不可预测的传输延迟(Latency),直接破坏了SLAM前端所需的硬实时性 。ROS 2的底层架构重塑从根本上消解了这一瓶颈。

3.1 DDS架构与零拷贝(Zero-Copy)借用消息的内存革命

ROS 2摒弃了中心化的主节点(ROS Master),全面拥抱工业级的分布式数据分发服务(DDS)标准(例如RTI Connext DDS、Eclipse Cyclone DDS及eProsima Fast DDS) 。针对同一台物理计算机内部的高频图像传输,ROS 2提供了至关重要的借用消息(Loaned Messages)与零拷贝(Zero-Copy)共享内存机制 。

在这一机制下,开发者利用ROS 2的组件节点(Composable Nodes)特性,将相机驱动模块、图像预处理模块和ORB特征提取模块组合挂载至同一个进程容器(Container)中 。当相机驱动准备发布一帧高分辨率RGB-D图像时,它不再像过去那样在自己的堆栈中分配内存并向订阅者复制数据;相反,它直接向底层DDS的中间件实现(RMW)“借用”一块预先分配好的共享内存区 。相机将图像数据写入该共享内存后,仅仅向特征提取节点传递一个包含内存地址和生命周期标记的轻量级指针。一旦提取节点完成ORB特征计算,该内存块即被安全归还。实验证实,这种零拷贝机制将进程内的巨型数据报文传输延迟从数十毫秒压缩至亚毫秒级别,使得复杂的视觉流水线真正具备了工业现场级的确定性执行能力 。

3.2 跨异构硬件的类型适配(REP-2007)与类型协商(REP-2009)

随着硬件加速计算(GPU、NPU)的普及,ROS 2在Humble及后续版本中进一步推出了更为激进的底层优化规范:类型适配(Type Adaptation, REP-2007)和类型协商(Type Negotiation, REP-2009) 。

传统的软硬件协同存在一个悖论:虽然GPU处理图像的速度远超CPU,但在ROS图(ROS Graph)中,每个节点之间的标准接口强制使用CPU内存格式(如sensor_msgs/Image)。这就导致数据必须在“CPU主存 $\rightarrow$ GPU显存 $\rightarrow$ CPU主存”之间反复搬移,这种“往返开销”往往抵消甚至超过了硬件加速带来的时间收益 。

-

类型适配(REP-2007)的机理:该标准允许特定的ROS 2节点针对特定的硬件架构,将标准的ROS数据类型直接“适配”为其原生底层格式。例如,在NVIDIA Jetson平台上,一个图像节点可以直接发布指向显存内部的CUDA张量格式图像,而无需将其强行转换为CPU上的字节数组 。

-

类型协商(REP-2009)的机理:在包含多个环节的RGB-D流水线(例如:图像去畸变节点 $\rightarrow$ 深度对齐节点 $\rightarrow$ ORB特征提取节点)中,相邻的节点在建立连接前会相互广播各自支持的数据格式。如果上下游节点同时部署在同一块GPU上,它们将“协商”出一种最优协议,直接在GPU显存内部传递张量指针,实现数据的“硬件内部闭环流转” 。

这套协议的全面铺开,彻底清除了硬件加速环境下的通信隐患,为RGB-D视觉SLAM算法的云边端协同部署铺平了道路 。

4. 异构硬件加速范式:从GPU高吞吐网络到FPGA的极低延迟计算

在算力受限但对功耗与实时性要求苛刻的移动机器人本体上,如何高效地压榨硬件性能,是2025-2026年机器人研究的核心焦点。针对RGB-D ORB特征提取的硬件加速,业界呈现出两条主流的技术演进路径。

4.1 基于NVIDIA NITROS架构的高吞吐量GPU感知管道

NVIDIA依托其强大的GPU生态体系,推出了专为ROS 2优化的Isaac ROS套件,其核心纽带便是完全实现了REP-2007/2009协议的NITROS(NVIDIA Isaac Transport for ROS)架构 。

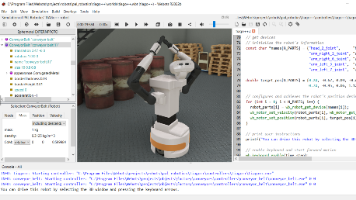

在Isaac ROS Visual SLAM模块中,RGB-D数据流被全面引入NITROS管道。系统利用GPU海量的并发线程,在微秒级别内完成大规模图像的去畸变、双目极线校正以及基于ORB的特征点检测与描述子计算 。这种软硬深度解耦与协同设计,使得在NVIDIA Jetson等边缘计算平台上,高精度的V-SLAM定位更新频率可飙升至惊人的250 FPS 。不仅如此,利用GPU的剩余算力,平行的Isaac ROS nvBlox模块还能同时接收同一份RGB-D数据流,利用空间体素哈希(Voxel Hashing)算法,实时构建包含细粒度物理几何结构和未知障碍物的密集3D语义成本地图(Costmap),从而为后续的Nav2路径规划器提供零延迟的避障输入 。

4.2 基于ROBOTCORE的FPGA可重构计算与LTTng精密追踪

对于体积更小、对功耗极限更敏感的微型无人机(UAV)或群智机器人,现场可编程逻辑门阵列(FPGA)展现出了超越GPU的低延迟优势。基于REP-2008规范构建的ROBOTCORE框架,提出了一种全新的“目标硬件无关(Target-Agnostic)”加速理念 。

开发者无需精通底层的Verilog或VHDL硬件描述语言,即可通过Yocto系统的标准构建指令,将ROS 2计算图中高度耗时的节点(如图像畸变校正、Resize操作、HOG或类似ORB的特征提取算子)编译下沉为FPGA内部定制化的硬件逻辑门电路 。为了精确量化这种加速带来的收益,研究人员深度集成了LTTng(Linux Tracing Toolkit next generation)工具链 。通过在ROS 2的rmw、rcl乃至用户层面的回调函数(如image_proc_rectify_init)中植入底层探测器(Probes),系统能够精确追踪数据在“CPU标量域 $\rightarrow$ FPGA加速域 $\rightarrow$ CPU标量域”之间每一次流转的纳秒级时延 。

大规模的硬件基准测试(如在AMD KV260和Jetson Nano 2GB平台上的对比)表明,将视觉感知算子注入FPGA硬件数据流网络后,系统成功消解了软件调度层面的不确定性,相较于纯CPU处理基线,节点的执行速度获得了24.42倍至惊人的509.5倍的跨越式提升 。这种硬件加速机制从根本上重塑了机器人计算体系的边界,标志着由软件定义的机器人正在向软硬协同共设计的机器人时代演进 。

5. 应对动态与非结构化环境:算法的深度融合与架构演进

标准的RGB-D ORB-SLAM3系统建立在一个强静态环境假设之上,即假设物理空间中的绝大部分特征点在世界坐标系中是静止的 。然而,在实际运行的工业车间(穿梭的AGV、运行的机械臂)、繁忙的物流中心或人流密集的商业综合体中,场景内充满了不可预测的动态实体。这些动态物体(如走动的人群或驶过的车辆)在相机画面中会产生大量不稳定的高对比度角点,当这些动态ORB特征被误认为是静态路标并送入后端的全局因子图优化时,会引发严重的数据关联污染(Data Association Contamination),导致相机位姿估计出现灾难性的漂移或完全丢失跟踪 。为此,学术界与工业界正围绕语义过滤与特征替代两大路线进行密集的攻坚。

5.1 语义网络与多视图几何约束的深度耦合(YOLO-ORB-SLAM)

针对高动态场景,目前在计算效率与剔除精度之间取得最佳平衡的方案,是深度融合深度学习实例分割网络与多视图极线几何约束的混合架构。最新的YOLO11-ORB-SLAM3系统便是这一理念的巅峰之作 。

在这类系统的ROS 2流水线中,RGB-D数据在进入前端特征提取模块之前,首先会被分发至一个经过量化压缩的YOLO11实例分割网络节点 。该网络以极高的帧率识别出视野范围内具有潜在运动先验的实体分类(如“人”、“汽车”、“宠物”),并输出像素级的掩码边界(Mask)。然而,简单的语义判定存在严重的过度剔除风险——例如,一辆停在路边的汽车虽然具有可运动属性,但此时它在物理空间中是静止的,应当作为优质的特征参考物被保留 。

为解决这一悖论,系统在语义掩码的基础上叠加了严密的几何一致性校验 。算法通过前一关键帧与当前帧之间的初始位姿估计,计算出基础矩阵(Fundamental Matrix),并据此在当前图像上绘制出针对特定匹配点的极线(Epipolar Line) 。如果位于语义掩码内部的某个ORB特征点到其对应极线的距离超过了容差阈值,或者结合RGB-D深度图进行密集光流法(Dense Optical Flow)分析发现其三维空间坐标发生了显著位移,该特征点才会被算法正式判定为真实移动的干扰项并予以剔除 。

在极其苛刻的TUM RGB-D动态场景公开数据集上进行的实机评测证明,这套混合机制在几乎不额外消耗过多CPU周期(得益于前述的NITROS/GPU硬件解耦)的前提下,成功将标准ORB-SLAM3的轨迹误差削减了93%,展现出了在真实的工业机器人平台上直接部署的卓越可行性 。

5.2 深度学习特征的降维打击(SuperPoint/LightGlue)与工程权衡

在剔除动态特征之外,前端特征提取算法本身的鲁棒性也在经历革命。传统的ORB特征依赖于人工设计的图像局部强度启发式规则,在面临极端光照突变、剧烈的视角旋转或严重的纹理相似性(Perceptual Aliasing,例如完全相同的走廊瓷砖)时,其匹配召回率往往会出现断崖式的下滑 。

基于卷积神经网络(CNN)与图神经网络(GNN)的密集深度学习特征模型正在重塑这一前沿阵地。以最新提出的SuperPoint-SLAM3研究为例,其在维持ORB-SLAM3核心因子图优化和多地图架构不变的前提下,将其前端检测模块直接替换为SuperPoint特征网络,并创造性地结合了自适应非极大值抑制(ANMS)算法以强制特征点在图像空间中维持极其均匀的分布 。更进一步,前端匹配网络引入了类似LightGlue的注意力机制架构,利用自注意力层(Self-Attention)深度挖掘单幅图像内特征点之间的相对几何拓扑结构,利用交叉注意力层(Cross-Attention)实现跨视角的稳健特征关联 。

量化对比数据揭示了令人震撼的性能差距:在KITTI测距基准测试中,使用深度特征替代方案后,SLAM系统的平均平移误差从使用ORB时的4.15%骤降至惊人的0.34%,六自由度姿态估计的旋转误差也从0.0027 deg/m大幅缩减至0.001 deg/m 。在涵盖快速无人机飞行和剧烈运动模糊的EuRoC MAV数据集中,改进方案同样将平移误差稳定压缩在了0.5%~0.9%的极低区间 。

商业落地的工程权衡:尽管SuperPoint等深度特征在纯粹的定位精度和抗干扰能力上对传统ORB形成了“降维打击”,但在现实工程落地中,开发者却面临着严峻的资源权衡 。在社区广泛的开源讨论中,工程师们指出,在非计算密集型的边缘设备上,传统ORB-SLAM3凭借其精妙的工程实现(C++内存池优化、高效词袋模型)依旧展现出了非凡的综合竞争力 。深度特征模型在提取和匹配阶段对GPU显存及算力的贪婪需求,使其在普通的单板微型计算机上难以维持实时性。因此,对于面向规模化部署的商用机器人(如扫地机器人或轻型物流AGV),“RGB-D深度修正 + 优化版传统ORB提取 + 极简的几何动态剔除”依然是目前工业界能够兼顾定位精度、计算延迟与BOM成本的最优工程解集 。

6. 迈向多智能体协同与边缘-云端架构部署

在广袤的现代农业监测、大规模自动化仓储作业以及灾后救援场景中,单体机器人的感知视野和计算效率已经逼近物理极限,基于ROS 2架构的多智能体协同(Multi-Agent Robotics)与分布式集群建图成为核心演进方向 。

6.1 云边协同下的带宽治理与地图融合(Map Merging)策略

在多机器人协作的三维视觉建图中,最大的痛点在于无线网络带宽的物理束缚 。如果在本地进行特征提取后,将海量的原始RGB-D稠密点云直接推流至云端,不仅会瞬间导致局域Wi-Fi网络或5G链路的拥塞崩溃,还会引发严重的数据包丢失与同步灾难 。

为了克服通信瓶颈,ROS 2生态下的多机器人系统采取了高度智慧的“计算卸载与拓扑传输”策略 。

-

极简数据的边缘侧提取:每台终端机器人在本地算力节点上(通过前文所述的硬件加速引擎)高速完成高频的RGB-D采集与ORB特征提取 。机器人不再传输全景图像,而是仅将精炼的二进制ORB描述子向量、高度压缩的关键帧集合以及局部的位姿增量图(Pose Graph)推送到网络层 。

-

云原生的事件驱动架构:中央控制集线器全面引入云原生(Cloud-Native)与微服务架构,如AWS Lambda无服务器计算方案 。云端通过低延迟的gRPC或WebSocket协议接收来自各个边缘节点的数据流,并利用计算力更强大的云服务器执行繁重的全局光束法平差(Global BA)与全局闭环检测(Loop Closure) 。

在此多集群协同中,ORB-SLAM3底层的**多地图系统(Atlas System)**发挥了决定性作用 。当某一台机器人在巡检过程中因穿越信号盲区或遭遇极端视觉退化(如剧烈晃动导致追踪丢失)时,Atlas系统允许其在本地无缝开启一张全新的子地图(Sub-map)并继续独立工作 。当机器人重新恢复稳定并进入之前任何一台机器人曾经建图过的已知区域时,通过词袋模型(Bag of Words, BoW)的高效空间搜索,云端或本地后端优化器会迅速触发多地图合并(Map Merging)算法,通过共视约束在不同的局部地图之间建立六自由度的相对变换,将其无缝缝合为一个全局一致的物理空间表征 。

7. 泛在工业与具身智能(Embodied AI)的商业应用前景

依托上述底层架构的全面突破与软件算法的深度演进,基于ROS 2的RGB-D视觉感知技术正以前所未有的速度向多个垂直行业的纵深领域渗透,勾勒出了极具商业价值的落地蓝图。

7.1 重工业与制造业的智能化迭代(以钢铁冶炼厂为例)

在高温、粉尘弥漫且GPS信号被完全屏蔽的重型钢铁厂房内部,部署自主机器人的安全标准与工程难度远高于普通商业环境 。为此,行业领先的自动化厂商结合ROS 2架构,制定了严谨的“五阶段成熟度模型(Maturity Model)” :

-

Stage 1 - 遥操作阶段:将作业人员从危险的冶炼炉边撤离,通过低延迟的ROS 2数据链路传输RGB-D视频流,实现带人在环(Human-in-the-loop)的远程安全监视与操控。

-

Stage 2 - 辅助自治阶段:引入初步的视觉SLAM建图与障碍物规避机制,操作员只需设定关键航点,机器人即可半自主导航,并将环境监控数据初步接入企业计算机化维护管理系统(CMMS)。

-

Stage 3 - 全自治阶段:系统完全接管底层控制逻辑。RGB-D感知管道开始进行动态障碍物的预判与规避,实现对人机混合作业区域的安全穿越与自动化巡检。

-

Stage 4 - 舰队智能(Fleet Intelligence):多台SLAM机器人通过DDS网络共享局部地图与成本代价图,云端优化调度路径,消除局部拥堵,实现整个车间物流体系的效率最大化。

-

Stage 5 - 泛在自我优化:融合强化学习与数字孪生(Digital Twin),机器人不再仅仅是被动执行代码指令,而是基于长期历史SLAM数据自我寻优出最优巡检频次与轨迹策略。

在这场变革中,硬件范式的变迁尤为引人注目。传统上,依赖高精度三维激光雷达(LiDAR,单价动辄数千美元)是工业移动导航的标配。然而,随着边缘算力的爆发,基于视觉先验(Vision-First)的架构正席卷重工市场 。多模态同步的RGB-D相机阵列(总成本不足200美元)与鸟瞰图(BEV)网络相结合,在精度上已经能够媲美甚至在语义理解上超越纯激光方案。行业报告大胆预测,到2027年第四季度,全球超过60%的新增工业自主移动机器人(AMR)将彻底放弃主激光雷达,全面转向“视觉SLAM + BEV”的解决方案,极大降低大规模自动化部署的财务门槛 。

7.2 商业空间计算与XR虚实融合(Extended Reality)

在复杂的商业零售空间、医疗仓储以及酒店服务场景中,机器人时常面临环境陈列每日更迭的挑战。Kudan等顶级商用SLAM方案供应商,正加速将其高度优化的ORB视觉管道与NVIDIA Isaac Perceptor平台进行深度嵌合 。这种工业级集成方案能够极好地抵抗室内光照的明暗突变和频繁的货架移动,输出高频重复定位精度,使AMR不仅在静态仓库中运行良好,更能在人流密集的超市或医院走廊中实现从容避障 。

同时,基于ROS 2的统一架构也极大地促进了跨现实(XR,涵盖AR/VR/MR)开发工作流的繁荣 。长久以来,仿真测试与物理现实之间存在的“现实鸿沟(Reality Gap)”是制约机器人快速迭代的阿喀琉斯之踵。如今,通过构建如SimNav-XR等混合现实框架,ROS 2底层的状态流(Transform TFs、Odometry)被直接透明化地桥接至Unity3D物理引擎 。远端的操作员或开发人员佩戴诸如Meta Quest 3等消费级XR头显,便可以在虚拟空间中以上帝视角或机器人第一视角直接观察到由RGB-D ORB特征点实时映射出的密集点云环境。开发人员可以用手势或自然交互对机器人在虚拟空间中的三维路径进行修正与测试,测试结果会以极低延迟反向同步给物理机器人。这种空间直觉化的开发范式极大地加速了从概念原型到真实部署的周期跨越 。

7.3 家庭服务机器人与大规模LLM指令融合

进入家庭环境的辅助机器人,面临着远超标准工厂的挑战——高度凌乱的玩具、四处游走的宠物以及极具随意性的家具摆放 。在这一领域,低功耗边缘部署与大模型(LLMs)的结合正在创造全新的应用场景 。

例如,搭载在Raspberry Pi 5单板机上的家庭助老巡检机器人,利用轻量级的RTAB-VSLAM结合RGB-D传感器的深度通道进行实时闭环检测和3D地图构建,能够高效完成客厅至卧室的复杂导航路径解算 。 更具有颠覆性的是,基于ROS 2 Nav2导航栈的前沿研究,正在将视觉SLAM生成的几何地图与当今最先进的大语言模型(如GPT-4、Claude 3、LLaMA-3)结合,打造全新的会话式人机交互界面(Conversational HMI) 。纯粹的几何建图系统无法理解物体的意义,但当RGB-D视觉管道中融合了对象检测与语义标签模块(Semantic Mapping)后,SLAM地图便升级为带有语用属性的空间实体库。普通非专业用户可以直接输入自然语言文本(例如:“绕过沙发,把厨房料理台上的水杯端过来”)。LLM在解析出用户的真实意图后,直接在底层的ROS 2系统中生成并下发多级导航航点序列 。在保证响应延迟与空间推理精度的多模型基准对比中,这种整合彻底打破了阻碍普通消费者接纳复杂智能机器人的技术坚冰 。

8. 面向世界基础模型(WFMs)的深度技术展望

将时间轴拨向未来,围绕2026年及以后的机器人技术核心命题,学界与产业界正在汇聚于物理空间智能的终极探索 。

过去的AI革命主要局限于能够进行文本推理和代码生成的语言世界,而未来的AI必须具备对物理三维世界的先验认知能力 。业界开始倾注海量资源构建“世界基础模型”(World Foundation Models, WFMs)与“大型地理空间模型”(Large Geospatial Models, LGMs) 。这些庞大的神经网络力求不仅能理解场景的几何外观,还能预测物理碰撞的受力分布与材质属性的互动反应 。

在这一宏大叙事中,ROS 2 RGB-D视觉SLAM不再是一个单纯寻找“我在哪里”的孤立导航算法模块,而演化成了构建世界大模型所不可或缺的“物理数据收割机”与“环境锚定探针” 。它源源不断地向云端数据中心提供高精度度量尺度(Metric-Scale)对齐的三维空间结构数据集,为大规模具身智能体(如通用双足人形机器人和多轴机械狗)训练端到端的运动与抓取策略提供核心原材料 。

同时,表示形式的演进也在加速。传统基于离散ORB点集的三维建图在提供逼真的物理交互方面显得单薄。三维高斯溅射(3D Gaussian Splatting, 3DGS)等隐式神经表达技术正在与经典的SLAM流水线产生激烈的化学反应 。未来的ROS 2机器人感知架构大概率将演变为一种“异步双轨制”范式:前台执行线(Frontend)依然倚靠久经考验的极简ORB特征提取算法配合硬件加速器执行极低延迟的六自由度位姿解算与运动控制;而在后台(Backend),系统则利用RGB-D相机的海量致密信息异步优化一个由无数个高斯椭球构成的连续光场地图。这种融合不仅能确保机器人导航的安全与敏捷,同时还赋予了系统构建相片级保真度数字孪生世界的宏伟能力 。

9. 结论

通过对底层数学机理、系统级中间件重构、异构硬件加速机制以及前沿行业部署现状的全方位剖析,可以明确得出结论:基于ROS 2架构的RGB-D ORB特征提取技术,已经彻底完成了从学术实验室原型向工业级基础设施底座的历史性蜕变。

其底层的二进制运算极简主义与RGB-D引入的确定性物理尺度深度耦合,构筑了一道兼顾计算能效与空间定位精度的护城河。而ROS 2中DDS零拷贝共享内存体系及REP-2007/2009类型协同协议的加持,连同NVIDIA GPU网络流水线与FPGA可重构硬件架构的双轨推进,彻底打通了高分辨率多模态数据在分布式节点间实时流转的算力瓶颈。

展望未来,尽管以SuperPoint和LightGlue为代表的深层神经网络特征描述技术在极端环境的绝对精度上不断突破天花板,且3D高斯溅射技术也在持续重塑地图表达的物理维度,但通过深度实例语义网络(如YOLO)进行混合约束优化后的RGB-D ORB-SLAM架构,仍将在很长一段时间内作为兼顾功耗上限、BOM成本控制和复杂数据关联的最优工程解,统治大规模商用移动机器人与家庭服务终端市场。在这个大语言模型向三维物理空间深度延伸的具身智能新纪元,ROS 2 RGB-D视觉感知体系不仅是机器人穿梭于物理世界的精准导航罗盘,更是帮助硅基生命认知、理解并最终重构真实世界的关键锚点。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)