WMPO:基于世界模型的VLA模型策略优化

本文是对论文《WMPO: World Model-based Policy Optimization for Vision-Language-Action Models》的深度解读。在通用机器人操作领域,VLA模型依赖专家演示、RL落地真实机器人样本效率低的问题,始终是核心研究挑战。香港科技大学与字节跳动Seed团队联合提出WMPO框架,创新性地将VLA在线RL落地于像素空间视频生成式世界模型,实

摘要:视觉 - 语言 - 动作(VLA)模型在通用机器人操作领域展现出巨大潜力,但其对专家演示数据的依赖限制了其从失败中学习和执行自我修正的能力。强化学习(RL)通过与物理环境的自优化交互解决了上述问题,然而在真实机器人上应用时存在样本复杂度极高的问题。本文提出了基于世界模型的策略优化方法(WMPO),这是一个无需与真实环境交互、适用于 VLA 模型的在线策略强化学习框架。与广泛使用的隐空间世界模型不同,WMPO 聚焦于基于像素的预测,使 “想象” 轨迹与经网络级图像预训练的 VLA 特征保持对齐。关键的是,WMPO 能让策略执行在线策略 GRPO 优化,其性能优于常用的离线策略方法。在仿真和真实机器人场景下的大量实验表明,WMPO 具备以下优势:(1)大幅提升样本效率;(2)实现更优的整体性能;(3)涌现出自我修正等行为;(4)展现出稳健的泛化能力和终身学习能力。

原文链接:WMPO_Seed.pdf

代码链接:https://wm-po.github.io/

沐小含持续分享前沿算法论文,欢迎关注...

一、研究背景与问题提出

1.1 VLA 模型的核心价值与现存缺陷

视觉 - 语言 - 动作(VLA)模型是通用机器人操作的核心研究方向,其能够将视觉输入与自然语言指令映射为可执行的机器人动作,实现非结构化环境下的复杂任务操作。当前 VLA 模型的主流训练方式是模仿学习(Imitation Learning, IL),即通过大规模人类专家演示数据进行训练。

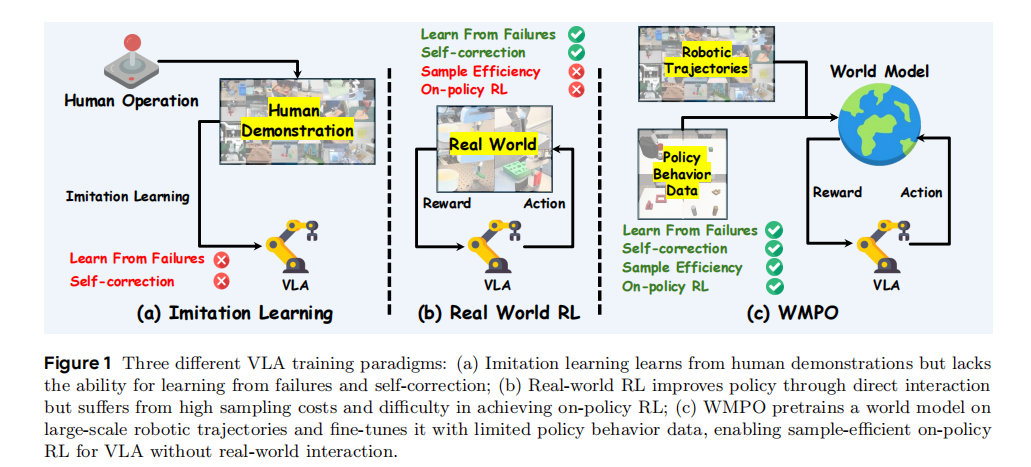

但模仿学习存在致命缺陷:对分布外状态鲁棒性差,无法从失败中学习和自我修正。当机器人遇到训练中未见过的场景时,会做出次优动作并导致错误累积,最终无法完成任务甚至无法恢复(如图 1a)。

1.2 强化学习的解决方案与新瓶颈

强化学习(RL)为模仿学习的缺陷提供了天然解决方案 —— 通过与环境的主动交互实现自我改进,让策略具备鲁棒性和失败恢复能力。但将 RL 直接应用于真实机器人面临样本效率极低的问题:需要数百万次的物理交互,不仅耗时、成本高,还存在安全风险(如图 1b)。

现有提升 RL 样本效率的策略主要分为两类:

- 人类干预引导学习:通过人类提供修正信号减少探索成本,但需要持续的人类监督,扩展性差;

- 仿真环境替代真实交互:利用仿真器降低真实世界交互需求,但为不同场景构建高精度仿真器的工程成本极高,且仿真与现实存在 “域间隙”。

1.3 世界模型的机遇与整合挑战

大规模生成式模型(尤其是视频生成式世界模型)的出现,让基于模型的 RL 成为解决 VLA 样本效率问题的关键方向。世界模型能从数据中学习环境动力学并模拟未来状态转移,实现无昂贵真实探索的可扩展 RL。

但将世界模型与现有 VLA 模型整合仍存在核心矛盾:传统基于模型的 RL 多在抽象隐空间中运行,而高性能 VLA 基础模型是在真实世界图像上预训练的,隐空间的动力学模型与 VLA 的预训练视觉特征存在分布不匹配,导致 VLA 的预训练视觉理解能力无法直接复用。

基于此,论文提出核心观点:基于像素空间的视频生成式世界模型是连接世界模型与 VLA 预训练知识的关键,并以此为基础设计了 WMPO 框架。

二、WMPO 框架核心设计理念

WMPO 的全称是基于世界模型的策略优化(World Model-based Policy Optimization),是一个将 VLA 强化学习完全落地在动作条件视频世界模型中的原则性框架,核心目标是在无真实世界交互的前提下,实现 VLA 模型的样本高效的在线策略 RL。

其核心设计理念可概括为三点:

- 像素空间建模:摒弃传统隐空间世界模型,采用像素空间视频生成式世界模型,让 VLA 策略在与预训练一致的视觉数据上运行,桥接世界模型与 VLA 预训练知识;

- 策略行为对齐:通过策略自身收集的行为数据微调世界模型,解决专家演示与策略滚动分布不匹配的问题;

- 想象空间的在线 RL:在世界模型生成的 “想象轨迹” 上执行在线策略优化(GRPO),彻底摆脱对真实物理交互的依赖,同时解决离线 RL 的价值估计偏差问题。

WMPO 的训练范式与传统模仿学习、真实世界 RL 的对比如图 1 所示:

- 模仿学习:仅从人类演示中学习,无失败学习和自我修正能力;

- 真实世界 RL:通过物理交互改进策略,但样本成本高,难以实现在线 RL;

- WMPO:在大规模机器人轨迹上预训练世界模型,通过少量策略行为数据微调,最终在想象空间中实现 VLA 的样本高效在线 RL。

三、WMPO 算法详细设计

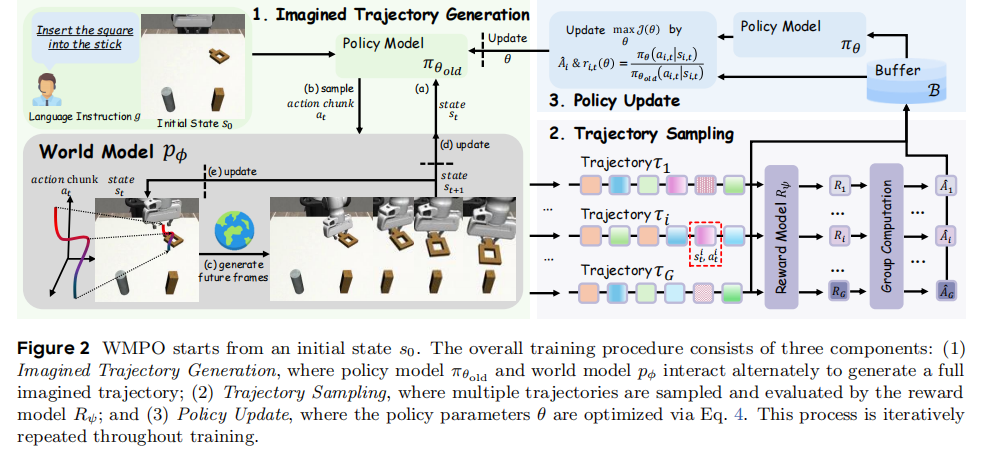

WMPO 的完整框架包含四大核心模块:生成式世界模型、奖励模型、策略行为对齐机制、基于想象轨迹的在线 GRPO 优化,整体训练流程如图 2 所示,分为想象轨迹生成、轨迹采样、策略更新三个迭代步骤。

图2 WMPO整体训练流程:从初始状态出发,经想象轨迹生成、轨迹采样、策略更新完成迭代优化

3.1 问题形式化定义

论文将 VLA 操作任务形式化为马尔可夫决策过程(MDP) ,各组件定义如下,核心假设为机器人状态可完全由图像观测定义(更复杂的部分可观测 MDP 为未来研究方向):

- 状态空间

:

,其中

,其中 为图像观测空间(图像序列

),

),为语言指令空间;

- 动作空间

:为动作块(action chunk) 空间,每个动作块是长度为

的机器人动作序列,每个动作

为

为 自由度的控制向量,为便于策略优化,每个维度离散为 256 个区间,策略表示为

;

; - 转移函数

:由参数化世界模型

实现,

实现, ,即基于历史观测和动作生成未来观测,通过迭代采样得到想象轨迹

,即基于历史观测和动作生成未来观测,通过迭代采样得到想象轨迹 };

}; - 奖励函数

:由学习到的奖励模型

实现,为二值奖励(任务成功 / 失败),

实现,为二值奖励(任务成功 / 失败), 。

。

优化目标:训练得到策略![]() ,该策略能最大化想象轨迹的预测累积回报:

,该策略能最大化想象轨迹的预测累积回报:

![]()

该形式化定义揭示了核心范式:利用生成式世界模型作为想象训练环境,将 VLA 的 RL 与真实世界交互解耦。

3.2 生成式世界模型:像素空间的高精度视觉动力学建模

生成式世界模型是 WMPO 的核心基础,负责在像素空间生成高保真的机器人动作条件视觉轨迹,解决了传统世界模型的隐空间与 VLA 预训练特征不匹配、长程预测失真、动作 - 帧对齐差等问题,包含轨迹生成逻辑、模型架构改进、鲁棒生成技术三部分。

3.2.1 想象轨迹生成逻辑

给定初始 帧

![]() 和语言指令

和语言指令 ,轨迹生成遵循策略预测动作块→世界模型生成对应帧的迭代流程:

- 策略

以最近

以最近 帧图像和语言指令为输入,预测动作块

;

; - 世界模型

以最后

以最后 帧观测和预测的动作块为条件,生成下

帧图像:

;

; - 重复上述过程直至达到最大长度

,得到完整想象轨迹

,再由奖励模型给出二值标签

,再由奖励模型给出二值标签 。

。

3.2.2 模型架构改进:基于 OpenSora 的像素空间优化

世界模型以OpenSora(视频扩散模型) 为骨干,并针对机器人操作任务做了关键修改,核心是保留像素空间的精细运动细节:

- 将 OpenSora 中的 3D VAE 替换为SDXL 的 2D VAE,避免过度压缩导致的时间失真,更好地保留机器人 - 物体交互的精细细节;

- 扩散过程在 VAE 隐空间进行,在 VLA 优化时将图像解码回像素空间,而非在 RSSM 等新隐空间中重新训练 VLA,确保与 VLA 预训练知识的一致性。

3.2.3 鲁棒长程生成技术:解决失真与对齐问题

由于世界模型采用自回归生成(以生成的帧为条件预测未来帧),长程预测会出现误差累积,导致视觉失真和动作 - 帧错位,论文提出两种核心技术解决该问题:

-

噪声帧条件化(noisy-frame conditioning)在训练时,对条件帧

加入50/1000 步的扩散噪声(而非使用干净帧),提升模型对不完美条件的鲁棒性,实现稳定的长程生成(可生成数百帧的轨迹而无明显质量损失)。

加入50/1000 步的扩散噪声(而非使用干净帧),提升模型对不完美条件的鲁棒性,实现稳定的长程生成(可生成数百帧的轨迹而无明显质量损失)。 -

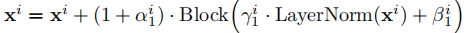

帧级动作控制(frame-level action control)受 Zhu et al. (2025) 启发,扩展 AdaLN 块在帧级别注入动作信号和扩散时间步嵌入,实现高精度的动作 - 帧对齐。具体来说,对每个动作

,由 MLP 生成调制系数:

- LayerNorm 输出的缩放

和偏移

和偏移 ;

; - MHA/FFN 块残差连接的缩放

。transformer 块内的特征更新规则为:

。transformer 块内的特征更新规则为:

其中

为第

帧的特征表示。

- LayerNorm 输出的缩放

3.2.4 策略行为对齐(Policy Behavior Alignment)

世界模型先在Open X-Embodiment (OXE) 大规模机器人轨迹数据集上预训练,获得通用的物理动力学知识,但 OXE 轨迹以成功执行为主,失败场景表示不足,且仅用下游任务的专家演示训练无法模拟策略的失败行为,导致想象轨迹与真实策略滚动存在分布不匹配。

为此,论文提出策略行为对齐:利用策略自身收集的真实滚动轨迹微调世界模型,让模型适应下游任务的(状态,动作)分布,更真实地捕捉策略的失败模式。若无该对齐,模型对失败场景的模拟会非常脆弱,无法支撑有效的 RL 训练。

3.3 奖励模型:轻量级的轨迹成败判定器

可扩展的策略优化需要自动判断想象轨迹的任务成败,论文设计了一个轻量级、数据高效的奖励模型,避免复杂的奖励塑形(reward shaping)和奖励攻击(reward hacking),核心是基于视频片段的二值分类。

3.3.1 训练数据构建

给定轨迹![]() ,定义长度为

,定义长度为 的视频片段

![]() :

:

- 正样本:成功轨迹的终端片段

;

- 负样本:成功轨迹的非终端片段

+ 失败轨迹的任意片段。

+ 失败轨迹的任意片段。 - 为解决类别不平衡,在每个训练批次中平衡正负样本数量。

3.3.2 模型架构与训练

- 骨干网络:VideoMAE 编码器(视频自监督预训练模型,数据效率高);

- 输出层:线性头,输出二值分类结果;

- 损失函数:二元交叉熵损失(BCE)。

3.3.3 推理逻辑

推理时,以步长 在轨迹

上滑动窗口,计算每个片段的成功概率;若任意片段的成功概率超过阈值

![]() (通过验证实验选择),则判定该轨迹为成功。论文实验中,该奖励模型在所有任务上的F1 分数均超过 0.95,能可靠地区分轨迹成败,有效避免奖励攻击。

(通过验证实验选择),则判定该轨迹为成功。论文实验中,该奖励模型在所有任务上的F1 分数均超过 0.95,能可靠地区分轨迹成败,有效避免奖励攻击。

3.4 基于 WMPO 的在线强化学习:解决 VLA RL 的两大瓶颈

VLA 任务的 RL 面临两大核心瓶颈:

- 物理交互瓶颈:与 LLM 不同,VLA 的反馈需要真实机器人的反复滚动,硬件成本高、有安全风险、扩展性差;

- 离线 RL 的价值估计偏差:受物理交互限制,现有真实世界 VLA RL 多采用离线 RL,但离线 RL 天然存在价值估计误差,而在线 RL 通常能获得更好的性能。

WMPO 通过在世界模型中完全优化策略解决上述瓶颈:用模型生成的想象轨迹替代昂贵的真实世界滚动,摆脱物理交互依赖,同时实现在线 RL,避免离线 RL 的价值偏差。

3.4.1 策略优化算法:GRPO

论文选择Group Relative Policy Optimization (GRPO) 作为核心优化算法,原因是 GRPO 在稀疏奖励场景下具备稳定、可扩展的训练特性,与 WMPO 的二值稀疏奖励高度匹配。

3.4.2 轨迹采样:动态采样策略

从真实环境的初始帧![]() 出发,在世界模型中从当前策略

出发,在世界模型中从当前策略![]() 采样一组(G 个)想象轨迹

采样一组(G 个)想象轨迹![]() ,由奖励模型预测每个轨迹的成败。

,由奖励模型预测每个轨迹的成败。

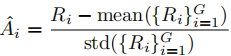

为缓解梯度消失,采用动态采样策略:若一组轨迹全部成功或全部失败,则丢弃该组,重新采样直至批次填满,确保每个批次的轨迹包含成败样本,为策略优化提供有效梯度。

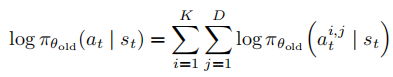

同时,预计算每个动作块在旧策略下的对数概率作为参考:

其中![]() 为第

为第 个动作块中第

个自由度的第

个动作。

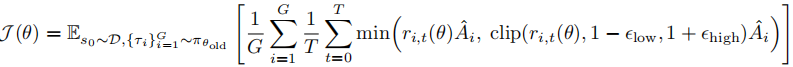

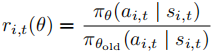

3.4.3 策略更新:无 KL 正则的 GRPO 目标

借鉴 DAPO (2025) 的设计,移除 KL 散度正则化,无需参考模型,减少内存消耗并鼓励策略探索新行为,最终的训练目标为:

其中:

:新 / 旧策略在轨迹

:新 / 旧策略在轨迹 第

步的概率比;

:轨迹

:轨迹 的归一化优势函数,

为轨迹

为轨迹 的二值奖励。

四、实验验证:全方位验证 WMPO 的有效性

论文在仿真环境(Mimicgen) 和真实机器人平台(Cobot Mobile ALOHA) 开展了大规模实验,核心回答 5 个问题:

- WMPO 是否优于仿真环境中的在线 / 离线 RL 基线?

- WMPO 的行为与模仿学习有何本质差异?

- WMPO 能否泛化到未见过的场景?

- WMPO 能否在部署中实现迭代改进(终身学习)?

- WMPO 能否应用于真实机器人?

4.1 实验设置

4.1.1 基础策略与模型配置

- 基础策略:以 OpenVLA-OFT 为基础,通过模仿学习在目标操作任务上微调,忽略机器人本体感受状态和腕部相机输入;

- 动作块长度 K=8,世界模型输入 c=4 帧条件帧,奖励模型视频片段长度 L=8,推理步长 s=1;

- 滚动预算 P:设置 P=128 和 P=1280 两个量级,评估方法的可扩展性;

- 硬件:OpenVLA-OFT 微调在 8 张 H100 GPU 上进行,世界模型训练和策略优化在 32 张 H100 GPU 上进行。

4.1.2 仿真环境与任务

采用Mimicgen 仿真环境,选择 4 个精细的机器人操作任务:Coffee_D0、StackThree_D0、ThreePieceAssembly_D0、Square_D0;

- 基础策略训练:每个任务用 300 条专家轨迹微调 OpenVLA-OFT;

- 评估方式:每个任务测试 128 个不同的初始状态,报告平均成功率。

4.1.3 基线方法

选择两个主流的 RL 算法作为基线,确保所有方法分配相同的真实滚动预算P:

- GRPO(在线 RL):在真实 / 仿真环境中直接收集轨迹更新策略,更新后丢弃轨迹;

- DPO(离线 RL):以基础策略为参考,构建成败轨迹对,用标准 DPO 损失优化,可重复使用收集的数据,但无法在线更新。

4.2 对比实验:WMPO 显著优于基线方法

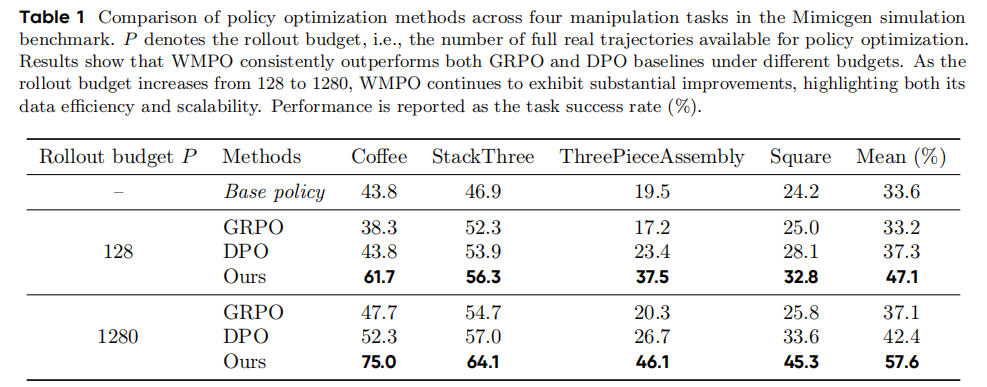

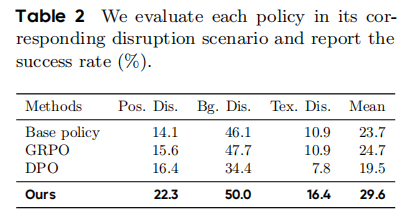

表 1 为不同滚动预算下,WMPO 与基线方法在 4 个仿真任务上的成功率对比,核心结论如下:

- 样本效率极高:在小滚动预算P=128时,WMPO 的平均成功率为 47.1%,远超最强基线 DPO 的 37.3%(+9.8 个百分点);

- 可扩展性优异:当滚动预算提升至P=1280时,WMPO 的平均成功率进一步提升至 57.6%,与最强基线的差距扩大至 + 15.2 个百分点,说明 WMPO 能更高效地利用额外的轨迹数据;

- 基线方法的局限性:GRPO 因有限更新常表现不佳,DPO 因静态数据复用出现性能平台期,而 WMPO 随滚动预算增加持续稳定提升。

4.3 涌现行为:自我修正与更高效的任务执行

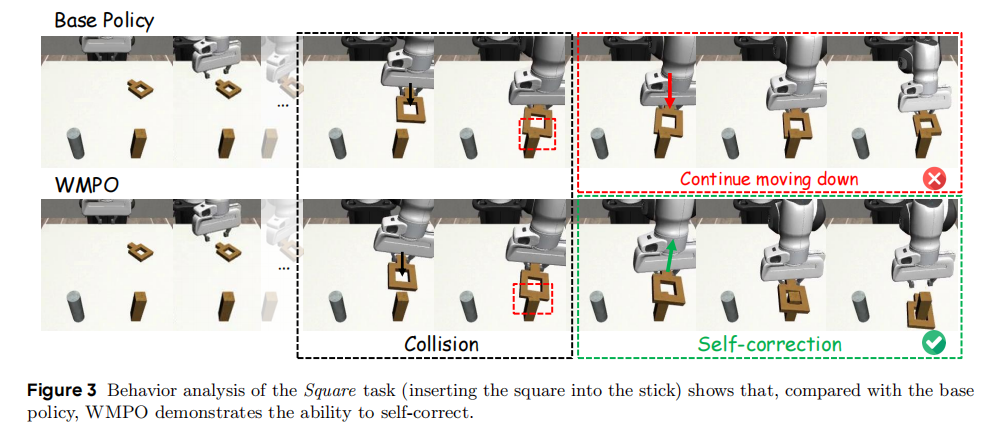

WMPO 训练的策略展现出模仿学习和基线 RL 无法实现的涌现行为,核心为自我修正和高效执行,以 Square 任务(将正方形块插入杆中)为典型案例(图 3):

4.3.1 自我修正能力

当策略因误差累积发生碰撞时,基础策略(模仿学习)因训练中未见过碰撞场景,会持续将正方形块推向杆直至超时失败;而 WMPO 通过世界模型的大规模想象轨迹,学习到了自我修正策略:自主抬起正方形块、重新对齐、再完成插入,最终成功完成任务。

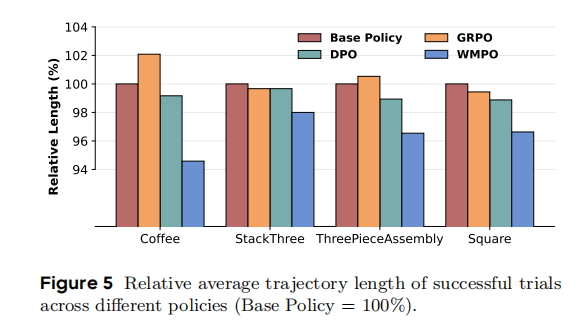

4.3.2 更高效的任务执行

分析不同策略成功轨迹的长度(图 5),发现 WMPO 训练的策略轨迹显著更短:WMPO 抑制了策略在次优状态中的 “卡顿” 行为,而卡顿往往是导致超时失败的主要原因。这一特性让 WMPO 策略的动作更快速、更流畅,任务完成效率更高。

4.4 泛化性实验:对未见过场景的鲁棒性

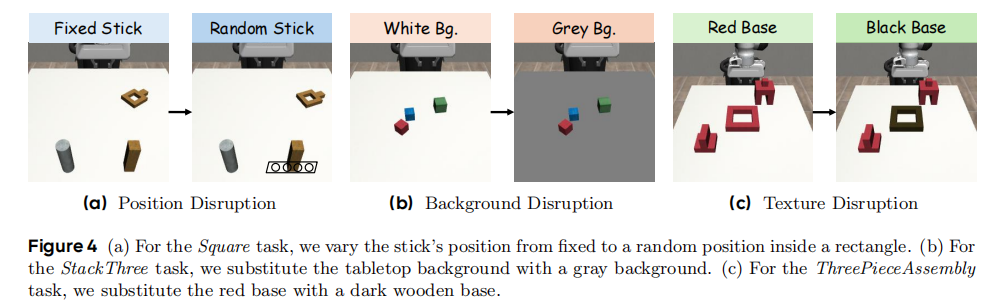

论文设计了三种分布外干扰场景(图 4),系统评估 WMPO 在空间偏移、背景干扰、纹理干扰下的泛化能力:

结果如表 2 所示:

- 空间干扰:Square 任务中,杆的位置从固定变为矩形区域内随机;

- 背景干扰:StackThree 任务中,桌面背景从白色变为灰色;

- 纹理干扰:ThreePieceAssembly 任务中,红色底座替换为深色木质底座。

核心结论:WMPO 在所有干扰场景下均取得最佳性能,泛化能力显著优于基线。原因在于:

- DPO 依赖虚假的视觉线索(如背景、纹理),而非可迁移的操作技能,因此在背景 / 纹理变化时性能大幅下降;

- GRPO 和基础策略的泛化能力差,对分布外状态鲁棒性低;

- WMPO 在世界模型中训练,捕捉到了更通用的操作策略,而非针对特定场景的表面特征,因此能在空间、背景、纹理变化时保持可靠性能。

4.5 终身学习实验:迭代的策略改进能力

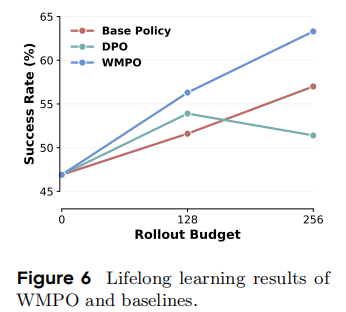

终身学习的核心是通过迭代收集真实轨迹,持续优化策略,论文在 StackThree 任务上验证 WMPO 的终身学习能力(图 6):

- 实验设置:迭代收集P=128条真实轨迹,用 WMPO 优化策略,再用更新后的策略收集下一批轨迹,重复该过程;

- 基线:DPO(同迭代设置)+ 模仿学习(用 300/428/556 条专家轨迹训练,作为人工收集数据的参考)。

核心结论:

- WMPO 实现了稳定且显著的迭代性能提升,随滚动预算增加成功率持续上升;

- DPO 因训练不稳定,无法实现迭代改进;

- 模仿学习依赖人类收集的专家轨迹,而 WMPO 仅依赖策略自身收集的轨迹,扩展性远优于模仿学习。

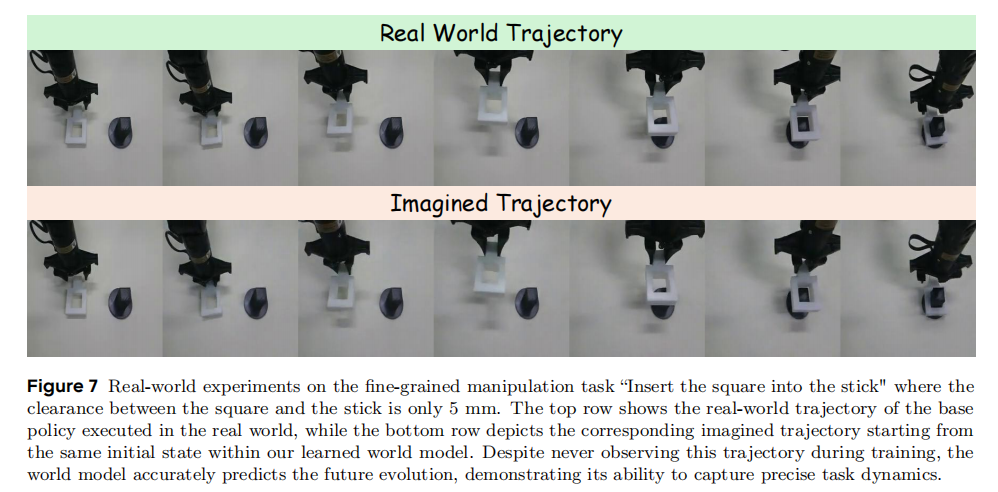

4.6 真实机器人实验:从仿真到现实的落地能力

论文在Cobot Mobile ALOHA真实机器人平台上,以Square 任务(正方形块插入杆,间隙仅 5mm) 为目标验证 WMPO 的落地能力(图 7),该任务对操作精度要求极高,是典型的精细操作任务。

4.6.1 实验设置

- 基础策略:用 200 条高质量专家演示微调 OpenVLA-OFT;

- WMPO 训练:用基础策略收集 128 条真实轨迹,微调世界模型并在想象空间中优化策略;

- 基线:DPO(用相同的 128 条轨迹训练);

- 评估:在相同实验条件下进行 30 次试验,报告平均成功率。

4.6.2 实验结果

- 基础策略(模仿学习):53%;

- DPO(离线 RL):60%;

- WMPO(WMPO+GRPO):70%。

核心结论:WMPO 在真实机器人上的性能显著优于模仿学习和 DPO,证明了其从仿真到现实的有效落地能力。同时,世界模型能在未见过的轨迹上准确预测未来状态演化,捕捉到了任务的高精度动力学特征。

五、结论与未来研究方向

5.1 核心结论

论文提出的 WMPO 是首个将 VLA 在线 RL 完全落地在像素空间视频生成式世界模型中的框架,通过一系列创新设计,解决了传统 VLA 模型的核心痛点,实验验证了其四大核心优势:

- 样本效率极高:无需大量真实世界交互,在想象空间中实现策略优化,显著优于现有在线 / 离线 RL 基线;

- 涌现自我修正行为:通过世界模型的大规模想象轨迹,让策略学会从失败中恢复,这是模仿学习无法实现的;

- 泛化能力强:捕捉通用的操作技能而非表面视觉线索,能适应空间、背景、纹理等分布外场景;

- 支持终身学习:通过迭代收集真实轨迹实现策略的持续改进,且无需人类专家演示,扩展性优异。

WMPO 为 VLA 模型的强化学习提供了可扩展、通用的新范式,将世界模型的像素空间建模与 VLA 的预训练知识有效桥接,彻底摆脱了对真实物理交互的过度依赖。

5.2 未来研究方向

论文指出了 WMPO 的现有局限性和未来的研究方向:

- 动作空间扩展:当前 WMPO 聚焦于离散化的动作表示,未来将扩展到更具表达性的策略类别,如基于流匹配(flow-matching)的连续动作策略,并结合 FlowGRPO 进行优化;

- 部分可观测 MDP(POMDP):当前假设机器人状态可完全由图像观测定义,未来将研究更复杂的部分可观测场景,提升模型对非完全观测的鲁棒性;

- 更大规模的世界模型预训练:利用更大规模、更多样的机器人轨迹数据集预训练世界模型,进一步提升其通用动力学建模能力;

- 多机器人 / 多任务迁移:探索 WMPO 在多机器人平台、跨任务场景下的迁移能力,实现通用的机器人操作策略学习。

六、论文核心创新点总结

WMPO 的核心创新可概括为四大技术创新和一个范式创新:

6.1 技术创新

- 像素空间视频生成式世界模型:摒弃隐空间建模,采用像素空间的视频扩散模型,桥接世界模型与 VLA 的预训练视觉知识,解决特征分布不匹配问题;

- 策略行为对齐:利用策略自身的行为数据微调世界模型,解决专家演示与策略滚动的分布不匹配,让模型真实捕捉策略的失败模式;

- 鲁棒的长程轨迹生成技术:提出噪声帧条件化和帧级动作控制,解决自回归生成的误差累积、视觉失真和动作 - 帧错位问题;

- 轻量级二值奖励模型:基于 VideoMAE 的视频片段分类,实现高效、可靠的轨迹成败判定,避免奖励塑形和奖励攻击。

6.2 范式创新

提出了 **“想象空间的 VLA 在线 RL”** 新范式,将 VLA 的强化学习与真实世界交互完全解耦,既解决了真实世界 RL 的样本效率问题,又避免了离线 RL 的价值估计偏差,为通用机器人操作的可扩展学习提供了全新的思路。

七、论文团队与资源

- 作者单位:香港科技大学 + 字节跳动 Seed 团队;

- 通讯作者:Song Guo(香港科技大学)、Xiao Ma(字节跳动);

- 项目页面:https://wm-po.github.io/;

- 核心数据集:Open X-Embodiment (OXE)、Mimicgen;

- 基础模型:OpenVLA-OFT、OpenSora、SDXL、VideoMAE。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)