英伟达Jetson Nano 设计背景初衷、不足与限制及其在人形机器人中的应用(一)

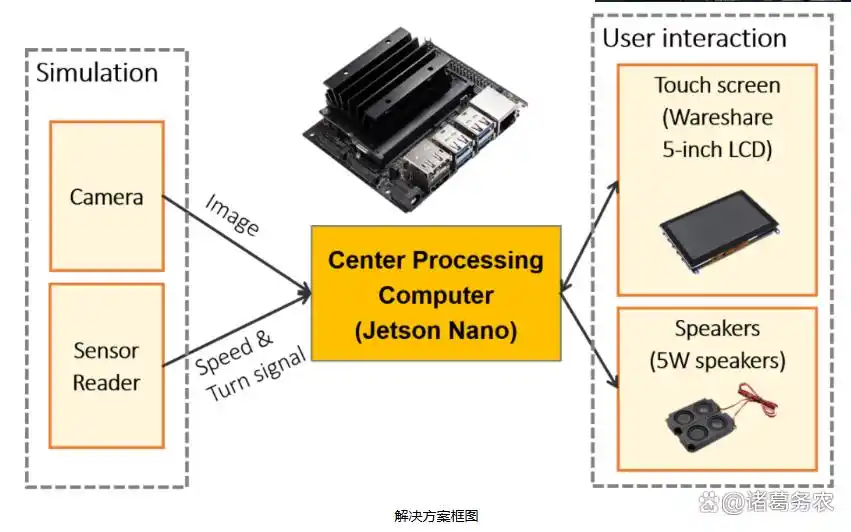

英伟达Jetson Nano作为嵌入式AI开发的入门级产品,在性能、功耗和成本间取得了良好平衡,472GFLOPS算力和5-10W功耗使其适用于机器人、智能视觉等边缘计算场景。其优势包括成熟的JetPack SDK软件栈、丰富接口和活跃开发者生态,但存在4GB内存瓶颈、散热限制及软件版本滞后等不足。Jetson产品线的演进趋势显示:软件持续挖掘硬件潜力、算力提升支持本地化大型AI模型运行、构建全栈

第一节:英伟达Jetson Nano及其演进趋势

英伟达Jetson Nano 自2019年推出以来,就以其相对亲民的价格和足以运行现代AI算法的性能,成为了很多开发者进入嵌入式AI和边缘计算世界的首选。随后,英伟达在2024年底对其进行了重大升级并价格减半,加之其整个Jetson产品线的演进,都清晰地指明了边缘智能的未来方向。

一、Jetson Nano核心特性

Jetson Nano的核心魅力,在于成功地在尺寸、功耗、成本和性能之间找到了一个难得的平衡点:

-

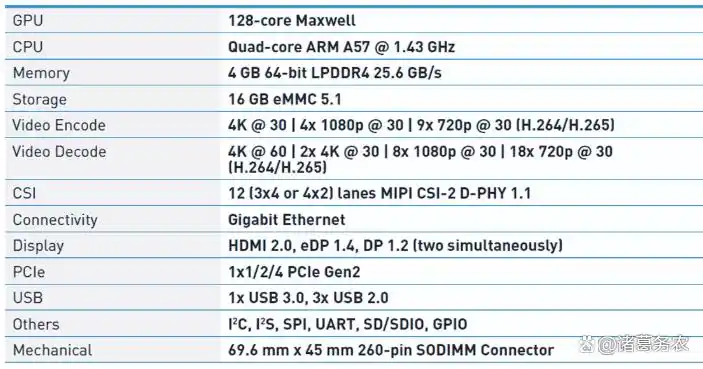

性能与功耗的平衡:Jetson Nano 模块提供了 472 GFLOPS 的加速计算能力,这对于一个功耗仅5W-10W、信用卡大小的模块来说非常可观。这意味着可以实时处理高分辨率传感器的数据,并且能并行运行多个神经网络。

-

成熟的软件栈与开发环境:Jetson Nano 同样受益于 NVIDIA JetPack SDK。JetPack 包含了板级支持包(BSP)、Linux OS、CUDA、cuDNN 和 TensorRT 等软件库,用于深度学习、计算机视觉、GPU计算和多媒体处理。这套丰富的软件堆栈能加速AI应用的部署,降低系统复杂性并缩短开发时间。

-

丰富的接口与连接性:Jetson Nano 配备了丰富的I/O接口,包括高速的CSI(支持多个摄像头)和PCIe,以及低速的I2C和GPIO等,使其能灵活连接各种传感器和外设,适应不同的应用场景。

-

强大的开发者生态:Jetson系列拥有一个庞大且活跃的开发者社区。无数的教程、开源项目和论坛讨论使得开发者可以快速上手并解决遇到的问题。同时,NVIDIA NGC目录中的预训练模型也经过性能优化,开发者可以借助NVIDIA TAO工具套件和客户数据集进行调优,这大大减少了AI软件开发的生产时间和成本。

二、Jetson Nano应用场景

Jetson Nano 的性能和特性使其在多个领域找到了用武之地:

-

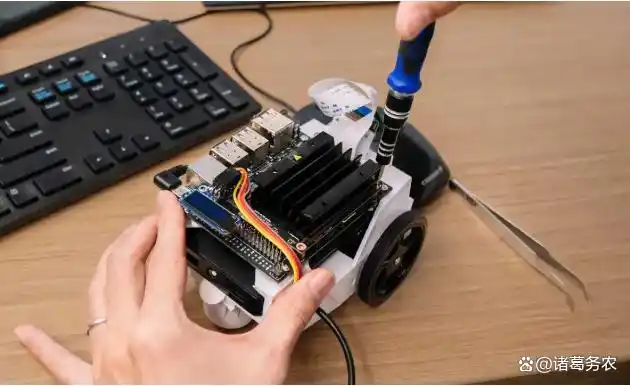

智能机器人:为小型商用机器人、教育机器人、无人机提供核心AI算力,用于目标检测、路径规划、自主导航等任务。例如,有研究基于Jetson nano开发板实现了自动跟随购物小车,采用深度学习方法完成跟随算法。

-

智能视觉分析系统:用于构建智能网络录像机(NVR)、监控摄像头,以及工业光学检测系统,实现实时的人脸识别、物体识别、异常行为检测和质量控制。

-

AIoT网关与嵌入式系统:作为智能网关,在边缘端聚合和处理来自多个传感器的数据,运行AI模型进行本地化决策,减少对云端的依赖,提升响应速度并保护隐私。

-

教育与科研:Jetson Nano是学习AI、机器人、计算机视觉的绝佳平台。其较低的入门成本和完整的软硬件生态,非常适合高校、科研机构和个人开发者进行原型验证和概念开发。

三、从Jetson Nano看演进趋势

Jetson Nano自身的升级和整个Jetson产品线的发展,揭示了边缘AI计算的几个清晰趋势:

-

软件定义与性能挖掘:

2024年底Jetson Nano的升级非常有趣:无需更换硬件,仅通过最新的JetPack SDK固件更新,就实现了内存带宽提升至102GB/s,INT8 TOPS性能提升57%-70%。这体现了英伟达“软件定义硬件”的策略,通过在硬件设计时预留“隐藏潜力”,并借助后期软件优化来持续释放性能,这不仅延长了产品生命周期,也增强了用户粘性。 -

算力飞跃与大型模型下沉边缘:

未来的边缘设备需要更强大的算力。英伟达在2025年8月发布的Jetson AGX Thor清晰地表明了这一点:其基于Blackwell GPU架构,AI算力(FP4精度)高达2070 TFLOPS,较前代Jetson AGX Orin提升约7.5倍。如此巨大的算力提升,旨在为了让人形机器人、自主机器等下一代边缘设备能够本地化运行大型语言模型(LLM)、视觉语言模型(VLM) 等复杂AI模型,实现更高级的自主推理和决策能力,而不必严重依赖云端。 -

平台化与生态闭环:

英伟达早已不止于卖硬件,而是构建软硬件一体的全栈平台。从Isaac Sim(用于机器人仿真)、Metropolis(用于视觉AI)等特定领域平台,到为机器人提供的基础模型(如Project GR00T) 和工具链(如Isaac Lab),英伟达致力于为开发者提供从开发、仿真到部署的端到端解决方案,极大缩短了产品上市时间。

Jetson Nano与其演进版性能比对

四、总结

Jetson Nano 是踏入嵌入式AI和边缘计算世界的一块坚实可靠的敲门砖。能够以相对较低的成本,学习和体验在终端设备上部署和运行AI应用的全过程。

而透过Jetson Nano的升级和整个Jetson系列的演进,看到的是边缘计算正朝着软件持续挖掘硬件潜能、算力向着支持本地化大型AI模型方向飞跃、以及构建从开发到部署的全栈平台生态的大趋势发展。

第二节:Jetson Nano 设计的背景初衷和目标及其不足与限制

一、设计背景、初衷与目标

Jetson Nano 的诞生,与下面这些因素密不可分:

-

边缘计算与AI的兴起:近年来,AI技术快速发展,图像识别、自然语言处理等领域取得了显著进步。同时,物联网(IoT)设备数量激增,产生了海量数据。将所有数据都传到云端处理,不仅网络延迟大、带宽成本高,还难以满足实时性要求,隐私和安全也是问题。因此,需要在数据产生的“边缘”就近处理,边缘计算(Edge Computing)应运而生。Jetson Nano 正是为了给这些边缘设备提供本地化的AI处理能力,使其能独立完成物体识别、自动导航等任务,而无需依赖云端。

-

降低AI开发门槛的愿景:在 Jetson Nano 之前,具备强大AI计算能力的嵌入式设备往往价格昂贵。许多创客、学生和开发者虽然对AI应用开发有兴趣,但可能被高昂的成本劝退。NVIDIA 希望推出一款 价格亲民 的产品,将现代AI的力量引入到一个低成本的平台,以支持创客、发明者、开发人员和学生的新一轮创新浪潮。

-

完善Jetson产品线布局:在 Jetson Nano 之前,NVIDIA 的 Jetson 系列已有用于完全自主机器的 Jetson AGX Xavier 和用于边缘人工智能的 Jetson TX2 等产品。Jetson Nano 的加入,使得 Jetson 平台将其适用范围扩展到全球更广泛的创客、开发人员、发明者和学生群体,形成了从高性能到入门级更完整的产品覆盖,以满足不同计算需求和预算的应用场景。

Jetson Nano 的设计初衷和目标可以概括为:打造一款小巧、低功耗、低成本,但又能提供足够AI计算性能的嵌入式计算机,旨在为数百万个智能系统提供动力,降低AI和机器人技术的开发门槛,推动边缘AI应用的创新和普及。

二、固有缺陷、不足与限制

尽管 Jetson Nano 在设计上取得了多项平衡,但其本身也存在一些固有的缺陷和限制,这在后续的使用和开发中逐渐显现:

-

计算资源有限:Jetson Nano 搭载了四核ARM Cortex-A57处理器和128核Maxwell架构GPU,提供472 GFLOPS的AI算力。这个性能对于运行现代AI工作负载和并行处理多个神经网络而言,在入门级应用中尚可,但与更高端的设备(如后来的 Jetson Orin 系列)相比,其计算资源仍然有限,可能无法胜任一些更复杂的任务。

-

内存瓶颈:Jetson Nano 配备了 4GB LPDDR4 内存。对于一些复杂的AI模型(例如某些版本的TensorFlow)和需要大内存的应用场景(如同时运行多个神经网络或处理大量数据),4GB的内存可能会成为瓶颈,导致系统需要频繁使用交换空间(swap),甚至因内存不足(OOM)而崩溃。

-

散热与功耗的权衡:Jetson Nano 在运行过程中可能会产生较多的热量,因此需要适当的散热措施(如散热片或主动风扇)来确保设备的稳定性和可靠性。虽然其功耗通常仅在5W到10W之间,但在高性能负载下,散热不佳会导致芯片 thermally throttling(热节流),即通过降频来防止过热,从而影响计算性能。

-

软件与生态的局限:

系统与软件版本:Jetson Nano 最初搭载的是 Ubuntu 18.04 LTS 操作系统,其内核版本和软件仓库相对较旧。用户尝试升级系统版本(如到Ubuntu 20.04)可能会遇到兼容性问题甚至导致系统无法启动。这对于希望使用较新版本库或工具的开发者也带来了一些挑战。

Python 与库版本限制:例如,Jetson Nano 系统自带的 Python 版本可能较低(如 Python 3.6.9),而一些新版本的深度学习框架(如 TensorFlow 2.x 的某些版本)可能需要更高版本的 Python 支持,这有时会为环境配置带来麻烦。

NVIDIA 的支持重心转移:随着 NVIDIA 推出更新、更强大的 Jetson 平台(如 Jetson Orin Nano系列),其对于 Jetson Nano 这类较早产品的官方更新和支持力度可能会逐渐减弱。

Jetson Nano 性能特征

(未完待续)

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献24条内容

已为社区贡献24条内容

所有评论(0)