自定义爬虫引擎开发:处理动态加载、表单自动填充与复杂交互实战

与依赖纯 HTTP 请求的传统爬虫不同,它内置或控制一个真实的浏览器内核(如 Chromium),能够执行 JavaScript、处理 AJAX 请求和响应用户交互事件,从而访问和抓取现代 Web 应用的全部数据。这个机器人不仅能收发信件,还能看到“按门铃”的纸条,走上前去按下门铃(执行 JavaScript),等待开门(等待动态内容加载),甚至能和开门的人对话(处理表单交互),最终拿到那个包裹(

前言

-

技术背景:在现代网络攻防与信息收集中,Web数据是核心情报源。然而,随着 AJAX、SPA(单页应用) 等前端技术普及,传统爬虫无法有效处理动态加载的内容。同时,许多关键数据隐藏在需要登录、表单提交等复杂交互之后。因此,开发能模拟真实用户行为、处理动态内容的自定义爬虫引擎,已成为突破数据获取瓶颈、进行深度网站分析和自动化安全测试的基础能力。它在整个攻防体系中,处于“信息收集”与“漏洞发现”阶段的关键节点。

-

学习价值:掌握本教程后,您将能够独立开发一个强大的自定义爬虫引擎,解决以下核心问题:

- 抓取动态内容:有效获取由 JavaScript 动态渲染的数据,突破传统爬虫的局限。

- 实现自动交互:自动化完成登录、表单自动填充、点击、滚动等复杂用户行为,访问受保护的内容。

- 构建可扩展框架:理解并搭建一个模块化、可配置的爬虫引擎,能适应不同目标的抓取任务。

-

使用场景:这项技术应用广泛,是多种网络任务的基石:

- 安全测试:自动化对 Web 应用进行漏洞扫描、凭证爆破和业务逻辑测试。

- 情报收集:大规模聚合来自社交媒体、暗网市场、特定论坛的公开及非公开情报。

- 业务监控:监控竞争对手网站价格变动、产品上新、舆情动态。

- 数据分析:为市场研究、金融分析等领域提供结构化数据源。

一、自定义爬虫引擎是什么

1. 精确定义

自定义爬虫引擎是一种通过编程模拟浏览器行为,以自动化方式与网站进行交互并提取其动态内容的软件程序。与依赖纯 HTTP 请求的传统爬虫不同,它内置或控制一个真实的浏览器内核(如 Chromium),能够执行 JavaScript、处理 AJAX 请求和响应用户交互事件,从而访问和抓取现代 Web 应用的全部数据。

2. 一个通俗类比

您可以把传统爬虫想象成一个只能通过邮局信箱收发信件的人。他能获取信箱里已有的所有信件(静态 HTML),但如果信箱里有一张纸条写着“请按门铃获取包裹”,他就无能为力了。

而自定义爬虫引擎则像一个拥有智能机器人的人。这个机器人不仅能收发信件,还能看到“按门铃”的纸条,走上前去按下门铃(执行 JavaScript),等待开门(等待动态内容加载),甚至能和开门的人对话(处理表单交互),最终拿到那个包裹(获取动态数据)。

3. 实际用途

- 自动化测试:模拟用户登录、填写复杂表单、点击购买按钮,验证整个业务流程是否正常,是否存在逻辑漏洞。

- 社交媒体监控:自动登录并抓取特定话题下的帖子、评论和用户关系,用于舆情分析。

- 金融数据采集:访问需要登录的网上银行或股票交易平台,定时抓取账户余额、交易历史等数据。

4. 技术本质说明

自定义爬虫引擎的技术本质是浏览器自动化。它通过特定的协议(如 Chrome DevTools Protocol, CDP)与浏览器内核进行通信,向其发送指令,如“打开这个网址”、“找到这个元素并点击”、“执行这段 JavaScript 代码”。浏览器接收指令后,像普通用户操作一样渲染页面、执行脚本,并将渲染后的页面状态、网络请求结果等信息返回给控制程序。这个过程完美复现了真实用户的浏览行为,因此能够处理任何复杂的网站。

二、环境准备

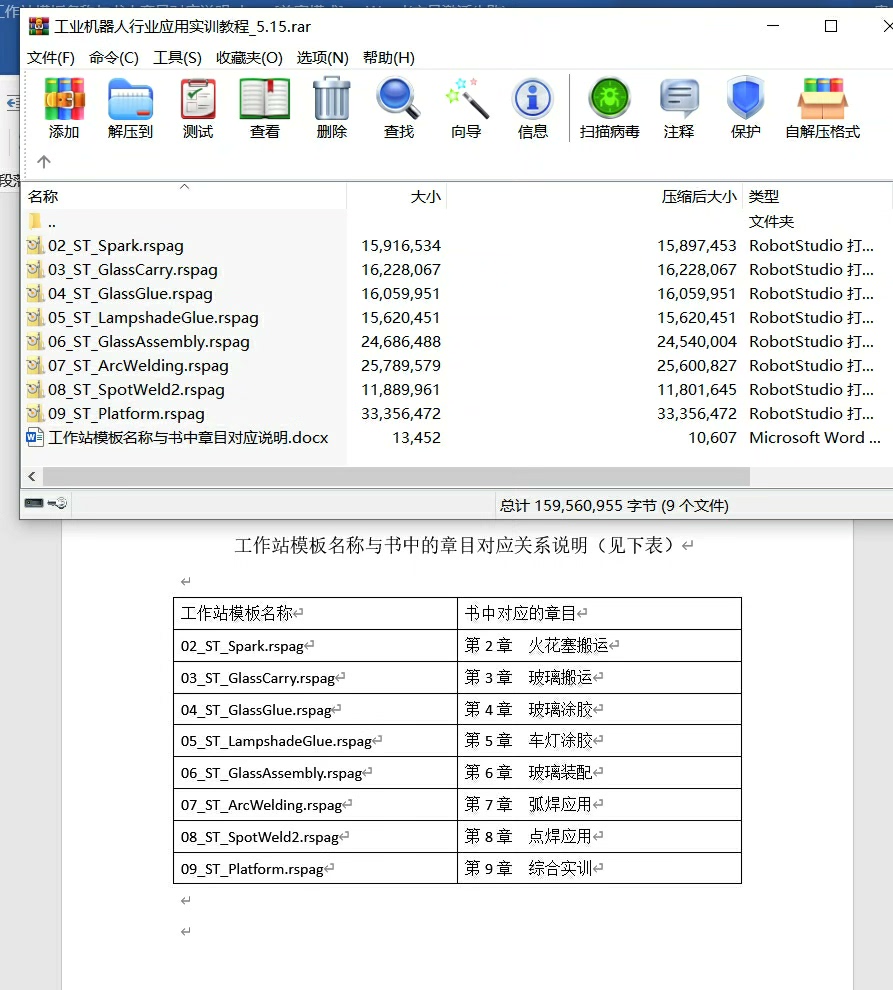

我们将使用 Python 配合 Playwright 库来构建爬虫引擎,Playwright 是一个功能强大且对开发者友好的现代浏览器自动化工具。

1. 工具版本

- Python: 3.8+

- Playwright: 1.40+

- Target Browser: Chromium (由 Playwright 自动管理)

2. 下载方式

首先,确保您已安装 Python。然后通过 pip 安装 Playwright。

# 安装 Playwright 库

pip install playwright

# 安装 Playwright 所需的浏览器内核 (Chromium, Firefox, WebKit)

# 这个过程会自动下载,无需手动配置

playwright install

3. 核心配置命令

Playwright 的配置非常简洁,大部分功能通过代码实现,无需复杂的配置文件。一个关键概念是选择以**有头(Headful)或无头(Headless)**模式运行。

- 无头模式 (Headless):默认模式,不在屏幕上显示浏览器窗口,适合在服务器上大规模运行。

- 有头模式 (Headful):显示浏览器窗口,便于开发和调试时观察爬虫的每一步操作。

4. 可运行环境命令或 Docker

为了确保环境隔离与可复现性,强烈建议使用 Docker。

Dockerfile 示例:

# 使用官方的 Playwright Docker 镜像

FROM mcr.microsoft.com/playwright/python:v1.40.0-jammy

# 设置工作目录

WORKDIR /app

# 复制项目文件到容器中

COPY . /app

# (可选) 如果有 requirements.txt 文件,安装其他依赖

# COPY requirements.txt .

# RUN pip install -r requirements.txt

# 默认执行的命令,例如运行主爬虫脚本

CMD ["python", "main_scraper.py"]

构建与运行 Docker 容器:

# 1. 将上述 Dockerfile 内容保存为 "Dockerfile" 文件

# 2. 将你的 Python 脚本 (例如 main_scraper.py) 放在同一目录

# 3. 构建 Docker 镜像

docker build -t custom-scraper-engine .

# 4. 运行容器

docker run --rm custom-scraper-engine

三、核心实战:模拟登录并抓取动态数据

本节将演示一个完整的 Playwright 使用方法,目标是模拟登录一个假设的测试网站,并抓取登录后才能看到的动态加载的用户信息。

目标网站:http://quotes.toscrape.com/login (一个为爬虫练习而设计的网站)

1. 编号步骤与目的说明

- 步骤 1:启动浏览器与创建页面

- 目的:初始化爬虫环境,打开一个浏览器实例和一个新的标签页,为后续操作做准备。

- 步骤 2:导航至登录页面

- 目的:访问目标网站的登录入口。

- 步骤 3:自动填充表单并提交

- 目的:模拟用户输入账号密码,实现表单自动填充,并点击登录按钮。这是处理交互的核心。

- 步骤 4:处理动态加载与等待

- 目的:登录后,页面可能会跳转或通过 AJAX 动态加载内容。必须等待关键元素出现,确保后续抓取操作不会因为内容未加载而失败。

- 步骤 5:提取目标数据

- 目的:在登录后的页面上,定位并提取所需的用户信息。

- 步骤 6:关闭浏览器

- 目的:释放资源,结束爬虫任务。

2. 完整可运行示例与自动化脚本

以下是集成了所有步骤的自动化脚本。它包含了详细的注释、错误处理机制和可配置的参数。

# main_scraper.py

import asyncio

import argparse

from playwright.async_api import async_playwright, TimeoutError as PlaywrightTimeoutError

# --- 授权测试警告 ---

# 本脚本仅限在获得明确授权的测试环境中使用。

# 未经授权对任何网站进行自动化访问可能违反其服务条款,甚至触犯法律。

# 使用者需自行承担所有风险与责任。

async def scrape_user_data(username, password, headless=True, timeout=30000):

"""

一个自动登录并抓取动态用户数据的爬虫函数。

:param username: 登录用户名

:param password: 登录密码

:param headless: 是否以无头模式运行 (True/False)

:param timeout: 操作超时时间 (毫秒)

:return: 抓取到的数据或错误信息

"""

async with async_playwright() as p:

# 步骤 1: 启动浏览器与创建页面

# 这里我们选择 chromium,也可以是 'firefox' 或 'webkit'

browser = await p.chromium.launch(headless=headless)

context = await browser.new_context()

page = await context.new_page()

page.set_default_timeout(timeout)

print(">>> [INFO] 浏览器已启动...")

try:

# 步骤 2: 导航至登录页面

login_url = "http://quotes.toscrape.com/login"

print(f">>> [INFO] 正在导航至: {login_url}")

await page.goto(login_url)

# 步骤 3: 自动填充表单并提交

print(">>> [INFO] 正在填充登录表单...")

# 使用 CSS 选择器定位输入框并填充

await page.fill("input#username", username)

await page.fill("input#password", password)

# 点击登录按钮

print(">>> [INFO] 正在提交登录表单...")

await page.click("input[type='submit']")

# 步骤 4: 处理动态加载与等待

# 等待登录成功后的特定元素出现,这里我们等待 "Logout" 按钮出现

# 这是一个关键的同步点,确保页面已完成登录跳转和内容加载

print(">>> [INFO] 等待登录成功标识...")

await page.wait_for_selector("a[href='/logout']", state="visible")

print(">>> [SUCCESS] 登录成功!")

# 步骤 5: 提取目标数据

# 假设登录后,页面上有一个动态加载的欢迎信息

# 我们通过 CSS 选择器找到它并提取文本

# 注意:实际网站中,这部分内容可能是通过 AJAX 请求后才渲染的

welcome_message_selector = "a[href='/logout']" # 示例中用登出链接代替动态内容

welcome_text = await page.inner_text(welcome_message_selector)

print(f">>> [DATA] 成功抓取到数据: {welcome_text}")

# 模拟抓取更复杂的数据

quotes = await page.query_selector_all(".quote")

scraped_data = []

for quote in quotes:

text = await quote.query_selector(".text")

author = await quote.query_selector(".author")

scraped_data.append({

"text": (await text.inner_text()).strip(),

"author": (await author.inner_text()).strip()

})

print(f">>> [DATA] 抓取到 {len(scraped_data)} 条名言。")

return {"status": "success", "welcome_message": welcome_text, "quotes": scraped_data}

except PlaywrightTimeoutError:

error_msg = "操作超时。可能原因:页面加载过慢、元素未找到或登录失败。"

print(f">>> [ERROR] {error_msg}")

# 保存截图以供调试

await page.screenshot(path="error_screenshot.png")

print(">>> [DEBUG] 错误截图已保存为 error_screenshot.png")

return {"status": "error", "message": error_msg}

except Exception as e:

error_msg = f"发生未知错误: {e}"

print(f">>> [ERROR] {error_msg}")

await page.screenshot(path="error_screenshot.png")

print(">>> [DEBUG] 错误截图已保存为 error_screenshot.png")

return {"status": "error", "message": error_msg}

finally:

# 步骤 6: 关闭浏览器

if 'browser' in locals() and browser.is_connected():

await browser.close()

print(">>> [INFO] 浏览器已关闭。")

async def main():

# 设置命令行参数解析

parser = argparse.ArgumentParser(description="自定义爬虫引擎 - 动态内容抓取实战")

parser.add_argument("-u", "--username", type=str, default="user", help="登录用户名")

parser.add_argument("-p", "--password", type=str, default="password", help="登录密码")

parser.add_argument("--show-browser", action="store_false", dest="headless", help="显示浏览器窗口进行调试")

parser.add_argument("-t", "--timeout", type=int, default=30, help="操作超时时间(秒)")

args = parser.parse_args()

# 运行爬虫

result = await scrape_user_data(

username=args.username,

password=args.password,

headless=args.headless,

timeout=args.timeout * 1000 # 转换为毫秒

)

print("\n--- 最终结果 ---")

print(result)

if __name__ == "__main__":

# 使用 asyncio 运行异步主函数

asyncio.run(main())

如何运行:

# 使用默认参数运行 (无头模式)

python main_scraper.py

# 显示浏览器窗口运行 (有头模式,便于调试)

python main_scraper.py --show-browser

# 使用自定义用户名和密码运行

python main_scraper.py -u your_username -p your_password

3. 请求 / 响应 / 输出结果

请求 (由 Playwright 自动完成):

GET http://quotes.toscrape.com/loginPOST http://quotes.toscrape.com/login(包含username和password的表单数据)GET http://quotes.toscrape.com/(登录成功后的跳转)

输出结果 (在终端显示):

>>> [INFO] 浏览器已启动...

>>> [INFO] 正在导航至: http://quotes.toscrape.com/login

>>> [INFO] 正在填充登录表单...

>>> [INFO] 正在提交登录表单...

>>> [INFO] 等待登录成功标识...

>>> [SUCCESS] 登录成功!

>>> [DATA] 成功抓取到数据: Logout

>>> [DATA] 抓取到 10 条名言。

>>> [INFO] 浏览器已关闭。

--- 最终结果 ---

{'status': 'success', 'welcome_message': 'Logout', 'quotes': [{'text': '“The world as we have created it is a process of our thinking. It cannot be changed without changing our thinking.”', 'author': 'Albert Einstein'}, ...]}

四、进阶技巧

1. 常见错误与解决方案

-

TimeoutError: 最常见的错误。- 原因: 网络慢、选择器错误、页面结构变化、人机验证(如 CAPTCHA)。

- 解决方案:

- 增加

timeout参数值。 - 使用

page.wait_for_selector()确保元素可见再操作。 - 登录或关键操作后,使用

page.wait_for_url()或page.wait_for_load_state('networkidle')等待页面稳定。 - 检查选择器是否正确,或目标网站是否更新了前端代码。

- 对于人机验证,需要集成第三方打码平台 API 或使用更高级的反检测技术。

- 增加

-

元素被遮挡 (

Element is not visible, enabled, or stable):- 原因: 元素存在于 DOM 中,但被弹窗、浮动广告等其他元素遮挡。

- 解决方案:

- 在点击前,先尝试关闭可能的遮挡物(如点击“接受 Cookie”按钮)。

- 使用

element.scroll_into_view_if_needed()将元素滚动到可视区域。 - 使用

page.click(selector, force=True)强制点击,但这可能不触发 JavaScript 事件。 - 使用

page.evaluate()执行 JavaScript 直接点击:await page.evaluate("document.querySelector('your-selector').click();")。

2. 性能 / 成功率优化

- 禁用非必要资源加载: 提升页面加载速度。

# 拦截并阻止图片、CSS、字体的加载 await page.route("**/*.{png,jpg,jpeg,css,woff}", lambda route: route.abort()) - 使用

wait_for_selector代替固定延时:time.sleep()是不可靠的,会导致爬虫要么等待太久,要么过早操作而失败。wait_for_selector更精确、更高效。 - 复用浏览器上下文 (Context): 如果需要对同一网站进行多次抓取,可以复用登录状态,避免重复登录。

# 登录一次后,保存状态 await context.storage_state(path="state.json") # 后续启动时,加载状态 browser = await p.chromium.launch() context = await browser.new_context(storage_state="state.json") - 并发执行: 使用

asyncio.gather同时处理多个页面或任务,大幅提升效率。

3. 实战经验总结

- 选择器策略: 优先使用

id、data-testid等稳定属性。避免使用动态生成、容易变化的class或xpath路径。 - 模拟人类行为: 在操作之间加入随机的短暂延时

await page.wait_for_timeout(random.randint(500, 2000)),移动鼠标await page.mouse.move(...),可以降低被反爬虫系统检测的概率。 - 调试是关键: 开发时始终使用有头模式 (

headless=False),并设置slow_mo参数launch(headless=False, slow_mo=50),可以放慢每一步操作,便于观察。

4. 对抗 / 绕过思路 (中高级主题)

现代网站会使用 JavaScript 指纹识别、人机行为分析等技术来检测和阻止自动化工具。以下是一些对抗思路:

- 修改浏览器指纹: Playwright 本身已经做得很好,但高级对抗需要修改

navigator对象属性(如webdriver、plugins等)。# 在页面加载前执行脚本,修改 navigator.webdriver 属性 await page.add_init_script("Object.defineProperty(navigator, 'webdriver', {get: () => undefined})") - 使用代理轮换 IP: 防止因请求频率过高而被封禁 IP。

# 启动浏览器时配置代理 browser = await p.chromium.launch( proxy={ "server": "http://your-proxy-server:port", "username": "proxy-user", "password": "proxy-password" } ) - 使用 Stealth 插件: 社区提供了针对 Playwright 的

stealth插件(如playwright-stealth),它能自动处理多种常见的反爬虫检测手段,是进行 Playwright 原理研究和实战的利器。

五、注意事项与防御

1. 错误写法 vs 正确写法

| 错误写法 (脆弱且低效) | 正确写法 (健壮且高效) | 理由 |

|---|---|---|

import time; time.sleep(5) |

await page.wait_for_selector(...) |

避免不必要的等待和因网络波动导致的失败。 |

page.click(".btn-class-123") |

page.click("[data-testid='submit-login']") |

依赖稳定、为测试设计的属性,而不是易变的 CSS 类名。 |

| 每次都重新登录 | context.storage_state() 保存和复用会话 |

大幅提升效率,减少对目标服务器的压力。 |

| 硬编码敏感信息在代码中 | 从环境变量或配置文件读取 | 提高安全性,便于在不同环境中部署。 |

2. 风险提示

- 法律风险: 未经授权的爬取可能构成非法获取计算机信息系统数据罪。务必遵守

robots.txt协议,并只在获得授权的范围内进行测试和数据收集。 - 资源消耗: 无头浏览器非常消耗 CPU 和内存。在服务器上大规模部署时,必须进行资源监控和管理,否则可能导致服务器崩溃。

- 被封禁风险: 过于频繁或具有攻击性的请求会导致 IP、账号甚至设备指纹被目标网站封禁。

3. 开发侧安全代码范式 (如何防御此类爬虫)

- 增强人机验证: 在登录、注册等关键操作上部署先进的 CAPTCHA 服务(如 reCAPTCHA v3, hCaptcha),它们能基于用户行为分析来区分人与机器。

- 后端速率限制: 对来自同一 IP 或同一用户的请求频率进行严格限制。

- JavaScript 指纹检测: 在前端收集浏览器环境信息(如字体、分辨率、插件、

navigator属性),发送到后端进行分析,识别已知的自动化工具(如navigator.webdriver === true)。 - 业务逻辑混淆: 定期更换前端选择器

id和class,增加 API 接口的加密和签名参数,提高逆向工程和抓取脚本的维护成本。

4. 运维侧加固方案

- 使用 WAF (Web 应用防火墙): 部署能够识别和拦截自动化工具流量的 WAF。许多商业 WAF 都有针对 Scrapy, Playwright 等常见框架的内置规则集。

- 监控异常流量: 监控访问日志,寻找非人类的访问模式,例如:固定的 User-Agent、极高的请求频率、无间隔的页面访问等。

- IP 黑名单与信誉库: 接入 IP 信誉数据库,主动屏蔽已知的代理、Tor 节点和数据中心 IP。

5. 日志检测线索

作为防御方,可以从服务器访问日志中寻找以下线索来发现自定义爬虫:

- User-Agent: 尽管可以伪造,但很多初级爬虫会使用默认的 Playwright User-Agent。

- 请求间隔: 毫秒级且非常有规律的请求间隔是机器行为的明显特征。

- 访问路径: 缺少对 CSS, JS, 图片等静态资源的请求,或者访问路径不符合正常用户浏览逻辑(例如,直接访问深层 URL 而没有经过首页)。

- 并发连接数: 单个 IP 在短时间内建立大量并发连接。

六、原理核心机制图

以下是自定义爬虫引擎(以 Playwright 为例)工作原理的 Mermaid 流程图,清晰展示了从指令到数据获取的全过程。

这张图独立地解释了用户脚本、Playwright 库、浏览器内核和网站服务器之间的交互时序,是理解整个自定义爬虫引擎实战背后机制的关键。

七、总结

- 核心知识: 自定义爬虫引擎的核心是浏览器自动化,通过 Playwright 等工具模拟用户行为,执行 JavaScript,从而处理动态加载、表单自动填充与复杂交互。

- 使用场景: 其应用贯穿攻防测试、情报收集和业务监控,是现代网络信息获取不可或缺的利器。

- 防御要点: 防御方应从人机验证、后端速率限制、前端指纹检测和 WAF 部署等多个层面建立纵深防御体系。

- 知识体系连接: 本技术是“Web 基础”和“Web 安全”的延伸,上游连接 HTTP 协议和前端知识,下游连接数据处理、漏洞挖掘和机器学习。

- 进阶方向: 深入研究方向包括大规模分布式爬虫集群、逆向工程分析 JavaScript 混淆、以及基于机器学习的行为检测与绕过。

自检清单

- 是否说明技术价值?

- 是否给出学习目标?

- 是否有 Mermaid 核心机制图?

- 是否有可运行代码?

- 是否有防御示例?

- 是否连接知识体系?

- 是否避免模糊术语?

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献9条内容

已为社区贡献9条内容

所有评论(0)