Spatial Forcing:视觉-语言-动作模型的隐空间表征对齐

25年10月来自香港科大(广州)、清华、西湖、浙大、华南理工大学的论文“Spatial Forcing: Implicit Spatial Representation Alignment For Vision-language-action Model”。视觉-语言-动作(VLA)模型近年来展现出巨大的潜力,能够使机器人遵循语言指令并执行精确动作。然而,大多数VLA模型都基于仅使用二维数据预训练

25年10月来自香港科大(广州)、清华、西湖、浙大、华南理工大学的论文“Spatial Forcing: Implicit Spatial Representation Alignment For Vision-language-action Model”。

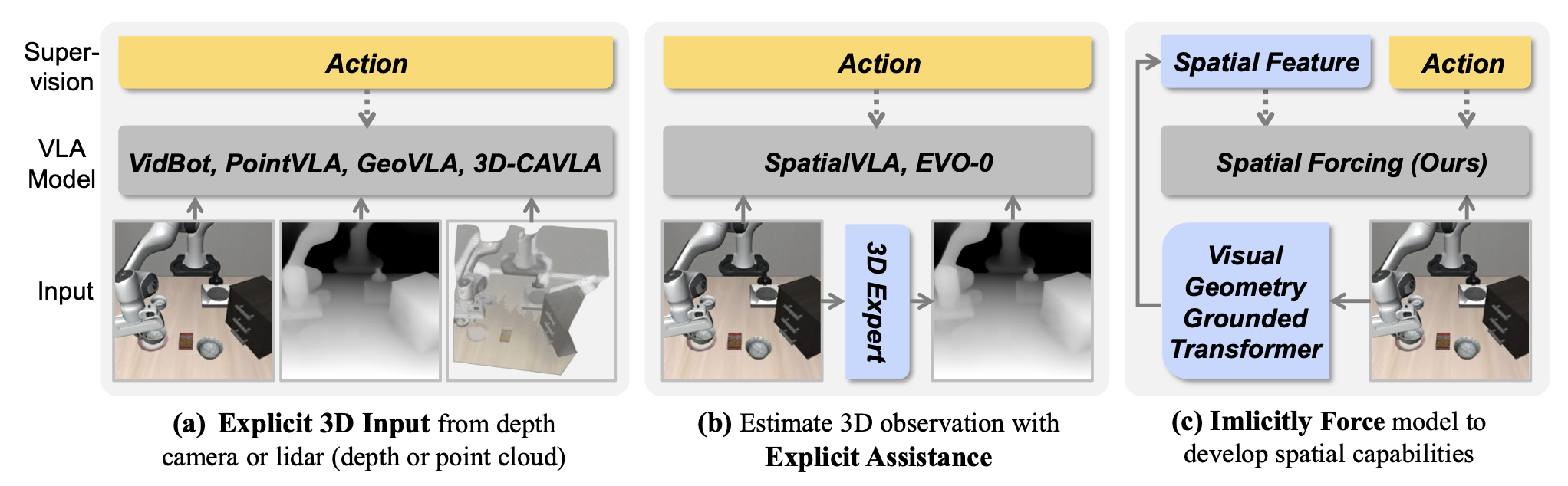

视觉-语言-动作(VLA)模型近年来展现出巨大的潜力,能够使机器人遵循语言指令并执行精确动作。然而,大多数VLA模型都基于仅使用二维数据预训练的视觉-语言模型构建,这些模型缺乏精确的空间感知能力,从而限制它们在三维物理世界中的运行。现有解决方案尝试引入显式的三维传感器输入,例如深度图或点云,但由于传感器噪声、硬件异构性以及现有数据集深度覆盖不完整等问题,这些方法面临诸多挑战。从二维图像中估计三维线索的替代方法也受到深度估计器性能有限的限制。提出一种名为“空间强制”(Spatial Forcing,SF)的简单而有效对齐策略,该策略能够隐式地强制VLA模型发展空间理解能力,而无需依赖显式的三维输入或深度估计器。 SF 将 VLA 的中间视觉嵌入与预训练的 3D 基础模型生成的几何表示进行对齐。通过在中间层强制执行对齐,SF 引导 VLA 编码更丰富的空间表示,从而提高动作精度。在仿真和真实环境中进行的大量实验表明,SF 取得最先进的结果,超越基于 2D 和 3D 的 VLA。SF 还将训练速度提高 3.8 倍,并提高各种机器人任务的数据效率。

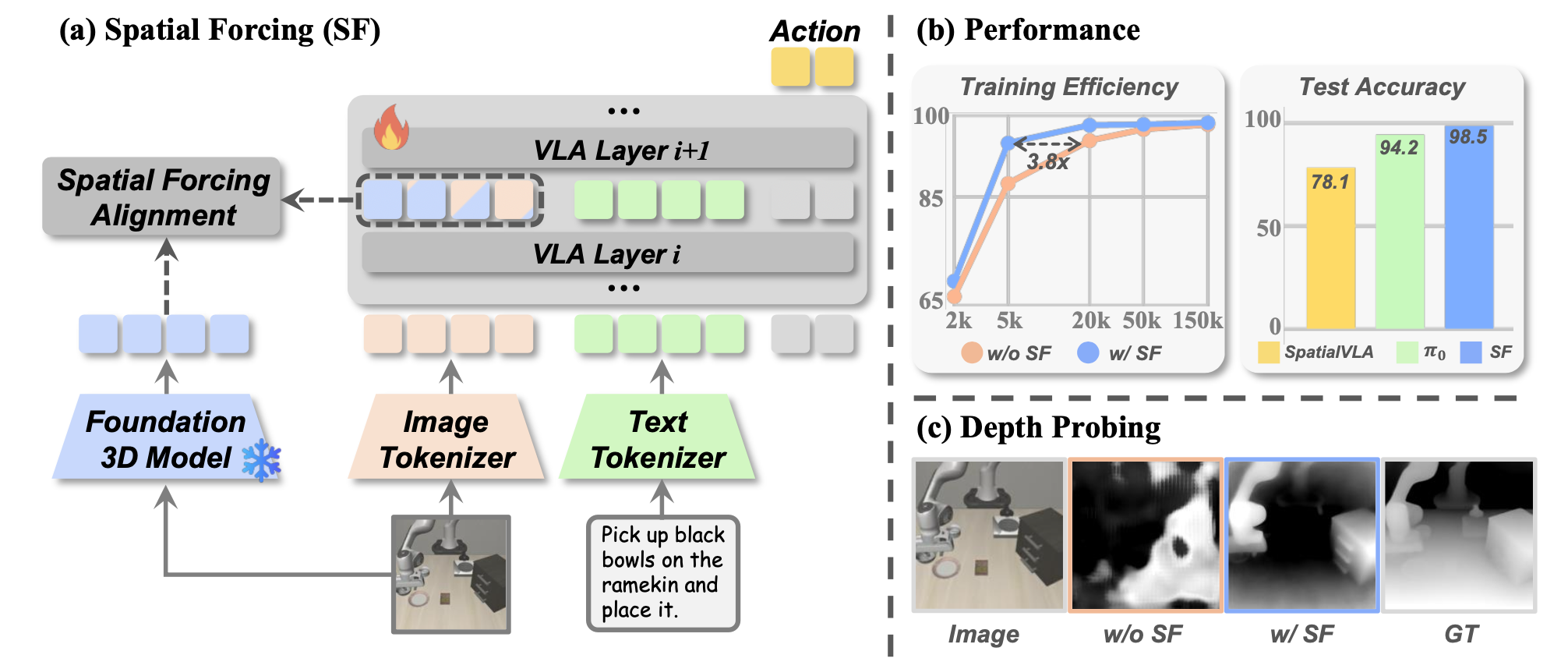

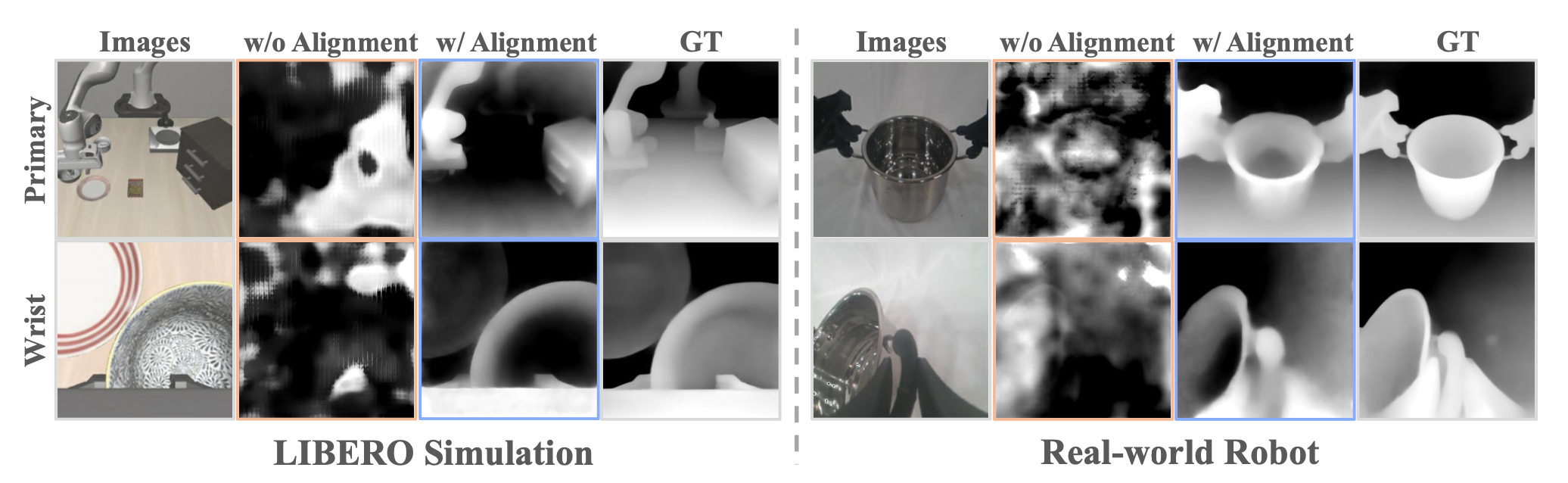

本文进行一项轻量级的深度探测实验:从主流的视觉语言动作(VLA)(Kim et al., 2025)中提取冻结的视觉嵌入,并仅训练一个DPT头(Ranftl et al., 2021)来预测深度图。如图©所示,该观察结果表明原始视觉嵌入无法产生有意义的空间结构,揭示在没有外部指导的情况下训练的VLA在空间推理能力方面可能存在的不足。为了弥补这一不足,本文提出空间强制(Spatial Forcing,SF)策略,这是一种简单而有效的对齐策略,它隐式地强制VLA模型获取空间觉察知识。具体而言,对于具有因果注意机制的自回归VLA,动作token的生成取决于先前的视觉和语言token。直观地说,包含更丰富空间信息的高质量视觉token有助于生成更精确的操作动作。近期研究(Huang et al., 2025; Wang et al., 2024; Yu et al., 2024)证明表征监督的有效性。受此启发,如图 (a) 所示,将VLA的中间视觉嵌入与从预训练的 3D 基础模型中提取的外部空间表征进行对齐。在技术上,为了确保多视角一致性,采用 VGGT(Wang et al., 2025b)作为 3D 基础模型,以同时处理机器人图像并生成归一化的空间表征,这些表征作为监督信号。总而言之,通过对齐表征,隐式地促使 VLA 发展出 3D 理解能力。

在多个仿真环境和真实世界进行的实验验证SF的有效性。在 LIBERO 和 RoboTwin 数据集上的实验结果(如图 (b))表明,SF达到目前最先进的 (SOTA) 性能,超越以往的优秀基线方法,包括二维和三维VLA。针对训练迭代次数和数据集大小的额外实验表明,该方法在显著减少数据量的情况下,实现 3.8 倍的训练效率,同时展现出极高的数据利用率。最后,实际应用实验验证了该方法的空间理解和数据利用能力。

预备工作

视觉-语言-动作模型(VLA)基于预训练的视觉-语言模型(VLM)构建,并通过针对动作专家的专门设计生成动作。θ参数化的VLM模型采用自回归方式,利用多个因果注意层生成下一个token,其形式为x_t ∼ p_θ(x_t | x<t),其中{x_t}表示token序列。

VLA模型将处理三种模态的信息:视觉、文本和动作。视觉模态由机器人捕获的多视角图像组成,这些图像通过预训练的视觉编码器(例如DINOv2(Oquab,2023)或SigLIP(Zhai,2023))转换为N个视觉token {xV_t}。文本模态由任务指令组成,这些指令由文本token化器转换为 M 个语言tokens {xL_t}。然后,VLA 模型根据前面的视觉和语言tokens生成 K 个动作 tokens {xA_t}。L[·, ·] 表示训练损失(例如 L1、L2 或交叉熵损失),G 表示可训练的动作专家(例如双层 MLP 或流匹配头(Lipman,2022))。其表明,作为中间场景表征的视觉token在生成动作token中起着至关重要的作用,并且可以进行适当的监督学习。

视觉几何接地Transformer(VGGT)。VGGT(Wang,2025b)是一种前馈模型,它基于一系列二维图像直接输出场景的各种三维属性,包括相机参数、点图、深度图和三维点轨迹。它由一个Transformer骨干网络和多个预测头组成。为了使Transformer能够交替地关注每一帧内和全局信息,该模型采用一种交替注意机制,将帧级自注意和全局自注意交错进行。对于每一帧,局部特征和全局特征被整合到一个统一的潜表示中,随后由一组特定任务的预测头进行处理,以生成相应的三维属性。在本文工作中,从VGGT Transformer骨干网络中提取的潜表示固有地编码丰富的空间信息,足以作为三维监督信号。

动机

挑战:弥合仅基于二维图像预训练的VLM与物理世界底层动态三维结构之间的差距极具挑战性。一些方法(Chen et al., 2025; Li et al., 2025a; Bhat et al., 2025a; Li et al., 2025c; Sun et al., 2025)(如图 (a))利用深度相机获取深度图作为输入,但由于三维数据质量低且数量有限,其有效性受到限制。其他方法(Qu et al., 2025; Lin et al., 2025)(如图 (b))尝试从二维图像中估计三维信息,但其能力受限于深度估计器的性能,导致策略并非最优。这些挑战促使探索一种通用且可扩展的3D VLA训练范式。如图(c)所示,其隐式地强制模型开发空间能力。

观察。由于VLA模型必须捕捉3D信息并推断机器人与物体之间的相对位置才能生成精确的空间运动,假设3D信息隐式地嵌入在VLA的视觉嵌入中。这种嵌入使得动作token能够在推理过程中通过自回归机制获取3D线索。

为了验证这一假设,借鉴线性探测(He et al., 2020)和Wu et al.(2025)的方法,进行一项轻量级的深度探测实验。具体而言,冻结VLA模型的所有参数,仅训练一个DPT头部(Ranftl et al., 2021),将VLA的视觉嵌入转换为深度图。这样能够量化嵌入在VLA表征空间中的空间信息的丰富程度。

如图所示,探测结果表明,仅从二维图像学习到的视觉嵌入无法产生有意义的空间结构,这表明该模型在没有显式空间输入或指导的情况下,编码三维结构信息的能力有限。

空间强制

主要思路是利用外部监督信号来监督视觉token xV。为了给这些信号提供丰富的空间信息,首先将一组多视角图像 I 输入到预训练的三维基础模型 VGGT f3D 中,该模型会输出每幅图像 I 的像素级空间表示 f3D (I)。此外,这些空间表示还添加额外的位置嵌入 E,以确保监督的token在 VLA 的自回归过程中保持关键的位置顺序。为了使 VLA 的逐像素视觉token与该三维基础模型对齐,首先对每个 x_i 进行批量归一化 Γ,然后使用一个两层 MLP 来确保特征维度的兼容性。然后,采用余弦相似度得分来最大化 VLA 的视觉token与空间表征信号之间的对齐程度。

此外,由于VLA模型中存在多个因果注意层,因此在不同层之后可以获得多个xV值。监督相对较深的层(而非最深的层)对于提升动作性能最为有效。原因可能是,更深的层会丢失更多视觉相关的特征,使其更难进行目标空间表征的监督,这与Huang(2024)的结论类似。

最终的训练目标结合用于动作生成的标准训练损失和3D基础模型对齐损失,并引入权重因子α。总体而言,通过SF,VLA 模型能够隐式且高效地获得空间推理能力。

模型推理。在推理过程中,以 SF 方式训练的 VLA 模型与未采用 SF 的标准 VLA 模型运行方式完全相同,无需引入额外的结构或计算开销,从而凸显 SF 的高度适用性。

仿真实验

仿真环境。在两个广泛使用的仿真基准测试平台 LIBERO (Liu et al., 2023a) 和 RoboTwin (Mu et al., 2025) 上评估方法。LIBERO 由四个主要任务套件组成:LIBERO-Spatial、LIBERO-Object、LIBERO-Goal 和 LIBERO-Long。每个任务套件包含 10 个任务的 500 个专家演示,用于研究策略对不同空间布局、物体、目标和长时程任务的泛化能力。RoboTwin 是一个真实-到-仿真的双手动基准测试平台。它包含一个使用域内布局的简单设置和一个使用域随机化的困难设置,后者包括场景杂乱、不同的背景纹理、光照变化和不同的桌面高度。在各种任务上评估方法。报告成功率 (SR) 作为这两个基准测试平台的评估指标。

基础模型和实现细节。遵循 Kim (2025) 的方法和 Black (2024) 分别采用 LIBERO 数据集上的 OpenVLA-OFT 和 RoboTwin 数据集上的 π0 作为基础模型。OpenVLA-OFT 使用在 Open-X-Embodiedment 数据集 (O’Neill,2024b) 上预训练的 Prismatic VLM (Karamcheti,2024) 作为视觉骨干网络,并使用融合视觉骨干网络(包括 SigLIP (Zhai,2023) 和 DINOv2 (Oquab,2023))作为视觉骨干网络。基于 OpenVLA-OFT 在 8 个 NVIDIA H100 显卡上训练 SF 模型,迭代次数为 15 万次,以便与其他方法进行比较。π0 使用 PaliGemma (Beyer,2024) 作为视觉骨干网络。本文用 LoRA(Hu,2022)在 1 个 NVIDIA H100 显卡上,基于 π0 训练本文的SF 模型,迭代次数为 3 万次。为确保公平性,所有训练和评估均遵循官方设置。

真实世界实验

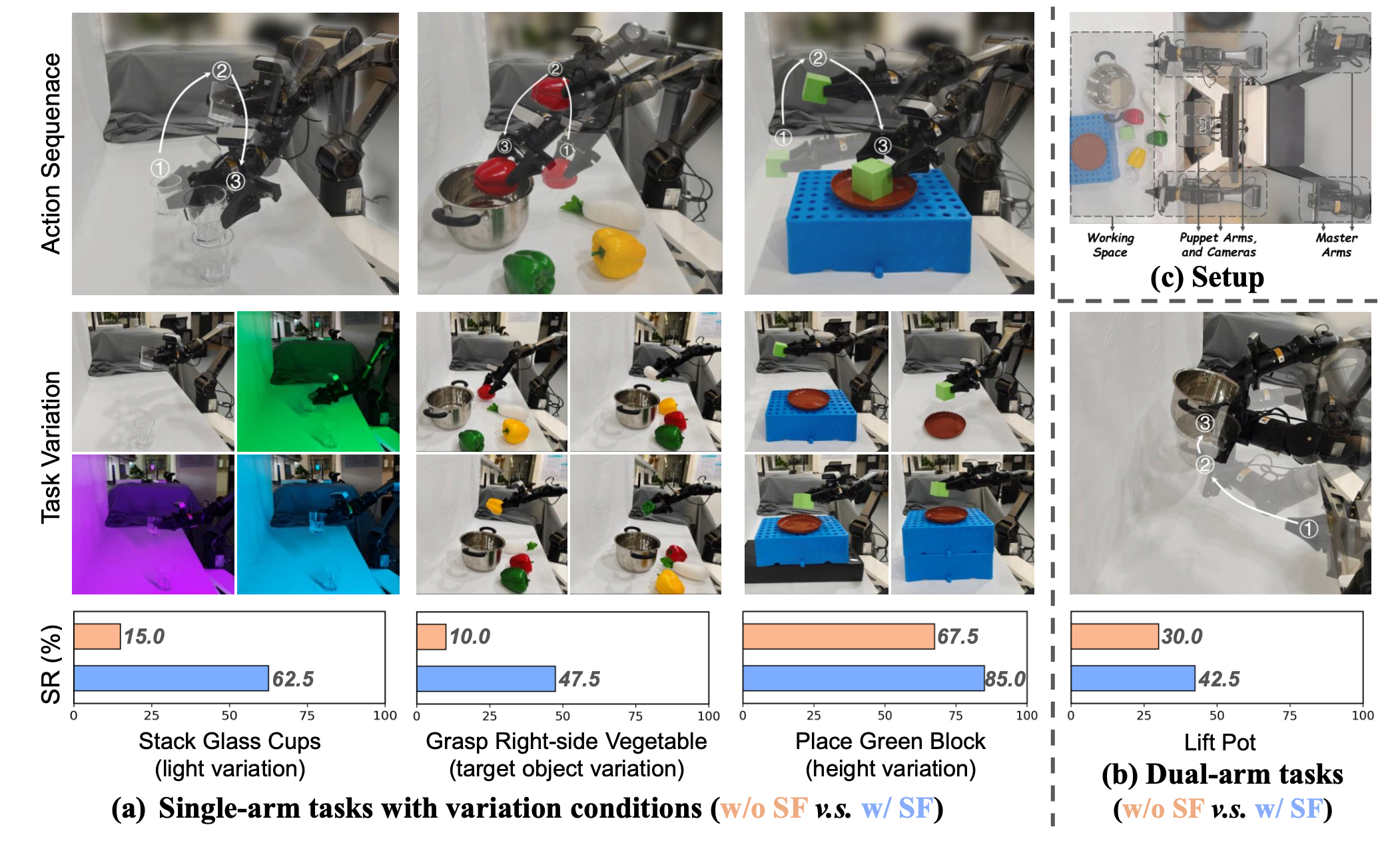

如图 © 所示,在双臂 AgileX 平台上进行真实机器人实验。每条机械臂由一个 6 自由度 Piper 机械臂和一个 1 自由度夹爪组成。机身和机械臂上分别安装一个主摄像头和两个腕部摄像头。设计一系列涵盖空间能力各个维度的综合任务:堆叠不同光照条件下的玻璃杯、抓取不同目标物体的右侧蔬菜、放置不同高度的绿色积木以及使用不同身体姿势举起花盆。为了检验数据效率,模型仅使用 40 个单臂任务演示数据和 20 个双臂任务演示数据进行训练。在评估过程中,对每个单臂任务的每个变体进行 10 次试验(共 40 次试验),对双臂任务进行 20 次试验。将每个任务的成功率 (SR) 作为评估指标。如图(a)和(b)分别是在真实环境的单臂和双臂任务。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献211条内容

已为社区贡献211条内容

所有评论(0)