达摩院CVPR'25|让Video LLM精准理解任意物体!VideoRefer Suite:实现视频大模型“细粒度”时空理解

作者|袁瑜谦 阿里巴巴达摩院实习生

【CVPR 2025预讲会】系列内容

CVPR 2025预讲会系列文章来源于 DAMO 开发者矩阵与 AI Time 联合举办 CVPR 2025预讲会整理成稿,旨在帮助大家率先了解计算机视觉领域的最新研究方向和成果。

摘要

当前视频大模型(Video LLM)在整体视频理解上表现出色,却难以精准捕捉视频中特定物体的细节变化(细粒度时空理解)。针对该挑战,本研究工作致力于提升视频大模型(Video LLM)的细粒度时空理解能力,使其能精准感知和推理视频中任意物体的细节变化。

该工作从数据、模型、评测三方面协同发力,提出VideoRefer Suite:(1)利用多智能体协作打造首个大规模高质量物体级视频指令数据集VideoRefer-700K;(2)设计 VideoRefer模型,其核心多功能时空物体编码器能有效提取物体的精确区域与动态序列特征;(3)构建首个细粒度视频理解综合性评测基准 VideoRefer-Bench ,为模型能力提供多维度评估标准。实验证明,该方案不仅能显著提升视频指代任务的性能,更能增强Video LLM的通用视频理解能力。

论文链接:https://arxiv.org/pdf/2501.00599

项目主页:https://damo-nlp-sg.github.io/VideoRefer/

代码仓库:https://github.com/DAMO-NLP-SG/VideoRefer

现存问题及挑战

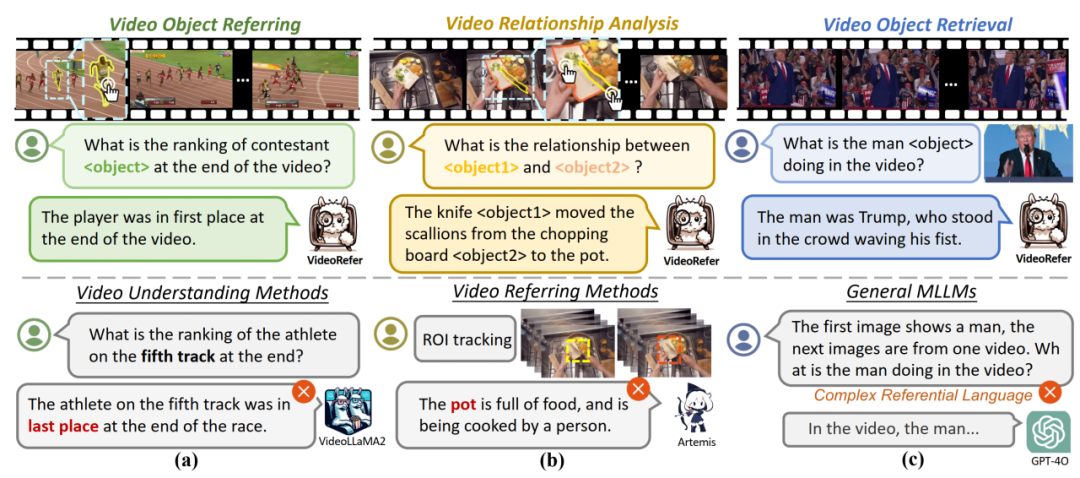

近年来,视频理解多模态大模型技术取得了突破性进展,以Qwen-VL系列和VideoLLaMA系列为代表的模型,在各类基准测试中展现出卓越的性能。这些模型虽然能够实现粗粒度的全局场景理解,但在处理细粒度的视频内容分析时仍存在明显局限。例如,在足球比赛视频中,当需要聚焦分析特定运动员的技术动作或得分情况时,或需要理解多个物体间的交互关系时,现有视频大模型的表现仍不尽如人意。

当前技术方案主要存在两类替代路径:一方面,基于静态图像的区域理解模型(如Osprey、Ferret等)虽然实现了细粒度的图像区域分析,但由于缺乏时序建模能力,难以直接迁移到动态视频场景;另一方面,基于目标跟踪的模型(如Artemis)仅支持单物体的框级特征提取,无法满足多物体关系分析、问答和复杂推理的需求。

综合来看,现有视频大模型(Video LLMs)在细粒度时空理解方面存在三大核心缺陷:

1、空间感知局限:难以精确解析用户指定的特定物体状态(如"图1-a中第五赛道运动员的最终排名");

2、时序建模不足:缺乏对物体跨帧运动轨迹和交互关系的建模能力(如"图1-b中刀具与砧板间的相对位移关系");

3、交互方式受限:依赖文本描述输入或外部物体跟踪器,无法灵活支持任意形状物体和任意时间点的交互式指定。

图 1 现有方法存在的挑战与本文提出的方法典型对比

本研究工作核心贡献:

为此,本文系统性地设计VideoRefer Suite,其包含三块核心内容:

(1)VideoRefer-700K数据集

通过引入多智能体数据引擎,构建高质量物体级视频指令数据集 VideoRefer-700K(70万条),该数据集覆盖物体级的基础描述、复杂推理、未来预测三大任务。

(2)VideoRefer模型架构

-

提出 VideoRefer 模型,核心为时空双编码器:

a、Spatial Token Extractor:支持任意形状/时间点的物体掩码输入。

b、Temporal Token Merge Module:自适应融合跨帧信息,捕捉物体运动与关系。

-

无缝兼容SAM 2:用户点击视频中的任意物体,模型即时理解其状态与行为。

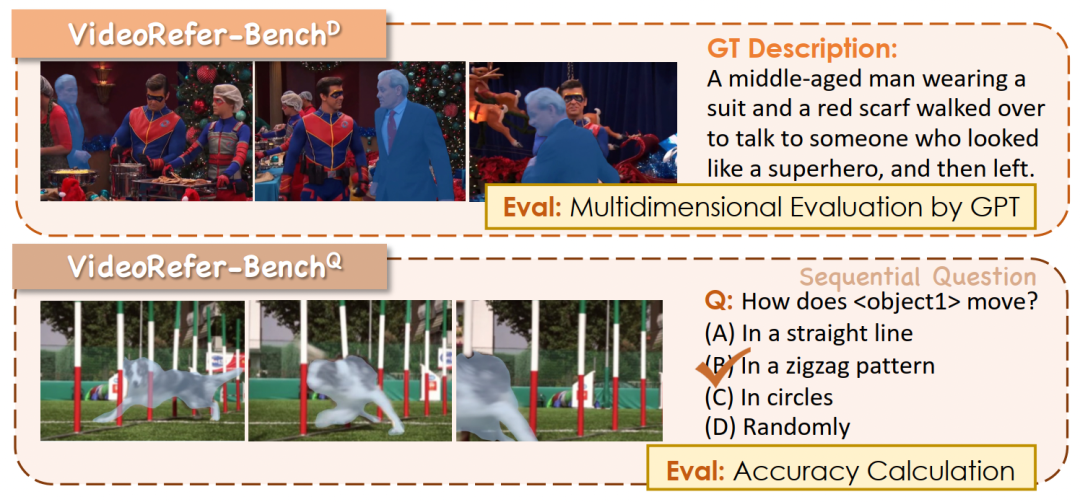

(3)VideoRefer-Bench评测体系:

-

提出首个细粒度视频理解评测集 VideoRefer-Bench:

a、

:评估4类描述生成能力;

b、

:检验5维问题推理能力;

-

全面考察模型在跨时间点、多物体关系、未来预测等场景的表现。

VideoRefer Suite

2.1 VideoRefer-700K数据集

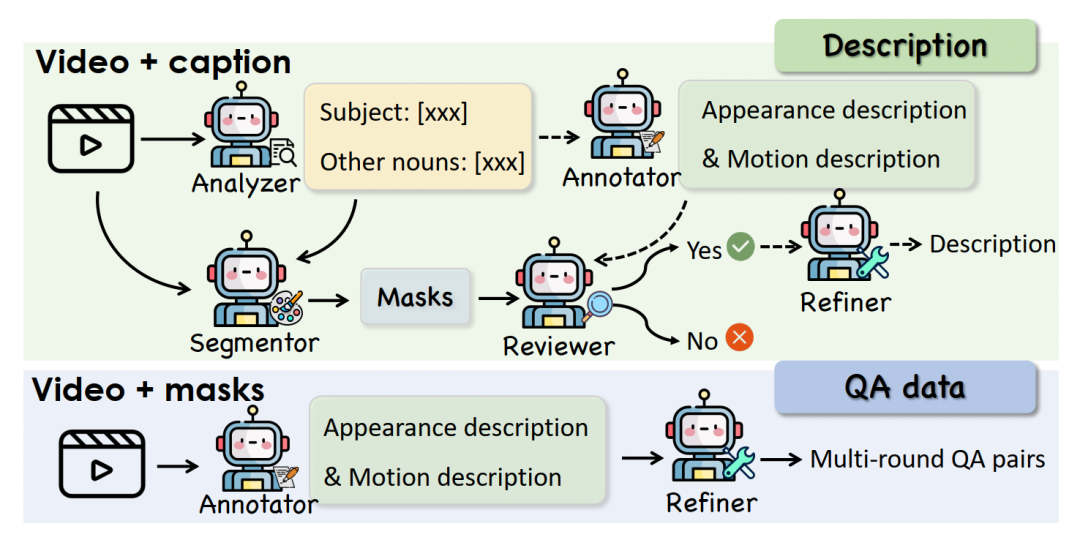

团队开发了一个自动化的多智能体数据引擎,用以创建VideoRefer-700K—一个大规模且高质量的对象级视频指令跟随数据集。具体而言,调用在描述生成、检测、分割与摘要等任务中表现优异的现成专家模型作为协作智能体,精心构建多样化的对象级指令数据。

如下图所示,数据构建流程包含五个核心组件:名词提取分析器(Analyzer);对象级描述生成标注器(Annotator);掩码生成分割器(Segmentor);标注审核器(Reviewer);以及摘要提炼优化器(Refiner)。这套多智能体数据引擎能有效剔除噪声或无关内容,确保数据的精确性与关联性。

图 2 本文提出的多智能体数据引擎

通过运用该多智能体数据引擎,我们精心构建两种对象级视频指令数据:

Description:详细描与简短描述,对物体的外观、运动等时间与空间信息进行细粒度描述,产生高质量的描述,共计62.5万组问答对。

QA Data:多轮问答对,其中包括基于区域的问答数据,包含三种类型的问题

(1)基础问题:涵盖对象类型、属性、动作、位置及时序交互;

(2)推理问题:需结合背景知识进行事件推理解释,不依赖具体视觉细节;

(3)未来预测:要求推测给定对象相关的未来动作或事件。该数据类型共计7.5万组问答对。

2.2 VideoRefer 模型框架

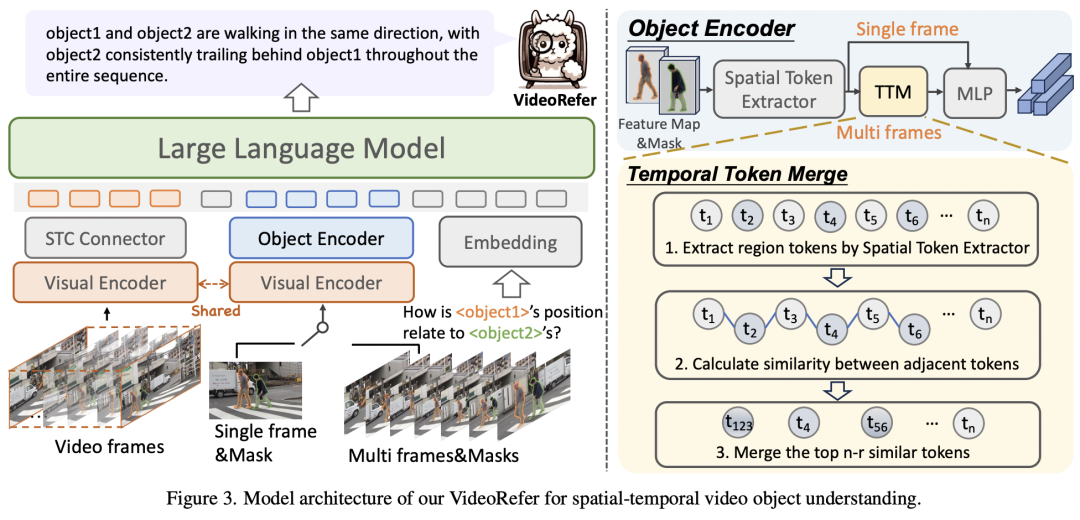

为实现对给定视频中任意区域、任意时间点的细粒度掩码级理解, 本研究工作引入VideoRefer框架。鉴于当前Video LLM已具备强大的通用场景级视频理解能力,团队在模型VideoLLaMA2.1基础上进行开发。核心创新在于引入通用统一的时空对象编码器,以获取跨视频场景的对象级表征。

图 3 VideoRefer模型框架

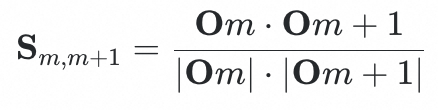

如图3所示,VideoRefer采用视觉编码器和STC连接器编码全局场景级视觉表征,预训练文本分词器捕获语言嵌入,指令跟随LLM进行语言解码。为实现视频指代理解,本研究工作提出通用统一的时空编码器

来生成对象级表征。

对于特定对象

,定义

,其中每个

![]()

为适应自由输入区域的统一二维二值掩码M(区域内值为1,区域外为0)。对象集合

![]()

与共享视觉编码器提取的图像特征图

![]()

输入对象编码器

,生成增强后的对象级表征具体表达式为:

。最终,场景级token

、对象级token

输入到LLM 中,获取细粒度语义理解结果,具体表达如下:

。

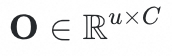

为支持多样化的时空视频理解任务,团队提出的时空编码器不仅能捕获单帧特定时间点的掩码级空间特征,还能聚合跨多帧的时序信息。为此,设计两种编码模式:单帧模式与多帧模式。为简明起见,以单个对象

为例(多对象时采用相同处理方式)。

单帧模式

输入为用户指定的随机单帧及其对应区域(

仅含单个时间戳)。通过设计的Spatial Token Extractor(空间表征提取器)生成对象级词元表征:

(1)共享视觉编码器提取图像特征

,其中

分别为特征图高/宽/维度;

(2)将对象二值掩码M缩放至特征图尺寸;

(3)对特征图执行掩码池化操作,提取对象级空间特征

;

(4)经MLP层适配,最终生成对象级词元

。

多帧模式

输入为视频中选定帧序列及其对应对象区域(

含多个时间戳)。通过 Temporal Token Merge module(时序表征合并模块)。

(1)共享视觉编码器提取多帧特征

![]()

,其中k为帧数;

(2)空间表征提取器逐帧生成对象词元

;

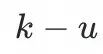

(4)计算相邻词元余弦相似度:

。

(5)选取Top

相似度对应的词元对进行合并。

(6)对每个合并簇执行平均池化,经MLP层生成u个时空融合词元

。

2.3 VideoRefer-Bench评估基准

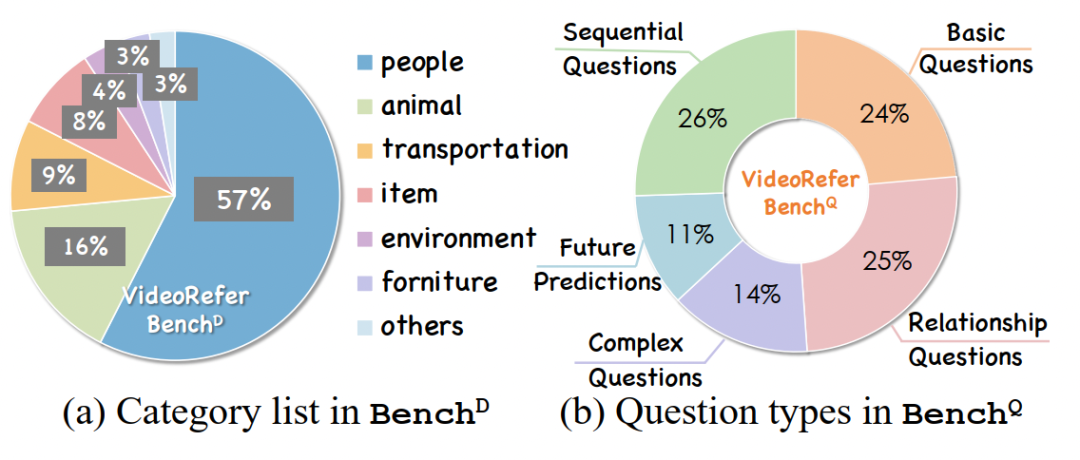

为全面评估模型在视频区域理解任务上的能力,我们开发了VideoRefer-Bench基准测试。该基准从两个核心维度进行评估:描述生成能力(对应

)和选择题问答能力(对应

)。图3与图4分别展示了测试样例可视化说明与数据特征。

图 4:VideoRefer-Bench示例说明.

-描述生成评估基准

该评估基准专门评估视频指代模型的描述生成性能。该子基准包含400条精选数据,其测试集基于Panda-70M构建,所述流程处理后经人工严格校验。我们开发了基于GPT-4o的自动化评估流程,从以下四个维度对模型生成结果进行0-5分制评分:

主体一致性(SC):评估生成描述的主体是否与真实标注严格对应;

外观描述(AD):检验物体外观视觉属性的描述准确性;

时序描述(TD):分析对象运动表征是否符合实际动态;

幻觉检测(HD):识别生成内容中是否存在虚构事实或错误推断;

-选择题推理评估基准

该基准用于评估多模态大模型(MLLMs)的视频对象解析能力。我们从DAVIS-2017、MeiViS等数据集精选198个视频,并由视觉语言学习领域专家标注1,000道高质量选择题。这些问题涵盖以下理解维度:

基础问题:对象基本属性识别;

时序问题:跨帧动态变化理解;

关系问题:对象间交互关系分析;

推理问题:需结合常识的深层推理;

未来预测:对象行为趋势推测。

所有问题均强制要求与特定视频区域绑定,确保模型必须通过实际分析目标对象才能作答,避免投机行为。

图4:VideoRefer-Bench的数据特性.

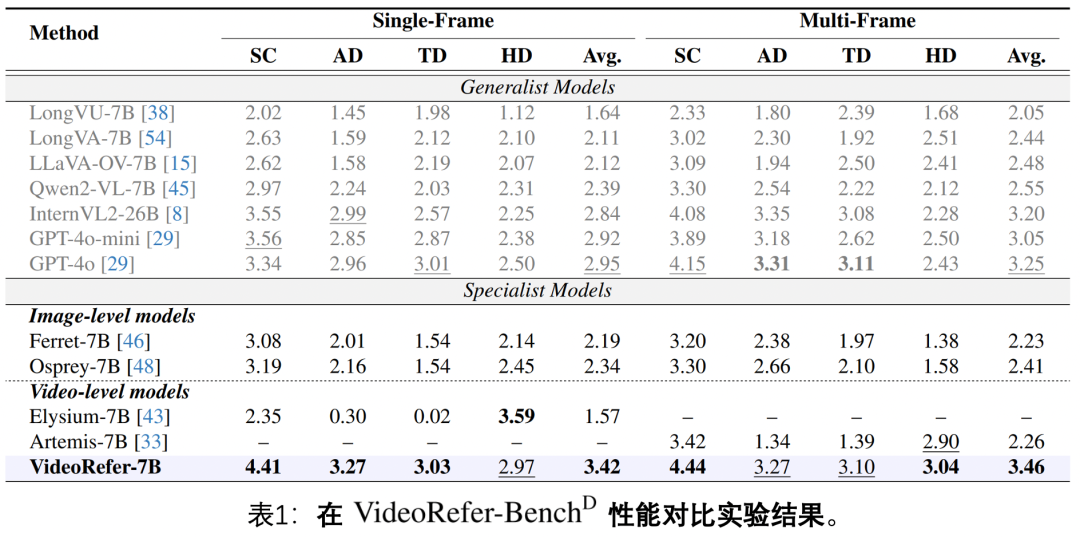

性能表现

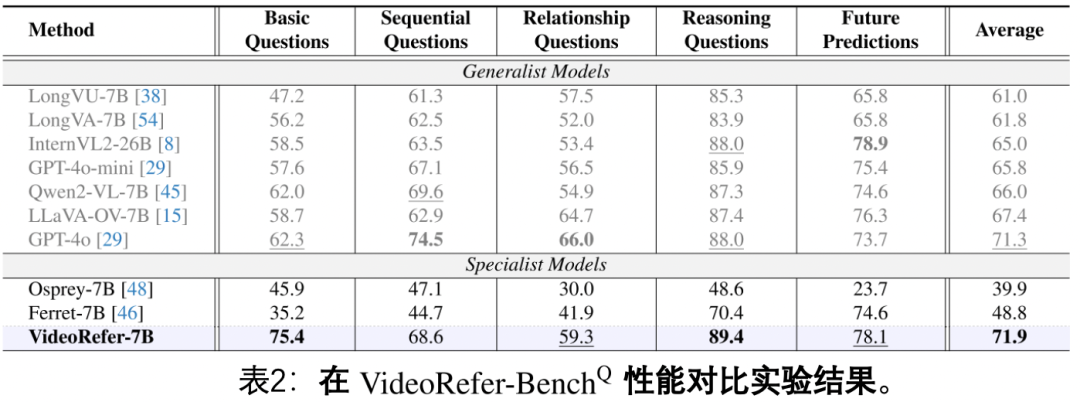

对多种视频理解模型进行了对比分析,包括通用视频理解模型(Generalist Model)、区域理解模型(Specialist Model),例如图像级的Ferret和Osprey,以及视频级的Elysium和Artemis。所有模型均在

和

两个基准测试平台上进行了全面的测试与评估。

对于通用模型,由于其本身并不直接兼容该任务,因此研究团队通过在原始视频帧上叠加透明掩膜(mask)的方式,实现了对目标物体的标记功能。而对于区域理解模型中的视频级模型Elysium和Artemis,由于它们缺乏问答能力,因此无法在

上提供有效的实验结果。

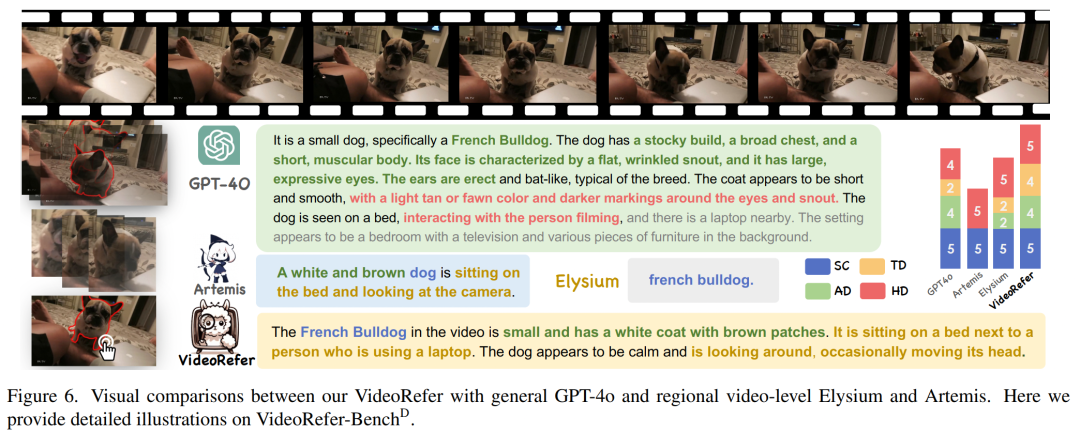

可以看出,在

子基准测试中,本研究的工作表现出色,在大多数关键指标上均取得了最优结果。具体而言,在single-frame模式下,本研究在主体一致性(SC)、外观描述(AD)和时序描述(TD)等指标上均达到了最佳表现;在multi-frame模式下,主体一致性(SC)和幻觉检测(HD)等指标也表现出色。此外,本研究在两种模式下的平均性能均达到了最优水平。图5展示了具体的典型测试样本分数计算对比,进一步验证了本研究方法的有效性。

图5 典型测试样本模型回答比较

在

基准测试中,本研究工作在基础问题和推理问题上均展现出卓越的性能,优于所有其他模型,取得了最优结果。在关系问题上,本研究位列第二,次于通用模型GPT-4o,后者在该任务上表现最佳;在未来预测问题上,本研究同样位居第二,通用模型InternVL2-26B在此任务上排名第一。

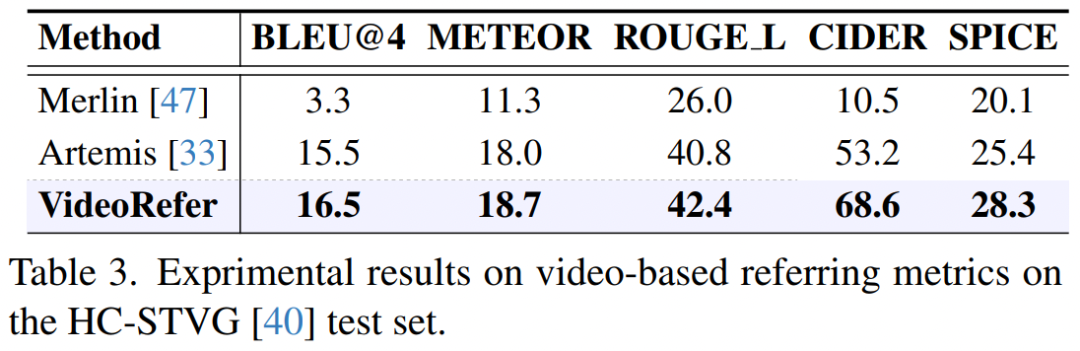

传统视频区域理解指标的验证

为了进一步验证方法的有效性,本文在传统视频区域理解领域常用的指标上进行了验证,包括BLEU@4、METEOR和ROUGE-L等。具体验证所采用的数据集为HC-STVG 的测试集。

表3: 在传统视频区域理解指标的对比实验结果

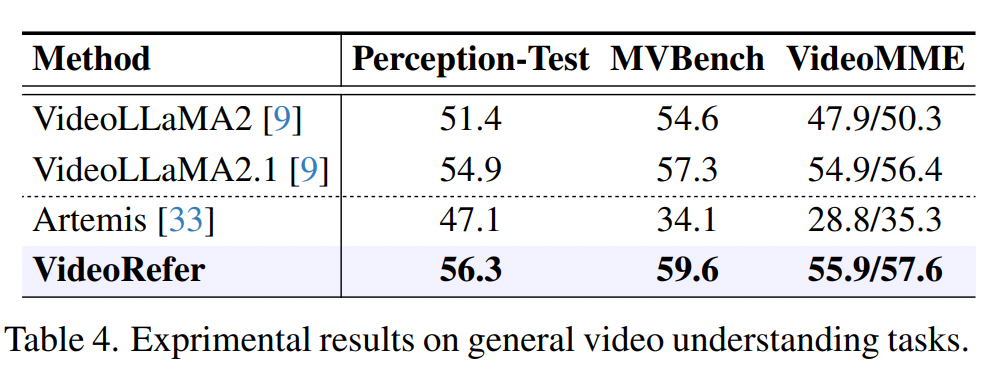

有利于通用视频能力的提升

本研究基于VideoLLaMA2.1框架进行方法开发,并针对通用视频理解任务的指标体系进行了系统性测试与验证。实验结果显示,VideoRefer在各项指标上均实现了显著的性能提升。这一结果表明,细粒度的区域理解能力对于提升场景级通用视频理解能力具有重要价值。

表4:在通用视频理解指标上的实验对比结果

详细的消融实验的结果,请参考我们的论文。

后续工作方向

(1)模型架构升级与性能优化

基于更强的通用视频理解框架,重点突破以下技术方向:

-

开发新型跨模态注意力机制,增强时空特征融合能力

-

设计动态自适应token压缩算法,提升长视频处理效率

-

引入因果推理模块,强化时序逻辑理解能力

(2)下一代数据集构建

进一步打造超大规模数据集,包含多样化的场景和时空掩码。

本研究路线将系统性地推进细粒度视频理解技术的研究,为构建新一代视频智能分析基础设施提供关键技术支撑。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献120条内容

已为社区贡献120条内容

所有评论(0)