统计学_一元线性回归知识点梳理

1 变量间关系的度量1 变量间关系的度量1.1 变量间的关系相关关系农作物产量施肥量函数关系y 完全依赖于 x1.2 相关关系的描述和测度相关分析就是对两个变量线性关系是否存在关系怎样的关系关系强度能否代表总体为了解决上述的四个问题,我们给出以下2个假定线性关系随机变量方法一:绘制散点图方法二:相关系数:相关系数是根据样本数据计算的,用来度量两个变量之间线性关系的一种。总体全部数据总体相关系数样本

1 变量间关系的度量

1.1 变量间的关系

- (1)相关关系:变量之间是不确定的数量关系,比如农作物产量和施肥量的关系。

- (2)函数关系:变量之间是一一确定的对应的关系,y 完全依赖于 x。

1.2 相关关系的描述和测度

相关分析就是对两个变量线性关系的描述和度量,我们需要讨论和解决的问题包括:

- (1)变量之间是否存在关系?

- (2)如果存在关系,他们之间是怎样的关系?

- (3)变量之间的关系强度如何?

- (4)样本所反映的变量之间的关系能否代表总体变量之间的关系?

为了解决上述的四个问题,我们给出以下2个假定:

- (1) 两个变量之间是线性关系;

- (2) 两个变量都是随机变量。

方法一:绘制散点图

方法二:相关系数:

相关系数 是根据 样本数据 计算的,用来度量两个变量之间 线性关系 的一种强统计量。

- 若相关系数是根据 总体全部数据 计算的,则称为:总体相关系数;

- 若是根据 样本数据 计算的,则称为:样本相关系数。

它的计算公式(Pearson 相关系数)是:

Person相关系数的性质:

(1)rrr 的取值范围是 [−1,1][-1, 1][−1,1],即 −1≤r≤1-1 \leq r \leq 1−1≤r≤1。

① 若 0<r≤10 < r \leq 10<r≤1,说明 xxx 与 yyy 之间存在 正线性相关关系;

② 若 −1≤r<0-1 \leq r < 0−1≤r<0,说明 xxx 与 yyy 之间存在 负线性相关关系;

③ 若 r=1r = 1r=1,说明 xxx 与 yyy 之间为 完全正线性相关关系;

④ 若 r=−1r = -1r=−1,说明 xxx 与 yyy 之间为 完全负线性相关关系。

可见,当 ∣r∣=1|r| = 1∣r∣=1 时,yyy 的取值完全依赖于 xxx,二者之间为 函数关系;

当 r=0r = 0r=0 时,yyy 的取值与 xxx 无关,二者之间不存在线性相关关系。

(2)rrr具有对称性,xxx与yyy之间的相关系数rxyr_{xy}rxy与yyy与xxx之间的相关系数ryxr_{yx}ryx是相等的。

(3) rrr的数值大小与xxx和yyy的原点及尺度无关。

(4) rrr只能用于描述线性关系,不能用于描述非线性关系。 当两个随机变量的rxy=0r_{xy}=0rxy=0时,只能说明这两个变量没有线性关系,但我们并不确定它是否具有非非线性关系。

(5)rrr 虽然是两个变量之间线性关系的一个度量,却不意味着 xxx 与 yyy 一定有因果关系。

相关程度的强弱:

① 当 ∣r∣≥0.8|r| \geq 0.8∣r∣≥0.8 时,可视为高度相关;

② 0.5≤∣r∣<0.80.5 \leq |r| < 0.80.5≤∣r∣<0.8 时,可视为中度相关;

③ 0.3≤∣r∣<0.50.3 \leq |r| < 0.50.3≤∣r∣<0.5 时,可视为低度相关;

④ 当 ∣r∣<0.3|r| < 0.3∣r∣<0.3 时,说明两个变量之间的相关程度极弱,可视为不相关。

但这种解释必须建立在对相关系数的显著性进行检验的基础之上。

1.3 相关系数的显著性检验

由于我们关注的是 总体相关系数, 但是我们只能通过抽样得到 样本相关系数,

也就是说,是用 样本相关系数 去 估计总体相关系数。然而由于 抽样波动 的影响,比如:

①第一次抽样,得到样本相关系数r1r_{1}r1;

②第二次抽样,得到样本相关系数r2r_{2}r2;

③第kkk次抽样,得到样本相关系数rkr_{k}rk;

但是并不是每一次的样本相关系数都可以用来估计总体相关系数。因此,需要考察样本相关系数的可靠性,也就是显著性检验。

1.3.1 r的抽样分布

样本相关系数:rrr是一个统计量

总体相关系数:常数

(1)样本相关系数是用来估计总体相关系数;

(2)当样本容量较大、且总体服从正态分布的时,rrr的分布会接近正态分布。

(中心极限定理:无论总体分布是什么,只要我们取的样本足够大,样本均值(或某些统计量)的分布就会趋近于正态分布。))

(中心极限定理保证“最终能正态”,而总体正态能让“立刻就正态”。)

(4)当总体相关系数很小或接近0时,rrr的抽样分布越明显地趋于正态分布。同理,当总体相关系数接近111或−1-1−1的时候,rrr的抽样分布呈现一定的偏态。

1.3.2 r的显著性检验

采用费希尔提出的 t 检验。该检验可用于小样本,也可用于大样本。检验的具体步骤如下:

第 1 步:提出假设。

H0:ρ=0;H1:ρ≠0 H_0: \rho = 0;\quad H_1: \rho \ne 0 H0:ρ=0;H1:ρ=0

第 2 步:计算检验的统计量。

t=∣r∣n−21−r2∼t(n−2) t = |r| \sqrt{\frac{n - 2}{1 - r^2}} \sim t(n - 2) t=∣r∣1−r2n−2∼t(n−2)

第 3 步:进行决策。

根据给定的显著性水平 α\alphaα 和自由度 df=n−2df = n - 2df=n−2 查 t 分布表,得出 tα/2(n−2)t_{\alpha/2}(n-2)tα/2(n−2) 的临界值。若 ∣t∣>tα/2|t| > t_{\alpha/2}∣t∣>tα/2,则拒绝原假设 H0H_0H0,表明总体的两个变量之间存在显著的线性关系。

2 一元线性回归

2.1 3个知识点

2.1.1 回归模型

因变量yyy:被预测变量或被解释变量;

自变量xxx: 用来预测或解释因变量的一个或多个变量。

一元回归:只涉及一个自变量;

一元线性回归:

多元回归:涉及多个自变量;

多元线性回归:

细讲一元线性回归模型:

y=β0+β1x+ε y = \beta_0 + \beta_1 x + \varepsilon y=β0+β1x+ε

①y=β0+β1xy=\beta_0+\beta_1xy=β0+β1x: 反映由于xxx的变化引起的yyy的变化;

② ε\varepsilonε是误差项的随机变量,反映除了xxx和yyy之间的线性关系之外的随机因素对yyy的影响,是不能由xxx和yyy之间的线性关系所解释的变异性。

我们在学习这个模型的时候,做了如下的假定:

(1)yyy和xxx具有线性关系;

(2)在重复抽样中,自变量xxx的取值是固定的(假定为非随机的)。

基于以上假设,可以知道,对于任意一个给定的xxx值,y的取值都对应一个分布。

(3)误差项是一个期望为0的随机变量。

(4)对于所有的xxx值,ε\varepsilonε的方差σ2\sigma^2σ2都相同;

(5)误差项ε\varepsilonε是一个服从正态分布的随机变量且独立。

(3)(4)(5)可以总结为:

ε∼N(0,σ2) \varepsilon \sim \N(0, \sigma^2) ε∼N(0,σ2)

2.2.2 回归方程

对于一元线性回归,回归方程为:

E(y)=β0+β1x E(y)=\beta_0+\beta_1 x E(y)=β0+β1x

因为y=β0+β1x+εy=\beta_0+\beta_1 x+\varepsilony=β0+β1x+ε,两边取数学期望,就可以得到E(y)=β0+β1xE(y)=\beta_0+\beta_1 xE(y)=β0+β1x。

2.2.3 估计的回归方程

对于一元线性回归,估计的回归方程形式为:

y^=β^0+β^1x \hat{y} = \hat{\beta}_0 + \hat{\beta}_1 x y^=β^0+β^1x

式中,β^0\hat{\beta}_0β^0 是估计的回归直线在 yyy 轴上的截距;β^1\hat{\beta}_1β^1 是直线的斜率,表示 xxx 每变动一个单位,yyy 的平均变动值。

2.2 参数的最小二乘回归

对于第iii个xxx值,估计的回归方程可以表示为:

y^i=β^0+β1^ \hat{y}_i=\hat{\beta}_0+\hat{\beta_1} y^i=β^0+β1^

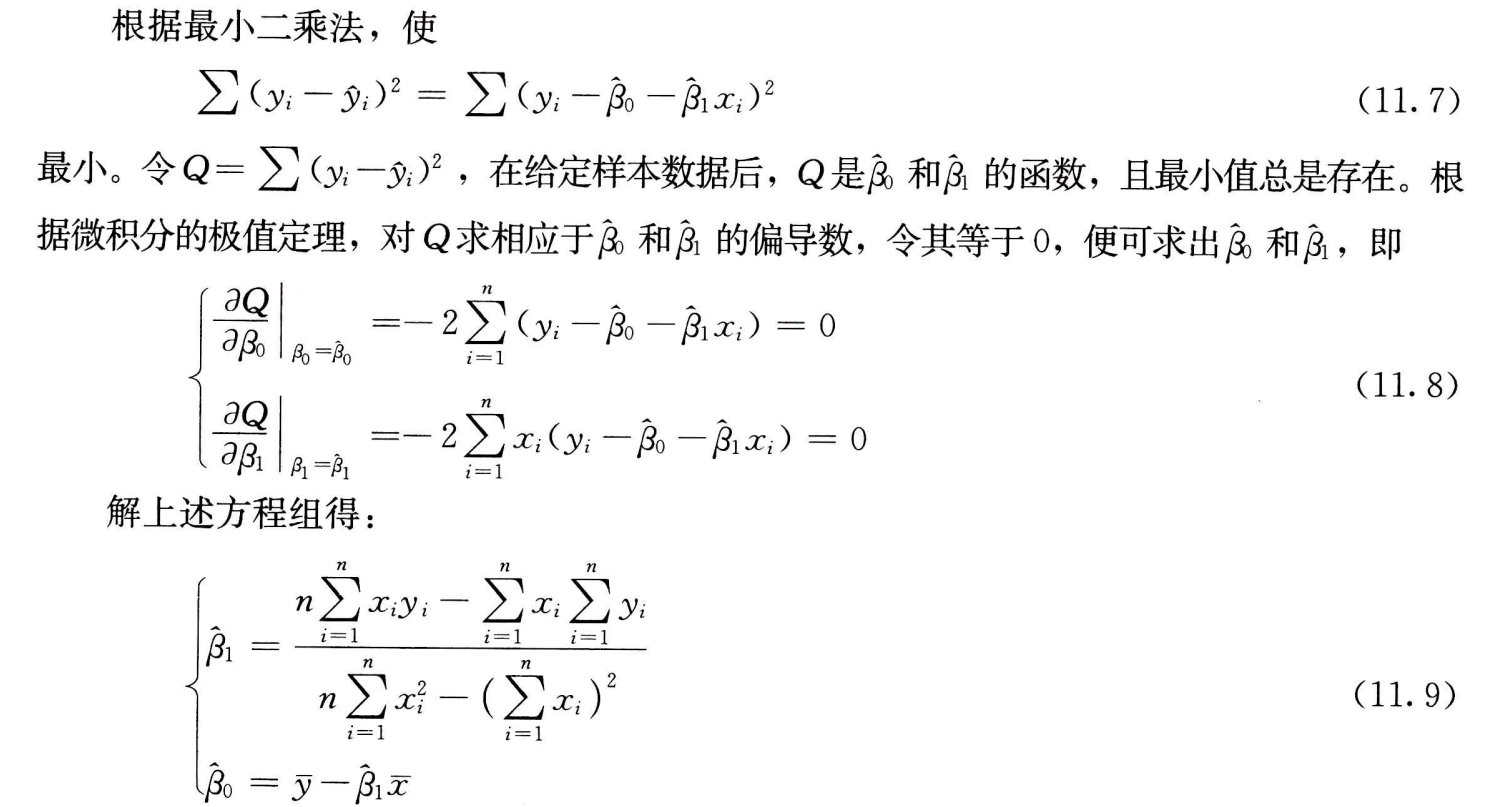

估计β^0\hat{\beta}_0β^0和β^1\hat{\beta}_1β^1的原理,最小二乘回归:

2.3 回归直线的拟合优度

回归直线与各观测点的接近程度称为回归直线对数据的拟合优度(goodness of fit)。

2.3.1 判定系数

- 判定系数 R2R^2R2 是对估计的回归方程拟合优度的度量。

- 因变量 yyy 的取值是不同的,yyy 的取值波动称为变差。变差的产生来自于两部分:

①由于自变量xxx的取值不同造成的;

②除了xxx以外的其他因素造成的。

(1) 总平方和(SST, Total Sum of Squares):衡量的是每个观测值 yiy_iyi 相对于均值 yˉ\bar{y}yˉ 的离散程度:

SST=∑(yi−yˉ)2 SST = \sum (y_i - \bar{y})^2 SST=∑(yi−yˉ)2

(2) 回归平方和(SSR, Regression Sum of Squares):也叫解释平方和,表示 xxx 对 yyy 的线性关系所能解释的部分变差:

SSR=∑(y^i−yˉ)2 SSR = \sum (\hat{y}_i - \bar{y})^2 SSR=∑(y^i−yˉ)2

(3) 残差平方和(SSE, Error Sum of Squares):也叫误差平方和,表示模型不能解释的变差,是 yiy_iyi 与 y^i\hat{y}_iy^i 的差异:

SSE=∑(yi−y^i)2 SSE = \sum (y_i - \hat{y}_i)^2 SSE=∑(yi−y^i)2

三者之间的关系是:

SST=SSR+SSE SST = SSR + SSE SST=SSR+SSE

判定系数 R2R^2R2的计算公式:

R2=SSRSST=1−SSESST R^2 = \frac{SSR}{SST} = 1 - \frac{SSE}{SST} R2=SSTSSR=1−SSTSSE

R2R^2R2的取值范围是[0,1][0,1][0,1],R2R^2R2越接近1,表明回归平方和占总平方和的比例就越大,回归直线与各观测点就越接近,用xxx的变化来解释yyy值变差的部分就会越多,回归直线的拟合程度就会越好。

2.3.2 估计的标准误差

残差平方和度量实际观测值yiy_iyi和回归估计值yi^\hat{y_i}yi^之间的差异程度。

估计的标准误差就是度量各实际观测点在直线周围的散布状况的一个统计量,它是均方残差(MSE)的平方根,用ses_ese来表示,计算公式为:

se=∑(yi−y^i)2n−2=SSEn−2=MSE s_e = \sqrt{ \frac{ \sum (y_i - \hat{y}_i)^2 }{ n - 2 } } = \sqrt{ \frac{SSE}{n - 2} } = \sqrt{MSE} se=n−2∑(yi−y^i)2=n−2SSE=MSE

2.4 显著性检验

2.4.1 线性关系的检验

线性关系的检验就是检验能否用一个线性模型y=β0+β1x+εy=\beta_0+\beta_1x+\varepsilony=β0+β1x+ε来表示。

检验过程如下:

第一步:提出假设。

H0:β0=0两个变量之间的线性关系不显著 H_0:\beta_0=0 \hspace{0.5cm} 两个变量之间的线性关系不显著 H0:β0=0两个变量之间的线性关系不显著

第二步:计算检验统计量。(服从F(1,n−2)F(1,n-2)F(1,n−2))

F=SSR/1SSE/(n−2)=MSRMSE F = \frac{\text{SSR}/1}{\text{SSE}/(n-2)} = \frac{\text{MSR}}{\text{MSE}} F=SSE/(n−2)SSR/1=MSEMSR

第三步:做出决策。

①如果F>FαF>F_\alphaF>Fα,拒绝H0H_0H0,表明两个变量之间的线性关系是显著的;

②如果F<FαF<F_\alphaF<Fα, 不拒绝H0H_0H0,没有证据表名两个变量之间的线性关系显著。

2.4.2 回归系数的检验

回归系数的检验是检验自变量对因变量的影响是否显著。

第一步:提出假设。

H0:β1=0; H1:β1≠0 H_0:\beta_1=0;\ H_1:\beta_1\neq0 H0:β1=0; H1:β1=0

第二步:计算检验统计量ttt。(服从t(n−2)t(n-2)t(n−2))

t=β^1sβ^1 t = \frac{\hat{\beta}_1}{s_{\hat{\beta}_1}} t=sβ^1β^1

第三步:做出决策。

①如果∣t∣>tα2\left| t \right|>t_\frac{\alpha}{2}∣t∣>t2α,则拒绝H0H_0H0,表明自变量xxx对因变量yyy的影响是显著的。

②如果∣t∣<tα2\left| t \right|<t_\frac{\alpha}{2}∣t∣<t2α,则不能拒绝H0H_0H0,没有证据表明自变量xxx对因变量yyy的影响是显著的。

2.5 回归分析的结果评价

(1)所估计的回归系数β^1\hat\beta_1β^1的符号是否与理论或则事先预期的相一致。

(2)如果理论上认为yyy与xxx之间的关系不仅是正的,而且是统计上显著的,那么所建立的回归方程也应该是这样。

(3)回归模型在多大程度上解释了因变量yyy取值的差异?

(4)考察关于误差项ε\varepsilonε的正态性假定是否成立。

注:关于误差项的正态性检验

3 利用回归方程进行预测

3.1 点估计

对于xxx的一个特定值x0x_0x0,求出yyy的一个估计值就是点估计。点估计可以分为两种:一是平均值的点估计,二是个别值的点估计。

(1)平均值的点估计:

E(y0)=β1x0+β0 E(y_0)=\beta_1x_0+\beta_0 E(y0)=β1x0+β0

(2) 个别值的点估计:

3.2 区间估计

比较难,不写了吧哈哈。

4 残差分析

可以基于残差分析检验ε\varepsilonε是否服从正态分布的假设。

4.1 残差和残差图

残差:ei=yi−yi^e_i=y_i-\hat{y_i}ei=yi−yi^

残差图:

标准化残差:

zei=yi−yi^se z_{e_i}=\frac{y_i-\hat{y_i}}{s_e} zei=seyi−yi^

如果标准化残差服从标准正态分布,根据3σ3\sigma3σ原则,大约有95%95\%95%的点在[−2,2][-2,2][−2,2]之间。如图所示:

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)