ONNX-MLIR:加速深度学习模型的编译基础设施

ONNX-MLIR:加速深度学习模型的编译基础设施ONNX-MLIR是一个由C++主导并融合了MLIR(Multi-Level Intermediate Representation)技术的开源项目,旨在实现Open Neural Network Exchange (ONNX)模型到高效执行代码的转换。此项目由一群致力于优化机器学习部署流程的开发者维护,它利用LLVM生态系统的力量,为AI模型提.

ONNX-MLIR:加速深度学习模型的编译基础设施

ONNX-MLIR是一个由C++主导并融合了MLIR(Multi-Level Intermediate Representation)技术的开源项目,旨在实现Open Neural Network Exchange (ONNX)模型到高效执行代码的转换。此项目由一群致力于优化机器学习部署流程的开发者维护,它利用LLVM生态系统的力量,为AI模型提供了从表示到编译的一站式解决方案。

核心功能:

ONNX-MLIR核心在于它的多功能性,能够将ONNX格式的模型转换成多种后端可执行形式,包括但不限于MLIR中间表示、LLVM IR、对象文件甚至共享库。这不仅提高了模型在不同平台上的可移植性,而且通过多个优化级别(O0至O3),确保了运行时的性能效率。项目内建了一个ONNX方言,允许其他项目集成,以及一个驱动程序来执行这种转换过程。此外,支持Python、C、C++乃至Java的运行环境,使得模型的部署更加灵活广泛。

编程语言及技术栈:

主要编程语言是C++,同时涉及到MLIR——一种由LLVM项目发展出来的强大的新中级表示。Python用于构建测试和辅助工具,确保项目的全面性和易用性。CMake作为构建系统确保跨平台兼容性,而整个项目高度依赖于现代软件工程的最佳实践,如Git签入要求遵循Developer Certificate of Origin (DCO)。

最近更新的功能:

虽然具体最近的更新详情未直接提供,但基于开源社区的动态,这类项目通常侧重于以下几个方面:增强对最新ONNX标准的支持、优化编译器性能以提升模型转换速度、增加对新型硬件架构的支持(例如IBM的Telum处理器)、以及提高多平台兼容性和稳定性。此外,持续的社区贡献可能还包括错误修复、文档改进和新的编译优化策略的实现。用户可通过查看项目的GitHub页面中的提交历史、issues和pull requests来获取最新的开发进展和技术细节。

ONNX-MLIR项目因其在简化AI模型部署、提升执行效率方面的卓越表现,已成为机器学习应用开发者不可或缺的工具之一,特别适合那些寻求高效且跨平台部署方案的团队和个人。

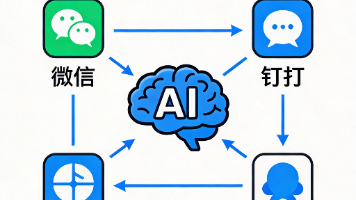

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

项目地址: https://gitcode.com/gh_mirrors/on/onnx-mlir

项目地址: https://gitcode.com/gh_mirrors/on/onnx-mlir

所有评论(0)