深度学习必读经典论文|ImageNet Classification with Deep Convolutional Neural Networks

这篇论文介绍了一种大型深度卷积神经网络(CNN),用于在ImageNet LSVRC-2010比赛中对1.2百万高分辨率图像进行分类,这些图像涵盖了1000个不同的类别。该网络在测试数据上实现了37.5%的top-1错误率和17.0%的top-5错误率,显著优于之前的最佳水平。网络包含6000万参数和650,000个神经元,由五个卷积层组成,其中一些后接最大池化层,以及三个全连接层,最后是一个10

论文标题

ImageNet Classification with Deep Convolutional Neural Networks

论文下载

ImageNet Classification with Deep Convolutional Neural Networks下载

论文作者

Alex Krizhevsky, Ilya Sutskever, Geoffrey E. Hinton

内容简介

这篇论文介绍了一种大型深度卷积神经网络(CNN),用于在ImageNet LSVRC-2010比赛中对1.2百万高分辨率图像进行分类,这些图像涵盖了1000个不同的类别。

该网络在测试数据上实现了37.5%的top-1错误率和17.0%的top-5错误率,显著优于之前的最佳水平。网络包含6000万参数和650,000个神经元,由五个卷积层组成,其中一些后接最大池化层,以及三个全连接层,最后是一个1000路softmax输出。

为了加快训练速度,作者使用了非饱和神经元和高效的GPU实现的卷积操作。为了减少全连接层的过拟合,他们采用了一种称为“dropout”的正则化方法。此外,他们还在ILSVRC-2012比赛中提交了这个模型的变体,并取得了15.3%的获胜top-5测试错误率。

方法分点说明

1.数据集和问题规模:

- 使用了ImageNet数据集,包含超过1500万个标记的高分辨率图像,分为约22,000个类别。

- 特别关注ILSVRC-2010和ILSVRC-2012子集,每个类别大约有1000张图像。

2.网络架构:

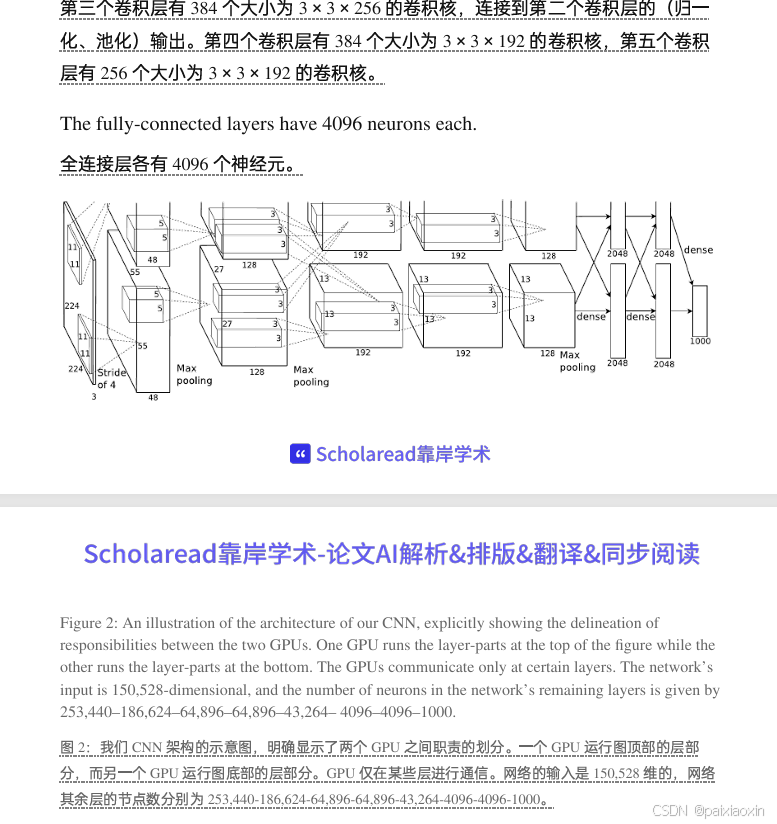

- 网络包含五个卷积层和三个全连接层,最终输出通过1000路softmax进行分类。

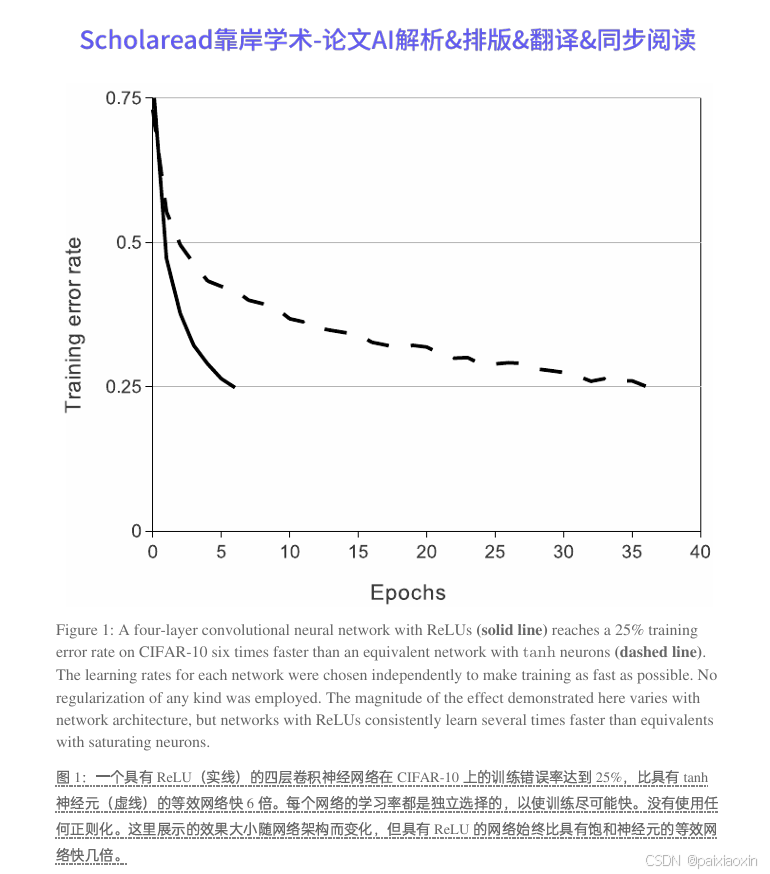

- 卷积层使用了非饱和的ReLU激活函数,以加快训练速度。

- 网络设计中包含了多个新颖或不寻常的特性,如局部响应归一化(Local Response Normalization)和重叠池化(Overlapping Pooling)。

3.训练加速和效率:

- 利用GPU进行卷积操作的高效实现,显著加快了训练速度。

- 通过在两个GPU上并行训练,解决了单个GPU内存限制的问题。

4.正则化技术:

- 为了减少过拟合,采用了“dropout”技术,即在训练过程中随机丢弃一部分神经元的输出。

- 还使用了数据增强技术,包括图像平移、水平反射和RGB通道强度的变化。

实验结果:

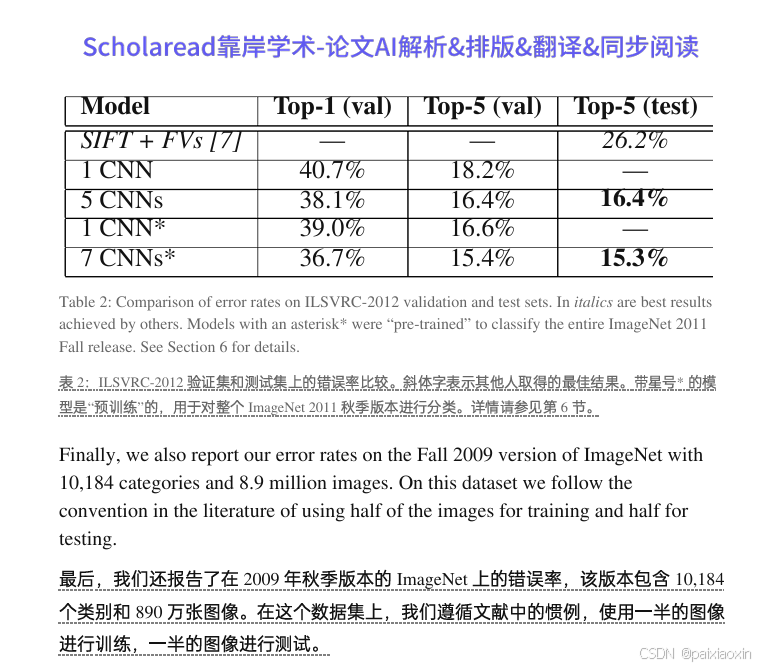

- 在ILSVRC-2010测试集上,网络实现了37.5%的top-1错误率和17.0%的top-5错误率。

- 在ILSVRC-2012比赛中,通过平均五个类似CNN的预测,错误率降低到了16.4%。

网络深度的重要性:

论文强调了网络深度对于性能的重要性,移除任何一个卷积层都会导致性能下降。

未来方向:

作者提出,尽管网络规模已经很大,但仍有潜力通过扩大网络规模和训练更长时间来进一步提升性能。

他们期望将来能够将这种大型深度CNN应用于视频序列,利用视频中的时间结构信息。

深度学习必读论文合集:

希望这些论文能帮到你!如果觉得有用,记得点赞关注哦~ 后续还会更新更多论文合集!!

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)