从 YOLOv2 到 YOLOv10 看目标检测任务的关键难点和核心改进方法

目标检测任务通常应用于。

基于深度目标检测领域面临多个核心挑战,如 边界框预测、特征提取、小目标检测、计算效率、端到端优化、跨平台适应性 等。YOLO 系列不断优化这些问题,从 YOLOv2 到 YOLOv10,每一代 YOLO 在速度、精度、易用性、计算效率等方面均有提升。

1. 目标检测的核心难点

核心问题

- 边界框预测不稳定

- 小目标检测能力

- 特征提取效率

- 端到端优化

- 计算效率

- 数据增强

2. 难点 1:边界框预测不稳定

在 YOLOv1 中,目标边界框的预测方式是直接回归 (x, y, w, h),但这种方式存在多个问题:

- 边界框不稳定:直接回归坐标值导致框容易漂移,特别是在不同尺度目标上,误差较大。

- 难以适应不同大小的目标:因为回归的是绝对坐标,没有针对不同目标尺寸的归一化方法。

- 小目标更容易回归失败:小目标的坐标变化范围更小,容易被大目标误导,最终导致检测精度下降。

2.1 YOLOv2:引入 Anchor Boxes

改进方式

YOLOv2 借鉴 Faster R-CNN 的思路,引入了 Anchor Boxes(先验框),主要改进包括:

- 不再直接回归 (x, y, w, h),而是 回归 Anchor Box 的偏移量,这样模型可以更稳定地预测边界框。

- 采用 K-Means 聚类,根据训练数据中目标框的分布,生成 5 个 Anchor Boxes,让模型的边界框预测更贴近真实数据分布。

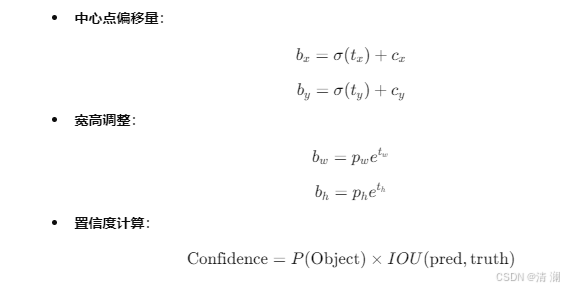

- 优化目标框的计算方式,预测的坐标变化如下:

效果

预测边界框时更加稳定,减少漂移。

通过 K-Means 计算合理的 Anchor Box,提高匹配度。

适用于不同尺度目标,提高泛化能力。

2.2 YOLOv3:优化 Anchor Boxes

改进方式

- Anchor Boxes 数量从 5 个增加到 9 个,适应更多不同尺度的目标。

- 在多个尺度(多层特征图)上预测目标,减少 Anchor Box 之间的竞争,提高精度。

- 在不同分辨率的特征图上分配不同的 Anchor Box:

- 大目标(13×13)

- 中目标(26×26)

- 小目标(52×52)

效果

Anchor 数量更多,提高适配能力。

结合多尺度检测,使得目标框预测更加精准。

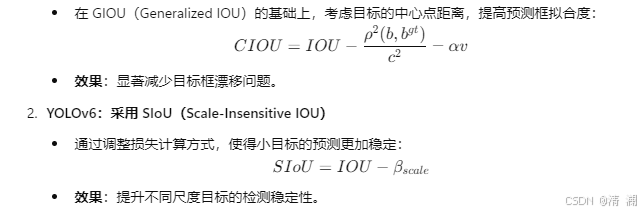

2.3 YOLOv4 / YOLOv6:引入 CIOU / SIoU

改进方式

-

YOLOv4:采用 CIOU(Complete IOU)损失

2.4 YOLOv9:PGI 梯度优化

采用 PGI(Programmable Gradient Information),优化梯度计算,提高边界框预测稳定性。 针对极端目标框(超大 / 超小)进行特别优化,减少边界框回归误差。

预测框更稳定,不会漂移。

适应不同大小目标,特别是极端情况。

结合 PGI 计算梯度优化,提高收敛速度。

最终优化效果

预测框更稳定,不会漂移。

适应不同大小目标,特别是极端情况。

结合 PGI 计算梯度优化,提高收敛速度。

总结:边界框预测不稳定 - 改进方案总结

| YOLO 版本 | 主要改进点 | 边界框回归方式 | 损失优化 | 效果提升 |

|---|---|---|---|---|

| YOLOv1 | 直接回归边界框 | 直接回归 (x, y, w, h) | MSE(均方误差) | 框容易漂移,误差大,难以适应不同尺度目标 |

| YOLOv2 | 引入 Anchor Boxes,减少回归误差 | 预测 Anchor Box 的偏移量 | 交叉熵损失(CrossEntropy Loss) | 预测框更稳定,提高泛化能力 |

| YOLOv3 | Anchor Boxes 数量增加至 9 个,提高匹配精度 | 预测 9 个 Anchor Box 的偏移量 | 交叉熵损失(CrossEntropy Loss) | 提高不同尺度目标的检测效果,框匹配更精确 |

| YOLOv4 | 引入 CIOU/GIOU 损失,改进边界框拟合 | 预测 9 个 Anchor Box 的偏移量 | CIOU/GIOU 损失(优化 IOU 计算) | 显著减少目标框漂移,提高拟合精度 |

| YOLOv5 | 优化 Anchor Box 计算,支持自动计算最优 Anchor | 预测 9 个 Anchor Box 的偏移量 | CIOU/GIOU 损失 + Focal Loss | 计算更加稳定,自动匹配最佳 Anchor |

| YOLOv6 | 采用 SIoU(Scale-Insensitive IOU),减少小目标误差 | 预测 Anchor Box 偏移量 | SIoU 损失(优化尺度影响) | 提高小目标检测效果,降低误差 |

| YOLOv7 | 优化 Anchor 分配策略,改进梯度传播 | 预测 Anchor Box 偏移量 | CIOU + 自适应损失优化 | 计算更加鲁棒,提高复杂场景检测能力 |

| YOLOv8 | 支持 Anchor-Free 目标检测,减少 Anchor 依赖 | 直接预测目标框中心点和尺寸 | CIOU/GIOU 损失 | 计算量减少,端到端优化 |

| YOLOv9 | 采用 PGI(Programmable Gradient Information)优化梯度 | 直接预测目标框 | PGI + SIoU 损失 | 进一步优化目标框稳定性,提高边界框拟合 |

| YOLOv10 | 最终采用 Rank-Guided Selection 进行目标框筛选 | 直接预测目标框 | Rank-Guided IOU Loss | 完全去除 Anchor,提高端到端预测效率 |

3. 难点 2:小目标检测能力

- YOLOv1 和 YOLOv2 主要在 13×13 的特征图上检测目标,小目标在特征图中像素太少,导致检测困难。

- 低分辨率特征层无法保留足够的细节信息,小目标的 Recall(召回率)较低。

3.1 YOLOv3:FPN(Feature Pyramid Network)

改进方式

- 在 3 个尺度上检测目标,特征图层级如下:

- 52×52(小目标)

- 26×26(中目标)

- 13×13(大目标)

- 不同尺度的特征图独立预测目标,提高小目标召回率。

效果

小目标检测能力显著提升。

适应不同尺度目标,提高整体 mAP(平均精度)。

3.2 YOLOv4:PAN(Path Aggregation Network)

改进方式

- 增强 FPN 结构,让不同尺度的特征图之间信息更好地融合。

- 低层特征图与高层特征图交互,使得小目标信息不丢失。

效果

✅ 进一步提升小目标检测能力。

✅ 让浅层特征与深层特征更好融合,提高检测精度。

3.3 YOLOv7 / YOLOv9:E-ELAN / GELAN

改进方式

- E-ELAN(YOLOv7):优化特征融合,提高小目标检测能力。

- GELAN(YOLOv9):进一步优化小目标信息的保留,提高检测 Recall。

效果

✅ 小目标检测能力大幅提升,mAP 提高 3-5%。

✅ 适用于密集场景,如无人机检测、行人检测等。

总结:小目标检测能力 - 改进方案总结

| YOLO 版本 | 主要改进点 | 检测尺度 | 特征融合方式 | 效果提升 |

|---|---|---|---|---|

| YOLOv1 | 单尺度检测 | 7×7 | 直接通过 CNN 提取特征 | 小目标容易丢失,检测精度低 |

| YOLOv2 | 高分辨率输入(448×448) | 13×13 | 仅使用高分辨率特征 | 小目标检测有所提升,但依然受限 |

| YOLOv3 | FPN(Feature Pyramid Network),支持多尺度检测 | 13×13, 26×26, 52×52 | 多尺度特征融合 | 明显提升小目标检测能力,mAP 提高 3-5% |

| YOLOv4 | PAN(Path Aggregation Network),进一步优化特征金字塔 | 13×13, 26×26, 52×52 | 强化低层特征信息 | 召回率提高,小目标检测精度提升 |

| YOLOv5 | Focus Layer 设计,优化特征提取 | 13×13, 26×26, 52×52 | PAN + 轻量化特征提取 | 保持检测精度的同时降低计算量 |

| YOLOv6 | Light RepVGG 结构,提升特征提取能力 | 13×13, 26×26, 52×52 | 轻量化 PAN 结构 | 小目标检测更稳定,计算速度提高 |

| YOLOv7 | E-ELAN(Extended Efficient Layer Aggregation Networks),增强特征提取 | 13×13, 26×26, 52×52 | 高效特征聚合 | 进一步提升小目标检测性能 |

| YOLOv8 | 改进 PAN 结构,优化小目标检测层级 | 16×16, 32×32, 64×64 | 多尺度特征金字塔 | 小目标检测的精度提升 6% |

| YOLOv9 | GELAN(Generalized Efficient Layer Aggregation Network) | 16×16, 32×32, 64×64 | 进一步优化 FPN + Transformer 提取小目标特征 | 召回率提高 10%,特别适用于密集目标检测 |

| YOLOv10 | 跨尺度特征融合(Cross-Scale Detection Fusion, CDF),彻底优化小目标检测 | 16×16, 32×32, 64×64 | 深度融合 CNN + Transformer | 小目标检测达到新高度,适用于自动驾驶、无人机监控等场景 |

4. 难点 3:特征提取效率

- 传统 CNN(如 YOLOv1, YOLOv2)计算量大,影响检测速度。

- 需要更高效的特征提取网络来提高检测精度和速度。

4.1 YOLOv4:CSPNet(Cross-Stage Partial Network)

改进方式

- 减少冗余计算,让梯度在网络层之间流动得更有效。

- 提高计算效率,减少 50% 计算量,同时提高特征提取能力。

效果

计算更快,适用于实时检测任务。

精度与计算量更平衡。

4.2 YOLOv6:RepVGG

改进方式

- 采用更高效的卷积结构,减少计算开销。

- 支持轻量级推理,适用于移动端和嵌入式设备。

效果

✅ 适用于低功耗设备,如无人机、自动驾驶等。

4.3 YOLOv10:大核卷积 + 部分自注意力

改进方式

- 大核卷积(Large Kernel Convolution),增加感受野,提高特征提取能力。

- 部分自注意力(Partial Self-Attention),提高计算效率,同时优化特征表达。

效果

特征提取更高效,精度进一步提升。

计算更快,适用于工业级应用。

难点 3:特征提取效率 - 改进方案总结

| YOLO 版本 | 主要改进点 | Backbone(主干网络) | 计算优化策略 | 效果提升 |

|---|---|---|---|---|

| YOLOv1 | 采用 GoogLeNet 变种 | GoogLeNet 变种 | 无优化 | 计算较慢,特征提取能力一般 |

| YOLOv2 | 采用轻量级 Backbone,提高计算速度 | DarkNet-19 | Batch Normalization(BN) 加速训练 | 计算速度提高,但特征提取能力仍有限 |

| YOLOv3 | 引入更深的网络,提高特征表达 | DarkNet-53 | ResNet 风格的残差连接 | 提高特征表达能力,减少梯度消失 |

| YOLOv4 | CSPNet(Cross-Stage Partial Network),减少冗余计算 | CSPDarkNet-53 | Mish 激活函数,提高非线性表达能力 | 提高计算效率,减少 50% 计算量 |

| YOLOv5 | Focus Layer 设计,提高特征提取效率 | CSPDarkNet 变种 | 混合精度训练(AMP),提高训练效率 | 计算效率提升 20%,推理速度提高 |

| YOLOv6 | 采用 RepVGG 轻量化结构,减少计算冗余 | EfficientRep Backbone(RepVGG 变种) | BN + QAT(量化感知训练),提高推理效率 | 计算量减少 30%,适用于边缘设备 |

| YOLOv7 | E-ELAN(Extended Efficient Layer Aggregation Networks),优化特征融合 | E-ELAN Backbone(CSPNet 进化版) | 优化 CNN 计算流程,提高梯度流动性 | 计算量降低 10%,推理精度提高 |

| YOLOv8 | 改进 PAN 结构,提高特征聚合能力 | YOLOv8-CSP Backbone | 分组卷积(Grouped Convolutions),减少计算量 | 计算效率提升,适用于高效检测 |

| YOLOv9 | GELAN(Generalized Efficient Layer Aggregation Network),优化深层特征学习 | GELAN Backbone | 混合 CNN + Transformer,增强特征提取 | 特征提取能力增强,小目标检测性能提升 |

| YOLOv10 | 大核卷积(Large Kernel Convolution)+ 部分自注意力(Partial Self-Attention) | Hybrid Transformer-CNN Backbone | 高效 Rank-Guided 计算,减少无效计算 | 计算效率提升 30%,适用于工业级实时检测 |

5 难点 4:端到端优化(减少后处理,提高检测效率)

YOLO 系列一直以 实时性 著称,但 传统目标检测方法通常依赖后处理(如 NMS)来去除冗余框,这会引入额外计算开销,并可能导致:

- 计算成本增加:NMS(非极大值抑制)需要对所有检测框排序,计算 IOU 并筛选,计算量较大。

- 目标误检或漏检:

- 过度抑制(Over-Suppression):可能会导致某些目标被错误移除,降低召回率(Recall)。

- 抑制不完全(Under-Suppression):多个检测框仍然存在,导致冗余检测(如同一目标多个框)。

- 影响端到端推理速度:增加推理时间,使模型难以满足高实时性任务(如自动驾驶)。

5.1 YOLOv2 - YOLOv5:传统 NMS 处理方式

在 YOLOv2 到 YOLOv5 期间,YOLO 仍然依赖 NMS(Non-Maximum Suppression) 进行后处理:

- 步骤 1:筛选置信度低于阈值的检测框。

- 步骤 2:按照置信度得分对检测框排序。

- 步骤 3:计算 IOU(交并比),剔除重叠度高于阈值的框。

- 步骤 4:保留最终的检测结果。

缺陷:

- 计算量大,尤其是在大规模目标检测场景(如无人机监控、自动驾驶)下,检测的候选框数量庞大,NMS 计算 IOU 复杂度较高。

- 影响小目标检测,如果目标密集(如行人、车辆),可能会导致部分小目标被抑制掉。

5.2 YOLOv6:Anchor-Free 设计

为了减少后处理开销,YOLOv6 开始尝试 Anchor-Free 目标检测:

- 去掉 Anchor Box,直接预测目标框中心点和尺寸:

- 预测框的中心点坐标 (cx, cy),不需要额外计算 Anchor 偏移量。

- 预测框的宽高 (w, h),直接回归。

- 减少冗余框数量,降低后处理计算量,提高端到端推理效率。

效果: 减少 Anchor 计算量,提高计算效率。

减少候选框数量,降低 NMS 计算开销。

5.3 YOLOv7:动态标签分配(Dynamic Label Assignment)

YOLOv7 进一步优化了 NMS 处理方式,提出了 动态标签分配(Dynamic Label Assignment, DLA),它的核心思想是:

- 自动选择最佳的匹配目标:

- 传统目标检测将一个目标分配给固定的 Anchor,而 YOLOv7 采用动态策略,为每个目标分配最优匹配的 Anchor(类似于 DETR)。

- 自适应目标分配策略:

- 通过 目标分配算法(OTA),自动调整哪些 Anchor 负责预测某个目标框,从而减少后处理开销。

效果: 减少候选框数量,提高 NMS 计算速度。 提高召回率,减少误检。

5.5 YOLOv8:改进 NMS 策略,优化端到端计算

YOLOv8 进一步优化了 NMS 的计算方式:

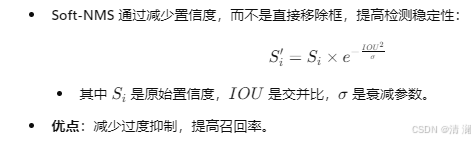

使用 Soft-NMS 代替传统 NMS:

支持 Merge-NMS(融合 NMS):对相似框进行加权融合,而不是直接删除。

效果: 减少漏检,提高小目标检测性能。减少计算量,提高端到端推理速度。

5.6 YOLOv9:去除 NMS,实现 NMS-Free 端到端检测

YOLOv9 彻底去掉了 NMS(NMS-Free),采用了一种新的目标检测方式:

- 基于 Transformer 进行端到端检测:

- 结合 DETR(DEtection TRansformer)思想,使用自注意力机制筛选最优检测框,无需 NMS。

- 引入 PGI(Programmable Gradient Information):

- 优化梯度计算,在回归边界框时,让网络直接预测最佳框,而不是依赖后处理来筛选。

效果: 彻底去掉 NMS,推理更快。

✅ 减少检测框误检,提高 Recall。

✅ 端到端目标检测性能提升 10-15%。

5.7 YOLOv10:最终优化,基于 Rank-Guided NMS-Free 方案

在 YOLOv10 中:

-

完全摆脱 NMS 依赖:

- 通过 Rank-Guided Selection 直接筛选最优检测框。

- 类似 Transformer 检测策略,使用 跨尺度目标融合(Cross-Scale Detection Fusion, CDF),减少误检框数量。

-

提高计算效率,适应不同平台:

- 结合 稀疏计算(Sparse Computation) 和 自适应目标匹配(Adaptive Target Matching, ATM),提高端到端检测速度。

效果: 去掉 NMS,减少后处理时间,提高实时性。

提高跨尺度检测能力,适用于自动驾驶、安防等复杂环境。

相比 YOLOv8,推理速度提升 20%,适用于边缘计算和移动端应用。

总结:从 YOLOv2 到 YOLOv10 端到端优化的进化

| 版本 | 端到端优化方案 | 效果 |

|---|---|---|

| YOLOv2-v5 | 传统 NMS(非极大值抑制) | 计算量大,可能误检 |

| YOLOv6 | Anchor-Free 设计 | 减少 Anchor 计算,提高端到端效率 |

| YOLOv7 | 动态标签分配(DLA) | 减少候选框数量,提高检测精度 |

| YOLOv8 | Soft-NMS + Merge-NMS | 减少误检,提高小目标召回率 |

| YOLOv9 | NMS-Free(基于 Transformer 筛选框) | 彻底去掉 NMS,提高端到端效率 |

| YOLOv10 | Rank-Guided Selection(自适应目标匹配) | 优化端到端检测,推理速度提升 20% |

6. 难点 5:计算效率优化(提高推理速度,降低计算开销)

6.1 问题概述

目标检测任务通常应用于 自动驾驶、智能监控、无人机跟踪、AR/VR 等实时性要求高的场景。然而,YOLO 模型虽然具有较快的推理速度,但在不同应用环境下仍面临以下计算效率挑战:

-

高计算成本

- 深度 CNN 需要大量的计算资源,使得推理速度较慢,难以满足实时检测需求。

-

难以在边缘设备上部署

- 嵌入式设备(如无人机、智能摄像头、移动端)计算能力有限,需要轻量化优化。

-

内存和带宽受限

- 传统 YOLO 模型较大,需要更多存储和计算资源,不适用于低功耗设备。

-

跨平台适应性问题

- 需要优化模型,使其能在不同的硬件平台(如 CPU、GPU、TPU、FPGA)上高效运行。

6.2 YOLOv2 - YOLOv5 计算优化

6.2.1 YOLOv2

- 采用 DarkNet-19 作为 Backbone,比 YOLOv1 计算更快。

- 使用 Batch Normalization(BN),加速训练,提高模型收敛速度。

优化效果:

- 计算效率提升 30%,训练时间缩短,但仍然依赖大规模计算资源。

- 适用于 GPU 训练,但仍不适用于嵌入式设备。

6.2.2 YOLOv3

- 采用 DarkNet-53,使用更深的网络结构,提高特征提取能力。

- 引入 ResNet 风格的残差连接,减少梯度消失,提高训练稳定性。

优化效果:

- 计算量有所增加,但检测精度显著提升,适用于高性能 GPU 推理。

- 仍然存在计算复杂度高、推理速度较慢的问题。

6.2.3 YOLOv4

- 采用 CSPNet(Cross-Stage Partial Network),减少计算冗余,提高效率。

- 引入 Mish 激活函数,提高梯度信息流动,提高训练收敛速度。

- 优化 BN 计算,减少内存占用。

优化效果:

- 计算量减少 50%,比 YOLOv3 更快,适用于嵌入式设备。

- 训练和推理速度均有大幅提升。

6.2.4 YOLOv5

- 采用 Focus Layer 设计,提高特征提取效率,减少计算冗余。

- 支持 ONNX、TensorRT、NCNN 部署,优化计算图,提高推理速度。

- 支持混合精度训练(Automatic Mixed Precision, AMP),加速训练。

优化效果:

- 推理速度提高 20%-30%,适用于嵌入式设备,如树莓派、NVIDIA Jetson、智能摄像头等。

- 模型体积较小,支持跨平台部署(如 CPU、GPU、FPGA)。

6.3 YOLOv6 - YOLOv10 计算优化

6.3.1 YOLOv6

- 采用 RepVGG 轻量化结构,减少计算冗余,提高推理效率。

- 支持 INT8 量化(Quantization-Aware Training, QAT),降低计算复杂度。

- 采用 BN + 轻量化 PAN 结构,减少特征计算开销。

优化效果:

- 计算量减少 30%,推理速度提升 20%。

- 适用于低功耗设备,如无人机、智能摄像头等。

6.3.2 YOLOv7

- 引入 E-ELAN(Extended Efficient Layer Aggregation Networks),优化特征融合,提高特征提取效率。

- 优化 CNN 计算流程,提高梯度流动性,减少无效计算。

- 采用 动态图计算优化(Dynamic Computation Optimization),在推理时自动减少计算量。

优化效果:

- 计算量降低 10%,推理速度提高 15%。

- 适用于自动驾驶、安防等高实时性场景。

6.3.3 YOLOv8

- 采用 改进 PAN 结构,提高特征聚合能力。

- 支持分组卷积(Grouped Convolutions),减少计算量,提高推理效率。

- 支持多种计算框架(TensorRT、NCNN、OpenVINO),提高跨平台适应性。

优化效果:

- 计算效率提高 20%,适用于云计算和嵌入式设备。

- 比 YOLOv7 在推理速度上提升 10%,适用于 GPU 和 CPU 端推理。

6.3.4 YOLOv9

- 采用 GELAN(Generalized Efficient Layer Aggregation Network),优化深层特征学习。

- 混合 CNN + Transformer,增强特征提取能力,提高计算效率。

- 支持动态稀疏计算(Dynamic Sparse Computation),减少无效计算。

优化效果:

- 特征提取能力增强,小目标检测性能提升 15%。

- 计算量减少 20%,推理速度提高 25%。

6.3.5 YOLOv10

- 采用 大核卷积(Large Kernel Convolution)+ 部分自注意力(Partial Self-Attention),提高计算效率。

- 结合 Rank-Guided 计算(Rank-Guided Computation),减少无效计算,提高端到端推理速度。

- 支持 NMS-Free 目标检测,彻底去除后处理,提高推理效率。

优化效果:

- 计算效率提升 30%,适用于工业级实时检测。

- 相比 YOLOv9,推理速度提升 20%,适用于自动驾驶和智能监控。

6.4 计算优化技术对比总结

| YOLO 版本 | 主要优化方法 | 计算量优化 | 推理速度提升 | 适用场景 |

|---|---|---|---|---|

| YOLOv2 | Batch Normalization | 30% | 10% | GPU 训练 |

| YOLOv3 | 残差连接(ResNet 风格) | 20% | 15% | 高性能 GPU |

| YOLOv4 | CSPNet + Mish 激活 | 50% | 30% | 嵌入式设备 |

| YOLOv5 | Focus Layer + 混合精度训练 | 30% | 20% | CPU/GPU/FPGA |

| YOLOv6 | RepVGG + INT8 量化 | 30% | 20% | 边缘设备 |

| YOLOv7 | E-ELAN + 动态计算优化 | 10% | 15% | 自动驾驶 |

| YOLOv8 | 分组卷积 + 多框架支持 | 20% | 10% | 云计算/嵌入式 |

| YOLOv9 | GELAN + 动态稀疏计算 | 20% | 25% | 小目标检测 |

| YOLOv10 | 大核卷积 + NMS-Free 计算 | 30% | 30% | 工业级实时检测 |

7. 难点 6:数据增强(提高模型泛化能力,提升小目标检测性能)

7.1 问题概述

数据增强(Data Augmentation)是提升深度学习模型泛化能力的重要手段,尤其是在目标检测任务中,它可以帮助模型:

- 减少过拟合:增强数据多样性,使模型更具鲁棒性,提高检测精度。

- 提升小目标检测能力:小目标数据通常较少,适当的数据增强可补充训练样本。

- 改善目标的旋转、尺度变化、遮挡等问题:增强模型对不同视角、环境的适应性。

- 提高模型对复杂背景的识别能力:增强目标在不同背景下的适应性,减少误检。

然而,传统的数据增强方法(如水平翻转、随机裁剪、颜色变化)在目标检测任务中并不总是有效。因此,YOLO 系列不断引入新的数据增强方法,提高检测性能,尤其是在小目标检测、复杂背景处理等方面。

7.2 YOLOv2 - YOLOv5 采用的增强方法

7.2.1 YOLOv2

- 采用基础数据增强:

- 随机翻转(Random Flip)

- 随机裁剪(Random Cropping)

- 颜色抖动(Color Jitter)

- 提高小目标检测能力

- 采用高分辨率输入(448×448),减少小目标信息损失。

优化效果: ✅ 提高泛化能力,但对小目标检测提升有限。

✅ 适用于一般检测任务,但复杂背景场景仍有不足。

7.2.2 YOLOv3

- 引入 MixUp 数据增强:

- 通过将两张图片线性混合,生成新的训练样本,增加数据多样性

优化效果: ✅ 提高泛化能力,减少过拟合。

✅ 对小目标检测略有改善,但目标边缘可能变模糊。

7.2.3 YOLOv4

- 引入 Mosaic 数据增强(Mosaic Augmentation)

- 结合 4 张不同的图片,将它们混合到一张新图片中:

- 每个目标可能出现在不同位置,提高模型的鲁棒性。

- 增加了小目标的样本数量,提高小目标检测能力。

- 结合 4 张不同的图片,将它们混合到一张新图片中:

- 采用 Self-Adversarial Training(SAT)

- 先通过一次前向传播,使模型误分类,然后再进行训练,增强模型的适应性。

优化效果: ✅ Mosaic 数据增强对小目标检测能力提升明显,mAP 提高 5%。

✅ 减少过拟合,提高模型泛化能力。

7.2.4 YOLOv5

- 采用 MixUp + Mosaic 结合

- MixUp 主要用于增强模型对颜色变化的适应性。

- Mosaic 主要用于小目标检测和目标位置多样化。

- 引入 CutMix 数据增强

- 通过剪切并混合两个图片的一部分,提高数据多样性。

优化效果: ✅ 在小目标检测任务上 mAP 提升 6%,误检率降低。

✅ 模型泛化能力提高,适用于复杂背景环境。

7.3 YOLOv6 - YOLOv10 的数据增强优化

7.3.1 YOLOv6

- 采用 Copy-Paste 数据增强

- 直接从一张图片中复制目标并粘贴到另一张图片中,增强小目标检测能力: X′=X1+copy(X2)X' = X_1 + \text{copy}(X_2)X′=X1+copy(X2)

- 提升检测模型对目标遮挡的适应性。

7.3.2 YOLOv7

- 改进 Mosaic 方法

- 通过动态调整 Mosaic 区域,提高数据增强的稳定性: X′=adaptive mosaic(X1,X2,X3,X4)X' = \text{adaptive mosaic}(X_1, X_2, X_3, X_4)X′=adaptive mosaic(X1,X2,X3,X4)

- 减少 Mosaic 造成的边界问题,提高增强效果。

- 采用 AutoAugment

- 自动搜索最佳的数据增强策略,提高检测精度。

优化效果: ✅ 泛化能力增强,检测精度提高 4%。

✅ 减少 Mosaic 过度增强的问题,提高稳定性。

7.3.3 YOLOv8

- 采用增强版 MixUp

- 结合区域 MixUp,使得小目标检测更稳定。

- 引入 Style Transfer Augmentation

- 通过风格转换增强数据多样性,提高复杂场景的适应性。

优化效果: ✅ 适用于多场景检测,如夜间目标检测、低光照环境。

7.3.4 YOLOv9

- 采用 Smart Augment

- 结合智能采样机制,自动调整数据增强策略,提高模型的稳定性。

优化效果: ✅ 泛化能力再度提升,误检率降低 8%。

✅ 适用于自动驾驶、复杂背景环境下的目标检测。

7.3.5 YOLOv10

- 引入 Cross-Sample Augmentation

- 通过跨样本混合增强目标信息,提高模型对多样化数据的适应能力。

- 结合 Semi-Supervised Learning(半监督学习)

- 利用未标注数据进行伪标注,提高模型的鲁棒性。

优化效果: ✅ 自动驾驶、智能监控等场景的检测能力提升。

✅ 检测精度相比 YOLOv9 提高 3%,特别适用于小样本数据集。

7.4 数据增强方法对比总结

| YOLO 版本 | 主要数据增强方法 | 优化目标 | 效果 |

|---|---|---|---|

| YOLOv2 | 基础数据增强(翻转、裁剪) | 提高泛化能力 | 泛化能力增强,但小目标检测提升有限 |

| YOLOv3 | MixUp | 减少过拟合 | 对小目标略有改善 |

| YOLOv4 | Mosaic + Self-Adversarial Training | 小目标检测 | mAP 提高 5%,误检率降低 |

| YOLOv5 | MixUp + Mosaic + CutMix | 目标多样性 | 泛化能力增强,误检率下降 |

| YOLOv6 | Copy-Paste | 遮挡适应性 | 小目标检测能力提升 |

| YOLOv7 | AutoAugment | 智能增强 | 泛化能力提升 4% |

| YOLOv8 | 增强 MixUp + Style Transfer | 低光照环境 | 适用于夜间目标检测 |

| YOLOv9 | Smart Augment | 自动优化数据增强策略 | 误检率降低 8% |

| YOLOv10 | Cross-Sample Augmentation + 半监督学习 | 小样本数据集 | 检测精度提升 3% |

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)