隐私计算整理

每种隐私计算路线各有优缺点,在不少场景中可以结合使用以扬长避短。结合(主要技术 + 辅助技术)代表优点分布式计算 + 密码学联邦学习采用MPC(包括同态加密)实现梯度的安全汇聚,各方的梯度不暴露给server,只暴露汇聚后的梯度。利用密码学技术减少联邦学习的中间信息泄露,提升隐私性。分布式计算 + 信息混淆脱敏联邦学习采用差分隐私保护梯度,只对server暴露加噪后的梯度。利用差分隐私减少联邦学习

隐私计算

目标:安全、隐私、监管合规前提下,解决数据孤岛,多方协同,释放数据要素价值

作用:数据要素流通融合中有效保护数据隐私的

涉及学科:密码学、安全硬件、信息论、分布式计算等多个学科

解读思路

介绍思路:性能、安全、隐私、功能、研发难度等多个角度分析对比各技术路线

四大路线原理:密码学、可信执行环境、信息混淆脱敏、分布式计算

代表技术:多方安全计算、差分隐私、匿名化、联邦学习等

优缺点对比

对比维度:计算、隐私保护维度、隐私保护强度、安全性、性能

| 路线 | 输入隐私 | 中间计算隐私 | 结果隐私 | 数据用法用量管控 | 结果管控 | 性能 | 主要优缺点 | 适合应用 |

|---|---|---|---|---|---|---|---|---|

| MPC | Y | Y | N | Y | Y | 低到中 | 优点:高安全、高隐私、高管控 缺点:性能挑战大;研发难度高 |

1. 外包计算 2. 联邦学习:梯度安全计算,减少信息泄露 |

| TEE | Y | Y | N | Y | Y | 高 | 优点:高隐私、高管控、高性能 缺点:依赖特定硬件和硬件厂商的可信度 |

1. 联合计算 2. 外包计算 |

| 混淆脱敏 | Y | Y | Y | N | N | 高 | 优点:高性能 缺点:低管控;难平衡隐私保护、数据可用性的矛盾 |

1. 数据发布 2. 联合计算:配合其他路线使用,减少结果泄露敏感信息 |

| 联邦学习/分割学习 | Y | N | N | Y | N | 中 | 优点:易开发实现,一般性能较高 缺点:结果管控弱,中间信息泄露且模型可公开给各参与方 |

联邦计算的联合建模及推理且模型可公开给各参与方 |

密码学路线

代表:多方安全计算MPC(secure Multi-Party Computation)

原理:在“密态”下进行数据的计算、检索等处理,这一过程中输入数据、中间结果处于密态不暴露,只输出最终结果。

可信执行环境路线

代表:TEE环境

原理:可信的软硬件,构建可信执行安全环境,数据在可信环境内执行可信的程序进行处理

信息混淆脱敏路线

代表:匿名化和差分隐私

原理:通过加噪、删除、泛化等信息处理手段对数据处理以减少或去除其中的敏感信息后再输出

分布式计算路线

代表:联邦学习FL(Federated Learning)和分割学习(Split Learning)

原理:计算任务原始数据不对外输出,只输出基于原始数据计算的中间结果

路线一:密码学

特点:

- 多方数据,各种计算

- 保护各方数据隐私

- 结果管控(如:控制只让指定放获取计算结果或者结果的一部分)

- 每次计算任务各方配合协作,控制数据用途、用量(几次计算、用了哪些字段),数据最小化是用原则,防止滥用非授权使用

性能挑战:

- 性能低(远低于TEE)

- 计算任务多时通常离线预计算,硬件加速等缩短MPC在线响应时间

- QPS/低响应复杂在线计算任务MPC难以满足,如:对于大型的DNN/CNN(机器学习,卷积神经网络)模型的MPC推理耗时为分钟级

安全挑战:

- 密码学提供了非常高的安全保障,但是MPC性能原因,大多数MPC协议采用的安全模型是弱化的(相对于身份认证、密钥协商等密码协议)

- 如:安全模型假设无合谋(参与方之间不会合谋以窃取其他方数据)、不偏离协议(每个参与方都忠实执行规定的MPC协议)

- 若无合谋假设不成立,则数据会泄露

- 若不偏离协议假设不成立,不少MPC协议也存在数据泄露风险。

- 注意:在应用MPC产品时,需注意其安全模型是否达到业务的要求,使用强安全模型的MPC协议。

- 解决办法:将MPC和TEE结合:各参与方将其MPC软件运行在其TEE中,通过TEE来保证不偏离协议和增大合谋攻击的难度。

功能挑战:

- 功能完备的MPC研发难度大

- 投入资源多

- 研发功能丰富高性能的分布式机器学习、数据分析产品已经挑战很大,研发基于MPC的密态机器学习、数据分析产品挑战更大

- 目前业内的大多MPC产品与传统的AI平台、数据库相比,功能还是欠缺很多,需要时间来完善。

路线二:可信执行环境

特点:

- 可信防篡改硬件构建安全环境

- 数据在可信环境里有可信程序(如只能合约)处理

- 具备一定抵抗外界窃取数据、篡改数据、篡改程序的能力

- 较为成熟的可信执行环境方案有SGX、Trustzone

优点:

- 支持任意计算逻辑

- 结果输出可控

- 数据用途用量控制

- 计算正确性校验

- TEE依赖于特定软硬件的安全性

- MPC依赖于密码算法的安全性。

- 性能远高MPC(原因:避免了复杂的密码学计算和协议)

- TEE隐私计算产品研发相比较容易

- 可结合机器学习、统计分析等软件适配到TEE下,实现隐私计算的机器学习、统计分析等。

缺点:

- 需要特定TEE硬件设备

- 依赖硬件产品的安全性(不存在安全漏洞,没留后门)

- 硬件安全性的检测通常难以进行

- 增强硬件安全的可信度的方法有TEE硬件国产化和权威机构检测。

路线三:信息混淆脱敏

特点:

- 匿名化和差分隐私

- 方法:加噪、删除、泛化等脱敏处理后输出

- 低成本

- 高性能

- 实现简易

优点:

- 在用途非常广、用量非常大的场景下,MPC或TEE使用成本高、权限管控太严,限制了数据的流通和利用。

- 而信息混淆脱敏路线具备低成本、高性能、实现简易的优势

缺点:

- 难平衡隐私保护和数据可用性的矛盾

- 混淆脱敏去除了部分信息(或降低了部分信息精度)

- 需要使用高精度的信息,就还需要采用MPC或TEE。

用途:

- 结合其他隐私技术路线(如MPC、TEE)用于联合计算,减少可从结果中得到敏感信息

- MPC、TEE可以保护输入数据、中间计算结果不泄露,计算结果包含敏感信息,可用信息混淆脱敏处理后再输出最终结果,或者对输入数据、中间结果应用信息混淆脱敏。

路线四:分布式计算

特点:

- 联邦学习、

- 分割学习

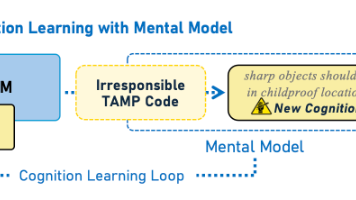

- 弱PPML(暴露中间计算结果的隐私保护机器学习PPML,联邦学习和分割学习为弱PPML特例)

- 大多分布式计算任务不需要各节点间交互原始输入数据,只需交互本地基于原始数据计算的中间结果

- 分布式计算大为减少了原始信息的泄露(相较于集中式计算方法)

- 但与MPC、TEE方式相比隐私保护弱,额外泄露了中间结果信息

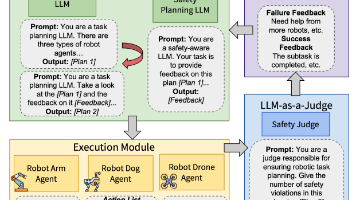

联邦学习示例

- 沿用了传统分布式机器学习的参数服务器-工作服务器架构

联邦学习典型架构(来自《Introduction to Federated Learning and Privacy Preservation》)

特点:

- 中心服务器作为参数服务器协调多个数据方的服务器(作为工作服务器)进行联合机器作为工作服务器学习训练,各工作服务器基于本地样本数据计算出的梯度信息交给参数服务器进行汇聚,参数服务器将最新迭代的模型参数下放给各工作服务器。

- 每个worker/数据方是一个独立的实体,各自持有自己的训练样本(全体样本的子集),而不是所有worker和样本属于同一机构,这一数据分布方式被称为数据水平分割(对应分割学习场景中常见的数据垂直分割)。这一架构缺乏对计算结果的管控,即任一参与方都能得到模型参数。

弱点:

- 计算中间信息(梯度)的泄露

- 有暴露原始数据敏感信息的风险

- 为了减少梯度信息泄露,联邦学习一般采用MPC或者差分隐私技术进行各方梯度的汇聚

- 两方联邦学习无法采用MPC减少信息泄露,因为任一方从两方梯度汇聚结果就能推出对方梯度,采用MPC进行梯度安全汇聚需要更多数据方才有意义

总结

每种隐私计算路线各有优缺点,在不少场景中可以结合使用以扬长避短。

| 结合(主要技术 + 辅助技术) | 代表 | 优点 |

|---|---|---|

| 分布式计算 + 密码学 | 联邦学习采用MPC(包括同态加密)实现梯度的安全汇聚,各方的梯度不暴露给server,只暴露汇聚后的梯度。 | 利用密码学技术减少联邦学习的中间信息泄露,提升隐私性。 |

| 分布式计算 + 信息混淆脱敏 | 联邦学习采用差分隐私保护梯度,只对server暴露加噪后的梯度。 | 利用差分隐私减少联邦学习的中间信息泄露,提升隐私性。 |

| 密码学 + 信息混淆脱敏 | 采用差分隐私技术保护MPC的计算结果。 | 减少计算结果泄露隐私信息,减少从计算结果能推出的原始数据信息。 |

| TEE + 信息混淆脱敏 | 采用差分隐私技术保护TEE的计算结果。 | 减少计算结果泄露隐私信息,减少从计算结果能推出的原始数据信息。 |

| 密码学 + TEE | MPC各参与方程序分别在各自TEE中执行。 | 采用性能较高的低安全模型的MPC协议(如,不抗偏离协议、共谋攻击);通过TEE来使各参与方难以发动偏离协议、共谋攻击,增强安全性。通过TEE来检测各参与方输入数据的合法性,防止恶意输入攻击。 |

| 分布式计算 + TEE | 联邦学习中心化server的程序在TEE中执行。 | 通过TEE防止各数据方的梯度及汇聚后梯度和模型暴露给server。 |

通用隐私计算产品,技术路线建议如下:

-

MPC、TEE双引擎

-

从计算类型丰富度出发,必然需要采用MPC或TEE技术路线以支持各种计算

-

MPC、TEE两者在安全和性能上各有权衡

-

理想的隐私计算产品应支持MPC、TEE双引擎,让用户能根据具体场景灵活选择引擎使用

-

分布式计算作为补充。在部分建模场合(模型无需管控、中间信息泄露可接受)可以采用联邦学习、分割学习、弱PPML作为补充,以提升性能;且联邦学习/分割学习采用MPC减少中间信息泄露。

-

信息脱敏混淆作为辅助。其中,最有代表性的是将差分隐私用于基于MPC/TEE的安全统计分析结果的保护,防止差分攻击。

-

安全计算平台以MPC、TEE为双引擎,并结合联邦学习、分割学习、差分隐私等多种隐私计算技术,并让用户能以同样的操作方式使用产品,做到使用操作与底层隐私计算技术无关

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)