2026年02月23日热门论文

Hugging Face最新研究呈现四大方向:1)大模型训练与推理优化,包括VESPO方法提升离线强化学习稳定性,以及探索推理模型隐式停止能力;2)虚实融合与具身智能,开发支持精细交互的视频世界模型和实时空间感知的数字人系统;3)多模态与视觉语言模型,提出视觉信息增益度量和构建DeepVision-103K数学数据集;4)机器人智能控制,研究端到端物体重排策略和平滑运动控制方法。这些研究体现了AI

Hugging Face最新论文研究趋势总结

当下人工智能研究正朝着“模型精进化、落地场景化、技术融合化的核心方向深度推进,“工欲善其事,必先利其器”,大模型的训练稳定性与推理效率优化成为基础研究的核心赛道,研究者们跳出启发式调优的桎梏,以理论化、体系化的方法破解大模型落地的底层难题;同时“道器相融,知行合一”,AI技术不再局限于纯算法创新,而是深度融合虚实融合、具身智能、机器人学等实际应用场景,实现从实验室到真实场景的技术落地;此外“问渠那得清如许,为有源头活水来”,多模态模型的发展正从单纯的架构改进,转向精细化度量设计与高质量数据集构建的双轮驱动,为模型性能提升筑牢数据与评估基础。

结合研究方向与应用场景,将8篇论文归为四大类:大模型训练与推理优化类、虚实融合与具身智能类、多模态与视觉语言模型类、机器人智能控制类,四类研究各有侧重又相互交融,共同勾勒出当下AI研究“基础创新筑基,场景落地赋能”的整体图景。

一、大模型训练与推理优化类

本类研究聚焦大模型强化学习训练的底层稳定性问题与推理阶段的效率冗余问题,以理论创新打破现有技术瓶颈,实现大模型训练与推理的双重提效,是大模型从“能训”到“训好”、从“能推理”到“巧推理”的关键突破。

★★★VESPO: Variational Sequence-Level Soft Policy Optimization for Stable Off-Policy LLM Training

核心应用场景:大模型离线强化学习训练,解决因策略陈旧、异步训练等导致的训练不稳定性问题,适配稠密模型与混合专家模型的数学推理任务训练。

创新点:针对大模型离线强化学习中重要性采样方差高、现有改进方法缺乏统一理论基础的问题,提出融合方差缩减的提议分布变分公式,推导出可直接作用于序列级重要性权重的闭式重塑核,摒弃长度归一化与令牌级分解的方式,让模型在64倍策略陈旧率与全异步执行下仍能保持稳定训练,且在数学推理基准测试中实现稠密和混合专家模型的性能提升。

论文地址:https://huggingface.co/papers/2602.10693

★★Does Your Reasoning Model Implicitly Know When to Stop Thinking?

核心应用场景:大推理模型的复杂数学推理任务,解决思维链推理带来的计算冗余、效率低下且长链易降低推理准确性的问题。

创新点:首次实证验证大推理模型具备隐式判断最优推理停止点的能力,该能力被现有采样范式掩盖,据此提出SAGE自感知引导高效推理采样范式,并将其作为混合采样融入基于组的强化学习形成SAGE-RL,把发现的高效推理模式融入标准pass@1推理,显著提升大推理模型在数学基准测试中的推理精度与计算效率。

论文地址:https://huggingface.co/papers/2602.08354

二、虚实融合与具身智能类

本类研究锚定XR、虚拟人、具身智能体等虚实融合的前沿应用场景,突破现有模型仅支持粗粒度控制、缺乏空间感知的局限,实现人与虚拟环境、具身智能体的自然交互,为元宇宙、数字人等场景的落地提供核心技术支撑。

★Generated Reality: Human-centric World Simulation using Interactive Video Generation with Hand and Camera Control

核心应用场景:扩展现实(XR)的具身交互场景,解决现有视频世界模型仅支持文本、键盘等粗粒度控制,无法实现灵巧的人手-物体交互的问题。

创新点:提出以人为中心、基于头部姿态与关节级手部姿态条件约束的视频世界模型,优化扩散变换器的3D头手控制机制,训练双向视频扩散模型并将其蒸馏为因果交互式系统,生成以自我为中心的虚拟环境,让用户在虚拟场景中获得更强的控制感,且任务表现相较于基线模型大幅提升。

论文地址:https://huggingface.co/papers/2602.18422

★SARAH: Spatially Aware Real-time Agentic Humans

核心应用场景:VR、远程呈现、数字人等场景的具身智能体交互,解决现有具身智能体运动缺乏空间感知,无法根据用户位置实现自然的对话式肢体与凝视运动的问题。

创新点:提出首个可部署于流式VR头显的实时、全因果空间感知对话运动方法,融合因果Transformer基变分自编码器与流匹配模型,结合交错潜令牌实现流式推理,设计带无分类器引导的凝视评分机制解耦模型学习与凝视控制,让具身智能体在Embody 3D数据集上实现300FPS的 sota 运动质量,精准捕捉自然对话的空间动态。

论文地址:https://huggingface.co/papers/2602.18432

三、多模态与视觉语言模型类

本类研究聚焦视觉语言大模型的核心痛点与多模态推理的基础支撑,一方面解决视觉语言模型的语言偏差问题,另一方面构建高质量多模态数据集,从模型训练方法与数据基础两个维度,推动多模态模型的视觉接地能力与推理能力提升。

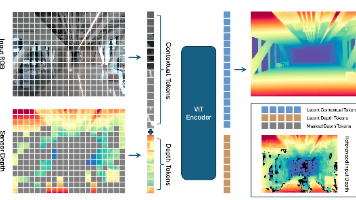

★Selective Training for Large Vision Language Models via Visual Information Gain

核心应用场景:视觉语言大模型的训练优化,解决模型存在语言偏差、过度依赖文本信息而忽略视觉证据,且缺乏量化视觉输入贡献方法的问题。

创新点:提出基于困惑度的视觉信息增益(VIG)度量,可在样本与令牌级精细量化视觉输入对降低预测不确定性的贡献,据此设计VIG引导的选择性训练策略,优先训练高VIG样本与令牌,在大幅减少监督成本的同时,有效提升模型的视觉接地能力,缓解语言偏差问题。

论文地址:https://huggingface.co/papers/2602.17186

★DeepVision-103K: A Visually Diverse, Broad-Coverage, and Verifiable Mathematical Dataset for Multimodal Reasoning

核心应用场景:大多模态模型的可验证奖励强化学习训练,解决现有多模态数据集多样性与覆盖度不足,限制模型视觉感知与推理能力提升的问题。

创新点:构建覆盖K12全数学知识点、视觉元素丰富的DeepVision-103K多模态数学数据集,弥补现有数据集小样本手动构建、资源重组的缺陷,将其用于大模型的RLVR训练,不仅让模型在多模态数学基准测试中表现优异,还能有效提升模型的视觉感知、反思与推理能力,且在通用多模态推理任务中具备良好的泛化性。

论文地址:https://huggingface.co/papers/2602.16742

四、机器人智能控制类

本类研究围绕移动机器人的实际操作与运动模仿场景,突破现有机器人控制依赖全局状态估计、运动控制存在不自然高频信号的问题,实现机器人在复杂环境下的端到端学习与平滑的运动模仿,推动机器人从仿真训练到真实场景的落地。

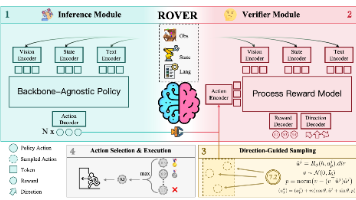

★EgoPush: Learning End-to-End Egocentric Multi-Object Rearrangement for Mobile Robots

核心应用场景:移动机器人在杂乱动态环境中的长程多物体非抓取式重排任务,解决现有方法依赖全局状态估计、在动态场景中易失效的问题。

创新点:提出基于自我中心感知的端到端策略学习框架EgoPush,设计物体中心潜空间编码物体相对空间关系而非绝对姿态,通过受限观测的RL教师模型与纯视觉学生模型的蒸馏缩小监督差距,采用阶段分解奖励解决长程信用分配问题,在仿真实验中大幅超越基线模型,且实现移动机器人多物体重排的零样本仿真到现实迁移。

论文地址:https://huggingface.co/papers/2602.18071

Learning Smooth Time-Varying Linear Policies with an Action Jacobian Penalty

核心应用场景:仿真角色与物理机器人的运动模仿任务,解决现有强化学习控制策略产生不自然高频信号、需大量调参,且计算开销大的问题。

创新点:提出动作雅可比惩罚机制,通过自动微分直接惩罚动作随仿真状态的突变,无需任务特定调参即可消除不自然的高频控制信号,针对该机制带来的计算开销问题,设计线性策略网(LPN)新架构,大幅降低训练中的计算负担,该架构无需参数调参、收敛速度快且推理效率更高,在空翻、跑酷等动态运动模仿及四足机械臂机器人的动态运动控制中实现平滑的策略学习。

论文地址:https://huggingface.co/papers/2602.18312

思维导向图

## **AI研究核心趋势**

- 模型精进化:大模型训练/推理的理论化优化

- 落地场景化:虚实融合、机器人学等场景落地

- 技术融合化:多学科技术交叉支撑AI创新

## **大模型训练与推理优化类**

- ★★★VESPO:大模型离线RL训练稳定化,变分公式+方差缩减

- ★★推理停止研究:LRM隐式停止能力,SAGE-RL提升推理效率

## **虚实融合与具身智能类**

- ★Generated Reality:XR头手精细控制,双向视频扩散模型

- ★SARAH:VR数字人空间感知,300FPS实时对话运动

## **多模态与视觉语言模型类**

- ★VIG度量研究:视觉语言模型选择性训练,缓解语言偏差

- ★DeepVision-103K:多模态数学数据集,支撑RLVR训练

## **机器人智能控制类**

- ★EgoPush:移动机器人自我中心感知,零样本仿真实迁

- 无星雅可比惩罚:机器人平滑运动控制,LPN架构降本提效

更多内容关注公众号"快乐王子AI说"

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献29条内容

已为社区贡献29条内容

所有评论(0)