Genie Envisioner:机器人操作的统一世界基础平台

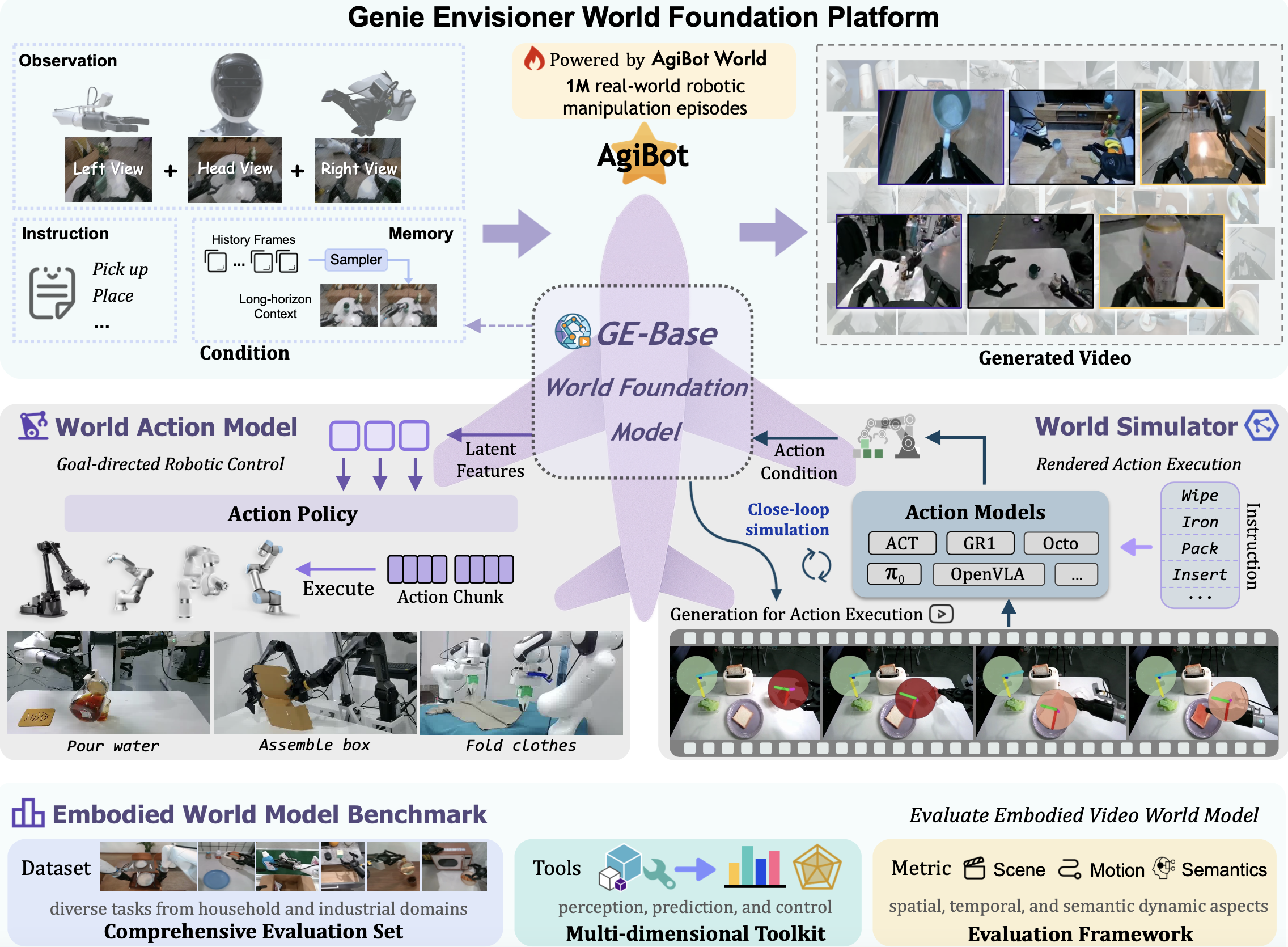

25年8月来自上海智元机器人、新加坡国立(NUS)和北航(BUAA)的论文“Genie Envisioner: A Unified World Foundation Platform for Robotic Manipulation”。Genie Envisioner (GE),是一个统一的机器人操控世界基础平台,它将策略学习、评估和模拟集成在一个视频生成框架中。GE-Base 的核心是一个大规模

25年8月来自上海智元机器人、新加坡国立(NUS)和北航(BUAA)的论文“Genie Envisioner: A Unified World Foundation Platform for Robotic Manipulation”。

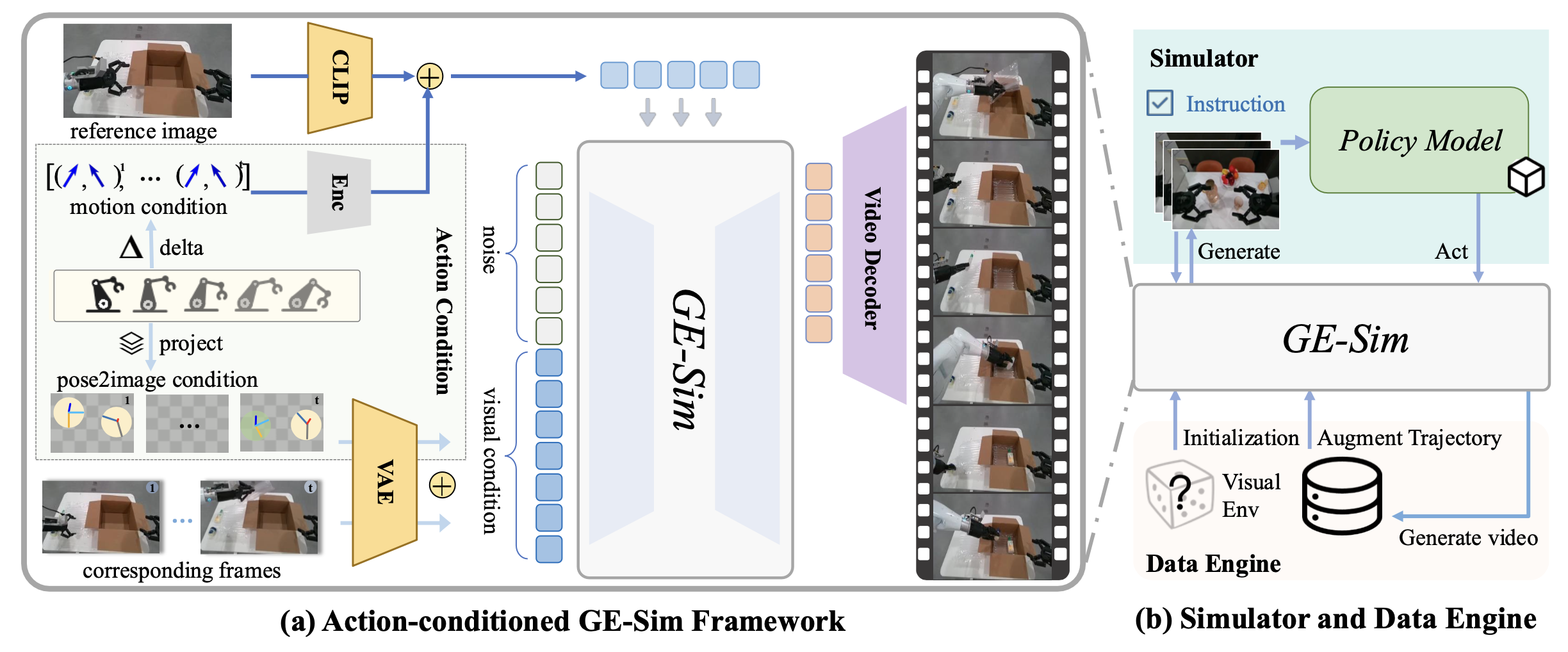

Genie Envisioner (GE),是一个统一的机器人操控世界基础平台,它将策略学习、评估和模拟集成在一个视频生成框架中。GE-Base 的核心是一个大规模、指令条件化的视频扩散模型,能够在结构化的潜空间中捕捉现实世界机器人交互的空间、时间和语义动态。在此基础上,GE-Act 通过轻量级的流匹配解码器将潜表征映射到可执行的动作轨迹,从而能够在最低限度的监督下跨不同具体化实现精确且可泛化的策略推理。为了支持可扩展的评估和训练,GE-Sim 充当一个动作条件化神经模拟器,为闭环策略开发提供高保真度的部署。该平台还配备了 EWMBench,这是一个标准化的基准测试套件,用于测量视觉保真度、物理一致性和指令-动作一致性。这些组件共同构成 Genie Envisioner,使其成为一个可扩展且实用的指令驱动型通用具身智能的基础。

为机器人操作的世界模型。世界模型作为感知、规划和控制的内部预测表示,这一概念长期以来在机器人技术中发挥着核心作用(Chatila & Laumond,1985;Sutton & Barto,1981)。早期方法依赖于解析建模和系统辨识(Murray et al., 2017),需要针对特定任务的工程设计,且通用性有限。神经世界模型(Ha & Schmidhuber,2018)的引入使得直接从感官输入中学习动力学的紧凑表示成为可能。这些模型后来发展到可以在像素空间(Ebert et al., 2018;Finn et al., 2016)和学习的潜空间(Hafner et al., 2019;Hu et al., 2024;Wu et al., 2023)中运行,并应用于控制和规划。然而,大多数先前的努力仍然局限于特定任务,受到有限交互数据的限制。近期的研究进展提出基于视频的通用世界模型,这些模型基于大规模数据集进行训练(Agarwal,2025;Bruce,2024;Jang,2025;Russell,2025),但这些模型主要侧重于视觉合成,不支持闭环机器人控制。相比之下,本文工作开发一个统一的框架,将基于视频的世界建模与动作解码模块(GE-Act)和闭环模拟器(GE-Sim)集成,从而可以直接应用于现实世界的机器人操控。

Genie Envisioner (GE) 是一个统一的平台,它将机器人感知、策略学习和评估功能整合到一个闭环视频生成世界模型中,如图所示。其核心是 GE-Base,这是一个指令调节的多视角视频扩散模型,该模型基于来自 AgiBot-World-Beta 数据集 (Bu et al., 2025a) 的约 3000 小时视频语言配对数据进行训练,涵盖超过一百万个现实世界机器人操作场景。基于机器人的视觉观察,GE-Base 自回归生成视频块,捕捉遵循高级指令的操作行为的时间演变。利用机器人领域自适应预训练,GE-Base 建立从语言指令到具体视觉空间的映射,通过建模现实世界交互的空间、时间和语义规律来捕捉机器人操作的本质。它通过推断潜轨迹来实现这一点,这些轨迹共同编码机器人的感知输入和合理动作序列下场景的预期演变。

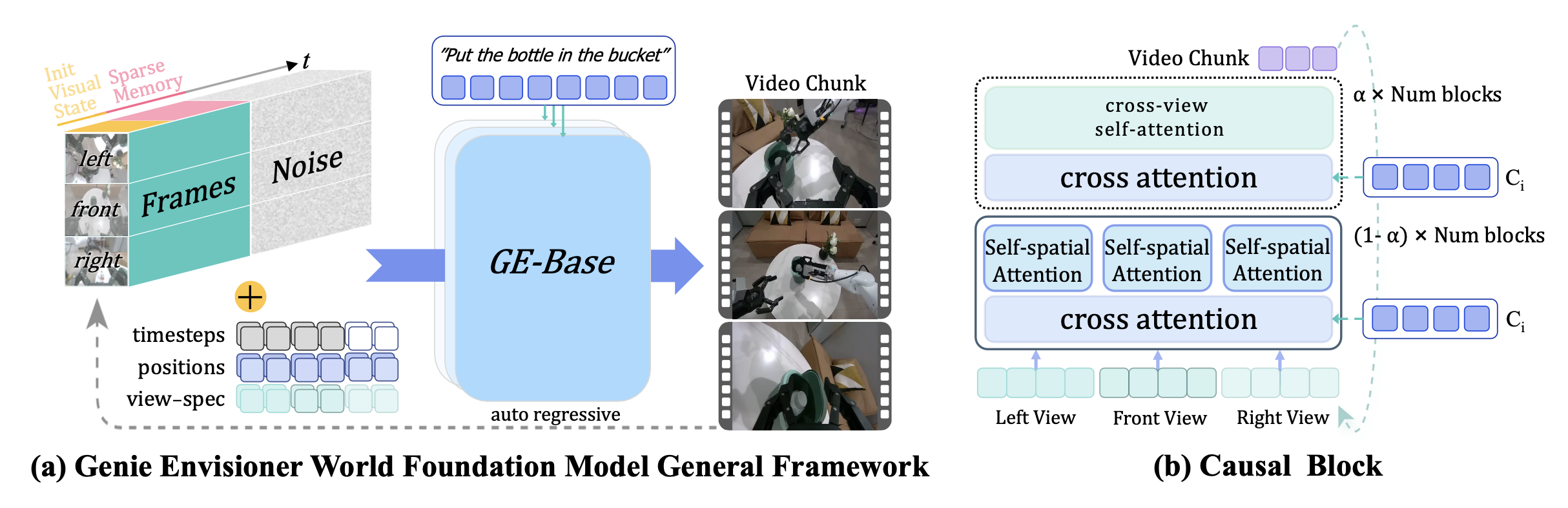

GE-Base 是 Genie-Envisioner 的核心组件。目标是扩展通用视频生成模型的预测能力,构建一个具身预测表征——一个统一的生成公式,能够预测未来机器人与环境的交互,该公式以任务指令为条件,并以智体的物理形态为基础。为此,将机器人视频世界建模定义为一个文本-和-图像-到-视频的生成问题:给定语言指令和初始视觉观察,该模型预测未来能够反映合理且连贯的机器人行为的视频片段。GE-Base 的一个关键设计特性是其稀疏记忆机制,该机制利用长期历史背景增强当前视觉输入,通过统一的视觉条件实现更强大的时间推理。基于此公式,GE-Base 采用视频扩散transformer架构,并结合机器人自适应预训练策略,将知识从通用视频数据集迁移到具身机器人领域。

基本架构

为了与机器人操作数据的序列性保持一致,采用一种自回归视频生成框架,将输出分割成离散的视频块,每个块包含 N 帧。在每个步骤 t,世界基础模型 W 会基于三个组成部分生成下一个视频块 x(t)_1:N:该组成部分包括初始视觉观测 x_0、语言指令 q 以及稀疏记忆 xˆ_0:t−1(稀疏记忆是通过对先前步骤中的长期历史帧进行稀疏采样而构建的)。

该方案能够基于视觉和指令条件逐步生成时间连贯的视频片段。通过将长期稀疏记忆融入视觉状态,而不是仅仅依赖于最近的帧,该模型能够有效地捕捉扩展的时间依赖性,同时在整个操作过程中保持语义对齐和视觉一致性。

为了在机器人视频建模中权衡效率和容量,采用紧凑的视频生成模型作为核心架构。 GE-Base 世界模型 W 在设计时充分考虑灵活性,能够与各种基于扩散transformer (DiT) 的视频生成模型无缝集成,例如 LTX-Video 2B (HaCohen,2024) 和 COSMOS 2B (Agarwal,2025)。考虑到双臂机器人系统中感知的自我中心特性,将 W 扩展为一个多视角、语言和图像调节的生成框架,该框架利用来自三个机载摄像头的时间同步输入:一个头戴式视角 (vh) 和两个腕戴式视角 (vl, vr)。x_0、xˆ_0:t−1 和 x_t 中的每一帧都构成这个三视角观察结构。

如图所示,生成流程首先使用共享视频编码器 E 对来自初始视觉观察 x_0 和稀疏内存 xˆ_0:t−1 的多视图观察进行编码。对于每个视图,获得潜视觉 tokens,表示为 E(v(i)_0) 和 E(v(i)_t-1)。每个视图的视觉 token 序列由来自 x_0 和 xˆ_0:t−1 的 tokens 连接而成。对应于每个视图,初始化一个不同的噪声图 z(i) 来指导生成。为了在区分特定视点信息的同时保持时空对齐,用 2D 旋转位置嵌入 e_pos 和特定于视图的可学习嵌入 e_view 来增强每个 token 和噪声输入。这些来自所有视图丰富的 tokens 和噪声图被连接起来,并进一步嵌入时间步长编码 e_t,然后输入到 DiT 主干网中以自回归生成下一个视频块。

为了促进跨多视图的连贯推理,将 (H, W) 上的标准空间自注意扩展为 (N, H, W) 上的跨视图自注意,其中 N 表示摄像机视角的数量。隐状态被重塑为 (B, N, T, H, W, C),以实现联合跨视图推理。为了确保计算的可处理性,跨视图注意被稀疏地插入到选定的 DiT 块中,而其余块通过将 N 维折叠到批维度中来独立处理视图,从而产生 (B · N, T, H, W, C) 的形状。这种混合注意方案平衡视图级别的一致性和效率。

为了结合语义任务级别的指导,指令 q 使用冻结的 T5-XXL 编码器(Raffel,2020)进行处理,生成一组文本嵌入 T (q)。这些嵌入通过 DiT 中的交叉注意层集成到视觉 token 流中,从而使模型能够将视频生成与指令语义对齐。

基于此设计,世界模型 W 预测下一个视频块 xˆ_t,其中 v(i)_0 和 v(i)_tˆ 表示来自视图 i 的编码初始和历史视觉 token,z(i) 表示相应的特定视图噪声图,T(q) 表示编码的语言指令。

这种统一的建模范式使 W 能够联合捕获空间布局、时间动态和语义意图,从而对机器人的具体行为产生连贯且可控的预测。

世界模型预训练

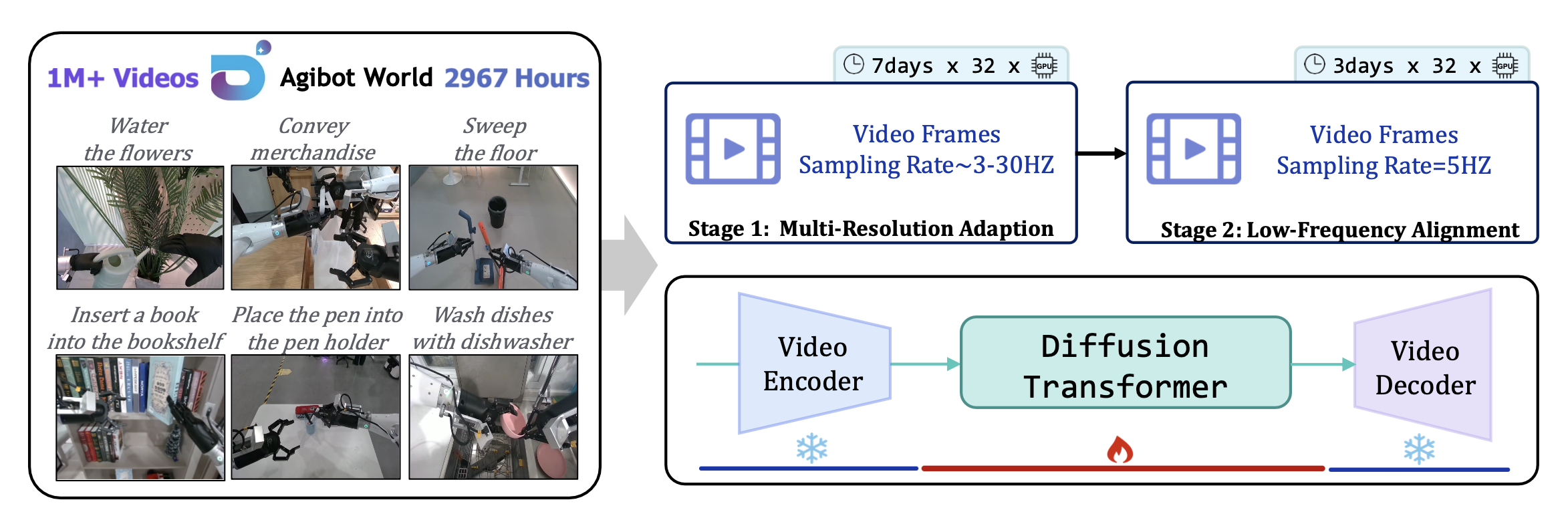

构建基于视频的机器人操作世界模型的核心挑战在于,如何将通用的视频生成能力与具体机器人领域的结构化动力学和语义进行适配。为了解决这个问题,开发一个多阶段预训练框架,逐步将模型的时空表征与现实世界机器人行为的分布特征进行匹配。

如图所示GE-Base训练进程:在训练过程中,从先前的视频历史中随机采样稀疏记忆帧,作为一种数据增强的形式。这种设计增加未来预测的难度,并增强模型对时间变化的鲁棒性,最终提升其对各种操作场景的泛化能力。

数据管理。采用 AgiBot-World-Beta (Bu et al., 2025a) 数据集作为预训练的基础。该数据集包含约一百万个高质量的真实世界双臂机器人操作场景,总计 2,967 小时,通过人类远程操作收集。该数据集涵盖了各种各样的任务、目标类别和环境,每条轨迹都标注有自然语言指令、多视角视觉观察和结构化动作策略。为了使数据集适应基于视频的建模,从三个经过标定的摄像机视角提取时间同步的视频流,并确保每个视频片段与其配对指令之间的语义一致性。此预处理步骤可生成高质量的文本-视频对,这些对能够反映连贯且可执行的操作行为。为了适应不同预训练阶段的不同学习目标,采用可变帧采样策略,以平衡时间分辨率和训练稳定性。

第一阶段:多分辨率时间自适应 (GE-Base-MR)。第一阶段旨在弥合通用视频表征学习与机器人特定运动动力学之间的差距。用 57 帧视频序列对模型进行预训练,这些序列以 3 Hz 到 30 Hz 之间的帧速率随机采样。每个训练样本包含四个稀疏记忆帧,这些帧是从先前的视频历史中随机抽取的,以增强时间多样性。这些片段通过预训练的 VAE 编码到 8 帧潜空间中,并在其中添加噪声,并通过去噪目标对模型进行优化。

这种训练设置将模型(称为 GE-Base-MR)暴露于广泛的运动速度和时间模式,从而鼓励其学习不受采样率影响的时空表征。该模型以视觉条件和语言指令为条件,经过训练,能够将高级任务意图映射到低级视觉动态,同时保持对部分观测的鲁棒性。这种设计对于现实世界的部署至关重要,因为传感器延迟、丢帧和异步数据在现实世界中很常见。GE-Base-MR 使用 32 块 NVIDIA A100 GPU 在大约 7 天内在 AgiBot-World-Beta 数据集上进行端到端训练。

第二阶段:低频策略对齐 (GE-Base-LF)。为了提高训练效率并更好地与下游动作建模中使用的时间抽象保持一致,用低帧率视频序列对 GE-Base-MR 进行微调。具体来说,以 5 Hz 的固定速率采样 9 帧片段,并提供 4 个额外的稀疏记忆帧作为时间上下文。这些序列通过预训练的视频编码器映射到由两个潜帧组成的紧凑潜空间中,编码器的参数保持不变。在此阶段仅更新视频生成组件。最终的模型 GE-Base-LF 经过优化,能够在稀疏视觉采样下捕捉语义上有意义的转换。生成路径的训练保持端到端,并同时以任务指令和视觉条件为条件。此过程有效地将视频 DiT 与控制中使用的时间抽象对齐,从而能够在离散动作步骤的粒度上实现可靠的视频反馈。GE-Base-LF 是后续动作模型预训练的关键基础,使用 32 块 NVIDIA A100 GPU 进行大约三天的训练。

通过 GE-Base 生成机器人操作视频

用 GE-Base 生成双臂机器人操作视频,并利用 LTX-Video 2B 架构(目前正在探索其他基础架构)。此过程采用自回归方法,每一步都会根据初始观察结果、一系列记忆帧和语言指令生成一个新的视频块。生成过程不断迭代,直到指令指定的任务完全执行,最终生成一个无缝衔接的视频序列,精确捕捉完整的操作过程。

在推理阶段,记忆帧会以固定间隔从先前的视频块中均匀采样,以确保稳定的时间动态和一致的预测。在现实世界的双臂机器人操作任务中评估该流程。GE-Base 生成的多视角视频能够准确反映不同的语言指令。

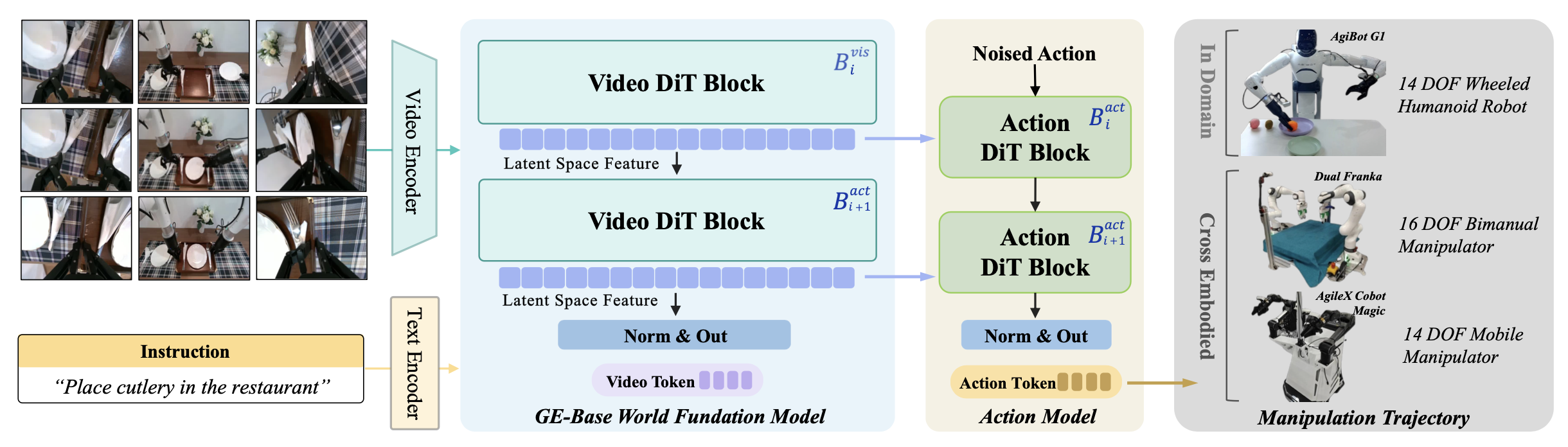

连接高级世界建模和低级控制对于在具身机器人中部署视觉语言基础模型至关重要。GE-Act,是一个即插即用的世界动作模块,它通过一个轻量级的、拥有 1.6 亿个参数的自回归动作解码器增强 GE-Base 基础模型。GE-Act 将基于多视角视觉观察和语言指令的多模态潜表征转化为时间结构化的动作策略,从而实现无需显式视频生成的指令跟随行为。该架构支持感知和控制之间的紧密耦合,为不同环境下的实时机器人操控提供可扩展且高效的解决方案。

基本架构

GE-Act 是一个即插即用的世界动作模块,它扩展了 GE-Base 基础模型,以实现基于指令的机器人控制。在架构上,它与 GE-Base 的视觉主干并行运行,采用基于自回归 DiT 的设计,将潜在视觉表征转化为时间结构化的动作策略。这种集成将高级感知理解与低级运动执行连接起来,支持基于多视角视觉观察和语言指令的无缝策略生成。

如图所示,GE-Act 通过镜像 DiT 块深度,同时采用降低的隐维度来确保计算效率,从而保持与 GE-Base 的结构一致性。在每一步中,基础模型处理源自初始观察 x_0 和稀疏采样的历史帧 xˆ_t−1 的视觉 token,并以指令嵌入 T (q) 为条件。

同时,GE-Act 中的动作路径通过一组相应的特定动作transformer块 Bact_i 处理噪声初始化的动作 token z_act,并通过交叉注意结合相关的上下文信息。

这种模块化架构使 GE-Act 能够完全在潜特征空间内运行,无需在部署过程中显式生成视频即可进行控制推理。当集成到实际系统中时,该模型可以直接使用实时感知输入,并通过闭环公式保持策略一致性。

训练流程

采用受标准视觉-语言-动作 (VLA) 操作框架启发的两阶段训练范式,包括与任务无关的预训练和针对特定任务的自适应训练。如图所示:

预训练。在动作模型的预训练阶段,用 AgiBot-World-Beta 数据集对预训练的视觉语言表征进行专门化,以用于动作策略学习。世界模型 W 使用来自 GE-Base-LF 的固定参数初始化,以保留其时空和语义先验,同时仅更新动作解码模块的参数。为了减少计算开销,训练期间禁用视频生成。取而代之的是,使用由 4 帧以 5 Hz 采样率组成的低帧率视觉记忆序列作为条件输入,而模型预测由 54 个步骤以 30 Hz 采样率组成的高频动作序列。训练仅由真实动作轨迹监督,使模型能够完全在预训练的潜空间内学习与控制相关的动态。该过程在由 16 块 NVIDIA A100 GPU 组成的集群上大约需要三天时间完成。

针对特定任务的自适应调优。为了使预训练模型适应下游机器人任务,采用包含视频自适应和动作特化两阶段微调流程,旨在将通用的视觉语言表征与特定任务的执行要求相匹配。在视频自适应阶段,仅更新世界模型 W 的视频生成组件,其余参数保持不变。微调是在由完整的 AgiBot-World 语料库和特定任务子集组成的复合数据集上进行的,其中后者的权重增加 10 倍,以在不牺牲泛化能力的情况下增强任务匹配性。采样协议与 GE-Base-LF 中使用的协议一致,以保持时间一致性。此阶段使用 8 块 NVIDIA A100 GPU 完成,耗时约 12 小时。在随后的动作特别化阶段,完整模型(包括 GE-Base 主干和动作模块)将基于特定任务数据进行微调,以捕捉细粒度的控制动态。此过程与动作预训练设置相同,并遵循相同的采样策略,以确保时间和控制层面的一致性。此阶段使用 8 块 NVIDIA A100 GPU 进行训练,耗时约 36 小时。

异步推理

为了弥合视觉处理和运动控制之间的时间差距,引入慢-快异步推理模式,该模式通过利用两个关键层面的不对称性来优化计算效率:去噪复杂度和目标频率。

非对称去噪策略。推理流程根据每种模态的不同需求分配计算资源。视频 DiT 在每次推理过程中执行单个流匹配去噪步骤,以生成视觉潜token,这些token随后被缓存并在整个动作生成阶段重复使用。动作模型需要更高的时间分辨率来实现精确控制,它执行五个去噪步骤,所有步骤都基于相同的缓存视觉表征。这种方法确保在实际机器人上搭载的板载 NVIDIA RTX 4090 GPU 上,54 步的前向传递在 200 毫秒内完成,从而确保实时推理能力。

除了改进去噪过程之外,还利用视觉感知和运动控制之间固有的频率不匹配。视频 DiT 以 5 Hz 运行,而动作模型以 30 Hz 运行,从而实现 1:6 的时间分辨率比。这种解耦实现稀疏视频预测和密集动作生成。通过仅表示选定的未来视频帧,显著降低视频潜空间的维数,无需处理高频视觉序列。这种设计使视频 DiT 能够在紧凑的潜空间中高效运行,同时动作模型保留实现精准响应控制所需的完整时间分辨率。

这种双层优化为训练和部署带来显著优势。在训练过程中,用随机高斯噪声初始化隐状态来消除视频加载和解码造成的典型瓶颈,从而优化大规模视频模型的训练过程。在部署过程中,单步视频去噪和降低潜维数相结合,实现机器人硬件的高效实时运行,促进视频生成和动作执行的无缝集成。

通过 GE-Act 在 AgiBot G1 上进行行动规划

为了严格评估方法在现实世界机器人操控中的有效性,对五项代表性任务进行广泛的评估,每项任务旨在测试控制精度、任务复杂性和泛化能力的不同方面。这些任务包括:

(1) 制作三明治:依次组装面包、培根、生菜和面包,测试机器人的多物体协调性、空间推理和程序性任务执行能力;

(2) 倒茶:涉及抓取、精确倒茶和重新摆放茶壶,凸显流体操控对精细运动控制和灵活性的需求;

(3) 清洁桌子:要求机器人抓住雨刷并执行一致的擦拭动作以去除表面污渍,评估轨迹稳定性和柔顺力施加;

(4) 在微波炉中加热食物:操作微波炉门、放入碗并与按钮交互,挑战系统处理铰接物体和多阶段界面操作的能力;

(5) 包装洗衣液:从传送带上抓取移动的洗衣液袋并将其放入盒子中,旨在评估动态感知、运动跟踪和工业规模的操作能力。

这些任务涵盖家庭和工业场景,为评估指令条件控制、时间基础和闭环执行能力提供了全面的基准。

评估方案。采用两种评估指标来评估性能:逐步成功率 (SR) 和端到端成功率 (E2E)。SR 指标独立评估每个子步骤,并将总体成功率计算为成功完成的子步骤占总子步骤的比率,从而提供对部分任务完成情况的精细洞察。相比之下,E2E 指标仅评估完整任务的最终结果,允许在执行过程中对单个子步骤进行多次尝试,这更好地反映了机器人能够从中间故障中恢复的真实部署场景。

使用 Genie Envisioner 进行跨具身泛化

除了在域内 AgiBot G1 平台上验证 GE 之外,还评估 GE 在不同具身间的泛化能力,这是开发多功能机器人基础模型的关键一步。具体而言,在操作研究中广泛使用的两个机器人平台上评估 GE:Franka 机械臂和 Agilex Cobot Magic 系统。为了与双臂框架保持一致,两个平台均进行相应的配置。

由于具身设计和动作空间的差异,直接在新平台上部署预训练的 GE 模型并不可行。为了解决这个问题,使用少样本自适应协议,为每个任务收集少量高质量的远程操作演示。这些演示用于微调 GE 和 GE-Act 模型,从而实现与新平台的有效迁移和对齐。除 AgiBot G1 上的标准任务集外,还在复杂的可变形物体操作任务(例如“折叠布料”和“折叠盒子”)上评估了 GE,这些任务的选择基于其与现实世界的相关性和物理挑战性。该框架对 GE 在不同机器人平台上的可转移性、稳健性和控制精度进行了全面评估。

为了支持与现实世界一致的评估和闭环控制,开发一个基于视频的世界神经模拟器,该模拟器能够根据机器人动作生成时间相干的视觉预测。该神经模拟器使具身策略模型能够与一致的视觉环境交互,摆脱基于物理的约束,并作为跨不同任务的策略学习和泛化的统一测试平台。

将 GE-Base 基础模型扩展为基于动作的世界模拟器 GE-Sim ,这样实现这一功能。在此方案中,动作轨迹作为驱动视频合成随时间变化的主要控制信号。为了确保生成帧之间的视觉一致性,引入一个由冻结 CLIP 图像编码器编码的参考图像作为轻量级锚点。该图像通过交叉注意机制注入到每个 DiT 块中,补充保留的视觉观察结果,为整个序列提供空间基础。

这一转变的一个根本挑战,是协调低级控制命令与预训练世界模型编码的高级潜表示之间的语义差异。为了解决这个问题,如图所示,引入一种分层动作调节机制,将结构化动作表示直接集成到 GE-Base 的 token 空间中。该架构保留模型预训练的时空语义,同时实现与各种策略模型的无缝对接,从而促进闭环、动作调节的神经模拟,并具有对各种机器人任务的鲁棒泛化能力。

分层动作调节机制

为了确保与各种动作策略模型兼容,采用一种通用的机器人轨迹表示方法。对于单个机械臂,每个控制步骤都编码为一个 7 维向量 [x, y, z, roll, pitch, yaw,o],其中 (x, y, z) 表示末端执行器位置,(roll, pitch, yaw) 表示其方向,o 表示夹持器的张开度。在双臂设置中,每一步的控制信号由一个 14 维向量表示,该向量由两个手臂的控制向量连接而成。在 K 步范围内,完整的动作轨迹表示为 A。为了将这种低级控制信号与 GE-Base 基础模型中基于 token 的输入接口连接起来,提出一种包含空间和时间成分的分层动作调节机制。

Pose2Image 调节。在每个时间步长 i 处,位姿向量 a_i = [x_i, y_i, z_i, r_i, p_i, y_i, o_i] 编码空间位置、方向和夹持器状态。位置 (x_i,y_i,z_i) 使用已标定的相机内外参投影到像素坐标中。方向 (r_i, p_i, y_i) 被转换为旋转矩阵,其正交轴也被投影到图像平面以指示方向性。夹持器打开度 o_i 在单位圆上渲染,阴影强度反映其状态 - 打开时颜色较亮,闭合时颜色较暗。不同的颜色编码区分左右臂。此过程生成与视觉场景在空间上对齐的位姿图像 P_i。

每个 P_i 与其对应的采样历史帧 I_i 配对。两者均使用共享视频编码器 E 进行编码,并通过逐元素相加的方式融合其潜特征。最终的融合token v_i 能够捕获上下文视觉语义和显式姿态信息,并将其插入到视觉 token 记流中进行下游处理。

运动矢量调节。为了捕捉时间动态,计算连续末端执行器姿态之间的运动增量。令 a_i = [p_i, r_i] 表示时间步 i 的六自由度姿态,其中 p_i 为位置,r_i 为方向。增量编码位置和方向的变化。这些增量通过可学习的编码器编码为运动 token,与参考图像风格 token 连接,并通过交叉注意机制注入到每个 DiT 块中。这种时间感知的表示提供连贯的运动先验,以指导 GE-Sim 中基于动作条件的视频生成。

训练流程

为了确保动作条件生成所需的高保真视频模拟,GE-Sim 基于高时间分辨率预训练模型 GE-Base-MR 进行初始化,该模型提供机器人动力学的细粒度建模。随后,该模型在完整的 AgiBot-World-Beta 数据集上进行训练,使用真实动作轨迹作为视频生成的条件输入。为了提高泛化能力和鲁棒性,训练语料库添加一系列从人类远程操作和现实世界机器人部署中收集的故障案例,包括错误执行、不完整行为和次优控制轨迹。在此阶段,VAE 和 CLIP 编码器保持冻结状态,以保留预训练的语义和空间先验,而其余参数则通过对预测的视频表征应用流匹配损失进行优化。

动作条件视频生成

为了评估动作条件视频生成的精度,基于真实控制序列对 GE-Sim 的模拟输出进行可视化。在不同的任务和视角下,生成的末端执行器运动始终与动作输入的空间意图保持一致,这表明 GE-Sim 能够忠实且精确地将低级控制命令转换为连贯的视觉预测。这一结果进一步验证 GE-Sim 作为高保真、动作对齐的机器人操作视频世界模拟器的可靠性。

闭环仿真

为了支持对任意策略模型的闭环评估,GE-Sim 充当基于视频的世界模拟器。给定语言指令和初始视觉观察,策略模型首先将其作为输入,并输出动作轨迹。然后,GE-Sim 会根据初始观察结果和预测的行动策略生成模拟该行动结果的视频片段。生成的视频会与原始指令一起反馈到策略模型中,以生成下一个行动步骤。此迭代过程持续进行,直至指令完成,从而在一致且可控的视觉环境中实现闭环模拟和与现实世界一致的策略模型评估。

除了策略评估之外,GE-Sim 还可用作多功能数据引擎。通过在不同的初始视觉环境下执行相同的动作轨迹,它可以生成反映不同上下文的多样化操作序列。

这款基于现实世界数据的视频世界模拟器,为传统物理模拟器提供一个替代方案,在实现高视觉保真度的同时,显著降低部署成本。至关重要的是,它无需手动进行环境建模,即可实现可扩展且灵活的模拟。因此,GE-Sim 为构建一种通用、逼真且低成本的世界模型奠定了基础,这些模型将具身智能中的学习与评估连接起来。

有效的评估框架是科学进步的导航工具——建立标准化标准并促进不同方法之间有意义的比较。在机器人世界建模领域,系统地评估模型是否忠实地捕捉具身环境的结构、动态和语义的能力对于该领域的发展至关重要。为此提出具身世界模型基准 EWMBench,这是一个全面的评估套件,旨在衡量基于视频的世界模型在现实世界机器人操作中的表征保真度和实用性。

与专注于视觉保真度、语言一致性或人类偏好的传统通用视频生成基准相比,机器人操作视频引入更严格的结构约束。在该领域,背景布局、目标配置和具身结构(例如机器人形态)应保持不变,而只有机器人的姿势和交互会根据指令进行演变。 EWMBench 的设计充分考虑这些特定领域的特性,提供面向任务的指标,用于评估视觉场景的一致性、运动正确性以及语义对齐和多样性,从而能够在以操作为中心的场景中更忠实、更实用地评估世界模型。为此,EWMBench 包含一个高质量的真实世界基准数据集和一套开源评估工具,构建一个标准化框架,用于严格评估基于视频的世界模型在以操作为中心的任务中的能力。

基准数据集

该基准数据集从 AgiBot-World-Beta 测试集中精选而来,选取 10 个涵盖家庭和工业领域的代表性任务。这些任务具有明确的操作目标和强大的顺序依赖性,需要对affordance和动作顺序进行程序化推理。为了确保评估的公平性,所有选定的任务均与 1M 规模预训练阶段使用的任务不相交。每个任务分解为 4-10 个原子子动作,每个子动作都配有步骤级字幕,从而实现视频片段、动作标签和语言描述之间的细粒度对齐。对于每个任务,均匀采样 100 个视频实例,以构建一个均衡且全面的评估集。

为了提高每个任务的多样性,实施一种基于空间变化的轨迹选择策略。具体而言,提取双臂末端执行器轨迹并将其体素化为 3D 网格。使用 3D 交并比 (IoU) 计算成对相似度矩阵,并采用贪婪算法迭代选择重叠度最小的轨迹。这种方法确保运动模式的广泛覆盖,并最大限度地减少每个任务评估集中的冗余。

评估指标

建立一个统一的评估框架,以评估基于视频的世界模型捕捉机器人操作的空间、时间和语义动态的准确性。

场景一致性。为了评估生成视频的结构和视觉连贯性,引入一个场景一致性指标,用于评估视觉外观、环境布局和视点对齐随时间变化的稳定性。具体而言,提出一个基于连续帧和初始帧计算的块级特征相似性指标。首先在机器人操作数据集上微调一个强大的视觉编码器 DINOv2 (Oquab et al., 2023),使其表征空间与具身域对齐。对于每一帧,用该编码器提取块级嵌入。然后,计算帧间对应块的余弦相似度,以量化时间一致性。相似度得分越高,表明整个视频序列中场景结构和摄像机视点的保留程度越高,从而具有更强的时空保真度。

动作轨迹质量。为了评估响应指令执行的动作轨迹质量,手动为每个指令注释一个参考轨迹作为动作轨迹 (GT)。对于每个生成的视频,用经过训练的末端执行器(EEF) 检测器跨帧定位机械手并重建轨迹。每个指令生成三个视频样本,并提取相应的轨迹。空间对齐 (SA) 使用对称Hausdorff (symH) 距离 () 进行评估,该距离测量生成的轨迹 P 与真值 G 之间的最大逐点偏差。为了确保分数越高表示对齐效果越好,报告该值的倒数 SA_score。为了考虑生成方差,选择 symH 最低的轨迹进行进一步评估。

然后使用归一化动态时间规整 (NDTW) () 评估时间对齐 (TA),该方法可捕获生成轨迹与真实轨迹在序列和时间上的一致性。为了生成正相关的指标,报告 NDTW 距离的倒数:TA_score。

此外,引入动态一致性 (DYN) 指标,通过比较预测轨迹和真实轨迹之间的速度和加速度曲线来评估运动动力学的真实性。具体而言,计算各个时间序列之间的 Wasserstein 距离 W (·),从而在不要求严格时间对应的情况下捕获分布对齐。为了考虑运动幅度的变化并防止低动态情况下的不稳定性,用幅度感知比率对每个分量进行归一化。该公式确保指标能够同时反映动态保真度和幅度鲁棒性。这种多层次评估方法能够全面衡量空间、时间和动态保真度。

运动语义指标。从两个角度评估运动语义:语义一致性和行为多样性。语义一致性评估生成的操作行为是否与预期任务指令一致,而多样性则衡量模型生成多样化且有效轨迹的能力。为了实现语义一致性,采用基于 VLM 模型Qwen2.5-VL-7B-Instruct (Bai et al., 2025) 的多粒度评估框架:

• 全局对齐:VLM 为每个生成的视频生成简洁的摘要说明,然后使用 BLEU 分数将其与原始任务目标指令进行比较,以评估视频与预期任务语义之间的整体对齐程度。

• 关键步骤一致性:为了评估关键子任务是否正确执行,VLM 会为生成的视频和真实操作视频生成分步描述。一致性是通过计算两个描述中相应步骤之间基于 CLIP 的相似度来衡量的。

• 逻辑正确性:为了识别违反物理或常识约束的情况,首先提示 GPT 定义机器人操作视频中典型逻辑错误的分类,例如幻觉动作、物体消失或物理上不合理的动作。然后,使用基于视频的 VLM 检测生成的视频中是否存在这些预定义的错误类型。检测的违规行为会受到明确惩罚,从而鼓励模型生成语义准确且物理上一致的操作行为。

为了评估模型生成多样化输出的能力,用基于 CLIP 的全局视频嵌入来测量语义多样性。具体而言,计算基于相同指令生成视频之间的成对 CLIP 相似度,并将多样性得分定义为 1 - CLIP 相似度。得分越高,语义多样性就越大,反映了模型在确定性执行之外进行泛化的能力。

世界模型评估

为了全面评估基于视频的世界模型在机器人操作中的有效性,建立了一个综合评估框架,称为“评估竞技场”,以便对各种模型架构进行直接的比较分析。在该框架中,对七种最先进的视频生成模型进行基准测试,包括 Open-Sora(Zheng,2024)、Kling(快手,2025)、Hailuo(MiniMax,2024)、LTX-Video(HaCohen,2024)和以场景为中心的 COSMOS(Agarwal,2025)。所有模型均在标准化的文本和图像到视频生成范式下进行评估,其中自然语言指令和头部视觉观察决定视频合成的条件。值得注意的是,GE-Base 模型基于 LTX-Video 架构构建,这使得它能够专注于特定领域的任务并利用精细调整的控制。

模拟评估

除了指令条件评估外,还评估基于视频的模拟器在动作条件设置下的保真度和可靠性。给定真实动作轨迹,模拟器仅根据这些控制序列生成视觉预测。在提出的 EWMBench 框架下,GE-Sim 在空间配置、轨迹执行和语义连贯性方面始终保持高度一致性。在固定动作输入下观察的低视觉多样性反映一个理想的特性,表明动作与视频之间具有精确的对应关系,并且与控制动态具有高度的一致性。

指标-人的一致性

为了验证提出的 EWMBench 的可靠性和任务相关性,将其与人类偏好评分和通用视频基准 VBench 进行比较分析。收集四个代表性模型(GE-Base、Kling-1.6(快手,2025)、Hailuo I2V-01-live(MiniMax,2024)和 OpenSora-2.0(Zheng,2024))生成的视频的人工注释,并使用排序协议,其中注释者根据感知的整体质量分配序数分数。排序结果会在注释者和样本之间汇总,并经过多轮审核以确保注释的一致性。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献211条内容

已为社区贡献211条内容

所有评论(0)