ActiveVLA:将主动感知融入视觉-语言-动作模型实现精准的三维机器人操作

26年1月来自复旦、上海创新研究院和南洋理工的论文“ActiveVLA: Injecting Active Perception into Vision-Language-Action Models for Precise 3D Robotic Manipulation”。近年来,机器人操作领域的进展利用预训练的视觉-语言模型(VLM),并探索将三维空间信号集成到这些模型中以实现有效的动作预测,由

26年1月来自复旦、上海创新研究院和南洋理工的论文“ActiveVLA: Injecting Active Perception into Vision-Language-Action Models for Precise 3D Robotic Manipulation”。

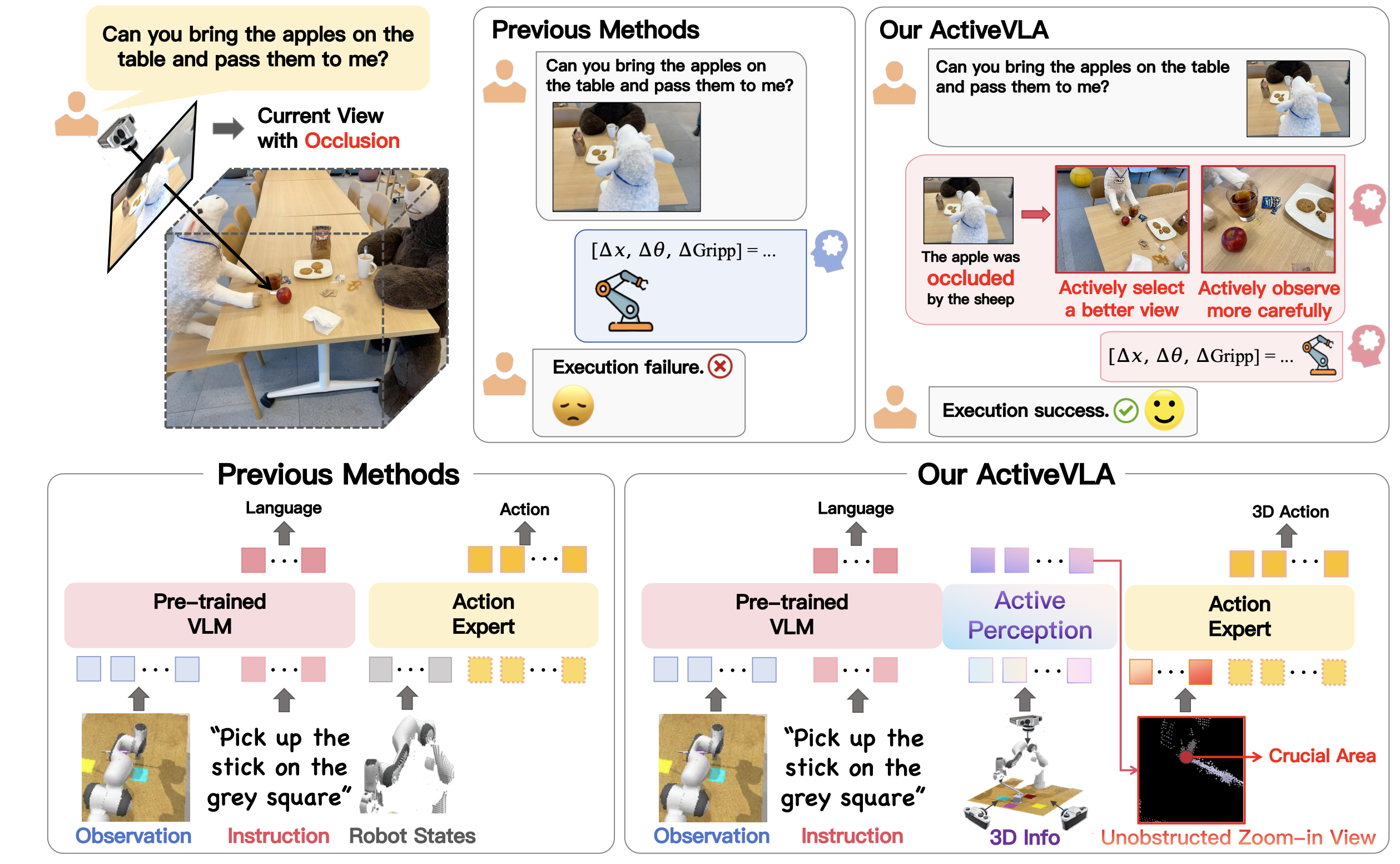

近年来,机器人操作领域的进展利用预训练的视觉-语言模型(VLM),并探索将三维空间信号集成到这些模型中以实现有效的动作预测,由此产生前景广阔的视觉-语言-动作(VLA)范式。然而,大多数现有方法忽略主动感知的重要性:它们通常依赖于静态的腕部摄像头,提供以末端执行器为中心的视角。因此,这些模型无法在任务执行过程中自适应地选择最佳视角或分辨率,这显著限制它们在长时程任务和精细操作场景中的性能。为了解决这些局限性,ActiveVLA,是一个视觉-语言-动作框架,赋予机器人主动感知能力,从而实现高精度、精细的操作。 ActiveVLA采用由粗到精的范式,将处理过程分为两个阶段:(1)关键区域定位。ActiveVLA将3D输入投影到多视角2D投影上,识别关键3D区域,并支持动态空间感知。(2)主动感知优化。基于定位的关键区域,ActiveVLA采用主动视图选择策略来选择最佳视角。这些视角旨在最大化非模态相关性和多样性,同时最小化遮挡。此外,ActiveVLA还应用3D放大来提高关键区域的分辨率。这些步骤共同实现更精细的主动感知,从而实现精确操作。ActiveVLA能够实现精确的3D操作,并在三个仿真基准测试中优于现有最先进的基线方法。此外,ActiveVLA 可以无缝过渡到现实世界的场景,使机器人能够在复杂的环境中学习高精度任务。

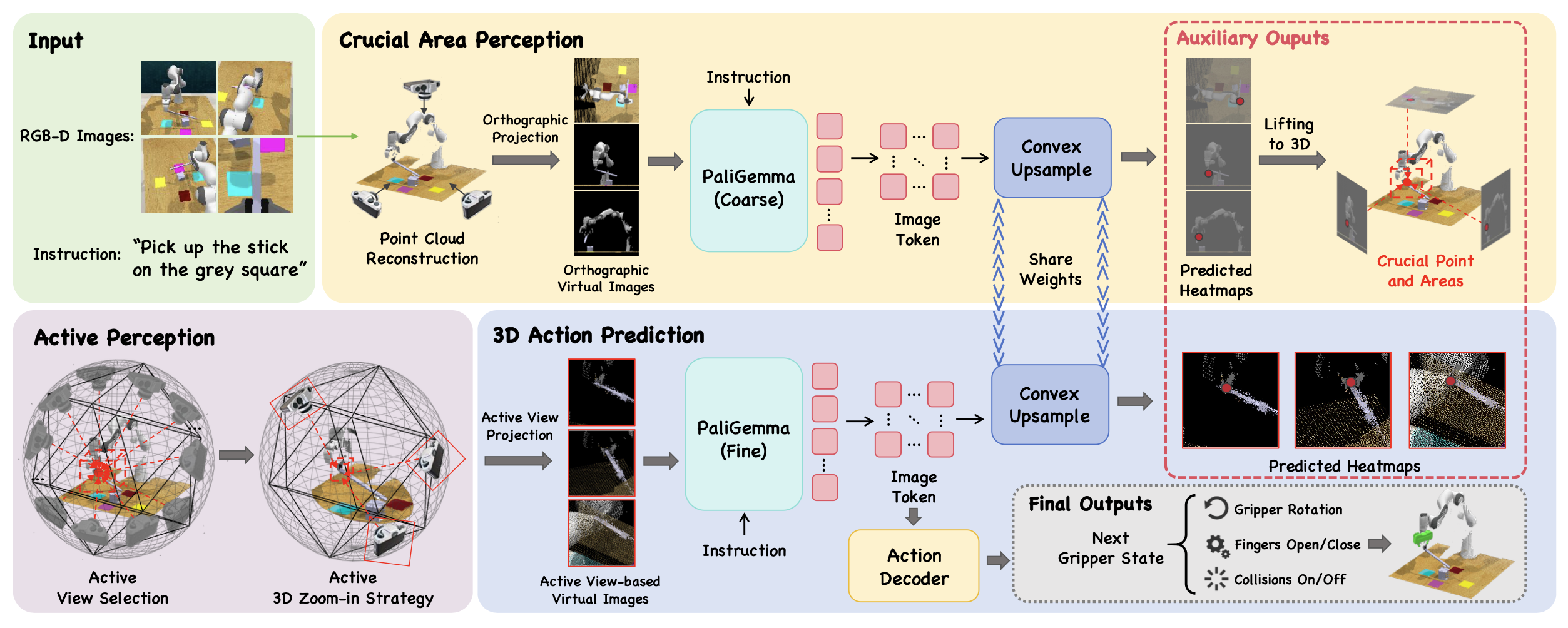

如图所示,ActiveVLA 采用由粗到精的主动感知设计,将 3D 空间推理与视觉语言理解相结合。在粗略阶段,ActiveVLA 将 3D 点云观测值投影到多个 2D 正交视图 [17, 18],并使其与预训练的 VLM 骨干网络对齐。通过利用 3D 输入中的结构先验信息,该模型能够有效地定位 3D 空间中显著且与任务相关的区域。在精略阶段,ActiveVLA 执行主动视图选择,以确定以这些关键区域为中心的最佳相机姿态,从而最大化非模态相关性和空间多样性,同时减少遮挡。然后,它应用主动 3D 放大策略来增强这些区域的空间分辨率,从而实现对精细细节的精确操作。这种闭环的、由粗到精的感知-动作管道使 ActiveVLA 能够动态地调整其传感器输入,并在复杂的、多步骤的、长时程的操作任务中保持高效。

VLA设置。视觉-语言-动作模型旨在学习一个可泛化且鲁棒的多任务机器人操作策略π。该策略将观测值o和语言指令l映射到动作a:

π : (o, l) → a

动作a由一个6自由度末端执行器位姿T、一个夹爪状态g ∈ {0,1}以及下一个关键帧的碰撞标志c ∈ {0, 1}组成。此设置假设可以访问包含N条轨迹的专家演示D = {τi},其中每条轨迹包含一条语言指令和一系列观测值-动作对,即τi = {li, (oi_1, ai_1), …, (oi_H, ai_H)}。观测值o包含从一个或多个固定的、以末端执行器为中心的视角捕获的RGB-D图像。然而,这种设置限制感知灵活性,因为它无法动态调整视角或分辨率,从而阻碍了上下文获取和策略泛化。

如图所示,ActiveVLA 通过一个由粗到精的主动感知框架来解决感知灵活性的限制。该框架能够根据任务上下文自适应地调整摄像头的视角和缩放级别,从而增强场景探索并促进精细交互。通过将 3D 空间推理与视觉语言理解相结合,我们的方法逐步细化感知焦点,从宏观概览到任务关键区域,从而增强上下文感知和泛化能力。ActiveVLA 使机器人能够关注关键的 3D 区域并主动感知环境,从而实现自适应视角和缩放,以进行精细操作。

在每个任务中,ActiveVLA 首先识别 3D 场景中的核心区域,作为主动感知的焦点。

多视图渲染。给定 RGB-D 图像作为视觉输入,ActiveVLA 使用标定相机拍摄的图像重建场景的点云。为了匹配 VLM 主干网所需的 2D 图像输入,从顶部、正面和右侧视角渲染点云的三个正交投影图像。具体来说,对于每个视角,渲染三个图像图,总共包含 7 个通道:RGB 通道、深度通道和点在世界坐标系中的坐标(3 个通道)。这些坐标有助于建立不同视角之间像素的对应关系,即,如果来自不同视角的像素具有相同的 (x, y, z) 坐标,则它们对应于 3D 空间中的同一个点。

3D关键区域提取。这些图像随后被用作VLM主干网络的输入,该网络旨在处理图像以及相应的文本提示。由于VLM的全局表示不足以进行精确的空间定位,引入一个热图预测模块来恢复细粒度的空间注意并识别每个视图中的物体位置。为了预测热图,首先根据输出图像块token {t_i} 的空间位置重新排列,形成一个特征网格。然后,对特征网格应用一个凸上采样模块,以获得与输入图像分辨率相匹配的热图。

该流程使用交叉熵损失进行训练,以预测热图,然后从所有视图进行反投影,以识别关键的 3D 区域。

ActiveVLA 能够实现主动感知,使机器人能够执行精细操作。它包含两个组件:主动视点选择和主动 3D 缩放。

主动视点选择。为了提高复杂场景中的感知完整性,ActiveVLA 提出一种假设检验策略来选择主动视图,该策略专注于以粗略阶段识别的关键区域为中心的最佳相机视点。其目标是通过确保目标物体的完全可见性和增加视图多样性来最大化非模态相关性。这些目标共同通过互补观测来减少遮挡和感知歧义。给定感兴趣的 3D 关键区域 p_f (例如,部分观测的物体质心),生成一组候选相机位置,这些位置均匀分布在以 p_f 为中心的球体周围。为了实现各向同性覆盖,采用一种基于正二十面体(icosahedron)递归细分的测地线采样策略,从而在球面上生成近乎均匀的点分布。这避免了经纬度参数化中固有的采样偏差,并通过细分级别实现对视点密度的可扩展控制。

选择得分最高的 K 个视图作为下一个观测姿态。每个相机都使用注视公式进行配置,包括眼睛坐标 c_i、目标坐标 p_f 和一个动态调整的向上向量。这些视图能够提供信息丰富且无遮挡的观测结果,支持稳健的多视图推理和精确操作,其中信息量最大的视图将作为主动 3D 放大的基础。

主动 3D 放大。以往的 VLA 模型依赖于机器人周围的固定相机视图,这通常无法捕捉到足够多的细节,无法完成涉及小型物体的精细任务(例如,使用焊枪焊接一个孔)。为了克服这一局限性,ActiveVLA引入一种主动式3D放大机制,能够自适应地优化关键交互区域周围的视觉感知。在选择最佳视角后,系统会以相同的相机姿态,缩小视场角,重新渲染场景,从而有效地放大局部区域,同时保持高像素分辨率,以实现精确的机械臂姿态预测。这模拟虚拟渲染空间中的光学变焦效果,使得在不损失视觉保真度的情况下,能够对小尺度结构进行精细观察。设α表示原始视场角(以弧度为单位),z > 1表示放大倍数,d表示相机到感兴趣区域的距离。

放大过程利用三维点云进行尺度不变的视图合成,且不会造成几何损失。与固定物理相机不同,虚拟渲染器基于局部三维结构生成高分辨率特写,从而提高机械臂姿态精度。通过将探索(视图选择)与利用(放大)分离,ActiveVLA 形成一种分层感知策略,提高操作精度,并突显自适应观察在仿真-到-真实VLA 系统中的优势。

在获得主动选择和放大视图后,将它们输入到 VLM 中以生成注意热图。对于平移预测,这些 2D 热图被反投影到 3D 工作空间,并在离散化网格 G = {g_1, . . . , g_N } 上累积,以形成多视图分数体。

然后,分层特征融合模块将全局和局部上下文整合起来,以预测旋转、夹爪状态和二元碰撞标志。

全局上下文编码:对每个正交投影的视觉编码器输出进行最大池化,以获得每个视图的全局特征向量,从而生成三个全局tokens,用于捕捉场景的整体语义。

局部上下文编码:为了进行细粒度推理,用 ROI 感知采样器提取局部token,对细节外观和几何形状进行编码。

所有token被连接起来,并通过多层感知器 (MLP) 头进行预测,以预测旋转、夹爪和碰撞动作。这种全局-局部融合使模型能够将整体场景理解与精细的空间精度相结合,从而在复杂环境中实现精确且安全的操作。

仿真基准测试。用三个仿真基准测试来评估 ActiveVLA 在长时域和细粒度操作方面的表现。RLBench [23] 包含 18 个任务,使用 Franka Panda 机器人,每个任务使用来自四个校准摄像头的 RGB-D 输入,并进行 100 次演示。COLOS-SEUM [48] 在 RLBench 的基础上扩展 12 种扰动类型,涉及物体、场景和摄像头的变化,用于评估鲁棒性。GemBench [14] 在 RLBench 的基础上进一步构建,成为一个分层基准测试,包含 16 个训练任务和 44 个测试任务,涵盖七个核心动作基元,用于评估组合性和泛化能力。

实现细节。ActiveVLA采用BridgeVLA [33] 中预训练的VLM骨干网络,该骨干网络基于PaliGemma [3],并结合了SigLIP编码器 [63] 和Gemma解码器 [53],在包含12万张图像的RoboPoint子集 [61] 上进行了预训练。在配备RealSense D455摄像头的KI-NOVA GEN2机器人上进行真实世界实验,实验采用眼手交互设置,涵盖遮挡较多的操作任务。所有实验均在配备8个NVIDIA H100 GPU和192个vCPU的Intel Xeon Platinum 8468系统上运行。

基线模型。将ActiveVLA与最先进的基线模型进行比较。Image-BC (CNN/ViT) [25] 使用卷积或Transformer骨干网络执行二维行为克隆。 C2F-ARM-BC [24] 和 PerAct [52] 分别采用基于体素的粗到精策略和感知器 Transformer 策略。HiveFormer 通过多模态 Transformer 集成历史观测数据,而 PolarNet [49] 对 3D 场景进行编码以预测热图和偏移量。Act3D [16] 对 3D 点进行采样和排序以进行动作选择,而 3D Diffuser Actor [28] 通过扩散对 3D 轨迹进行建模。RVT [17] 和 RVT-2 [18] 在粗到精的 Transformer 框架中聚合多视图投影,而 BridgeVLA [33] 对齐 2D 热图以实现高效的 3D 视觉-语言-动作学习。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献209条内容

已为社区贡献209条内容

所有评论(0)