具身智能1.4 :延迟与噪声-物理世界的真实挑战(不同于 Token 的离散完美性)。

1.在 20 分钟的通信闭环里,你发出的指令是基于“过去”的状态(10分钟前),执行的动作将发生在“未来”(10分钟后)。因为仿真器里的物理引擎(Physics Engine)是基于简化公式的,它无法完美模拟现实世界中复杂的空气动力学、软体形变、温度对电路的影响,以及延迟和随机噪声。我们在仿真器(Simulation)里训练机器人时,就像在一个没有延迟、没有噪声的完美真空中。你看到敌人,开枪,但什

1. 从“上帝视角”跌落凡间:离散 vs. 连续

在纯粹的数字世界里,一切都是离散且完美的。 当你在 Python 里写下 a = 5,a 永远是 5,不会是 4.999,也不会在 10 毫秒后才变成 5。当你输入一个 Token,Transformer 接收到的就是这个确定的整数 ID。在这个世界里,时间是逻辑步数(Step),没有物理时钟。

但在具身智能的世界里,机器人面对的是物理定律:

-

没有完美的值(噪声): 传感器读数永远在跳动,电机永远无法精确输出你指令的扭矩。

-

没有瞬间的动作(延迟): 光速是快的,但电路、计算、机械传动是慢的。

核心洞察: 在 LLM 中,错误通常源于逻辑(Hallucination);在机器人中,错误往往源于物理(Physics)——即使逻辑完全正确,延迟和噪声也能让系统崩溃。

2. 延迟(Latency):隐形的杀手

想象你在玩一个网络延迟极高的射击游戏(Ping 值 500ms)。你看到敌人,开枪,但什么也没打中,因为你看到的“敌人”其实是 0.5 秒前的残影。

机器人无时无刻不在玩这个“高延迟游戏”。

具身系统的“总延迟”构成:

一个典型的 Sense-Act 循环,延迟 () 由以下部分串联而成:

-

感知延迟 (

):光线进入摄像头

曝光

读出数据

传输到内存。这通常需要 30ms - 100ms。

-

计算延迟 (

):神经网络推理(Inference)。如果你用大模型做决策,这里可能高达 200ms甚至数秒。

-

传输延迟 (

):CPU/GPU 将指令发给底层控制器(如 CAN 总线、Ethernet)。

-

机械延迟 (

):这是最容易被忽视的。电流流过线圈,电机产生磁场,克服静摩擦力,齿轮咬合,最后手臂真正动起来。物理惯性导致了必然的滞后。

为什么延迟会引发灾难?

在控制理论中,延迟会导致相位滞后(Phase Lag)。 假设机器人要抓取一个移动的物体。如果没有延迟,它能实时跟踪。加上延迟后,当机器人“看到”物体偏左并试图向左修正时,物体可能已经回到中间了。结果机器人向左猛冲,发现偏得更远了,又向右猛冲……

这就是可怕的震荡(Oscillation)。在极端情况下,系统会发散(Diverge)——机器人会剧烈抖动直至把自己拆散。

3. 噪声(Noise):世界充满了谎言

如果说延迟是“迟钝”,那噪声就是“幻觉”。在物理世界中,没有任何测量是绝对准确的。

A. 观测噪声(Observation Noise)

你的眼睛(摄像头)和耳朵(麦克风)都在“撒谎”。

-

深度相机(Depth Camera): 对着一面白墙或反光镜子,你会看到很多黑洞或错误的距离值。

-

激光雷达(LiDAR): 雨雪雾天会产生大量的噪点。

-

IMU(惯性测量单元): 哪怕机器人静止不动,加速度计读数也会在 0附近疯狂跳动(高斯白噪声)。

数学上,我们不再说观测值 等于真实状态

,而是:

B. 执行噪声(Process/Actuation Noise)

你想走直线,但你走不出直线。

-

摩擦力不均: 地面一边滑一边涩。

-

电机死区: 只有电压超过一定阈值,电机才会转动。

-

磨损与间隙: 齿轮之间的空隙(Backlash)导致你指令转 1 度,实际轮子没动。

数学上,下一个状态 不仅仅由当前状态

和动作

决定:

这意味着,具身智能不仅要规划(Plan),更要推断(Infer)和修正(Correct)。 这也是为什么我们在后面章节需要学习“卡尔曼滤波”和“概率机器人学”的原因。

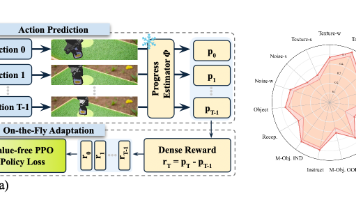

4. 具身智能的应对之道:Sim-to-Real Gap

这引出了具身智能领域最著名的问题:Sim-to-Real Gap(虚实迁移鸿沟)。

我们在仿真器(Simulation)里训练机器人时,就像在一个没有延迟、没有噪声的完美真空中。机器人在仿真里学会了跑酷,但一部署到真机上,往往会像醉汉一样摔倒。

为什么? 因为仿真器里的物理引擎(Physics Engine)是基于简化公式的,它无法完美模拟现实世界中复杂的空气动力学、软体形变、温度对电路的影响,以及延迟和随机噪声。

正因为延迟和噪声的存在,导致了具身智能的技术栈必须极其复杂:

-

因为有延迟,我们不能指望 AI 像回合制游戏一样思考。我们需要高频控制(50Hz ~ 1000Hz)和预测未来(第9章:世界模型)。

-

因为有感知噪声,我们不能直接信赖传感器。我们需要滤波算法(卡尔曼滤波)来融合多传感器数据,从噪声中提取真相。

-

因为有执行噪声,我们不能只做开环规划。我们需要闭环反馈(PID和鲁棒性策略(RL)来不断修正误差。

ChatGPT 犯错可能只是说了一句胡话;机器人犯错(由于延迟或噪声),可能会撞碎玻璃、损坏自身,甚至伤害人类。

习题

假设你正在通过远程操控(Teleoperation)控制一台位于火星的探测车。

-

地球到火星的信号传输延迟约为 10 分钟(单程)。

-

问题: 为什么你不能像玩赛车游戏一样实时控制它?如果探测车前方 5 米处突然出现悬崖,而在你的屏幕上探测车还在平地上行驶,会发生什么?

-

进阶: 这种情况下,探测车应该具备什么样的“自主权(Autonomy)”才能生存?(提示:思考 Reflex System 与 Conscious System 的区别)。

1.在 20 分钟的通信闭环里,你发出的指令是基于“过去”的状态(10分钟前),执行的动作将发生在“未来”(10分钟后)。如果你的屏幕显示前方平坦,实际火星车可能已经到了悬崖边。当你看到悬崖并按下“停止”键时,指令传到火星又是 10 分钟后了——此时车早已坠毁。

2.

地球端(High-Level): 人类不发送具体的电机指令(如“左轮转速 50rpm”),而是发送任务指令(如“移动到坐标 [x,y] 处的岩石”)。

火星车端(Low-Level / Real-time): 必须具备局部自主权(Local Autonomy)。它需要一个高频的本地反射弧(Reflex Loop),利用本地传感器(激光雷达/视觉)实时检测障碍。一旦检测到悬崖,无论人类有没有指令,必须立即覆盖(Override)原有路径,触发急停或避障。

这就是具身智能中的“系统快慢思考”。底层控制必须极快且就在本地(脊髓反射),高层规划可以慢且在云端/大脑(皮层思考)。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献4条内容

已为社区贡献4条内容

所有评论(0)