JRDB数据集介绍

JRDB 是一个面向真实机器人应用、强调第一视角、遮挡严重、尺度变化极端的2D 标注规模极大的数据集。特别适合用于多目标跟踪(MOT)、遮挡建模、群体行为建模以及Egocentric MOT 方法研究。

引言:

JRDB(JackRabbot Dataset and Benchmark)是一个以机器人第一视角(egocentric view)为核心的人类感知数据集,专门面向人类环境中的行人检测与跟踪任务。

与传统自动驾驶数据集(如 KITTI、nuScenes)不同,JRDB 的目标场景是:

①室内(教学楼、走廊、咖啡厅)

②室外(校园道路、广场、人行道)

③高密度人群

④强遮挡

⑤机器人在“人类高度”的第一视角移动

论文明确指出,现有数据集严重低估了真实人类环境中 2D 感知的难度,尤其是在:

①行人近距离出现(2D 框巨大)

②行人被频繁遮挡

③视角快速变化(机器人移动)

JRDB 的核心价值是为 2D / 3D 行人检测与多目标跟踪提供一个更接近真实社交机器人应用场景的数据集。

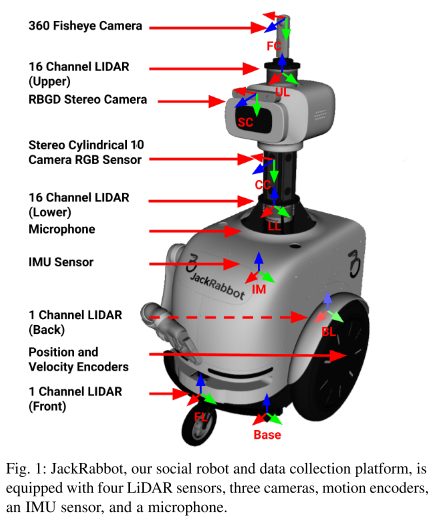

传感器平台:

JRDB 数据由社交机器人 JackRabbot 采集,搭载多模态传感器。

与 2D 直接相关的传感器:

①360° 柱面 RGB 相机系统:由 5 个 RGB 相机组成一排;由 5 个 RGB 相机组成一排;多相机拼接成 360° 柱面全景图像;帧率为15 FPS

②鱼眼相机(360°):分辨率为1280 × 720(15 FPS)

③RGB-D 相机(ZED):分辨率为672 × 376(15 FPS)

2D 标注真正使用的是哪一个:

当前版本只对“柱面 360° RGB 相机的上排图像”进行 2D 标注

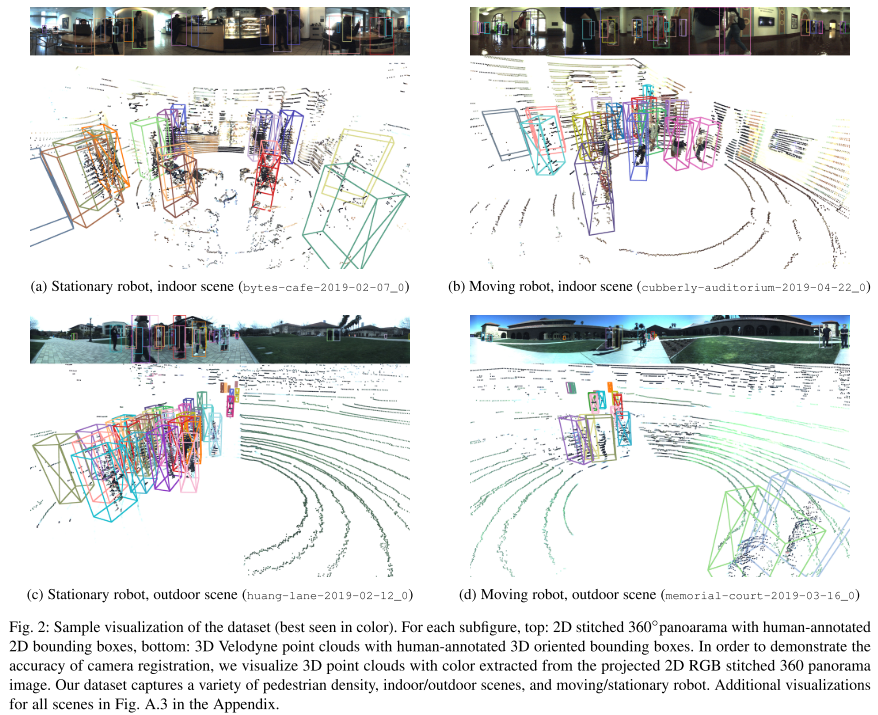

数据采集:

场景规模:

总时长:64 分钟

序列数:54 个;包含室内33个,室外21个

机器人状态:移动的为32个,静止的为22个

2D 视觉数据形式:

JRDB 提供两种 2D 图像视角:

①原始单相机图像:来自 5 个独立 RGB 相机

②拼接后的 360° 柱面图像:常用于训练与评测

2D 重点解读:

与 MOT、BDD100K 不同,JRDB 的 2D 图像是非平面视角,横向极宽(约 3760×480),包含前、侧、后方行人。

标注与标签:

标注流程:

标注采用 “3D 先行 → 投影到 2D → 人工精修” 的方式

过程:

①在 LiDAR 点云中标注 3D 行人框

②投影到每个 RGB 相机

③人工修正 2D 边界框

④合并为 360° 柱面图像中的 2D 框

⑤从 7.5Hz 插值到 15Hz

这保证了 2D 框的时序一致性非常强

2D Bounding Box 标注:

2D 标注内容包括:

label_id:每个行人一个唯一 ID;跨时间 + 跨相机一致

box:左上角坐标 (u, v);宽高 (w, h)

occlusion(遮挡等级):Fully visible、Mostly visible、Severely occluded、Fully occluded

truncated:是否被图像边界截断

area:框的像素面积

interpolated:是否为插值帧

no_eval:是否参与benchmark评测

2D 重点解读:

JRDB 是少数明确提供“遮挡等级标签”的大规模 2D 行人数据集,非常适合研究遮挡鲁棒检测与复杂人群中的跟踪稳定性。

数据划分与统计:

数据划分:

Train + Validation:27 个序列

Test:27 个序列

室内 / 室外、移动 / 静止比例保持一致

2D 数据规模:

| 项目 | 数量 |

| 2D Bounding Boxes | 约 240 万 |

| 2D Tracks | 约 3500 条 |

| 平均轨迹长度 | ≈ 500 帧 |

对比:

超过 MOT17,接近甚至超过 MOT20,但视角更复杂、遮挡更严重。

JRDB 的独特性:

对 2D 任务的挑战:

①极端尺度变化,行人距离机器人 1m → 80m

②长时间遮挡,比 MOT 系列更严重

③第一视角几何畸变,360° 柱面展开导致非线性形变

④室内复杂背景,桌椅、楼梯、墙体

2D 重点解读:

JRDB 的 2D 检测/跟踪失败,往往不是因为“模型太弱”,而是因为数据本身比传统 benchmark 更接近真实机器人部署环境。

总结:

JRDB 是一个面向真实机器人应用、强调第一视角、遮挡严重、尺度变化极端的2D 标注规模极大的数据集。特别适合用于多目标跟踪(MOT)、遮挡建模、群体行为建模以及Egocentric MOT 方法研究。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)