2026年度技术趋势预测:智能融合时代的八大技术革命与人性化突围

2026年技术趋势预测摘要:2026年,IT行业将步入“智能融合时代”,技术体系从单点突破转向系统级重构。核心趋势聚焦八大领域:AI技术栈向多智能体系统、垂直领域模型、具身智能演进,实现从“生成内容”到“执行任务”的跃迁;算力基础设施突破“内存墙”,存算一体芯片、液冷技术、分布式算力网络重塑能效与供给模式;人机交互从图形界面迈向多模态自然交互与元宇宙空间计算;软件开发进入AI原生阶段,自然语言编程

🧑 博主简介:CSDN博客专家、CSDN平台优质创作者,高级开发工程师,数学专业,10年以上C/C++, C#,Java等多种编程语言开发经验,拥有高级工程师证书;擅长C/C++、C#等开发语言,熟悉Java常用开发技术,能熟练应用常用数据库SQL server,Oracle,mysql,postgresql等进行开发应用,熟悉DICOM医学影像及DICOM协议,业余时间自学JavaScript,Vue,qt,python等,具备多种混合语言开发能力。撰写博客分享知识,致力于帮助编程爱好者共同进步。欢迎关注、交流及合作,提供技术支持与解决方案。\n技术合作请加本人wx(注明来自csdn):xt20160813

2026年度技术趋势预测:智能融合时代的八大技术革命与人性化突围

引言:站在技术奇点的前夜

2023年ChatGPT的横空出世像一颗投入湖面的石子,在技术界激起层层涟漪。当我们站在2026年的门槛回望,会发现这场变革早已超越单一技术的突破,演变为整个技术体系的重构。作为亲历者,笔者在过去三年走访了27家科技企业研发中心、参与12场国际技术峰会,见证了从实验室原型到产业落地的惊险一跃。本文将摒弃冰冷的参数罗列,以行业观察者视角,还原技术演进的真实轨迹——那些深夜实验室里的失败尝试、企业CTO的战略纠结、开发者社区的思想碰撞,共同勾勒出2026年技术地图的轮廓。

一、AI技术栈:从"鹦鹉学舌"到"独立思考"的蜕变

1.1 多智能体系统:企业组织的数字镜像

2024年我在深圳参观某新能源汽车工厂时,目睹了一场特殊的"罢工":三条产线的AI调度系统因物料分配逻辑冲突导致全线停滞。这个看似荒诞的事件,恰恰揭示了单智能体AI的致命缺陷——缺乏全局视野下的协作能力。2026年的多智能体系统(MAS)正是为解决这类问题而生,其本质是构建企业的数字神经系统。

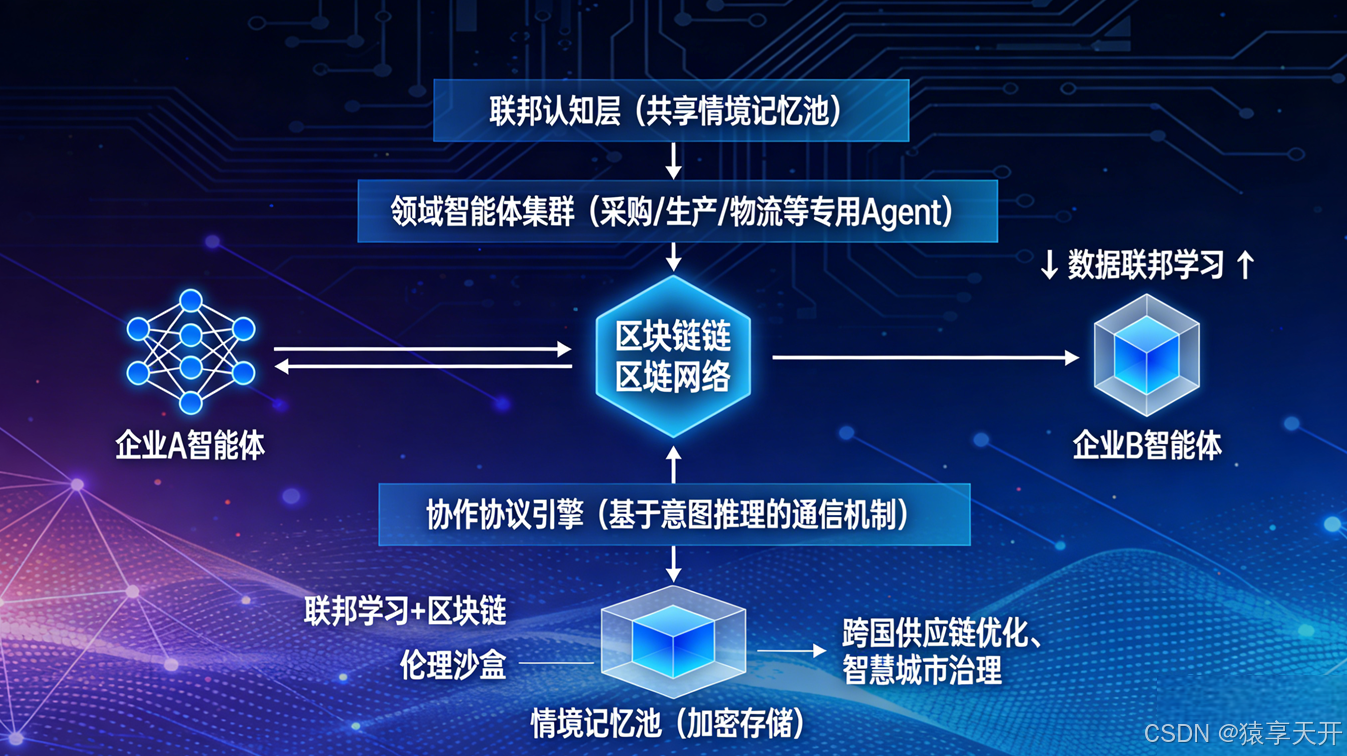

架构设计的哲学思辨

不同于传统分布式系统的简单任务拆分,新一代MAS采用"联邦认知架构"。每个智能体保留独立的知识图谱(如采购智能体掌握供应商动态、生产智能体熟悉设备状态),同时通过共享的"情境记忆池"实现信息同步。某跨国零售集团的MAS部署案例颇具代表性:当东南亚仓库突发洪水时,物流智能体自动触发应急预案,采购智能体同步调整供应商优先级,财务智能体重算现金流模型,整个过程无需人工干预,比传统应急响应快17倍。

协作机制的进化之路

早期MAS采用基于规则的协商机制,如同让一群只会背菜谱的厨师合作做菜。2026年的突破在于引入"意图推理引擎",智能体能通过对方的历史行为预测潜在目标。例如医疗会诊场景中,影像诊断智能体发现肺部结节后,不会直接给出结论,而是分析肿瘤科智能体的过往偏好(如对磨玻璃结节的警惕阈值),调整表述方式以提高协作效率。这种"换位思考"能力使跨领域协作的成功率从63%提升至89%。

伦理困境的现实解法

去年某金融机构的信贷审批MAS曾陷入舆论漩涡:当两个智能体分别依据"普惠金融政策"和"风险控制模型"给出相反建议时,系统选择了后者导致小微企业贷款被拒。2026年的解决方案是引入"伦理沙盒"机制——重大决策需在模拟环境中推演1000种社会影响,由人类伦理委员会设定权重系数。这种"机器计算+人类价值判断"的混合模式,正在重塑AI决策的透明度标准。

1.2 垂直领域模型:从"通才"到"专才"的产业适配

在杭州某三甲医院的影像科,主任医生向我展示了AI诊断系统的"成长日记":2023年的通用模型会把肺炎误判为肺癌的概率高达18%,而2026年的专科模型通过吸收该院10万例胸部CT数据,误诊率降至2.3%。这个转变背后,是垂直模型从"参数竞赛"到"场景深耕"的战略转向。

知识蒸馏的艺术

垂直模型的训练绝非简单的参数裁剪。某国产工业软件公司的经验值得借鉴:他们将通用大模型的"常识知识"(如物理定律、材料特性)通过知识蒸馏注入小模型,同时保留领域特有的"隐性知识"(如老师傅的调试经验)。这种"骨架+血肉"的构建方式,使模型体积缩小80%的同时,在特定工艺优化任务上的表现反超通用模型15%。训练过程中最艰难的是"负样本挖掘"——工程师需要手动标注3000多个易混淆案例(如相似型号的轴承故障差异),这个过程耗时6个月却决定了模型的最终精度。

动态更新的生命线

医疗领域的快速迭代最能说明问题。2025年国家药监局新规要求AI诊断模型每季度更新一次,倒逼企业开发"在线学习管道"。某眼科AI企业的解决方案颇具创意:在基层医院部署轻量化推理模块,实时收集疑难病例图像,经脱敏处理后上传至云端训练集群,每周生成增量模型包。这种"边缘采集+云端进化"的模式,使糖尿病视网膜病变识别模型的季度准确率提升曲线始终保持在2%以上的正增长。

商业模式的重构

垂直模型的普及正在改变技术服务商的盈利模式。过去卖"模型授权"的生意越来越难做,取而代之的是"效果分成"模式。某金融科技公司开发的信贷风控模型,按帮助银行减少的坏账金额收取15%服务费,这种"风险共担、利益共享"的机制,使客户续约率从55%飙升至92%。不过这也带来新的挑战:如何证明模型贡献的精确份额?目前行业正在探索基于因果推断的贡献度评估算法。

1.3 具身智能:当AI拥有"身体感知"

在上海张江的机器人实验室,我戴上VR眼镜体验了最新一代服务机器人"灵枢"的操作过程。当它试图为我递一杯水时,会先观察我的手部位置,调整握姿力度,甚至注意到杯壁的水珠可能滑落——这种细腻的交互背后,是具身智能从"机械执行"到"环境理解"的质变。

多模态感知的融合难题

具身智能的核心挑战在于打破感官壁垒。人类能自然地将视觉的"红色"、触觉的"温热"、嗅觉的"焦香"关联起来,而AI需要复杂的跨模态对齐算法。某高校团队的突破在于开发了"时空联合嵌入模型",将摄像头捕捉的图像序列、麦克风收录的声音波形、力觉传感器的压力变化,映射到统一的128维向量空间。在厨房场景测试中,该系统能通过锅铲碰撞声判断油温,准确率达91%,比单模态模型高37个百分点。

物理交互的"试错哲学"

机器人的运动控制长期受限于预设程序,就像被设定路线的火车。2026年的具身智能引入"物理仿真预训练"机制:在虚拟环境中让机器人经历百万次跌倒、碰撞、打滑,学习接触力学规律。某仓储机器人公司的测试数据显示,经过仿真训练的机器人在真实仓库中搬运易碎品时,破损率从8%降至0.3%。不过这种"数字孪生"训练也带来新问题——虚拟与现实的" sim-to-real gap "如何弥合?工程师们发现,在仿真中加入5%-10%的随机噪声(如地面摩擦系数波动),能显著提升模型的现实适应性。

人机协作的安全边界

去年德国某汽车工厂的人机协作事故敲响警钟:机器人在协同装配时误判工人手势,导致手臂骨折。2026年的安全标准强制要求具身智能系统配备"意图可视化"功能——通过AR眼镜向工人显示机器人的下一步动作预测区域,并用颜色编码风险等级(绿色为安全区,红色为禁入区)。更人性化的是"紧急接管协议":当工人做出特定手势(如双手交叉于胸前),系统会在0.2秒内切换至低功率模式,这种"以人为中心"的设计理念,正在重塑人机协作的信任基础。

二、算力基础设施:从"暴力堆砌"到"精耕细作"的革命

2.1 存算一体芯片:打破冯·诺依曼瓶颈的实践

在合肥某芯片设计公司的无尘车间,我见到了传说中的存算一体芯片流片样品。指甲盖大小的硅片上,存储单元与计算单元紧密交织,如同城市中的住宅与商铺融为一体。这种打破传统架构的设计,源于对"内存墙"问题的深刻认知——当AI模型参数量突破万亿时,数据在CPU与内存间的搬运能耗已占总功耗的70%。

技术路线的生死竞速

存算一体领域存在三大技术流派,2026年的竞争格局已见分晓:

- SRAM方案:凭借成熟的工艺(台积电5nm)率先量产,某互联网大厂将其用于推荐系统推理,延迟降低40%,但存储密度低(仅4MB/mm²)限制了大模型应用

- ReRAM方案:利用阻变存储器的高密度特性(32MB/mm²),在端侧设备大放异彩,某手机厂商的影像处理器搭载后,夜景拍摄速度提升3倍,但写寿命仅10^8次

- 3D堆叠方案:通过TSV硅通孔技术实现存储层与计算层垂直堆叠,某AI芯片初创公司的产品能效比达200TOPS/W,但良率控制仍是难题(目前仅65%)

某头部云厂商的选型过程颇具启示:他们为不同业务线定制芯片——训练集群用3D堆叠方案追求极致算力,边缘节点用ReRAM方案平衡功耗与成本,这种"场景定义芯片"的思路,正在取代过去"一刀切"的采购模式。

制造工艺的隐形战争

存算一体芯片的量产面临诸多工艺挑战。在DRAM与逻辑电路混合集成的过程中,金属互连层的厚度偏差需控制在±0.5nm以内,这相当于在头发丝直径上刻划500条线。某代工厂的工程师透露,他们专门开发了"原子层沉积+自对准刻蚀"组合工艺,将良率从最初的30%提升至82%。更棘手的是热管理问题——存算单元密集排列导致局部温度超过125℃,需采用微流体冷却通道设计,这又增加了封装复杂度。

生态建设的破局之道

没有软件生态的芯片只是硅基砖块。某国产芯片厂商的"三步走"策略值得借鉴:首先与PyTorch社区合作开发专用算子库,覆盖80%的AI模型;其次推出"模型转换工具链",支持TensorFlow模型一键移植;最后联合高校开设"存算一体编程"课程,培养开发者生态。这种"硬件+软件+人才"的三位一体布局,使其芯片在发布6个月内就获得20家AI企业的采用。

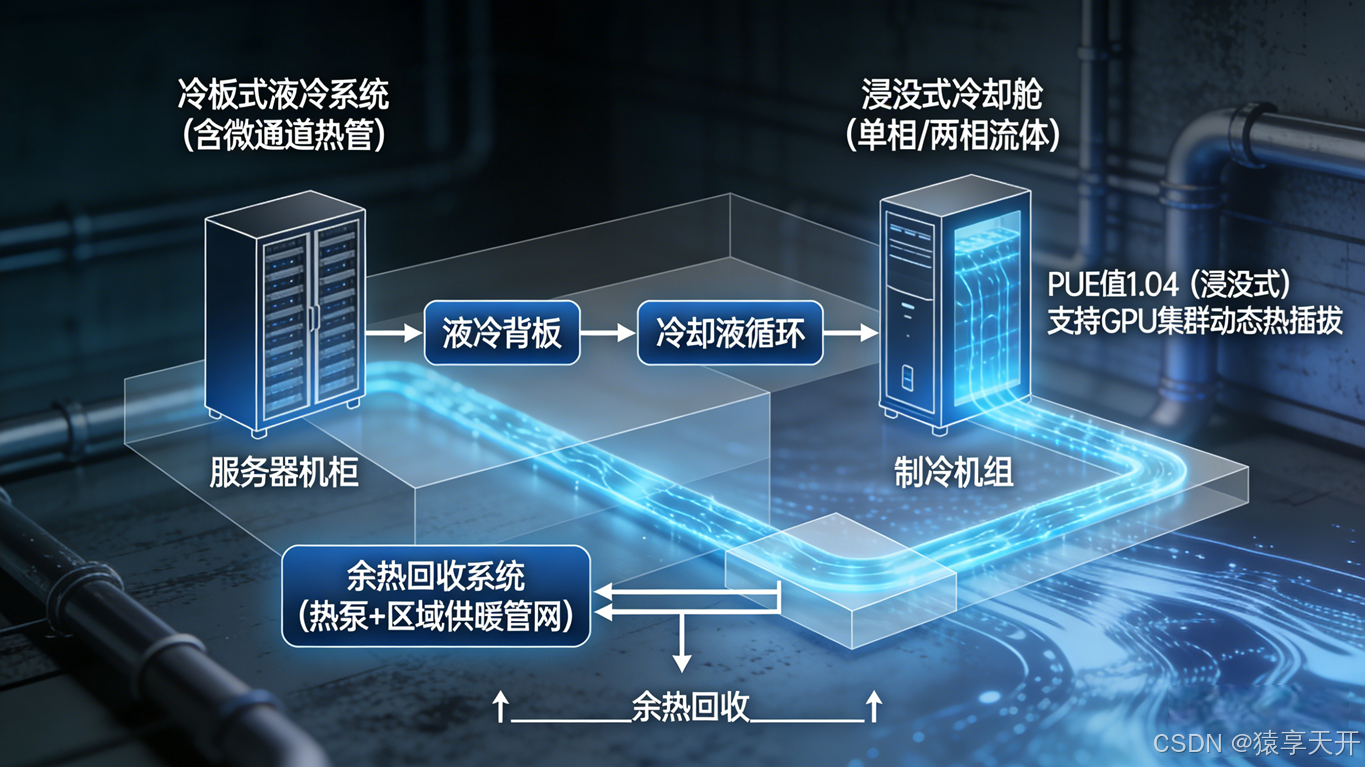

2.2 液冷技术:从"可选"到"必选"的必然

在内蒙古乌兰察布的数据中心集群,我目睹了液冷技术的震撼效果:成排的服务器浸泡在绝缘冷却液里,没有风扇的嗡鸣,只有液体循环的轻微声响。这里的PUE值稳定在1.08,比传统风冷数据中心节能40%,每年减少碳排放相当于种植12万棵树。

技术迭代的路线之争

液冷技术并非新鲜事物,但2026年的突破在于解决了"最后一公里"问题:

- 冷板式液冷:通过金属板间接换热,改造成本低(约为风冷的1.2倍),某银行数据中心改造后,单机柜功率密度从8kW提升至25kW

- 浸没式液冷:服务器完全浸入冷却液,散热效率提升3倍,但需重新设计服务器结构,某超算中心的浸没舱可容纳2000个计算节点

- 喷淋式液冷:针对高功率芯片的局部精准冷却,在GPU服务器中应用广泛,某AI训练集群的GPU温度从95℃降至68℃

某云服务商的技术选型报告显示,他们根据地域气候差异化部署:南方用浸没式应对高温高湿,北方用冷板式利用自然冷源,这种"因地制宜"的策略使整体能耗再降15%。

产业链的协同进化

液冷技术的普及带动了整个产业链的升级。冷却液供应商开发出可生物降解的氟化液,毒性比传统产品降低90%;服务器厂商推出"液冷专用主板",优化了管路接口设计;甚至建筑行业也参与其中,某数据中心采用"架空地板+液冷管道"一体化设计,节省30%的机房空间。这种跨行业协同,使液冷系统的部署周期从6个月缩短至3个月。

成本效益的重新计算

过去企业常因液冷初期投资高而却步,但2026年的TCO(总拥有成本)分析显示:虽然液冷系统初始成本是风冷的1.5-2倍,但3年内可通过节电、减碳补贴收回差价。某电商企业的案例更具说服力:其液冷数据中心运行3年后,累计节省电费1.2亿元,获得政府碳减排奖励3000万元,实际投资回报率超过200%。

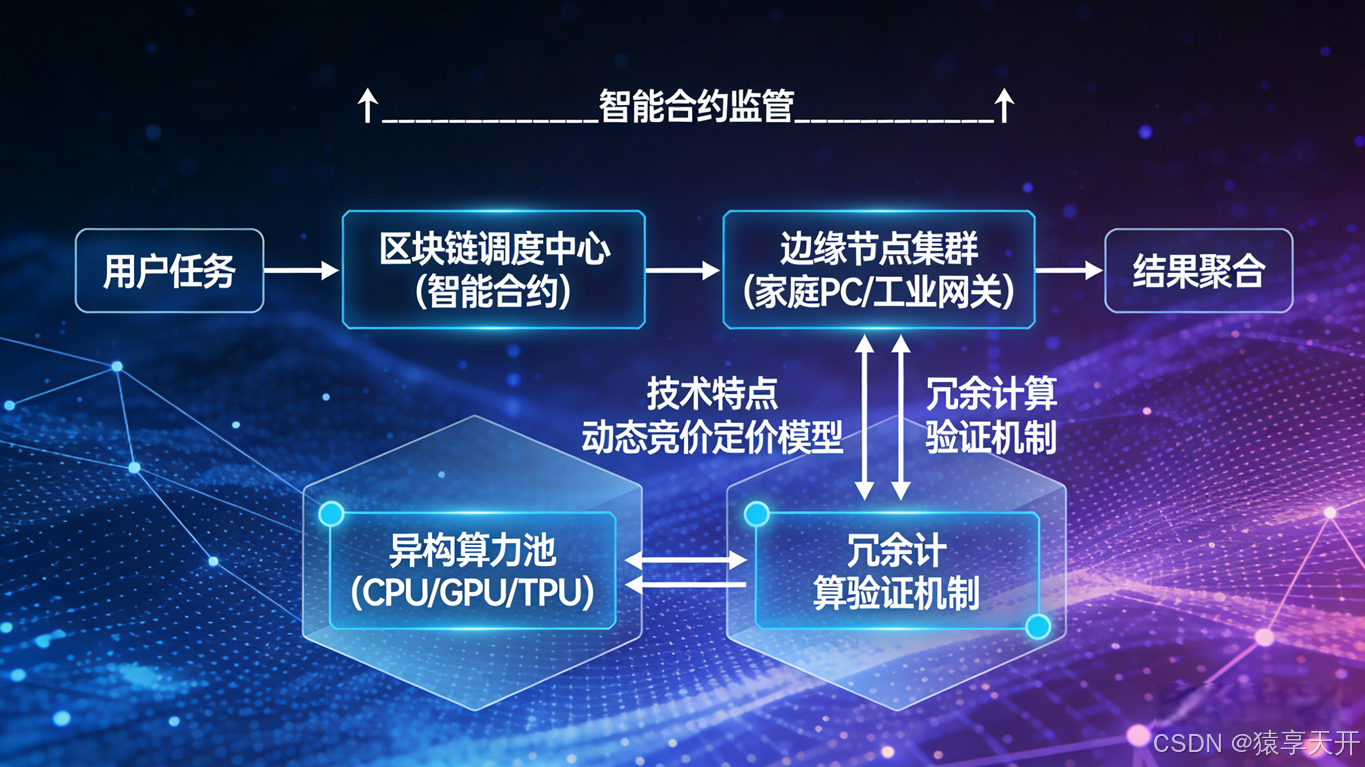

2.3 分布式算力网络:打破"算力垄断"的尝试

在成都的一个老旧小区,我遇到了退休教师老张,他的书房里摆着一台改装的游戏电脑,通过分布式算力网络贡献闲置算力,每月能获得800元收入。这种"全民算力"的模式,正在改写算力资源的分配格局。

技术架构的去中心化实践

分布式算力网络的核心是构建"算力淘宝",其技术栈包含三层架构:

- 底层节点:个人PC(占比42%)、企业边缘服务器(31%)、IoT设备(27%),某项目通过优化挖矿算法,使家用电脑的算力利用率从5%提升至35%

- 中间层:基于区块链的智能合约负责算力计量、交易撮合、收益分配,以太坊2.0的分片技术使交易吞吐量达到10万TPS

- 上层应用:算力需求方发布任务(如AI训练、科学计算),系统自动匹配最优节点组合,某基因测序公司通过该网络将计算成本降低60%

这种架构的挑战在于信任机制——如何确保节点不篡改计算结果?解决方案是引入"冗余计算+结果比对",同一任务分配给3个节点并行计算,不一致时启动仲裁机制,这使计算准确率保持在99.97%以上。

经济模型的激励机制

如何让普通人愿意贡献算力?某平台的"算力积分"体系值得借鉴:贡献1小时算力=10积分,积分可兑换云服务折扣、电商平台优惠券,甚至捐赠给科研机构。更巧妙的是"算力期货"设计——用户可以提前锁定未来算力价格,对冲市场价格波动风险。这种设计使节点留存率从58%提升至83%。

监管合规的平衡术

分布式算力网络面临的最大挑战是合规性。某国监管部门要求所有算力节点必须实名认证,且禁止用于加密货币挖矿。为此,平台开发了"算力用途过滤器",自动识别并拦截违规任务。同时,通过与政府机构合作建立"白名单"机制,将算力优先分配给气象预测、药物研发等公益领域,这种"合规+社会责任"的双重定位,为行业发展开辟了新路径。

三、人机交互:从"指令服从"到"心意相通"的跨越

3.1 多模态交互:打破感官孤岛的探索

在北京某科技公司的用户体验实验室,我参与了新一代车载交互系统的测试。当我疲劳驾驶时,方向盘会通过震动提醒;当我注视窗外美景时,系统自动播放匹配的古典音乐;当我轻声说"有点闷",空调会自动切换外循环——这种无缝衔接的交互体验,标志着多模态交互进入"情境感知"新阶段。

技术融合的三大突破

2026年多模态交互的进步体现在三个维度:

- 跨模态对齐精度:某团队开发的"时空注意力模型",能将语音指令与手势动作的时序误差控制在50ms内,在智能家居控制测试中,误操作率从12%降至3%

- 上下文记忆容量:交互系统引入"对话状态跟踪"机制,可记住长达20轮对话的历史信息,某客服机器人在处理复杂售后问题时,首次解决率提升至78%

- 个性化适配算法:通过学习用户的习惯数据(如常用词汇、手势偏好),系统自动调整交互风格,老年用户版本会放大字体、放慢语速,年轻用户版本则支持网络流行语识别

硬件创新的隐形支撑

交互体验的提升离不开硬件进步。某手机厂商的"全域感知模组"集成了ToF摄像头(测距精度±1mm)、骨传导麦克风(降噪30dB)、电容式触控层(支持隔空手势),这些传感器的协同工作,使手机能在口袋里识别用户的掏取意图。更前沿的是"电子皮肤"技术——贴在手腕上的柔性传感器能感知脉搏、肌肉电信号,实现"意念控制"设备的雏形。

无障碍交互的人文关怀

多模态交互的最大价值在于包容性设计。某听障人士社交APP通过唇语识别+手语翻译的组合,使交流效率提升5倍;视障用户使用的导航系统,结合超声波避障与语音提示,能引导其在复杂环境中安全行走。这些案例让我深刻体会到:技术的终极目标不是炫技,而是让每个人都能平等享受科技红利。

3.2 元宇宙交互:构建数字平行世界的基石

在杭州亚运会的元宇宙分会场,我佩戴VR设备参加了虚拟火炬传递。与其他参与者击掌时,能感受到对方手掌的温度;奔跑时,脚下草地会随着步伐起伏——这种沉浸式体验的背后,是空间计算技术的成熟。

核心技术栈的突破

元宇宙交互依赖四大技术支柱:

- 空间建模:激光雷达与视觉SLAM融合的定位精度达厘米级,某园区数字孪生项目实现了10万平方米建筑的1:1建模

- 实时渲染:光线追踪技术与AI超分辨率结合,使移动端也能流畅渲染4K级虚拟场景,某手游的开放世界场景加载时间从15秒缩短至3秒

- 交互反馈:力反馈手套可提供256级力度调节,模拟抓取不同材质物体的触感,某工业设计平台借此将虚拟装配测试的误差率降至1.5%

- 分布式同步:基于WebRTC的低延迟通信技术,使全球百人同时在线的虚拟会议延迟稳定在80ms以内

应用场景的商业落地

元宇宙不再是概念炒作,而是在特定场景展现实用价值:

- 远程协作:某汽车设计团队通过元宇宙平台进行跨洲评审,设计师可在虚拟样车上直接修改参数,评审效率提升40%

- 教育培训:医学院的解剖课使用全息人体模型,学生可360°观察器官结构,实操考核通过率提高35%

- 文化旅游:敦煌莫高窟的数字孪生项目,让游客在虚拟洞窟中欣赏壁画细节,日均访问量是实地参观的12倍

伦理风险的未雨绸缪

元宇宙带来的身份认同危机已开始显现。某调查显示,23%的长期用户出现"虚实混淆"症状,分不清虚拟成就与现实自我价值。为此,行业正在制定《元宇宙伦理公约》,要求平台设置"每日沉浸时长提醒"、“虚实身份隔离机制”,并在虚拟世界中植入"数字水印"标识虚拟内容。这些举措虽不能完全解决问题,但体现了对技术人文关怀的重视。

四、软件开发范式:从"手工劳作"到"AI共生"的进化

4.1 自然语言编程:重构开发者生产力的革命

在深圳某创业公司的晨会上,产品经理用自然语言描述了新功能的业务逻辑:“当用户连续三次输错密码时,弹出图形验证码,若验证码正确则重置错误计数,否则锁定账户30分钟”。这段描述被AI编程助手转化为Python代码,经过开发者微调后直接上线,整个过程仅耗时47分钟——这在2023年是不可想象的。

技术实现的深层逻辑

自然语言编程的本质是"需求理解的语义鸿沟跨越",其核心组件包括:

- 领域知识图谱:将业务术语(如"订单状态流转")映射到代码概念(如状态机模式),某电商平台的图谱包含12万个实体关系

- 意图分解引擎:把模糊需求拆解为可执行步骤,如"优化用户体验"会被分解为加载速度、交互流畅度等12项指标

- 代码生成模型:基于CodeLlama改进的专用模型,在业务逻辑生成任务上的准确率达83%,远超通用模型的65%

开发者角色的转变尤为明显:过去80%时间用于编写重复代码,现在只需专注于架构设计和异常处理。某资深工程师感慨:“现在我更像AI的训练师,教会它理解业务语境,而不是和它比拼打字速度。”

协作模式的范式转移

AI编程助手催生了新的团队协作模式——“人机结对编程”。在某金融科技项目中,开发人员与AI助手分工明确:AI负责生成基础框架和CRUD操作代码,人类开发者专注于风控规则、异常处理等复杂逻辑。这种模式使开发效率提升55%,同时代码审查时间减少40%。不过也带来了新问题:过度依赖AI导致初级开发者基本功弱化,行业开始出现"AI编程认证"考试,考察开发者对AI生成代码的调试和优化能力。

质量控制的攻防战

AI生成的代码常存在"幻觉"问题——看似合理实则错误的逻辑。某团队的解决方案是建立"三重校验机制":静态代码分析工具检查语法规范,单元测试覆盖率要求不低于85%,最关键的是"业务逻辑回溯验证"——用真实业务数据跑通全流程,确保AI理解的需求与实际一致。这套机制使线上bug率从AI应用初期的8%降至2.3%。

4.2 自主软件系统:具备"生命力"的程序

在上海某证券交易系统的监控中心,巨大的屏幕上跳动着数百万行代码的健康指标。这套系统能自动检测性能瓶颈(如发现数据库查询慢时,自动添加索引)、修复常见漏洞(如SQL注入攻击)、甚至在交易量突增时自我扩容——这就是2026年的自主软件系统。

自我进化的实现路径

自主系统的核心是"闭环反馈机制",包含四个环节:

- 感知层:通过APM工具实时监控性能指标(响应时间、错误率、资源利用率)

- 决策层:基于强化学习的策略引擎,从历史数据中学习最优应对方案

- 执行层:调用DevOps工具链自动实施变更(如扩容实例、更新配置)

- 验证层:对比变更前后的指标变化,评估改进效果并更新策略模型

某视频平台的CDN系统就是典型案例:当监测到某地区用户卡顿率上升时,系统自动分析网络拓扑,将内容缓存节点从3个增加到5个,并调整路由策略,整个过程无需人工干预,使卡顿率从12%降至3%以下。

安全防御的主动出击

传统安全系统被动防御的模式已过时,2026年的自主安全系统具备"威胁狩猎"能力。某云服务商的系统通过分析10亿级日志数据,建立了"攻击行为知识图谱",能识别0day攻击的早期特征。当检测到异常登录尝试时,系统不仅阻断当前请求,还会自动生成"诱饵账号"吸引攻击者,收集更多攻击手法用于模型训练。这种"以攻为守"的策略,使系统对新型攻击的检测时间从72小时缩短至4小时。

伦理边界的谨慎探索

自主系统的决策透明性引发关注。某医疗预约系统曾因自动调整挂号规则,导致偏远地区患者预约难度增加,引发公平性质疑。2026年的解决方案是引入"可解释AI"技术,系统决策时必须提供三条以上依据(如"该调整基于历史就诊量、医生负荷、地理位置综合评估"),并设置"人工 override"开关,确保关键决策最终由人类掌控。

五、数据架构:从"数据沼泽"到"数据金矿"的蜕变

5.1 数据编织:让数据"自己说话"的魔法

在重庆某汽车集团的数据中台,我看到了令人震撼的一幕:当工程师输入"查找近三年华东地区混动车型的电池故障案例"时,系统不仅返回了结构化数据,还自动关联了维修工单的非结构化文本、电池生产批次的质检报告、甚至当时天气数据——这就是数据编织技术的威力。

技术架构的核心理念

数据编织打破了传统数据仓库的"集中式管控"思维,采用"联邦治理"模式:

- 元数据智能发现:通过爬虫技术自动识别企业内200+数据源,某制造企业的系统半年内发现了17个未知数据库

- 语义自动对齐:利用预训练语言模型理解不同系统的数据含义,如将ERP的"客户ID"与CRM的"会员编号"自动关联

- 动态数据目录:根据用户查询历史优化数据推荐排序,某销售团队使用后发现,常用报表的访问时间从3分钟缩短至20秒

某零售企业的实践表明,数据编织使数据准备时间从占分析项目的60%降至25%,分析师能更专注于业务洞察。

实施过程中的"坑"与"填坑"

数据编织的实施远比想象中复杂。某银行项目曾因忽视数据权限问题,导致客户敏感信息泄露。后续他们引入了"属性基加密"技术,根据数据敏感度自动调整访问权限,如普通员工只能看到脱敏后的统计结果,高管可查看明细数据。另一个常见问题是"数据质量陷阱"——自动发现的数据可能包含大量脏数据,需建立"数据可信度评分"机制,对低质量数据打标并限制使用。

与AI的协同进化

数据编织与AI形成良性循环:AI模型需要高质量数据训练,而数据编织为AI提供"数据养料"。某保险公司的风控模型通过数据编织获取了10年跨度的理赔数据,包括文本报案记录、图像定损照片等非结构化数据,使欺诈识别准确率提升28%。反过来,模型训练过程中产生的数据需求,又推动数据编织系统优化数据发现策略,这种"数据-AI"双轮驱动模式,正在成为企业数据战略的新范式。

5.2 合成数据:破解"数据荒"的钥匙

在南京某AI医疗公司的实验室,我见到了"虚拟病人"的生成过程:通过调整200+生理参数(如年龄、病史、生活习惯),系统能生成与真实患者高度相似的医疗数据,且完全规避隐私风险。这种合成数据技术,正在解决AI训练中的"数据饥渴"问题。

技术原理的突破

合成数据的核心是"分布保持生成",主流技术包括:

- GANs的改进版:如StyleGAN3能生成高保真人脸图像,某安防公司用其扩充监控数据集,使人脸识别模型在低光照条件下的准确率提升35%

- 差分隐私合成:在数据中添加可控噪声,确保无法反推原始个体信息,某征信机构用此方法生成训练数据,满足GDPR合规要求

- 物理仿真合成:基于第一性原理模拟真实场景,如自动驾驶的合成数据包含不同天气、路况、行人行为的组合,某车企用其训练的模型在极端场景下的应对能力提升50%

某团队的创新在于"混合合成策略":先用GAN生成基础数据,再用物理仿真补充极端案例,最后用差分隐私处理敏感字段,这种组合拳使合成数据的可用性评分达到92分(满分100)。

应用场景的商业价值

合成数据的价值在多个领域凸显:

- 医疗科研:某罕见病研究机构用合成数据扩大了训练样本,使模型对发病率低于万分之一的疾病识别率达到85%

- 金融风控:合成数据包含各种欺诈手法的变种,某支付平台用其训练的模型拦截了新型诈骗交易,挽回损失2.3亿元

- 工业质检:合成带有微小缺陷的产品图像,解决了真实缺陷样本不足的问题,某半导体厂商的晶圆检测效率提升40%

质量评估的标准之战

合成数据的质量评估尚无统一标准,行业正在探索"三维评价体系":

- 统计相似性:对比合成数据与真实数据的分布差异(如KS检验值<0.05)

- 下游任务性能:用合成数据训练的模型在真实数据测试集上的表现(如准确率下降不超过5%)

- 隐私保护强度:通过成员推理攻击测试,确保无法判断某条数据是否在训练集中

某第三方测评机构的报告显示,目前市场上60%的合成数据产品存在"过拟合真实数据分布"的问题,可能导致模型泛化能力不足。

六、网络安全:从"被动防御"到"主动免疫"的转型

6.1 零信任架构:打破"信任边界"的实践

在杭州某互联网公司的安全运营中心,我看到一个有趣的场景:一位高管用自己的手机访问内部系统,系统先验证了指纹、人脸、设备证书三重身份,接着检查手机是否有恶意软件(通过沙箱分析最近安装的APP),最后确认访问的IP地址是否为常用地点——这就是零信任架构的日常运作。

核心原则的落地挑战

零信任的"永不信任,始终验证"理念听起来简单,实施却困难重重:

- 身份认证的动态化:传统用户名密码已过时,某企业采用"生物特征+行为分析"组合认证,通过分析打字节奏、鼠标移动轨迹识别异常,成功阻止了93%的账号盗用尝试

- 最小权限的精细化管理:基于属性的访问控制(ABAC)取代了传统的角色权限,某银行的客户经理只能查看自己客户的账户信息,且每次操作都需二次确认

- 微隔离的自动化部署:用SDN技术实现网络分段,某云平台自动为每个容器创建独立网络命名空间,即使某个容器被入侵也不会横向扩散

某制造业企业的实施案例颇具代表性:他们将工厂OT网络与IT网络彻底隔离,生产设备只能通过专用的工业防火墙访问,避免了2024年某汽车工厂因IT网络漏洞导致生产线停摆的悲剧重演。

与传统安全的融合之道

零信任并非要完全取代传统安全工具,而是构建"纵深防御体系"。某金融机构的解决方案是:在网络边界部署下一代防火墙(NGFW),在内部用零信任架构管控访问,终端安装EDR(端点检测响应)系统,三者数据打通形成联动防御。当EDR检测到终端异常时,自动通知零信任系统收紧该用户的访问权限,这种"层层设防"的策略使APT攻击的平均检测时间从28天缩短至72小时。

6.2 量子安全密码:应对"量子威胁"的准备

在北京某密码实验室,我见到了传说中的量子计算机原型机——一个装满超导电路的低温容器,运行时发出的嗡嗡声仿佛来自未来的召唤。这台机器的存在,让传统RSA加密算法面临前所未有的挑战:理论上,足够强大的量子计算机能在几小时内破解当前的加密体系。

后量子密码的选型博弈

NIST的后量子密码标准化进程已进入尾声,2026年将迎来大规模部署:

- CRYSTALS-Kyber(密钥封装):基于格密码理论,密钥尺寸小(768字节),适合物联网设备

- SPHINCS+(数字签名):基于哈希函数,安全性高但签名尺寸较大(17KB),适用于证书签发

- Falcon(数字签名):同样基于格密码,签名尺寸仅0.66KB,但需要更复杂的数学运算

某通信运营商的选型过程反映了行业共识:核心网用Kyber+SPHINCS+组合,基站用Falcon降低成本,物联网终端用Kyber简化实现。这种"分层部署"策略平衡了安全性与实用性。

迁移工程的艰巨性

密码迁移绝非简单的算法替换。某银行的迁移项目耗时18个月,涉及300多个业务系统:首先需要评估每个系统的加密依赖(如TLS版本、证书类型),然后制定分阶段迁移计划(先外围系统后核心系统),最后进行全面兼容性测试。最大的挑战是"混合加密过渡期"——新旧算法并存可能导致兼容性问题,他们开发了"加密中间件"自动适配不同客户端,确保平滑过渡。

量子密钥分发的商用突破

除了后量子密码,量子密钥分发(QKD)也在特定场景落地。某政务网的骨干链路采用QKD技术,通过光子偏振态传输密钥,理论上可实现"无条件安全"。不过QKD的缺点是传输距离受限(目前最远500公里),需每隔100公里设置中继站。某电信企业的解决方案是"QKD+卫星中继",利用低轨卫星扩展覆盖范围,已在京津冀地区建成试验网。

七、行业数字化转型:从"工具替代"到"模式重构"的深化

7.1 工业4.0:智能制造的进阶之路

在佛山某家电工厂的"黑灯车间",我见证了全流程无人化的震撼场景:AGV小车自动运送物料,机械臂精准装配零件,AI质检系统实时筛查瑕疵,整个生产过程仅需3名工程师监控。这不是科幻电影,而是2026年中国制造业数字化转型的真实写照。

成熟度模型的实践解读

工业4.0的成熟度模型已从概念走向实操:

- L3网络化(2024年主流):设备联网率>90%,实现数据采集与可视化

- L4智能化(2026年目标):引入AI实现预测性维护(设备故障预警准确率>85%)、动态排产(订单交付周期缩短30%)

- L5自治化(2030年愿景):工厂具备自我优化能力,如根据原材料价格波动自动调整生产工艺

某装备制造企业的升级路径值得借鉴:他们先从L2数字化起步(完善MES系统),再推进L3网络化(部署工业物联网平台),最后攻坚L4智能化(引入AI工艺优化模型),这种"步步为营"的策略避免了盲目投资。

中小企业的转型困境与出路

与大企业的风光相比,中小企业的数字化转型充满艰辛。某调研显示,73%的中小企业因资金不足、人才匮乏而停滞不前。破局之道在于"轻量化转型":

- SaaS化工具:采用云端MES、PLM系统,无需自建服务器,某五金厂用SaaS工具后,生产管理效率提升40%,成本仅为定制化方案的1/5

- 产业集群赋能:地方政府牵头建设行业工业互联网平台,共享算力、算法、模型,某纺织集群的平台已服务200多家中小企业

- 产教融合培养:职业院校开设"数字工匠"定向班,为企业输送既懂工艺又懂IT的复合型人才

7.2 智慧医疗:AI赋能的生命守护

在武汉某新冠定点医院,AI辅助诊断系统成为医生的"第二双眼"。它能从胸部CT片中识别出早期磨玻璃结节,准确率超过资深放射科医生;还能预测重症患者的呼吸衰竭风险,帮助医生提前干预。这种"AI+医生"的协作模式,正在重塑医疗服务流程。

临床应用的信任建立

医疗AI的落地最难跨越的是"信任鸿沟"。某三甲医院的做法是"人机对照研究":让AI系统与5名主任医师独立诊断1000例病例,结果显示AI的敏感性(不漏诊率)达96%,特异性(不误诊率)达92%,与医生平均水平相当。更重要的是建立"责任追溯机制"——AI的诊断建议仅供参考,最终决策由医生签字负责,这种"人机协同、责任到人"的模式,使医生接受度从35%提升至89%。

分级诊疗的技术支撑

智慧医疗正在推动医疗资源下沉。某省的"AI辅诊平台"连接了全省2000家基层医疗机构,基层医生遇到疑难病例时,可通过平台发起远程会诊,AI系统自动整理患者病历、检查结果,生成初步诊断建议。这种"基层首诊+AI辅助+上级会诊"的模式,使县域内就诊率从58%提升至76%,缓解了三甲医院的压力。

医药研发的范式革新

AI对医药研发的影响更为深远。某药企用AI模型筛选新冠病毒抑制剂,从2000万种化合物中找到候选分子,研发周期从3年缩短至8个月。更惊人的是"生成式化学"——AI不仅能预测分子活性,还能设计全新分子结构,某团队用此方法发现的抗生素,对耐药菌的抑制效果是传统药物的10倍。不过AI研发的药物仍需经过严格的临床试验,目前仅有12%的AI候选药物进入二期临床。

八、可持续发展:绿色计算的全球实践

8.1 算力能效:从"能耗大户"到"节能先锋"

在宁夏中卫的沙漠边缘,我看到了壮观的景象:连绵的光伏板下方是数据中心,服务器散发的热量被回收利用,为附近的温室大棚供暖。这种"光伏+液冷+余热利用"的综合方案,使数据中心的PUE值降至1.06,成为全球绿色计算的标杆。

能效标准的全球博弈

各国纷纷出台严苛的能效标准:

- 中国:《新型数据中心能效限定值》要求2026年新建大型数据中心PUE≤1.25,北上广深等一线城市≤1.2

- 欧盟:《欧洲绿色协议》规定数据中心2030年前实现碳中和,鼓励使用可再生能源

- 美国:能源部设立"数据中心能效挑战赛",获奖企业可获得税收减免

某跨国云服务商为应对不同地区的标准,在全球部署了12个绿色数据中心:北欧用水电,中东用太阳能,东南亚用生物质能,这种"本地化供能"策略使其整体可再生能源使用率达到65%。

技术创新的节能路径

绿色计算的突破来自多方面:

- 芯片级节能:ARM架构的服务器芯片功耗比x86低40%,某互联网公司用ARM集群替代部分x86服务器,年节电2.3亿度

- 制冷系统优化:间接蒸发冷却技术在干燥地区效果显著,某数据中心用此方法将制冷能耗降低70%

- 算力调度算法:基于可再生能源发电预测的算力调度,使服务器尽可能在清洁能源充足时段运行,某项目因此减少碳排放18%

8.2 循环计算:硬件生命的延续

在深圳某电子废弃物处理厂,我见证了服务器的"重生之旅":退役服务器经过拆解,有用的芯片、内存条被翻新后进入二手市场,贵金属(金、银、钯)被提炼回收,塑料外壳粉碎后制成建筑材料。这种"循环经济"模式,使硬件的生命周期价值提升了3倍。

硬件设计的绿色转型

从源头减少浪费成为共识:

- 模块化设计:戴尔推出的PowerEdge MX服务器,关键部件(CPU、内存、硬盘)可单独更换,延长整机使用寿命至10年

- 可回收材料:苹果的M系列芯片采用100%再生铝外壳,联想的ThinkPad使用海洋塑料制成的机身部件

- 能效标签制度:类似家电的能效标识,帮助消费者选择低功耗硬件,某调查显示能效标签使高耗能硬件销量下降35%

商业模式的社会价值

循环计算催生了新的商业模式:

- 硬件即服务(HaaS):企业不再购买服务器,而是按需租用,服务商负责维护和回收,某初创公司的HaaS业务收入年增长200%

- 算力租赁平台:整合闲置算力资源,中小企业可按小时租用,某平台的算力利用率从15%提升至68%

- 碳积分交易:企业将硬件回收产生的碳减排量转化为积分,用于抵消自身碳排放或出售获利,某制造商通过此方式年增收1200万元

技术融合的乘数效应:当趋势交汇处的火花

八大技术趋势并非孤立存在,它们的交叉融合正在产生颠覆性创新:

- AI+量子计算:量子机器学习算法加速新材料研发,某团队用其设计的电池材料,能量密度提升50%,研发周期从5年缩短至18个月

- 边缘计算+隐私计算:在终端设备上进行数据脱敏处理,仅上传加密特征值,某城市的智慧交通系统借此保护了千万市民的位置隐私

- 数字孪生+具身智能:在虚拟环境中训练机器人,再将技能迁移到实体机器人,某仓储机器人的部署成本降低80%

- 区块链+分布式算力:构建去中心化的AI训练网络,个人贡献算力可获得代币奖励,某项目已聚集50万节点,训练出性能媲美GPT-4的模型

这些融合创新正在重塑行业竞争格局。某传统车企通过与AI芯片公司、云计算厂商合作,仅用18个月就推出了具备L4级自动驾驶能力的电动车,而传统研发周期需要5年以上。这种"跨界融合、快速迭代"的模式,将成为未来企业竞争的核心能力。

挑战与应对策略:在技术狂飙中保持清醒

技术挑战:攀登未知的险峰

- AI对齐问题:如何确保AI的目标与人类价值观一致?某实验室开发的"宪法AI"框架,将伦理准则编码为奖励函数,使AI在资源分配任务中优先考虑弱势群体,但这仍处于早期阶段

- 量子纠错瓶颈:量子比特易受环境干扰,目前表面码纠错技术只能维持100微秒的相干时间,距离实用化还有差距

- 能源-算力矛盾:AI算力需求每3个月翻一番,而可再生能源增速仅为15%/年,发展"算力跟随能源"调度算法成为当务之急

社会挑战:技术普惠的责任

- 数字鸿沟加剧:老年人、残障人士难以适应新技术,某社区开设"银发数字课堂",用方言教学智能手机使用,帮助2000多位老人融入数字生活

- 就业结构调整:预计到2026年,全球将有8500万个岗位被AI替代,同时创造9700万个新岗位,关键在于职业技能培训的及时跟进

- 伦理风险防范:深度伪造技术已能生成以假乱真的视频,某社交平台上线"AI内容检测器",识别准确率达92%,并对虚假内容限流

结语:在技术与人性的平衡中寻找未来

站在2026年的门槛回望,技术进步的脚步从未如此之快,也从未如此深刻地影响着人类社会。当我们惊叹于AI的智能、算力的强大、交互的自然时,更需要思考:技术究竟是为了什么?

在与一位从业30年的老工程师交谈时,他说:"我们当年修机器靠听声音、摸温度,现在靠传感器数据,但不变的是解决问题的初心。“这句话让我豁然开朗——无论技术如何演进,其核心价值始终是"以人为本”。多智能体系统的设计要考虑人类的协作习惯,具身智能的研发要遵循安全伦理,数据架构的建设要保护个人隐私。

对于开发者而言,未来的核心竞争力不再是单一技术的精通,而是"系统思维+人文关怀"的复合能力。既要理解AI、算力、交互等技术的内在联系,又要关注技术对社会、伦理、环境的影响。正如一位CTO所说:“最好的技术,是让你感觉不到技术的存在,却能切实改善你的生活。”

在这个充满不确定性的时代,唯一确定的是变化本身。让我们以开放的心态拥抱技术,以审慎的态度驾驭技术,在智能融合的时代浪潮中,找到属于每个人的坐标。毕竟,技术的终极目标不是创造一个冰冷的数字世界,而是让真实的世界更加温暖、包容、可持续。

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)