微信ipad协议,wechatapi.net

企业级微信机器人系统应采用经典的分层架构,每层职责明确,便于独立演化和维护。连接管理是系统稳定性的基础,需要处理微信长连接的建立、维护和恢复。高效的消息路由是系统性能的关键,需要支持多种路由策略和优先级处理。# 连接池满,清理最久未使用的连接。│负载均衡 · API网关 · 安全认证│。│容器平台 · 消息队列 · 数据库│。│营销系统 · 客服系统 · 数据分析│。│消息服务 · 用户服务 ·

一、企业级应用的特殊要求与挑战

当微信机器人从个人工具升级为企业级系统时,面临的需求复杂度呈指数级增长。一个成熟的企业级微信机器人系统需要满足以下核心要求:

可用性要求:

99.9%的系统可用性(全年停机时间不超过8.76小时)

秒级故障切换能力

7×24小时不间断服务

性能要求:

单实例支持1000+联系人并发消息处理

平均响应延迟低于200毫秒

日处理消息量百万级

扩展性要求:

支持水平扩展,线性提升处理能力

模块化设计,便于功能迭代

多租户支持,资源隔离

可维护性要求:

完善的监控告警体系

灰度发布和回滚能力

自动化运维工具链

二、分层架构设计模式

企业级微信机器人系统应采用经典的分层架构,每层职责明确,便于独立演化和维护。

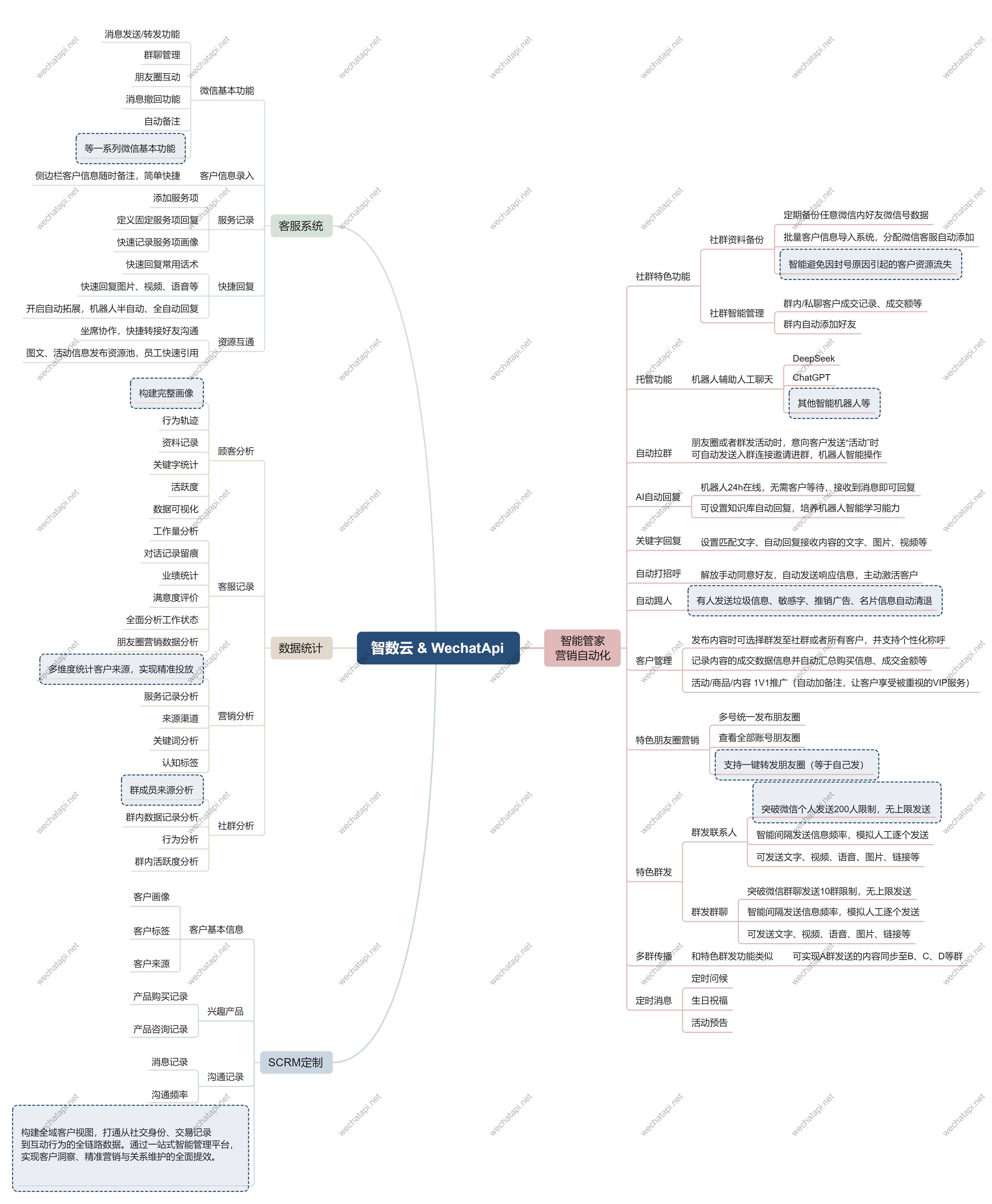

架构总览图

text

┌─────────────────────────────────────┐

│ 业务应用层 │

│ 营销系统 · 客服系统 · 数据分析 │

├─────────────────────────────────────┤

│ 网关层 │

│ 负载均衡 · API网关 · 安全认证 │

├─────────────────────────────────────┤

│ 服务层 │

│ 消息服务 · 用户服务 · 群组服务 │

├─────────────────────────────────────┤

│ 协议层 │

│ 微信协议实现 · 连接管理 · 会话管理│

├─────────────────────────────────────┤

│ 基础设施层 │

│ 容器平台 · 消息队列 · 数据库 │

└─────────────────────────────────────┘

三、核心服务模块详细设计

1. 连接管理服务

连接管理是系统稳定性的基础,需要处理微信长连接的建立、维护和恢复。

连接池设计:

python

class ConnectionPoolManager:

def __init__(self, max_connections=1000):

self.pool = {}

self.max_connections = max_connections

self.health_checker = HealthChecker()

async def get_connection(self, wechat_id):

"""获取微信连接"""

# 检查现有连接

if wechat_id in self.pool:

conn = self.pool[wechat_id]

if await self.health_checker.check(conn):

return conn

else:

# 移除失效连接

await self.remove_connection(wechat_id)

# 创建新连接

if len(self.pool) >= self.max_connections:

# 连接池满,清理最久未使用的连接

await self.evict_oldest()

conn = await self.create_connection(wechat_id)

self.pool[wechat_id] = conn

# 启动健康检查

asyncio.create_task(self.monitor_connection(conn))

return conn

async def create_connection(self, wechat_id):

"""创建微信连接"""

conn_config = {

'protocol_version': '8.0.37',

'heartbeat_interval': random.randint(15, 45),

'reconnect_attempts': 3,

'timeout': 30

}

# 建立TCP连接

reader, writer = await asyncio.open_connection(

'wechat.server.com', 443, ssl=True

)

# 微信握手协议

await self.perform_handshake(reader, writer, wechat_id)

return WeChatConnection(reader, writer, conn_config)

async def monitor_connection(self, connection):

"""监控连接健康状态"""

while connection.is_active:

try:

# 发送心跳包

await connection.send_heartbeat()

# 接收响应

response = await connection.receive(timeout=10)

if not response:

# 连接可能已断开

await self.handle_connection_loss(connection)

break

# 更新连接状态

connection.last_active = time.time()

# 适当休眠

await asyncio.sleep(connection.heartbeat_interval)

except (ConnectionError, TimeoutError) as e:

logger.error(f"连接异常: {e}")

await self.recover_connection(connection)

break

2. 消息路由服务

高效的消息路由是系统性能的关键,需要支持多种路由策略和优先级处理。

智能路由引擎:

python

class MessageRouter:

def __init__(self):

self.routing_rules = self.load_routing_rules()

self.message_queue = PriorityQueue()

self.workers = []

async def route_message(self, message):

"""路由消息到合适的处理器"""

# 消息预处理

processed_msg = await self.preprocess_message(message)

# 确定路由策略

route_strategy = self.determine_routing_strategy(processed_msg)

# 根据策略分发

if route_strategy == 'immediate':

# 立即处理

await self.process_immediately(processed_msg)

elif route_strategy == 'batch':

# 批量处理

await self.enqueue_for_batch(processed_msg)

elif route_strategy == 'delayed':

# 延迟处理

await self.schedule_delayed(processed_msg)

elif route_strategy == 'fallback':

# 降级处理

await self.handle_fallback(processed_msg)

def determine_routing_strategy(self, message):

"""确定消息路由策略"""

strategy_scores = {}

# 基于消息优先级

priority_score = self.calc_priority_score(message)

# 基于系统负载

load_score = self.calc_load_score()

# 基于业务规则

rule_score = self.apply_routing_rules(message)

# 综合评分

total_score = (

priority_score * 0.4 +

load_score * 0.3 +

rule_score * 0.3

)

# 策略映射

if total_score > 0.8:

return 'immediate'

elif total_score > 0.5:

return 'batch'

elif total_score > 0.2:

return 'delayed'

else:

return 'fallback'

async def process_immediately(self, message):

"""立即处理消息"""

# 选择最佳处理器

processor = self.select_processor(message)

# 并发处理

tasks = []

# 主要处理逻辑

main_task = asyncio.create_task(

processor.handle(message)

)

tasks.append(main_task)

# 辅助任务(日志、监控等)

if self.need_auxiliary_tasks(message):

aux_tasks = self.create_auxiliary_tasks(message)

tasks.extend(aux_tasks)

# 等待所有任务完成

results = await asyncio.gather(*tasks, return_exceptions=True)

# 处理结果

await self.handle_processing_results(message, results)

3. 会话状态服务

在分布式环境中保持会话状态一致性是技术难点。

分布式会话管理:

python

class DistributedSessionManager:

def __init__(self, redis_client):

self.redis = redis_client

self.local_cache = LRUCache(maxsize=1000)

self.session_timeout = 1800 # 30分钟

async def get_session(self, session_key):

"""获取会话状态"""

# 检查本地缓存

cached = self.local_cache.get(session_key)

if cached and not cached.expired:

return cached.data

# 从Redis获取

session_data = await self.redis.get(f"session:{session_key}")

if session_data:

session = json.loads(session_data)

# 更新本地缓存

self.local_cache.put(session_key, session)

# 续期

await self.redis.expire(

f"session:{session_key}",

self.session_timeout

)

return session

return None

async def update_session(self, session_key, updates):

"""更新会话状态"""

# 获取当前会话

current = await self.get_session(session_key)

if not current:

current = self.create_new_session(session_key)

# 应用更新

for key, value in updates.items():

if isinstance(value, dict) and key in current:

# 字典合并

current[key].update(value)

else:

current[key] = value

# 设置版本号,解决并发冲突

current['version'] = current.get('version', 0) + 1

current['last_updated'] = time.time()

# 使用事务保存

async with self.redis.pipeline(transaction=True) as pipe:

pipe.setex(

f"session:{session_key}",

self.session_timeout,

json.dumps(current)

)

pipe.set(

f"session_version:{session_key}",

current['version']

)

await pipe.execute()

# 更新本地缓存

self.local_cache.put(session_key, current)

return current

四、性能优化策略

1. 消息处理性能优化

批量处理机制:

python

class BatchProcessor:

def __init__(self, batch_size=50, flush_interval=1.0):

self.batch_size = batch_size

self.flush_interval = flush_interval

self.buffer = []

self.last_flush = time.time()

async def process_message(self, message):

"""处理消息(支持批量)"""

self.buffer.append(message)

# 检查是否满足批量处理条件

if (len(self.buffer) >= self.batch_size or

time.time() - self.last_flush >= self.flush_interval):

await self.flush_buffer()

async def flush_buffer(self):

"""批量处理缓冲区的消息"""

if not self.buffer:

return

# 分组消息(按接收者或类型)

grouped = self.group_messages(self.buffer)

# 并发处理各组消息

tasks = []

for group_key, messages in grouped.items():

task = asyncio.create_task(

self.process_message_group(group_key, messages)

)

tasks.append(task)

# 等待所有组处理完成

results = await asyncio.gather(*tasks, return_exceptions=True)

# 处理结果

await self.handle_batch_results(results)

# 清空缓冲区

self.buffer.clear()

self.last_flush = time.time()

def group_messages(self, messages):

"""智能分组消息"""

groups = defaultdict(list)

for msg in messages:

# 基于接收者分组

group_key = msg['receiver']

# 相同接收者的消息进一步按类型分组

if self.should_group_by_type(msg):

group_key = f"{msg['receiver']}:{msg['type']}"

groups[group_key].append(msg)

return dict(groups)

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)