VINS-Fusion-ROS2 概览

VINS-Fusion-ROS2 是一个功能强大且多功能的视觉惯性导航系统,它结合了视觉和惯性测量数据,为机器人应用提供精确的实时状态估计。这个兼容 ROS2 的实现基于原始 VINS-Fusion 框架构建,提供了增强的模块化、改进的性能以及与现代 ROS2 生态系统的无缝集成。

VINS-Fusion-ROS2 是一个功能强大且多功能的视觉惯性导航系统,它结合了视觉和惯性测量数据,为机器人应用提供精确的实时状态估计。这个兼容 ROS2 的实现基于原始 VINS-Fusion 框架构建,提供了增强的模块化、改进的性能以及与现代 ROS2 生态系统的无缝集成。

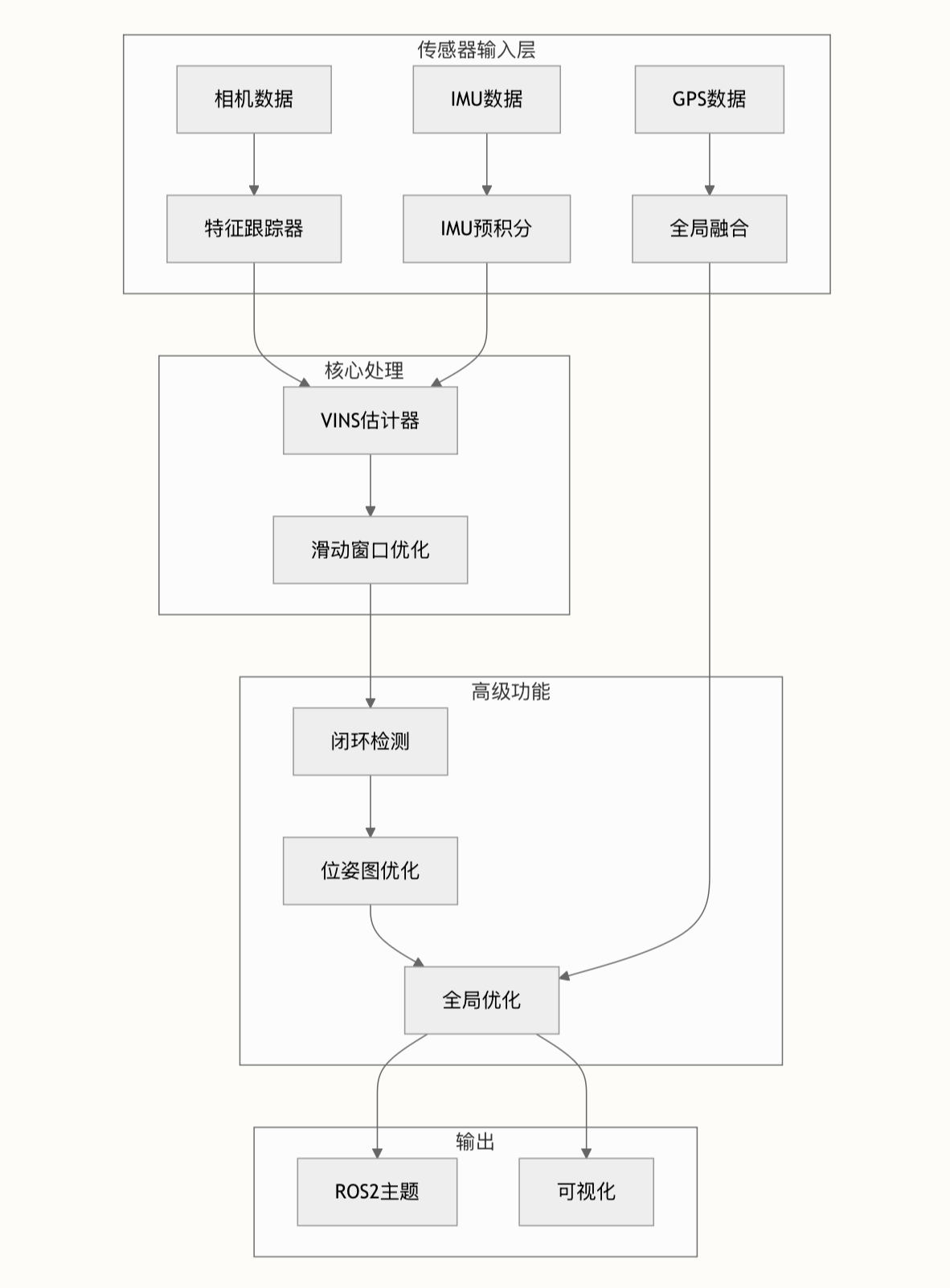

系统架构

VINS-Fusion-ROS2 系统采用模块化架构设计,旨在实现灵活性和可扩展性。系统的核心通过复杂的优化管道处理视觉和惯性传感器数据,提供精确的姿态估计和建图能力。

关键组件

核心模块

系统由多个关键模块组成,每个模块负责处理视觉惯性导航管道的特定方面:

- VINS估计器 (

vins/src/estimator/): 核心优化引擎,使用滑动窗口优化技术融合视觉和惯性数据 - 特征跟踪器 (

vins/src/featureTracker/): 处理跨相机图像的实时特征检测和跟踪 - 闭环融合 (

loop_fusion/): 管理闭环检测和位姿图优化以确保全局一致性 - 全局融合 (

global_fusion/): 集成GPS数据用于全局定位和漂移校正 - 相机模型 (

camera_models/): 提供全面的相机标定和投影模型

性能能力

VINS-Fusion-ROS2 在各种场景下提供稳健的性能:

| 指标 | 典型性能 |

|---|---|

| 处理速度 | 30-60 Hz (实时) |

| 位置精度 | < 行驶距离的1% |

| 旋转精度 | < 0.5度 |

| 闭环检测 | 亚米级精度 |

配置系统

VINS-Fusion-ROS2 通过广泛的配置系统支持多种硬件配置:

| 配置类型 | 支持的数据集 | 关键特性 |

|---|---|---|

| EuroC | 微型飞行器数据集 | 双目-IMU,高精度标定 |

| KITTI | 自动驾驶数据集 | 多相机设置,GPS集成 |

| RealSense D435i | Intel RealSense相机 | 内置IMU同步 |

| MYNT EYE | MYNT EYE双目相机 | 自定义标定配置文件 |

支持的硬件和数据集

系统为各种传感器和数据集提供开箱即用支持:

相机配置

- 单目 + IMU: 单相机与惯性测量单元组合

- 双目 + IMU: 双相机设置与IMU组合以增强深度感知

- 仅双目: 不使用惯性数据的视觉里程计

- 多相机: 支持最多4个相机配置

传感器模型

- 针孔相机: 标准透视投影模型

- MEI/CMei相机: 用于鱼眼镜头的扩展统一相机模型

- 鱼眼支持: 兼容广角镜头并提供畸变校正

核心系统架构

VINS-Fusion 系统采用模块化架构,围绕三个主要处理流水线:前端处理、后端优化和全局融合。这种设计通过精心分离的关注点实现实时性能,同时保持估计精度。

前端处理流水线

前端负责原始传感器数据处理和特征提取,作为传感器与优化后端之间的主要接口。关键组件包括:

特征跟踪模块:FeatureTracker 类实现了精密的视觉特征跟踪,支持单目和立体配置。它管理连续帧间的特征检测、跟踪和异常值剔除 [feature_tracker.h#L55-L75]。跟踪器通过光流方法维持特征对应关系,并通过专用掩码处理支持鱼眼相机模型。

IMU 预积分:系统通过 IntegrationBase 类实现高效的 IMU 预积分,该类累积关键帧之间的 IMU 测量值。这种方法允许在优化过程中进行常数时间的 IMU 因子评估,同时通过一阶误差状态传播保持数值精度。

后端优化引擎

后端构成 VINS-Fusion 的计算核心,通过非线性最小二乘实现紧耦合的视觉-惯性优化。Estimator 类通过几个关键阶段协调此过程:

状态管理:系统维护一个综合状态向量,包括滑动窗口中每一帧的位置、速度、方向和 IMU 偏置 。这种状态表示支持具有时间一致性约束的完整视觉-惯性光束法平差。

因子图优化:VINS-Fusion 使用 Ceres Solver 进行非线性优化,为不同传感器模态实现专门的代价函数:

- IMU 因子:IMUFactor 提供连续位姿间的 15 维约束

- 视觉因子:多个投影因子处理单目、立体和多相机观测

- 边缘化因子:MarginalizationInfo 保留来自边缘化状态的信息

初始化流水线:系统通过多阶段过程实现鲁棒初始化:

- 运动恢复结构:initial_sfm.cpp 恢复初始相机位姿和 3D 结构

- 视觉-惯性对齐:initial_alignment.cpp 对齐视觉和惯性参考系

- 精化:联合优化同时精化所有参数

多模态传感器集成

VINS-Fusion 通过灵活架构支持多样化的传感器配置:

相机配置:系统通过特征跟踪器中的 m_camera 向量适应单目、立体和多相机设置。每台相机可使用不同的投影模型(pinhole、mei),通过 YAML 文件配置。

IMU 集成:高频 IMU 数据提供视觉更新间的运动约束。系统通过在线估计外参参数和时间同步偏移处理 IMU-相机时空校准。

全局传感器:通过 GlobalOptimization 类可选集成 GPS 和其他全局传感器,实现全局一致性并为长期操作提供漂移校正。

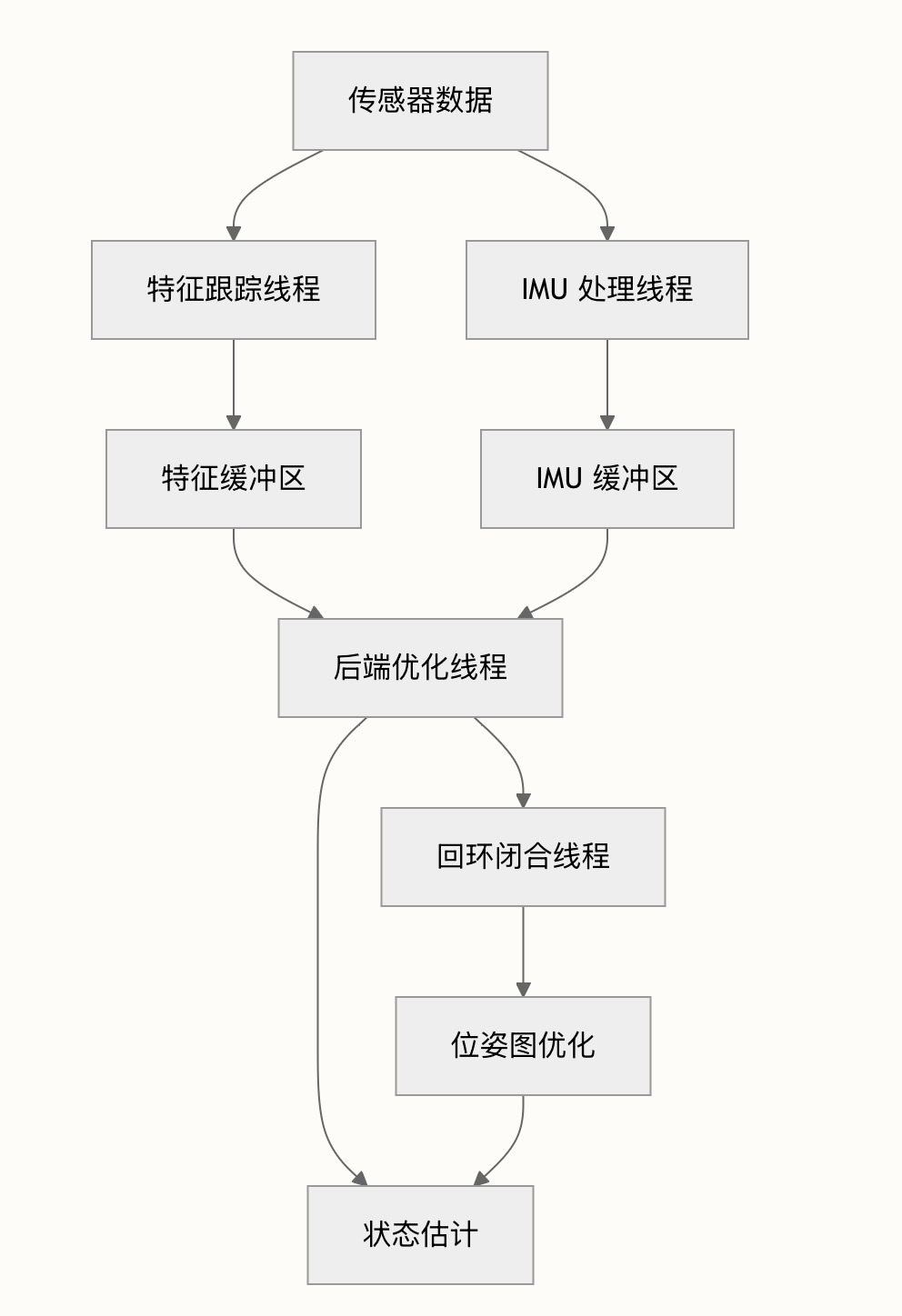

线程架构

VINS-Fusion 采用多线程架构进行并行处理:

系统利用三个主线程 :

- 特征跟踪线程:处理视觉数据并提取特征

- 后端线程:执行非线性优化和状态估计

- 回环闭合线程:处理地点识别和全局优化

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)