【技术科普】不仅是“回放”:为什么具身智能(Embodied AI)开发需要 Rerun.io?

摘要:Rerun.io是一款面向AI和机器人开发的开源可视化引擎,被誉为"超级黑匣子"。它突破了传统调试工具的限制,能够将多模态数据(图像、点云、日志等)在统一时空坐标系中精确对齐和可视化。与普通摄像头录像相比,Rerun具备3D时空重建、AI思维可视化、多源数据同步三大核心优势,使开发者能直观分析系统状态。该工具支持Python/C++/Rust集成,适用于机器人、计算机视觉

摘要:在机器人和多模态 AI 开发中,传统的 print() 调试和简单的视频录制已无法满足需求。本文将深入解析开源可视化引擎 Rerun.io 的核心能力,探讨其与传统摄像头录像的本质区别,并解释为何它被称为 AI 时代的“超级黑匣子”。

一、 引言:当我们谈论“调试”时,我们在谈论什么?

一、 引言:当我们谈论“调试”时,我们在谈论什么?

在纯软件开发时代,调试意味着打断点、看日志。但在**具身智能(Embodied AI)和机器人(Robotics)**领域,调试的维度被无限拉伸了:

-

代码逻辑是时间连续的;

-

传感器数据(图像、雷达)是空间分布的;

-

模型推理(Tensor)是高维抽象的。

当你发现“机器人撞墙了”,单纯的 Log 文件看不出原因,单一的摄像头录像又看不出逻辑。这时,我们需要一个新的工具——Rerun.io。

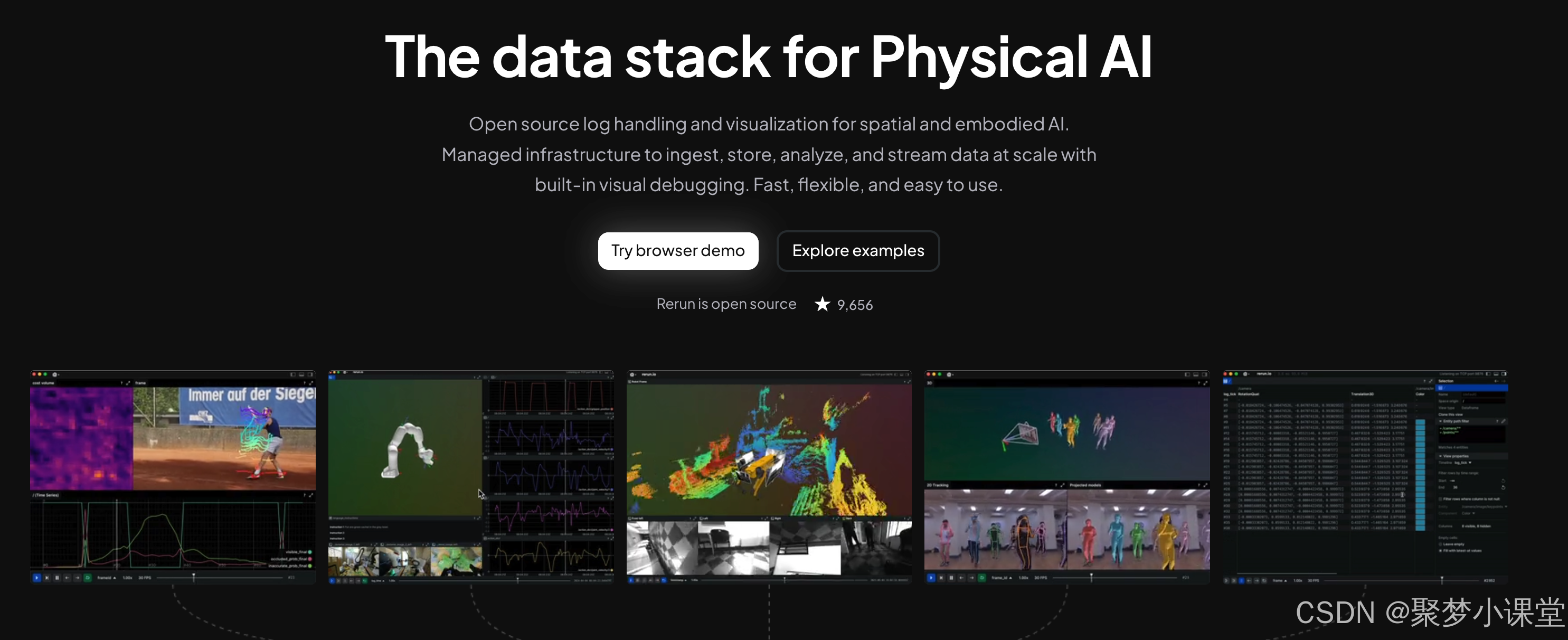

二、 Rerun.io 是什么?

Rerun.io 是一个开源的多模态数据可视化 SDK 和查看器(Viewer)。

如果用一句话定义它:它是为算法工程师设计的、带有时间轴和空间坐标系的“全栈黑匣子”记录仪。

它不负责“思考”(那是 AI 模型的事),它只负责诚实、精准地**“记录”系统内部发生的一切,并将其在一个统一的 3D 界面中“对齐”**展示出来。

核心能力一览

-

多模态数据融合:在一个视图内同时渲染 RGB 图像、LiDAR 点云、深度图、Tensor 张量、文本日志和标量曲线。

-

时间旅行(Time-Travel):全量数据按时间戳索引,支持毫秒级的回放、暂停和拖拽,不仅看“现在”,更能复盘“过去”。

-

空间交互:内置 2D/3D 视图引擎,支持在三维空间中旋转视角,查看传感器数据的空间位置关系。

-

极简集成:通过 Python/C++/Rust SDK,一行代码即可将数据流注入可视化引擎。

三、 深度解析:Rerun 与“摄像头录像”的本质区别

很多初学者容易误解:“这不就是一个高级点的视频播放器吗?”

并不是。 这是“表象”与“逻辑”的区别,是“皮囊”与“大脑”的区别。

我们可以从以下三个维度来理解两者的本质差异:

1. 维度差异:2D 像素 vs. 3D 时空

-

摄像头录像:记录的是结果。它是一系列扁平的 2D 像素。由于透视关系,你很难在视频中判断物体之间的真实距离,也无法改变观察视角。

-

Rerun:记录的是原始数据(Raw Data)。它构建了一个3D 虚拟世界。

-

场景:机器人面前有一个障碍物。

-

区别:在 Rerun 里,你可以暂停回放,旋转视角从侧面看,测量出机器人距离障碍物精确的 2.5 米,而不是通过视频画面去猜。

-

2. 信息深度:看见“皮囊” vs. 看见“大脑”

-

摄像头录像:只能告诉你机器人做了什么(比如:它撞墙了)。

-

Rerun:能告诉你机器人当时在想什么。

-

场景:撞墙事故分析。

-

Rerun 视图:你可以看到撞墙前 0.5 秒,图像上已经生成了红色的“检测框”(说明感知层识别到了墙),但底部的“路径规划线”依然穿过了墙壁(说明决策层代码有 Bug)。

-

核心价值:它可视化了不可见的数据(置信度、预测轨迹、内部变量)。

-

3. 数据结构:非结构化 vs. 强时空对齐

-

摄像头录像:视频帧与后台 Log 是分离的。想知道“视频第 10 秒时,电机电流是多少?”,你需要人工去翻查日志文件并艰难地对齐时间戳。

-

Rerun:基于统一时间轴的强制对齐。当你拖动进度条,图像、点云、代码日志、报错信息会同步跳转到同一毫秒的状态。它是一个结构化的系统状态快照。

四、 核心逻辑:记录才是核心,智能交给模型

基于上述分析,我们可以得出一个重要的技术结论:

Rerun 的核心不是“人工智能”,而是“高维记录”。

它扮演的角色类似于电子工程中的示波器,或者医学领域的核磁共振(MRI)。

-

示波器本身不懂电路,但它能把不可见的电流画出来,让工程师分析。

-

Rerun 本身不懂自动驾驶,但它能把 AI 模型内部的张量运算画出来,让算法工程师分析。

Rerun 的工作流逻辑:

-

Input(感知):摄像头、雷达、传感器采集数据。

-

Process(智能):你的 AI 模型(PyTorch/TensorFlow)进行推理。

-

Log(记录):Rerun SDK 实时抓取上述所有步骤的输入和输出。

-

Visualize(呈现):人类工程师通过 Rerun Viewer 进行“验尸”或调试。

五、 典型应用场景

任何涉及**“空间位置”** + “时间变化” + **“多传感器”**的系统,都是 Rerun 的用武之地。

-

机器人开发 (Robotics)

-

调试 SLAM(定位与建图)算法,实时查看点云地图的构建过程,检查是否存在漂移。

-

分析机械臂的运动规划(Motion Planning),对比“计划轨迹”与“实际轨迹”的误差。

-

-

计算机视觉 (CV)

-

目标检测与跟踪:将 Bounding Box 和 ID 标签实时叠加在视频流上。

-

3D 重建:可视化 NeRF 或 Gaussian Splatting 的训练过程。

-

-

具身智能 (Embodied AI)

-

在仿真环境(Simulator)中,对比 Agent 的“感知视角”与上帝视角(Ground Truth)的差异,分析 Agent 的决策失误原因。

-

-

多传感器融合 (Sensor Fusion)

-

校准摄像头与激光雷达的外参。在 Rerun 中通过叠加点云到图像上,一眼就能看出标定是否准确。

-

六、 快速上手 (Python 示例)

只需几行代码,即可体验从单纯的 print 到多模态可视化的飞跃:

codePython

import rerun as rr

import numpy as np

import cv2

# 1. 初始化 Rerun

rr.init("my_robot_session", spawn=True)

# 2. 模拟数据流循环

for step in range(100):

# 设置当前时间轴

rr.set_time_sequence("step", step)

# --- 记录数据 ---

# A. 记录一张随机图像 (模拟摄像头)

image = np.random.randint(0, 255, (480, 640, 3), dtype=np.uint8)

rr.log("sensors/camera/image", rr.Image(image))

# B. 记录 3D 点云 (模拟激光雷达)

points = np.random.normal(size=(1000, 3))

rr.log("sensors/lidar/points", rr.Points3D(points))

# C. 记录检测框 (模拟 AI 感知结果)

rr.log(

"perception/bbox",

rr.Boxes2D(min=[100, 100], sizes=[50, 50], labels=["Obstacle"])

)七、 结语

在具身智能爆发的今天,工具的进化必须跟上算法的复杂度。Rerun.io 并不是要替代人类的判断,而是通过提供极高密度的“上下文信息”,让人类的判断变得基于数据而非猜测。

如果你还在对着满屏的终端日志发愁,或者看着一段单薄的 MP4 视频百思不得其解,不妨试试 Rerun,给你的算法装上一个“透视眼”。

关键词:Rerun.io, 计算机视觉, 机器人开发, 数据可视化, 具身智能, SLAM, 多模态调试

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)