UniVLA:Learning to Act Anywhere withTask-centric Latent Actions

和LAPA有点像通过三个步骤来实现UniVLA:1. 任务中心潜在动作学习:通过无监督的方式从大规模跨实体视频中提取与任务相关的动作表示。使用VQ-VAE对潜在动作进行离散化,并利用DINOv2特征空间来减少任务无关的动态影响。通过语言指令作为条件,进一步分离动作表示,使其专注于任务中心的动作。2. 下一个潜在动作预测:训练一个基于自回归的视觉-语言模型,该模型以视觉观察和任务指令为输入,预测统一

和LAPA有点像

通过三个步骤来实现UniVLA:

1. 任务中心潜在动作学习:通过无监督的方式从大规模跨实体视频中提取与任务相关的动作表示。使用VQ-VAE对潜在动作进行离散化,并利用DINOv2特征空间来减少任务无关的动态影响。通过语言指令作为条件,进一步分离动作表示,使其专注于任务中心的动作。2. 下一个潜在动作预测:训练一个基于自回归的视觉-语言模型,该模型以视觉观察和任务指令为输入,预测统一潜在空间中的潜在动作标记。3. 潜在动作解码:将潜在动作解码为物理行为,将预训练的通用策略高效地适应于未见任务。

Introduction

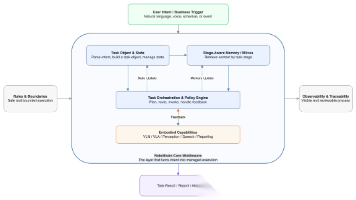

UniVLA,这是一个通用的政策学习框架,可以在各种实施例和环境之间实现可扩展和高效的规划。就像大型语言模型 (LLM) 学习跨语言共享知识一样 [22, 18],我们的目标是构建一个统一的动作空间,促进视频数据之间的知识传递,包括各种机器人演示和以自我为中心的人类视频。我们的通才政策配方包括三个关键阶段:1) 以任务为中心的潜在动作学习,其中我们以无监督的方式从大量跨实施体视频中提取与任务相关的动作表示。这是通过使用 VQ-VAE [76] 从配对帧的逆动力学中离散潜在动作来实现的。2)潜在动作预测,我们使用离散的潜在动作标记训练一个自回归视觉语言模型,赋予它与本体无关的规划能力。3) 潜在动作解码,我们将潜在计划解码为物理行为,并将预先训练的通才策略专门化,以有效地部署到看不见的任务中。

虽然近期研究[87, 16]已探索从⽹络规模视频中学习潜在动作的可⾏性,但它们存在⼀个关键的局限性:其基于重建的朴素⽬标函数往往会捕捉到与任务⽆关的动态,例如⾮主体的移动或不可预测的摄像机移动。这些噪声表征会引⼊与任务⽆关的⼲扰,从⽽阻碍策略预训练。为了解决这个问题,我们利⽤预训练的 DINOv2 特征[62]从像素中提取块级表征,从⽽提供空间和以对象为中⼼的先验知识,从⽽更好地捕获与任务相关的信息。通过使⽤现成的语⾔指令作为条件,我们进⼀步将动作分解为两个互补的动作表征,其中⼀个明确地表⽰以任务为中 ⼼的动作。

(LAPA [87]和 IGOR [16]引⼊了⽆监督预训练⽅法来教授 VLA 离散潜在动作,旨在从⼈类视频中迁移知识。然⽽,这些⽅法会编码原始像素中的所有视觉变化,从⽽捕获与任务⽆关的动态,例如相机抖动、 其他智能体的移动或新物体的出现,最终会降低策略性能。我们提出了⼀个新颖的训练 架,将以任务为中⼼的动态与⽆关的视觉变化分离,构建更有效的潜在动作空间,以实现稳健的策略规划。)?

UniVLA 在多个作基准和导航任务中实现了最先进的性能,性能大大优于 OpenVLA [39],而只需要 1/20 的预训练成本(以 GPU 小时为单位)。这种效率源于其以任务为中心的潜在动作空间,它将与任务相关的动态与无关的视觉变化解耦。我们的动作表示不仅减少了计算开销,而且实现了高效的扩展——随着数据集大小的增加,UniVLA 的性能得到提高,有效地利用交叉实施、交叉视图机器人数据集甚至未标记的人类视频来扩展其预训练语料库并提取可转移知识。值得注意的是,当仅在 Bridge-V2 数据集 [78] 上进行预训练时,UniVLA 超过了在更大的 Open X-Embodiment [63] 数据集上训练的 OpenVLA 和 LAPA,强调了它从有限数据中提取可转移知识的能力。

此外,我们采用了一个只有 10.8M 参数的轻量级解码器将潜在动作转化为可执行轨迹,大大减少了对大量微调的需求。这种设计利用了以任务为中心的潜在动作空间的紧凑和信息特性,使 UniVLA 能够以最少的下游数据有效地适应不同的任务和实施例。我们的综合评估涵盖作、导航和实际部署,强调了该框架的效率、可扩展性和通用性,将其定位为通往下一代通才机器人策略的有前途的途径。

主要三方面贡献:

1.我们提出了 UniVLA,这是一种通过在统一的、与实施体无关的行动空间中进行规划来实现通才政策的配方,通过从网络规模的视频中学习来实现可扩展和高效的决策。

2.我们引入了一种从跨实施例视频中提取与任务相关的潜在动作的新方法,将以任务为中心的动态从不相关的视觉变化中解耦出来。定性和定量实验都突出了它与现有工作相比的优点和优势。

3.UniVLA 在多个基准测试和真实机器人测试中实现了最先进的性能,在 LIBERO [48] 基准测试中,成功率比 OpenVLA 提高了 18.5%,在导航任务 [4] 方面提高了 29.6%,在实际部署方面提高了 36.7%。

Methodology

我们制定了实施 UniVLA 的三个步骤:1)(第 III-A 节)利用基于语言的目标规范,我们以无监督的方式从广泛的视频数据集中提取逆动力学(inverse dynamics),产生一组离散的以任务为中心的潜在动作,这些动作可以推广到不同的实施例和领域;2)(第 III-B 节)基于此,我们训练了一个基于自回归转换器的视觉-语言-动作模型,该模型以视觉观察和任务指令作为输入,以预测统一潜在空间中的潜在动作标记;3)(第 III-C 节)为了促进对各种机器人控制系统的有效适应,我们引入了专门的策略头,将潜在动作解码为可执行的控制信号。

A. 以任务为中⼼的潜在动作学习

1)潜在动作量化

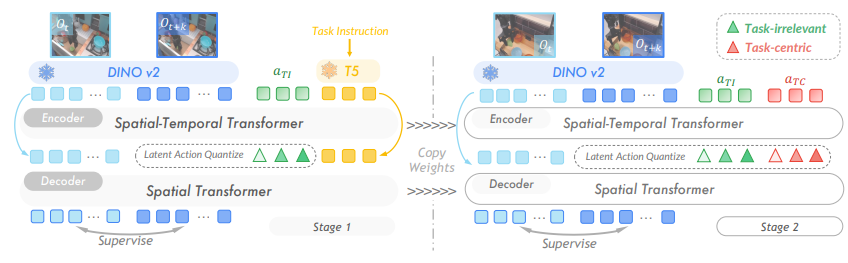

图2展⽰了我们潜在动作模型的两阶段训练流程和整体架构。我们从⼀ 对连续的视频帧开始,记为{ot, ot+k},帧间隔为 k。为了确保不同数据集的时间间隔统⼀约为 1 秒。

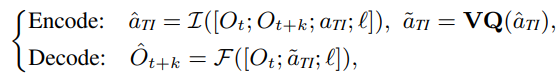

编码器I(at|ot, ot+k)和解码器F(ot+k|ot, at),编码器根据连续观测推断潜在动作,解码器则经过训练,根据指定的潜在动作预测未来观测。

遵循 Villegas 等⼈[77]的研究,将编码器实现为⼀个带有随机时间掩码的时空transformer。⼀组具有预定义维度 d 的可学习动作标记aq ∈ R(N*d),按顺序连接到视频特征后用于提取动态特征。

为了进⼀步压缩信息并使其与基于⾃回归transformer的策略的学习⽬标[66]保持⼀致, 我们对动作标记应⽤了潜在量化。量化动作标记az ∈R(N*d) ,使⽤ VQ-VAE [76]⽬标函数进⾏优化,其码本词汇量为 |C|。解码器采⽤空间transformer实现,经过优化,仅利⽤量化动作标记即可预测未来帧。我们不将历史帧输⼊解码器,防⽌模型过度依赖上下⽂信息或仅仅记住数据集。

虽然最近的研使⽤原始像素进⾏预测,但我们观察到像素空间预测会 迫使模型关注嘈杂的、与任务⽆关的细节(例如,纹理、光照) [30]。这个问题在⽹络规 模和众包视频数据集[29] 中被放⼤,其中不受控制的捕获条件引⼊了进⼀步的变化。 受联合嵌⼊预测架构 (JEPA) [5, 6, 96] 的启发,我们提出使⽤DINOv2 [62] spatial patch features作为语义丰富的表⽰。它们以对象为中⼼和空间感知的特性使它们不仅适合⽤作输⼊,也适合⽤作潜在动作模型的预测⽬标。我们的⾃监督⽬标是最⼩化嵌⼊重建误差:

![]()

,我们用{Ot,Ot+k}来表示成对视频帧{ot,ot+k}的 DINOv2 特征。因此,紧凑的潜在动作必须对观测之间的变化进行编码,以最小化预测误差。

图 2:以任务为中⼼的潜在动作学习。我们提出了⼀个两阶段训练框架,旨在将以任务为中⼼的视觉动态和变化与外部因素区分开来。在第⼀阶段,来⾃预训练的 T5 ⽂本编码器[67]的任务指令嵌⼊被⽤作编码器和解码器的输⼊。这些嵌⼊提供与任务相关的语义信息,以增强预测准确性。在第⼆阶段,引⼊了⼀组新的潜在动作,专 ⻔⽤于取代语⾔的作⽤,并从 DINOv2 编码的视频帧特征中捕捉以任务为中⼼的动态。

这里预测目标不是重构原始图像,而是预测dino特征

2)潜在动作解耦

如前所述,在⽹络规模视频中,机器⼈的动作通常与不相关 的环境变化纠缠在⼀起。为了减轻与任务⽆关的动态变化的不利影响,我们 将现成的语⾔指令纳⼊潜在动作模型的第⼀个训练阶段(图2左)。语⾔输⼊使⽤预训练的 T5 ⽂本编码器[67]进⾏编码,并同时作为编码器和解码器 上下⽂中的条件信号。

整个过程:

其中 [; ] 表⽰按序列连接,VQ 表⽰⽮量量化动作表⽰的码本,ℓ 是来⾃ T5 ⽂本编码器的指令嵌⼊。

向解码器发送任务指令可提供关于底层动作的⾼级语义指导。因此,量化的潜在动作经过优化,仅编码环境变化和视觉细节[89],由于码本容量有限,省略了与任务相关的⾼级信息[2]。此阶段会建⽴⼀组潜在动作,其中包含与任务⽆关的信息,例如新物体的出现、外部主体的移动或摄像机引起的运动伪影。这些动态变化虽然对于将模型应⽤于视觉环境⾄关重要,但与任务的具体⽬标⽆关。

接下来,我们将第⼀阶段训练的潜在动作模型中与任务⽆关的码本和参数重 新⽤于下⼀阶段(如图2右图所⽰),其⽬标是学习⼀组新的以任务为中⼼的潜在动作aTc:

其中VQ(TC)表⽰⽤于学习以任务为中⼼的动态的新初始化码本。基于已获取的与任务⽆关的表征,我们冻结了相应的码本,使模型能够专注于细化和专⻔化新的潜在动作集合。这种专⻔化有助于精确建模与任务相关的动态,例如物体操控或⽬标导向的运动轨迹。潜在动作表征的显式解耦增强了我们的泛化策略在不同环境和任务中的泛化能⼒。与朴素的潜在动作学习⽅法(例如 LAPA [87])相⽐,仅基于以任务为中⼼的表征进⾏训练可以实现更快的收敛速度,同时实现稳健的性能,这表明这些潜在动作对于后续的政策学习具有更丰富的参考价值。

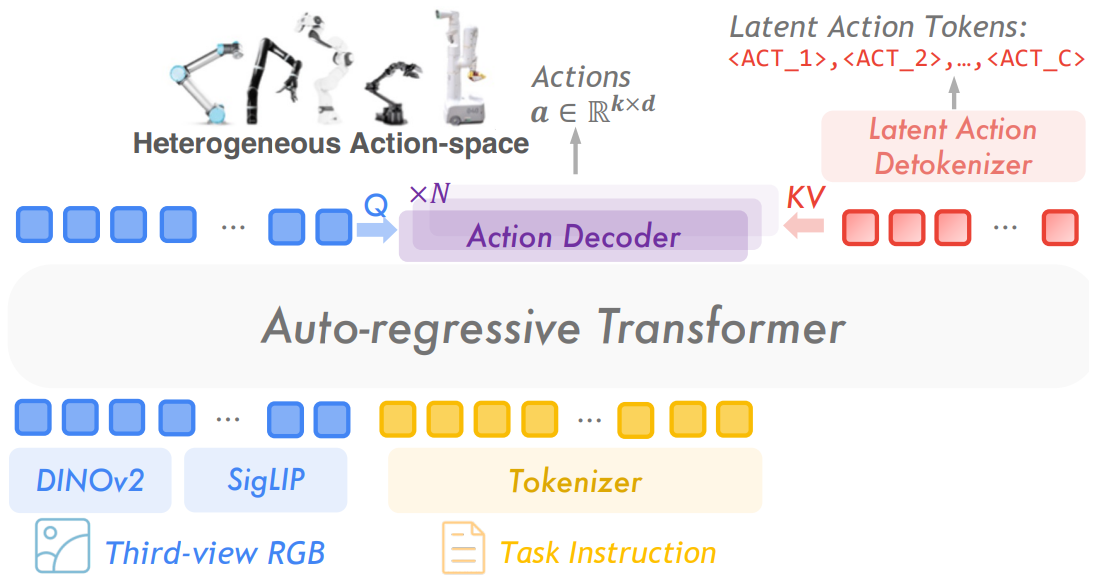

B. 通⽤策略的预训练

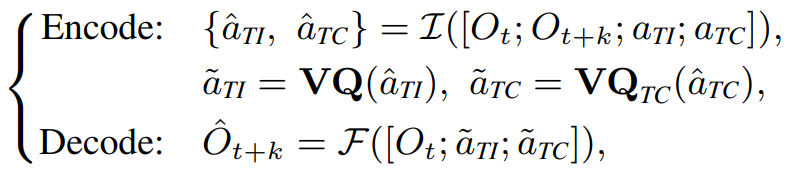

借助上一步训练好的潜在动作模型,我们继续在给定 ot+k 的情况下,用潜在动作 az 标记任何视频帧 ot。然后,我们使用这些标签来开发一个通用策略。为了与 Kim 等人 [39] 的研究保持一致,我们的通用策略建立在 Prismatic-7B [37] 视觉语言模型 (VLM) 之上。该架构集成了源自 SigLip [90] 和 DINOv2 [62] 的融合视觉编码器、用于将视觉嵌入与语言模态对齐的投影层,以及 LLaMA-2 大型语言模型 (LLM) [75]。与之前基于 LLM 的通用策略(即 RT-2 [10] 和 OpenVLA [39]通过将 LLaMA 标记器词汇表中不常用的单词映射到 [-1, 1] 内均匀分布的动作箱中)不同,直接在低级动作空间中进行规划,我们将词汇表扩展为 |C|个特殊标记,具体来说是 {ACT_1, ACT_2, ACT_3,..., ACT_C}。潜在动作会根据其在动作代码本中的索引投射到此词汇表中。这种方法保留了 VLM 的原始模型架构和训练目标,充分利用其预训练知识迁移到机器人控制任务。具体而言,我们的策略模型 π 接收观测值 o、任务指令 l 和潜在动作标记 az 的前缀,并进行优化以最小化下一个潜在动作负对数概率之和:(N个交叉熵损失的和)

其中 N 表示动作标记的总长度。我们在所有实验中均设置 N = 4(预测动作块长度是四)(相当于1s四个动作)。此外,经验证据表明,压缩动作空间(例如,从 OpenVLA [39] 中的 256^7 缩减到 |C| = 16 时的 16^4)可显著加速模型收敛。我们的方法仅需 960 个 A100 小时的预训练就取得了具有竞争力的结果,与 OpenVLA 预训练所需的 21,500 个 A100 小时相比,大幅减少了时间。

通过在统一的潜在动作空间内训练我们的策略,该模型充分利用了从跨领域数据集中获得的可迁移知识。与 Yang 等人 [86] 的研究不同,后者需要通过视觉上相似的自我中心运动(例如操作任务中的腕部摄像头运动和自我中心导航)手动对齐动作空间,而我们的方法则省去了这一步骤。因此,UniVLA 扩展了可用数据集的范围并提升了整体性能,证明了利用以任务为中心的潜在动作表征进行可扩展策略学习的有效性。

C. 部署后训练

潜在动作解码

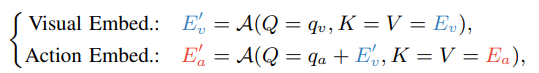

在下游自适应过程中,预训练的通才策略通过预测下游自适应过程中的下一个潜在动作来保持其具体化不可知的特性。为了弥合潜在动作与可执行行为之间的差距,采用了额外的动作解码器(如图 3 所示)。具体而言,首先通过多头注意力池 [43] 将视觉嵌入序列聚合为单个标记,然后将其用作查询,从潜在动作嵌入中提取信息。该过程表述如下:

(相当于串行)

其中 A 表示多头注意力机制,{Ev, Ea} 是来自 VLM 最后一层的视觉和潜在动作嵌入,{qv, qa} 是随机初始化的查询,分别用于提取视觉和动作信息。最终的动作嵌入 E'a 随后被线性投影到目标机器人系统的期望动作空间中。

图 3:通用策略的架构。我们的策略架构基于 Prismatic-7B 视觉语言模型 (VLM) [37],该模型将投影的视觉嵌入和标记化的任务指令作为输入,以自回归的方式预测潜在动作标记。为了适应特定的机器人系统,我们采用了专门的动作解码器头。这些解码器利用视觉信息从潜在动作中提取特定于上下文的特征,然后将其转换为具有异构动作空间的机器人系统的可执行控制信号。

鉴于潜在动作被设计为表示大约一秒间隔内发生的动作(如上文第三章 A 节所述),它们可以自然地解码为动作块 [93]。块的大小可以根据具体实施例轻松定制,以实现更流畅、更精确的控制。

在实践中,我们利用 LoRA [33] 进行参数高效的微调,以实现高效的自适应。加上仅包含 12.6M 个参数的动作头,可训练参数总数约为 123M。整个模型采用端到端训练,优化了下一个潜在动作预测损失以及真实动作与预测低级动作之间的 L1 损失。

从历史输出中学习

历史观测已被证明在增强机器人控制的顺序决策过程中发挥着关键作用 [60, 42, 45]。然而,直接向大型视觉-语言-动作模型提供多个历史观测值会引入显著的推理延迟,并导致视觉标记中出现冗余信息 [94, 45]。受大型语言模型 (LLM) 中成熟的思维链 (CoT) 推理范式 [80](该范式会生成中间推理步骤来处理复杂任务)的启发,我们提出利用历史潜在动作输出来促进机器人控制中的决策。与 LLM 逐步解决问题类似,我们在部署过程中的每个时间步将过去的动作融入到输入提示中。这为机器人策略建立了反馈回路,使策略能够从自身的决策中学习并适应动态环境。

为了将这种方法付诸实践,我们采用潜在动作模型来注释从历史帧中提取的动作。这些带注释的动作随后被映射到 LLaMA 标记词汇表中,并附加到任务指令中。在训练后期,历史动作输入被整合为输入,以赋予模型基于上下文的学习能力。在推理时,除初始步骤外,每个时间步都会纳入一个历史潜在动作步骤(编码为 N = 4 个标记)。实证结果表明,这种简单的设计能够提升模型性能,尤其是在长周期任务中(参见第四章 C 节)。

evaluton

A. 主要结果

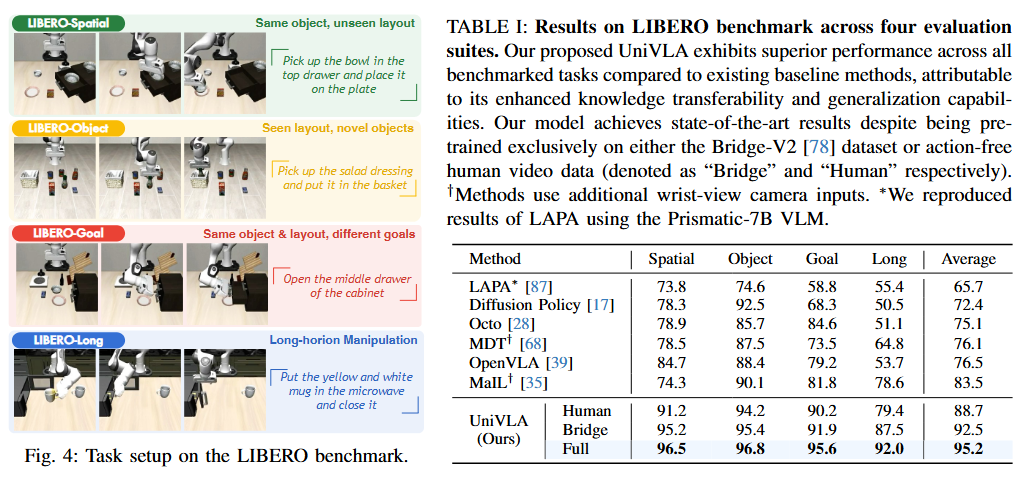

1)LIBERO 上的操纵基准

我们的模型仅在 Bridge-V2 [78] 数据集或无动作人体视频数据(分别表示为“Bridge”和“Human”)上进行了预训练,但仍取得了最佳结果。

† 方法使用了额外的腕部摄像头输入。我们使用 Prismatic-7B VLM 复现了 LAPA 的结果。

实验设置

我们基于操作数据、导航数据和人体视频数据(这些数据分别是 Open X-Embodiment (OpenX) 数据集 [63]、GNM 数据集 [72] 和人体视频 (Ego4D [29]) 的子集)预训练了完整的潜在动作模型。预训练细节见附录 A1。LIBERO 基准 [48] 包含四个任务套件,专门设计用于促进机器人操作的终身学习研究。我们的实验专注于目标任务套件内的监督微调,评估通过行为克隆训练的各种策略在成功任务演示上的性能。

四个任务,每个任务套件包含 10 个任务,每个任务包含 50 个人类遥控演示。

UniVLA 在 LIBERO-Long 上训练了 4 万步,在其他测试套件上训练了 3 万步,全局批次大小为 128。我们仅使用第三人称图像和语言指令作为输入。值得注意的是,LIBERO 中的任何样本均未包含在策略的预训练数据集和潜在动作模型的训练数据中,因此需要确保两者的普遍性。除了展示我们性能最佳的模型(已在完整数据集上预训练)的结果外,我们还提供了专门在 Bridge-V2 [78] 和人类数据上预训练的模型的结果,在表 I 中分别标记为“Bridge”和“Human”。为了最小化方差,所有方法均在每个任务套件上进行了超过 500 次试验(即每个任务 50 次试验)的评估,报告的性能反映了三个种子的平均成功率。

结果

表 1 中的结果展示了 UniVLA 在所有四个评估套件中的卓越性能,显著超越了之前的通用策略,例如 OpenVLA、LAPA 和 Octo。值得注意的是,UniVLA 通过在完整数据集上进行预训练,平均性能达到 95.2%,分别比 OpenVLA 和 LAPA 高出 18.7% 和 29.5%。尽管仅在 Bridge-V2 数据集上进行预训练,UniVLA 仍达到了 92.5% 的平均性能,优于 MaIL(83.5%)和 MDT(76.1%)等利用额外腕视摄像头输入的方法。使用人类数据进行预训练的策略比使用领域内 OpenX 数据训练的 OpenVLA 高出 12.2%。总而言之,UniVLA 展现出无与伦比的知识迁移能力,并在 LIBERO 基准上创造了新的最高水平。我们在附录 B 中提供了 CALVIN 和 SimplerEnv 基准的更多结果。

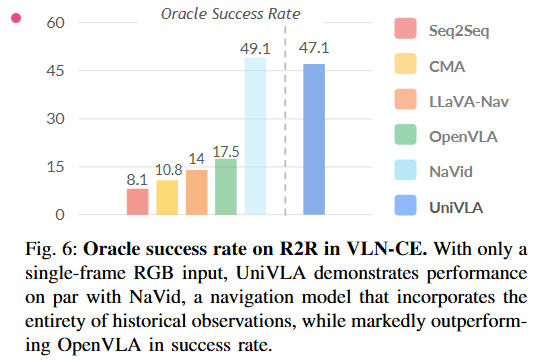

2)Room2Room 上的导航基准测试

实验设置。在本实验中,我们在 VLN-CE 基准 [41] 上评估 UniVLA,以评估其在导航任务上的表现。

这些基准测试提供了一组语言引导的导航任务和连续环境,用于在重建的逼真室内场景中执行低级操作。具体而言,我们专注于 VLN-CE 中的 Room2Room (R2R) [4] 任务,这是视觉与语言导航 (VLN) 领域最受认可的基准测试之一。所有方法均基于 R2R 训练集的 10,819 个样本进行训练,并基于 R2R val-unseen 集的 1,839 个样本进行评估。我们使用 oracle 成功率来评估导航性能。如果智能体在 VLN-CE 中到达目标 3 米范围内,则该回合被视为成功。

基线。为了确保与 UniVLA 进行公平比较,我们评估了仅使用 RGB 的方法,这些方法无需深度或里程计数据,可直接预测 VLN-CE 环境中的低级动作。选定的基线:

图 6:VLN-CE 中 R2R 上的 Oracle 成功率。仅使用单帧 RGB 输入,UniVLA 的性能就与 NaVid(一种整合了全部历史观测数据的导航模型)相当,同时在成功率上明显优于 OpenVLA。

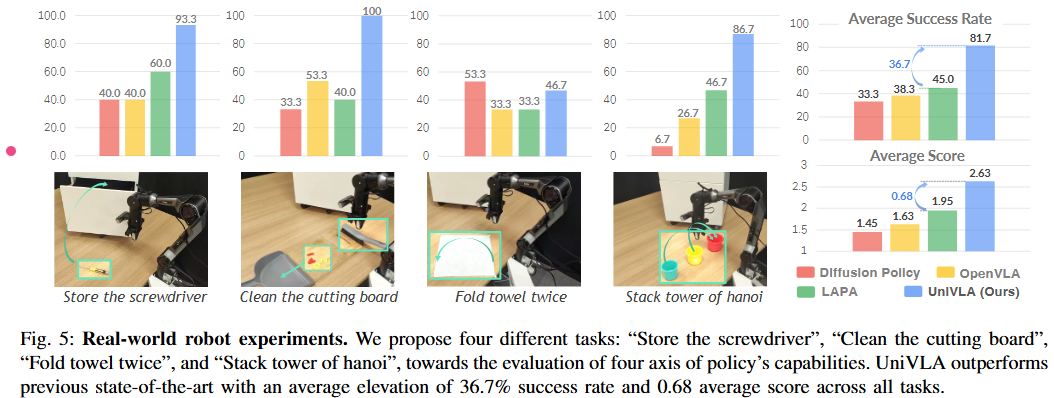

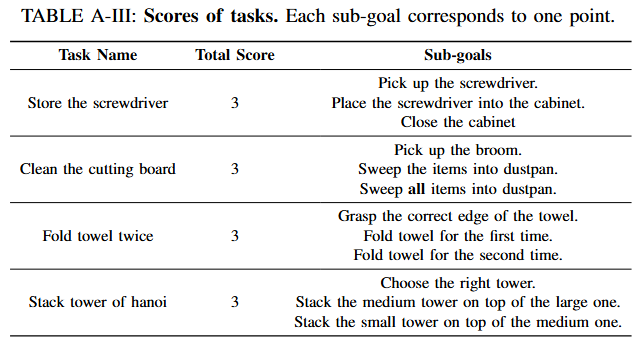

3)现实世界的机器人部署

所有实际实验均采用 AgileX Robotics 的 Piper 机械臂进行,该机械臂具有 7 自由度动作空间和第三视角 Orbecc DABAI RGB-D 相机,我们仅使用 RGB 图像作为输入。为了评估策略,我们设计了一套涵盖策略能力各个维度的综合任务,包括:

1)空间意识:拿起螺丝刀放入柜子并关上门(“存放螺丝刀”)。

2)工具使用和非抓握操作:拿起扫帚,将切菜板上的物品扫入簸箕(“清洁切菜板”)。

3)可变形物体操作:将毛巾对折两次(“将毛巾对折两次”)。

4)语义理解:先将中塔堆叠在大塔之上,再将小塔堆叠在中塔之上。(“堆叠河内塔”)

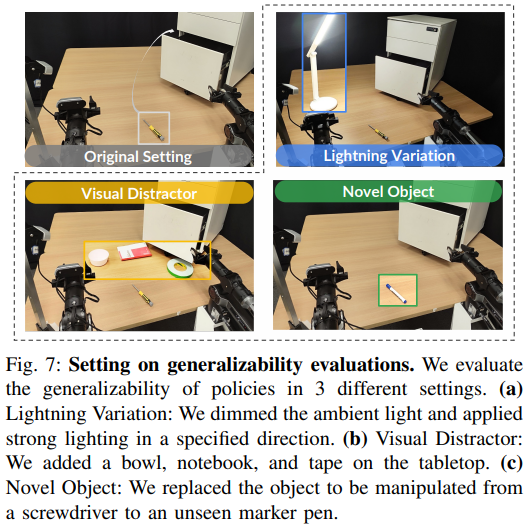

对于每个任务,我们收集 20 到 80 条轨迹,并根据任务复杂度进行缩放,以微调我们的模型。为了全面评估泛化能力

我们设计的实验涵盖了多个维度的未见过的场景,包括光照变化、视觉干扰因素和物体泛化(见图 7)。鉴于单凭成功率不足以反映策略性能或区分其能力,我们引入了一个阶梯式评分系统。对于四项任务中的每一项,我们分配最高 3 分,以反映任务执行过程中不同阶段的完成情况。详细的评分标准、任务设置和实验结果见附录 C。

基线。我们选择扩散策略 [17],以及通用策略、OpenVLA [39] 和 LAPA [87] 作为基线。扩散策略以单任务方式训练,而通用模型则同时在所有任务上进行指令输入训练。为了公平比较,我们使用 Prismatic-7B VLM [37] 和动作解码器头复现了 LAPA,并将其架构与我们的方法保持一致。这种设置使我们能够分离并强调以任务为中心的潜在动作空间的贡献。具体参数和架构细节可在附录 C 中找到。

图 5:真实世界机器人实验。我们提出了四项不同的任务:“存放螺丝刀”、“清洁砧板”、“折叠毛巾两次”和“堆叠汉诺塔”,以评估四维策略的能力。UniVLA 的表现超越了之前的最优水平,平均成功率提升了 36.7%,所有任务的平均得分提升了 0.68。

结果。我们在图 5 中绘制了任务成功率。单任务扩散策略 (DP) 针对轨迹保真度和低延迟控制进行了优化,在诸如折叠毛巾等任务中表现出色,因为成功的关键在于一旦选择了正确的毛巾边缘,就必须执行固定轨迹。这种特化使得 DP 在该任务中的成功率 (53.3%) 高于 UniVLA (46.7%)。然而,UniVLA 的分步得分更高(2.47 vs. DP 的 2.33,详见附录 C),这反映了它即使在最终执行失败的情况下也能可靠地完成中间阶段(例如边缘选择、部分折叠)的能力——这在动态的现实世界环境中至关重要,因为在这种环境中,部分进展至关重要。

这种权衡源于 UniVLA 的通用设计:虽然 DP 的单任务训练能够最大限度地提高特定工作流程的轨迹精度,但在需要语义推理的任务中却举步维艰(例如,在河内塔游戏中,DP 的成功率仅为 6.7%)。相比之下,UniVLA 展现出卓越的泛化能力和语义理解能力,成功率高达 86.7%,无与伦比。在需要精确操控物体和空间推理的场景中(例如在“存放螺丝刀”任务中,物体的姿态和位置各不相同),其 93.3% 的成功率进一步证明了这一点。

此外,我们的方法通过在紧凑的潜在动作空间中进行规划,在 NVIDIA RTX 4090 GPU 上实现了 10Hz 的实时闭环推理频率,并允许高效的动作块预测(我们在实践中使用的块大小为 12)。尽管 OpenVLA 在大规模机器人数据集上进行了广泛的训练,但由于推理延迟,执行过程中仍存在卡顿(例如,预测单个动作步骤时为 0.18 秒,预测大小为 4 的动作块时为 0.68 秒),导致实际性能不佳,平均成功率仅为 38.3%。总而言之,UniVLA 的成功率比排名第二的 LAPA 高出 36.7%,平均得分高出 0.68,这证明了其在实际应用中的有效性,以及我们提出的以任务为中心的潜在动作空间的优势。

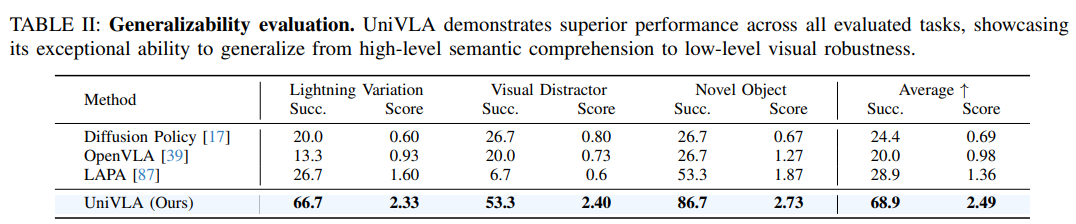

泛化能力分析

我们从三个不同的角度考察了策略的泛化能力,具体实验设置如图 7 所示。表 II 中的结果突显了 UniVLA 卓越的泛化能力,在成功率和分步得分方面显著优于基线方法。在不同光照条件下,UniVLA 的成功率达到 66.7%,超过了 Diffusion Policy(20.0%)、OpenVLA(13.3%)和 LAPA(26.7%)。展现出对环境变化的稳健性。在存在视觉干扰的场景下,更依赖语义信息的策略(例如 LAPA 和 UniVLA)会经历相对明显的性能下降。在新的物体设置中,我们用记号笔替换了螺丝刀,并相应地调整了通用策略的语言输入。这一变化对我们的策略影响甚微,成功率仅下降了 6.6%。总体而言,UniVLA 的平均成功率为 68.9%,平均得分为 2.49,显著优于之前的 VLA,例如 LAPA(28.9%,1.36)和 OpenVLA(20.0%,0.98)。我们还在补充材料中提供了视频演示。

图 7:泛化能力评估的设置。我们在 3 种不同的设置中评估策略的泛化能力。(a)光照变化:我们调暗环境光,并在指定方向施加强光。(b)视觉干扰:我们在桌面上放置了一个碗、一个笔记本和一条胶带。(c)新物体:我们将操作对象从螺丝刀替换为看不见的记号笔。

B. 关于潜在动作的讨论

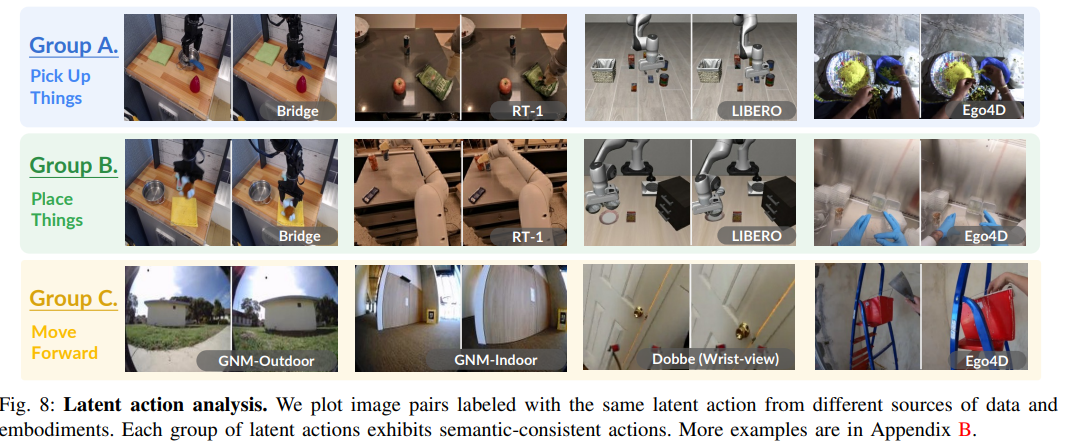

定性分析。我们通过可视化来自不同数据源、共享相同潜在动作的图像对(如图 8 所示)来研究潜在动作的跨域可迁移性。每组潜在动作在不同具体化中都映射到语义一致的行为(例如,A 组中表示“拿起东西”的潜在动作)。值得注意的是,我们的潜在动作模型在未使用 LIBERO [48] 数据集的任何数据进行训练的情况下,能够有效地推广到这个未知领域,并标记出准确的动作。此外,LAM 学会了将操作中的腕部视角观察与导航中的自我中心动作相结合,如 C 组中所示,这突显了其连接不同模态和具体化的能力。

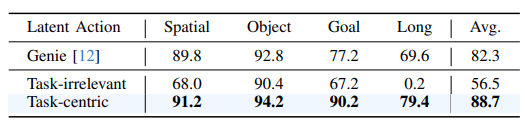

定量分析。为了评估我们提出的动态分解方法在以任务为中心的潜在动作学习中的有效性,我们评估了使用来自不同潜在动作的标签训练的策略的部署性能。LIBERO 上的结果如表 III 所示。我们仅使用包含大量不可预测运动的真人视频对策略进行预训练,以放大我们方法的优势。与 Genie [12] 中引入的、能够捕捉所有视觉变化的潜在动作构建方法相比,我们的方法表现出明显的优势。具体而言,我们在平均成功率方面实现了 6.4% 的提升,LIBERO-Goal 和 LIBERO-Long 取得了显著提升(分别提升了 13% 和 9.8%)。相比之下,与任务无关的潜在动作与真实动作的匹配度较低,这使得策略难以根据观察结果和任务指令推断出这些动作。这体现在训练过程中动作 token 预测准确率较低以及推理性能较差。值得注意的是,使用与任务无关的潜在动作进行训练,在颇具挑战性的 LIBERO-Long 基准测试中,其成功率接近于零。

表三:使用不同潜在动作在 LIBERO 上的表现。我们在 Ego4D [29] 上对策略进行了预训练,该模型包含具有多样化动作和与任务无关动态的人类视频,以证明我们成功地分离了以任务为中心的动态。与任务无关的动态性能较差,而以任务为中心的潜在动作学习能够生成更有意义的动作表征,最终实现更高的部署成功率。

C. 更多消融

数据可扩展性

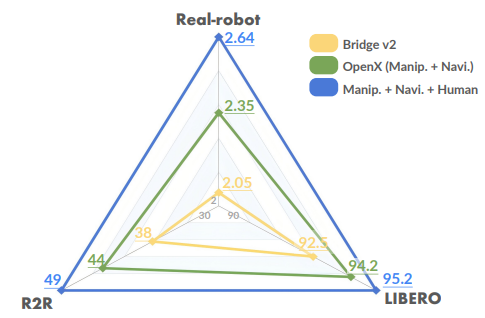

图 9 展示了 UniVLA 如何随着数据规模的增长以及不同领域数据的融合而发展。尽管 UniVLA 仅使用 Bridge-V2 [78] 进行预训练,就已经在 LIBERO 上创造了新的 SOTA 纪录。OpenX [63] 和 Ego4D [29] 中的跨具体化数据进一步将平均成功率提高了 2.0%。虽然在 LIBERO 基准测试中的表现似乎已趋于稳定,但在我们具有挑战性的真实世界测试套件中,我们观察到性能的持续提升。在真实世界的评估中,与仅使用 Bridge 进行预训练相比,将预训练数据扩展到 OpenX 可将平均得分提高 0.3 分。进一步融入人类数据,尽管缺乏动作标签并引入了巨大的具体化差距,但仍可额外提高 0.28 分。在 R2R 导航基准测试中也观察到了类似的性能提升趋势,这突显了我们方法的可扩展性,因为它有效地利用了多样化的数据源。

图 9:数据可扩展性。UniVLA 通过整合来自 OpenX 的跨具体化数据和未标记的人类演示,有效地扩展了其预训练语料库,从而不断提高下游性能。

数据效率

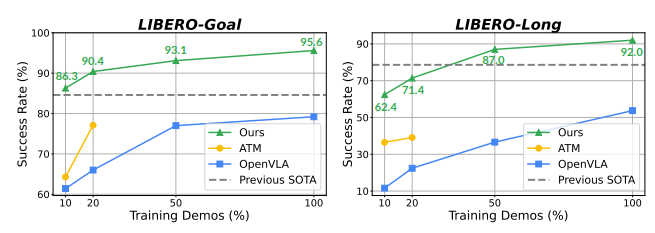

上一节重点介绍了 UniVLA 在预训练数据方面的可扩展性,并持续提升其性能。接下来,我们将探索其如何以最少的数据高效适应未知环境,如图 10 所示。具体而言,我们使用部分训练数据评估了其在 LIBERO-Goal 和 LIBERO-Long 基准测试中的表现。与之前的通用策略(例如 OpenVLA [39])以及显式点预测方法(例如 ATM [81])相比,UniVLA 展现出了卓越的数据效率。值得注意的是,仅使用 10% 的演示数据,UniVLA 在 LIBERO-Goal 上的成功率(86.3% vs. 79.2%)就高于在完整数据集上训练的 OpenVLA。此外,它分别仅使用 10% 和 50% 的训练集,在 LIBERO-Goal 和 LIBERO-Long 上创造了新的最佳性能。通过在统一的潜在动作空间内进行规划,UniVLA 最大限度地利用了预训练知识,从而能够高效地适应新环境。

图 10:数据效率。我们展示了 UniVLA 在不同数据集比例(10%、20%、50% 和完整数据集)下的成功率。我们的策略可以适应未知环境,无需大量专家演示进行训练,这显示出显著优于基线的优越性。

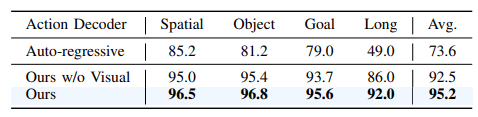

潜在动作解码器

我们将我们提出的动作解码方案与自回归方法进行了比较,后者像 OpenVLA 和 LAPA 一样顺序生成离散化动作。如表 IV 所示,我们的方法在所有测试套件中始终保持更高的成功率,在 LIBERO-Long 中取得了 42.1% 的显著提升。利用视觉嵌入作为查询,通过减少多模态分布中的歧义性来增强动作解码,平均成功率额外提升了 2.2%。

此外,如第三节 A 节所述,潜在动作旨在封装一秒时间范围内的动态。鉴于这种时间结构,将潜在动作解码为动作组块[93]是一种直观的选择,可以使组块大小与目标具体化的控制频率保持一致。这是通过简单地扩展最终线性投影层的输出维度来实现的,同时与自回归方法相比,引入的额外推理成本可以忽略不计。

表四:解码器设计改进。“自回归”表示我们遵循 OpenVLA 和 LAPA 的方法,以自回归的方式在离散化的动作箱上按顺序预测动作。“w/o visual”表示不使用视觉嵌入作为解码潜在动作的查询输入,如图 3 所示。所提出的动作解码器头,加上视觉特征,被证明是最有效的,在所有测试套件中都获得了最高的结果。

历史潜在动作

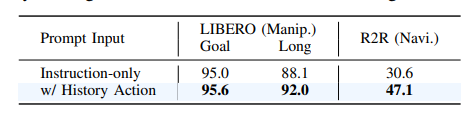

如第三节 C 部分所述,我们利用历史潜在动作来增强指令输入,以增强序列决策。我们评估了这种最小化架构修改在操作和导航任务中的有效性,并在表 V 中给出了定量结果。该方法在长视域场景中尤其有效:仅使用四个输入标记(代表一个潜在动作组)即可将成功率提高 16.5%(R2R)和 3.9%(LIBERO-Long)。延长历史视域会导致收益递减。与需要冗余多帧视觉标记来获取时间上下文的方法(例如 [91, 45])不同,我们的设计提供了紧凑的历史指导,同时通过自参考输出实现了迭代策略细化。这种精简的集成增强了情境感知能力,而不会产生不必要的计算开销。

表五:关于历史动作使用的消融。将前几步的潜在动作输出合并为提示输入,尽管简单,但可以提高性能,尤其是在 LIBERO-Long 和 R2R 等长视界任务中。

总结

在本研究中,我们引入了 UniVLA 模型,这是一个视觉-语言-动作模型,它在统一的、以任务为中心的潜在动作空间内进行规划,从而能够高效地适应新型机器人设置。通过广泛的评估,我们证明了 UniVLA 在多个操作和导航基准测试中均达到了最佳性能。该模型还展现出可扩展性,能够利用异构预训练数据来提升其下游性能,即使在数据有限的场景下也能保持高度的适应性。我们的目标是为下一代通用策略铺平道路,使其能够利用网络规模的视频数据进行训练,不受本体差距或动作标签可用性的限制。

限制和未来

潜在动作设计

虽然 UniVLA 推进了通用机器人策略,但仍存在一些局限性。固定的潜在动作粒度和预定义的码本大小可能并非适用于所有任务或具体实现。探索基于环境条件动态调整这些参数的自适应机制,或许能够提升性能。此外,UniVLA 主要在单臂操作任务上进行评估。在我们的框架内,潜在动作标记所代表的动作粒度相对固定。将框架扩展到双臂人形系统或灵巧手可能需要更复杂、更细粒度的动作空间建模。我们将此留待未来探索。

语言标注要求

关于语言粒度,与任务相关的潜在动作旨在编码对任务完成至关重要的自我主体运动,同时排除非自我动态(例如,“烧水”时水壶冒出的蒸汽)。我们的数据集主要包含描述短期动作而非高级目标的细粒度指令。虽然更具表达力的语言指令可能会减少潜在行动学习中的歧义性,但我们想强调的是,我们的方法能够从不同粒度的指令中进行可扩展的学习。无需对指令进行任何特殊处理,我们的方法就能胜过简单的潜在行动学习方法。

与世界模型的集成

潜在动作模型的解码器本质上是一个世界模型,它根据潜在动作预测未来的观测值。它可以基于我们策略实时采样的潜在动作进行条件处理,并生成多个相应的视觉规划。这为通过强化学习进行参考对齐 [92] 和通过规划树 [25] 进行测试时间扩展打开了大门,其中可变学习模型 [54] 或启发式函数可以用作奖励模型。

情境学习能力

对于提升视觉-语言-动作模型的性能上限至关重要。鉴于我们发现,所提出的潜在动作模型能够提取连接人类和机器人操作的可迁移运动表征,我们建议将人类演示视频编码成一系列紧凑的潜在动作嵌入,作为情境样本(概念上,潜在动作模型相当于视频分词器)。这种方法无需额外微调即可实现零样本技能习得。我们将在未来的工作中探索这一方向。

附录

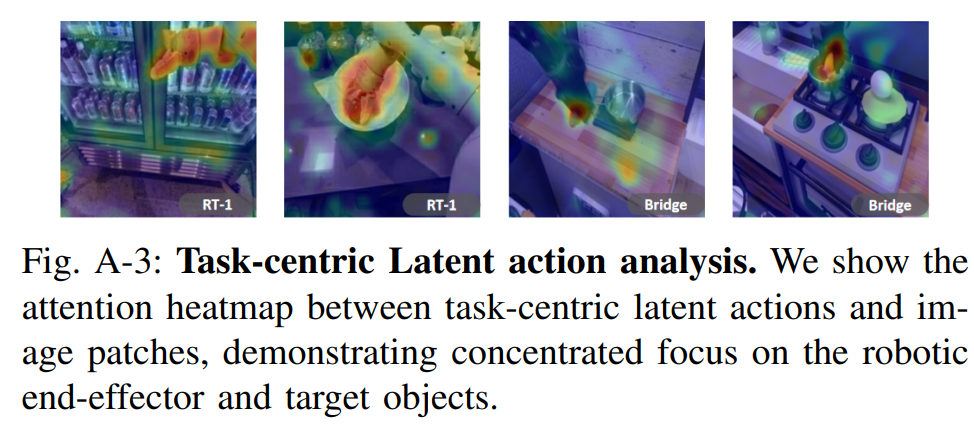

可视化了已学习到的以任务为中心的潜在动作与图像块之间的注意力图。热力图揭示了注意力集中在任务关键区域:机械臂的末端执行器(例如,夹持器)和交互物体(例如,鸡蛋),同时忽略了无关的背景。这表明潜在动作本身就编码了以任务为中心的空间先验,仅关注下游学习所需的实体。

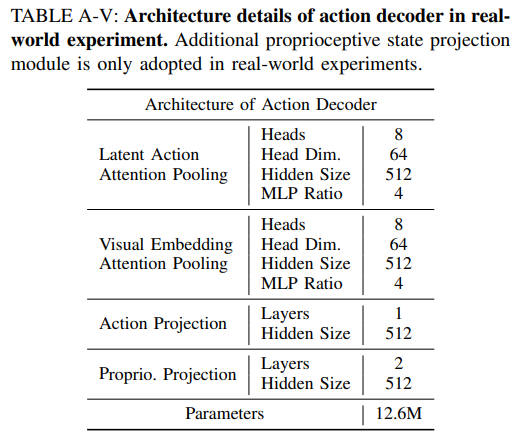

动作解码器的架构

在 LAPA 和我们的方法的动作解码器架构设计中,我们使用两个多头注意力模块来处理潜在动作和视觉嵌入(另请参阅第三节 C 部分),并使用一个 MLP 层来处理本体感受状态。然后将生成的嵌入连接起来,并通过投影层映射到所需的动作维度。详细参数见表 AV。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

所有评论(0)