基于DJL与Spring框架整合的深度学习模型训练与推理实战

Deep Java Library(DJL)是Amazon推出的开源深度学习框架,专为Java开发者设计,旨在弥合Java生态与AI能力之间的鸿沟。其核心理念是“引擎无关性”,通过抽象层统一接入PyTorch、TensorFlow、MXNet等后端引擎,开发者无需编写Python代码即可完成模型训练与推理。// 示例:无需关心底层引擎,自动选择可用的引擎该设计使得企业可在不改变现有Java技术栈的

简介:Fast Deep Java Library(DJL)是一个专为Java及JVM平台设计的高效开源深度学习库,支持无缝集成Spring等主流企业级框架,简化了在Java环境中进行深度学习开发的复杂性。本资源包涵盖DJL核心组件、模型构建、训练、评估、保存加载与推理全流程,并提供与Spring Boot/Spring Cloud集成方案,助力开发者快速实现图像识别、自然语言处理等智能服务。内容适合初学者和进阶开发者,通过实战示例掌握DJL在企业应用中的落地实践。

1. DJL框架简介与核心架构

DJL的设计理念与引擎抽象机制

Deep Java Library(DJL)是Amazon推出的开源深度学习框架,专为Java开发者设计,旨在弥合Java生态与AI能力之间的鸿沟。其核心理念是“引擎无关性”,通过抽象层统一接入PyTorch、TensorFlow、MXNet等后端引擎,开发者无需编写Python代码即可完成模型训练与推理。

// 示例:无需关心底层引擎,自动选择可用的引擎

Model model = Model.newInstance("resnet");

Predictor<Image, Classifications> predictor = model.newPredictor(new ImageClassificationTranslator());

该设计使得企业可在不改变现有Java技术栈的前提下,无缝集成AI能力,尤其适合Spring生态下的微服务架构。下一节将深入解析其模块化架构如何支撑这一目标。

2. DJL与Spring框架整合实践

在企业级Java应用日益复杂的背景下,人工智能能力的集成已不再局限于独立服务或离线分析场景。随着微服务架构的普及和业务对实时智能决策的需求增长,将深度学习模型无缝嵌入现有后端系统成为关键挑战。Spring作为Java生态中最主流的企业级开发框架,凭借其强大的依赖注入、AOP支持、事务管理以及与云原生技术栈的良好兼容性,自然成为承载AI服务的理想平台。而Deep Java Library(DJL)作为一种专为Java开发者设计的现代化深度学习库,提供了无需依赖Python环境即可完成模型加载、推理甚至训练的能力。两者的结合不仅提升了AI功能的服务化效率,也显著降低了运维复杂度。

本章聚焦于如何在Spring生态系统中实现DJL的工程化落地,重点探讨从项目结构搭建到服务封装、再到安全与可观测性增强的完整链路。通过实际代码示例、配置策略和架构图解,深入剖析DJL与Spring Boot之间的协同机制,并提出适用于生产环境的最佳实践路径。

2.1 Spring生态与AI服务融合的必要性

现代软件系统的智能化转型正在加速推进,传统以规则驱动的业务逻辑逐渐被数据驱动的预测模型所补充甚至替代。无论是推荐系统中的用户行为建模、金融风控中的异常检测,还是客服系统中的语义理解,AI能力已成为提升产品核心竞争力的重要组成部分。然而,这些模型通常由Python生态构建并部署为独立服务,导致与主业务系统的耦合松散、调用延迟高、维护成本大。在此背景下,将AI模块直接融入Spring主导的后端服务体系,具备极强的现实意义。

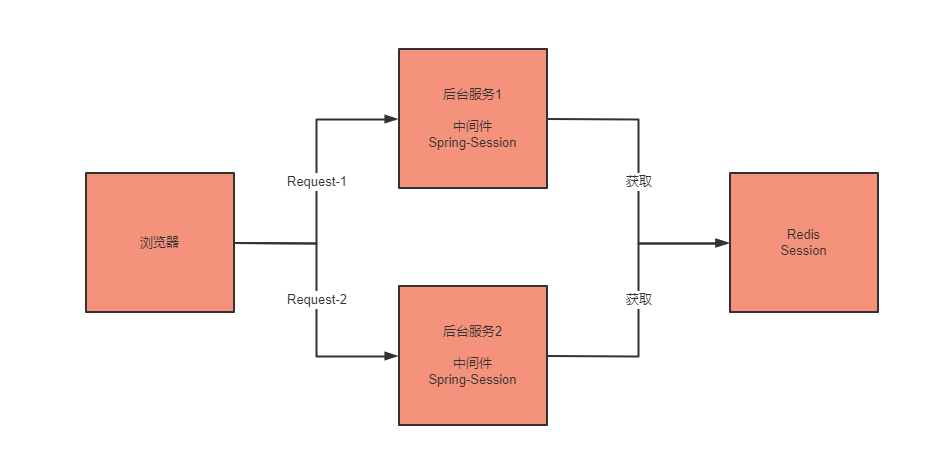

2.1.1 微服务架构下AI能力的服务化需求

当前大多数企业采用基于Spring Cloud或Kubernetes的微服务架构进行系统拆分。每个服务负责特定领域功能,如订单处理、用户认证、支付网关等。当需要引入AI能力时,常见的做法是将其封装为独立的“AI微服务”,对外暴露REST或gRPC接口供其他服务调用。这种模式虽实现了职责分离,但也带来了新的问题:

- 网络开销增加 :每次推理请求都需要跨进程通信,尤其在高频调用场景下容易造成瓶颈;

- 版本同步困难 :模型更新需重新部署整个AI服务,难以做到灰度发布或按需切换;

- 资源利用率低 :多个微服务共享同一模型时无法有效复用内存中的模型实例;

- 调试复杂 :调用链路变长,日志追踪、错误定位难度上升。

因此,更优的解决方案是在业务服务内部直接集成轻量级推理引擎,使AI能力像普通Service组件一样被本地调用。这正是DJL的价值所在——它允许开发者在Java进程中直接加载PyTorch、TensorFlow等主流框架导出的模型,避免了跨语言交互带来的性能损耗和部署复杂性。

以下流程图展示了传统AI服务架构与本地集成模式的对比:

graph TD

A[客户端请求] --> B{传统模式}

B --> C[业务微服务]

C --> D[远程AI服务]

D --> E[(模型推理)]

E --> F[返回结果]

G[客户端请求] --> H{本地集成模式}

H --> I[业务微服务 + DJL]

I --> J[(本地模型推理)]

J --> K[返回结果]

style D fill:#f9f,stroke:#333

style I fill:#bbf,stroke:#333

该图清晰地表明,在本地集成模式中,模型推理发生在同一个JVM进程中,极大减少了I/O等待时间。同时,由于模型加载由Spring容器统一管理,可借助Bean生命周期机制实现懒加载、预热、缓存等功能,进一步提升系统响应速度。

此外,从DevOps角度看,将AI能力内嵌至业务服务还能简化CI/CD流程。例如,在GitLab CI流水线中只需打包一个JAR文件即可完成部署,无需额外维护模型服务镜像或配置服务发现规则。

| 架构维度 | 传统远程AI服务 | 本地集成DJL方案 |

|---|---|---|

| 调用延迟 | 高(HTTP/gRPC往返) | 低(进程内调用) |

| 部署复杂度 | 高(需独立部署、注册中心) | 低(随主服务一起发布) |

| 模型热更新 | 支持但需滚动更新 | 可结合@RefreshScope动态替换 |

| 内存占用 | 多实例重复加载模型 | 单例共享,节省内存 |

| 故障隔离性 | 强 | 弱(影响主服务稳定性) |

| 开发协作成本 | 高(需跨团队协调) | 低(Java团队自主完成) |

综上所述,在微服务架构中推动AI能力的服务化,不仅要考虑功能性输出,更要关注性能、可维护性和团队协作效率。通过DJL与Spring的整合,能够在保障服务稳定性的前提下,实现AI能力的高效复用与快速迭代。

2.1.2 Spring Boot作为后端服务载体的优势分析

Spring Boot以其“约定优于配置”的理念和开箱即用的特性,已经成为Java后端开发的事实标准。其自动装配机制、内嵌Web服务器、健康检查端点、外部化配置等特性,极大提升了服务开发效率。将DJL集成进Spring Boot应用,不仅能享受上述便利,还可充分利用其成熟的扩展机制来优化AI模块的行为。

首先,Spring Boot的 ApplicationContext 为模型管理提供了天然的容器支持。我们可以将训练好的模型注册为单例Bean,在应用启动时完成初始化,后续所有控制器均可通过@Autowired注入使用。这种方式避免了频繁创建和销毁模型对象带来的资源浪费。

其次,Spring Boot的Profile机制可用于区分不同环境下的模型加载策略。例如,在开发环境中可以使用小型测试模型加快启动速度;而在生产环境中则加载完整精度的大模型。相关配置如下所示:

spring:

profiles: dev

djl:

model-path: classpath:/models/test_model.zip

engine: PyTorch

spring:

profiles: prod

djl:

model-path: /opt/models/prod_model.pt

engine: PyTorch

num-threads: 8

再者,Spring Boot Actuator提供的 /actuator/health 、 /actuator/metrics 等端点,可用于监控模型是否成功加载、推理次数统计、内存使用情况等关键指标,便于实现自动化告警和容量规划。

更重要的是,Spring Boot强大的生态系统支持多种增强手段:

- 使用 @Scheduled 定时任务定期拉取远程模型更新;

- 借助 CircuitBreaker (如Resilience4j)防止因模型推理超时导致服务雪崩;

- 利用 @Cacheable 缓存高频输入的结果,减少重复计算;

- 结合 ThreadPoolTaskExecutor 控制并发推理线程数,防止OOM。

以下是一个典型的Spring Boot主类结构,展示如何启用DJL相关组件扫描:

@SpringBootApplication

@ComponentScan(basePackages = {"com.example.ai", "ai.djl.spring"})

public class AIServiceApplication {

public static void main(String[] args) {

SpringApplication.run(AIServiceApplication.class, args);

}

}

其中 ai.djl.spring 是DJL官方提供的Spring集成包路径,包含自动装配逻辑。通过显式声明扫描范围,确保自定义模型处理器和服务能被正确识别。

最后,Spring Boot对GraalVM Native Image的支持也为未来构建超快启动的原生AI服务奠定了基础。虽然目前DJL在Native Image环境下仍有部分限制(如反射调用),但社区已在积极适配,预计不久将实现全栈编译优化。

总之,Spring Boot不仅是理想的AI服务宿主,更是连接传统企业系统与前沿AI技术的关键桥梁。通过合理设计,可以在不影响原有业务逻辑的前提下,平滑引入智能化能力,真正实现“AI as a Component”。

2.2 DJL与Spring Boot的工程级集成方案

要实现DJL在Spring Boot中的稳定运行,必须从项目依赖、自动装配机制到资源管理进行全面把控。不同于简单的工具类引用,深度学习模型具有体积大、初始化慢、依赖本地库等特点,若不加以控制极易引发启动失败、内存溢出等问题。为此,需制定一套标准化的集成流程,涵盖依赖管理、条件化装配、Bean生命周期调控等多个层面。

2.2.1 Maven依赖引入与组件扫描配置

在Maven项目中,正确引入DJL及其Spring扩展模块是第一步。建议优先使用官方发布的BOM(Bill of Materials)来统一版本管理,避免因版本冲突导致类找不到或方法不兼容的问题。

<dependencyManagement>

<dependencies>

<dependency>

<groupId>ai.djl</groupId>

<artifactId>bom</artifactId>

<version>0.27.0</version>

<type>pom</type>

<scope>import</scope>

</dependency>

</dependencies>

</dependencyManagement>

<dependencies>

<!-- 核心DJL库 -->

<dependency>

<groupId>ai.djl</groupId>

<artifactId>djl-api</artifactId>

</dependency>

<!-- PyTorch引擎支持 -->

<dependency>

<groupId>ai.djl.pytorch</groupId>

<artifactId>pytorch-engine</artifactId>

</dependency>

<!-- 自动下载原生库 -->

<dependency>

<groupId>ai.djl.pytorch</groupId>

<artifactId>pytorch-native-auto</artifactId>

</dependency>

<!-- Spring Boot集成模块 -->

<dependency>

<groupId>ai.djl.springboot</groupId>

<artifactId>djl-spring-boot-starter</artifactId>

<version>0.27.0</version>

</dependency>

<!-- Web支持 -->

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

</dependencies>

上述配置中, djl-spring-boot-starter 是关键组件,它包含了自动配置类 DjlAutoConfiguration ,能够根据classpath判断是否存在DJL相关类,并自动注册ModelZoo、Criteria等Bean。

为了确保自定义组件能被Spring容器识别,应在启动类上明确指定扫描包路径:

@SpringBootApplication

@ComponentScan({

"com.yourcompany.ai.controller",

"com.yourcompany.ai.service",

"ai.djl.spring"

})

public class AiApplication { /* ... */ }

若未显式声明 @ComponentScan ,可能导致第三方Starter中的配置类未被加载,从而引发 NoSuchBeanDefinitionException 。

此外,还需注意JDK版本兼容性。DJL要求至少JDK 8u191以上版本,推荐使用JDK 11或17以获得更好的GC性能和Vector API支持。

2.2.2 使用@ConditionalOnClass实现DJL自动装配

Spring Boot的自动装配机制依赖于条件注解来决定是否创建某个Bean。 @ConditionalOnClass 是最常用的条件之一,用于检测特定类是否存在classpath中。DJL的自动配置类正是基于此机制实现无侵入式集成。

查看 djl-spring-boot-starter 源码中的 DjlAutoConfiguration.java 片段:

@Configuration

@ConditionalOnClass(Model.class)

@EnableConfigurationProperties(DjlProperties.class)

public class DjlAutoConfiguration {

@Bean

@ConditionalOnMissingBean

public Model model(DjlProperties properties) throws IOException, ModelNotFoundException {

return Model.newInstance(properties.getName())

.setModelUrl(properties.getModelPath())

.build();

}

@Bean

public Predictor predictor(Model model) {

return model.newPredictor();

}

}

逐行解析如下:

- 第2行: @ConditionalOnClass(Model.class) 表示只有当 ai.djl.Model 类存在时才加载该配置类,防止在未引入DJL依赖时抛出ClassNotFoundException。

- 第4行: @EnableConfigurationProperties(DjlProperties.class) 将 application.yml 中的 djl.* 配置映射为Java对象。

- 第7–13行:定义 Model Bean,若上下文中尚未存在同类型Bean,则自动创建一个基于配置路径的模型实例。

- 第15–18行:创建 Predictor Bean,封装推理会话,供Controller调用。

这种设计使得开发者无需手动编写工厂类,只需配置参数即可完成模型注入。例如:

djl:

name: sentiment-analysis

model-path: file:///data/models/sentiment.pt

此时Spring会在启动时自动加载该模型,并可通过 @Autowired Model model 直接使用。

值得注意的是, @ConditionalOnMissingBean 保证了灵活性——如果用户希望自定义模型加载逻辑(如从S3拉取),只需提供自己的 @Bean 定义,便不会覆盖默认行为。

2.2.3 Bean生命周期管理与模型初始化时机控制

深度学习模型通常占用数百MB甚至GB级内存,且加载过程涉及解压、权重解析、CUDA初始化等耗时操作。若在Spring容器启动阶段同步执行,可能导致应用启动超时(特别是在Kubernetes探针检测场景下)。因此,必须精细控制模型的初始化时机。

一种常见做法是使用 SmartLifecycle 接口延迟加载模型:

@Component

public class LazyModelLoader implements SmartLifecycle {

private boolean isRunning = false;

private final ModelService modelService;

public LazyModelLoader(ModelService modelService) {

this.modelService = modelService;

}

@Override

public void start() {

if (!isRunning) {

CompletableFuture.runAsync(modelService::loadModel);

isRunning = true;

}

}

@Override

public void stop() {

modelService.unloadModel();

isRunning = false;

}

// 其他方法略

}

此外,也可利用 @PostConstruct 配合 @Async 实现异步预热:

@Service

public class InferenceService {

@Autowired

private Model model;

@Async

@PostConstruct

public void warmUp() {

try (NDManager manager = NDManager.newBaseManager()) {

NDArray input = manager.create(new float[]{1.0f});

model.newPredictor().predict(input); // 预热一次

}

}

}

这样可在服务对外提供HTTP接口的同时后台完成模型加载,提高可用性。

表格总结不同初始化策略的特点:

| 策略 | 启动延迟 | 内存占用 | 适用场景 |

|---|---|---|---|

| 同步加载 | 高 | 即时 | 小模型、强一致性要求 |

| 异步加载 | 低 | 延迟 | 大模型、容忍短暂不可用 |

| 懒加载(首次调用) | 最低 | 按需 | 低频使用模型、节省冷启动资源 |

| 定时刷新 | 动态 | 波动 | 需定期更新模型版本 |

综合来看,合理的Bean生命周期管理是保障AI服务稳定性的基石。结合Spring的强大控制力,可灵活应对各种生产环境挑战。

3. 环境配置与模型训练全流程实现

在企业级AI应用开发中,构建一个稳定、高效且可复现的训练流程是实现高质量模型输出的前提。DJL(Deep Java Library)作为专为Java生态设计的深度学习框架,其核心价值不仅体现在API的简洁性和引擎抽象能力上,更在于它能够将复杂的模型训练过程封装成标准化、工程化的流水线。本章聚焦于从零开始搭建完整的模型训练环境,并通过系统性编码实践完成数据准备、模型定义、训练循环到超参数调优的全链路闭环。整个流程强调可维护性、性能可控性以及跨平台兼容性,特别适用于需要与Spring等后端框架集成的企业场景。

通过本章内容,开发者将掌握如何基于DJL构建端到端的训练任务,理解底层资源管理机制,并学会使用高级特性如自定义数据映射器、动态学习率调度和检查点保存策略。更重要的是,我们将深入探讨GPU加速配置细节、Native库依赖处理方式以及多环境适配的最佳实践,确保训练任务既能在本地快速验证,也能无缝迁移到生产级服务器或容器化部署环境中。

3.1 开发与运行环境搭建

要成功运行基于DJL的深度学习项目,首要任务是建立一个具备完整依赖支持的开发与运行环境。不同于Python生态中常见的 pip install torch 即可使用的便捷模式,Java中的深度学习依赖涉及JVM层、操作系统级Native库以及硬件驱动等多个层面,因此环境配置更具挑战性。合理的环境搭建不仅能避免“找不到CUDA”、“无法加载.so库”等常见错误,还能显著提升训练效率并保障系统的稳定性。

3.1.1 JDK版本选择与Native库依赖配置

DJL对JDK版本有明确要求:推荐使用 JDK 11 或更高版本 ,尤其是长期支持(LTS)版本如 JDK 11、JDK 17 和 JDK 21。这些版本提供了更好的模块化支持、垃圾回收优化以及向量计算扩展(Vector API),对于处理大规模张量运算尤为重要。此外,DJL内部大量使用了 var 关键字、 record 类型和 try-with-resources 增强语法,低版本JDK会导致编译失败。

<!-- pom.xml 中指定编译版本 -->

<properties>

<maven.compiler.source>17</maven.compiler.source>

<maven.compiler.target>17</maven.compiler.target>

</properties>

Native库的作用与加载机制

DJL本身是一个纯Java库,但其后端依赖于PyTorch、TensorFlow或MXNet等原生深度学习引擎,这些引擎以C++编写并通过JNI(Java Native Interface)暴露接口。这意味着我们必须确保对应的 .so (Linux)、 .dll (Windows)或 .dylib (macOS)文件存在于系统路径中。

DJL采用自动下载机制来简化这一过程。例如,当引入以下Maven依赖时:

<dependency>

<groupId>ai.djl.pytorch</groupId>

<artifactId>pytorch-engine</artifactId>

<version>0.28.0</version>

</dependency>

<dependency>

<groupId>ai.djl.pytorch</groupId>

<artifactId>pytorch-native-auto</artifactId>

<classifier>linux-x86_64-gpu</classifier>

<version>1.13.1</version>

</dependency>

其中 pytorch-native-auto 的 classifier 指定了平台和设备类型:

- linux-x86_64-gpu :表示 Linux 系统上的 GPU 支持;

- windows-x86_64-cpu :表示 Windows 上仅 CPU 运行;

- auto 后缀意味着 DJL 会在运行时自动检测环境并下载合适的二进制包。

| 平台 | Classifier 示例 | 是否支持GPU |

|---|---|---|

| Linux x86_64 | linux-x86_64-gpu | 是 |

| macOS Apple Silicon | macosx-aarch64 | 否(截至v1.13) |

| Windows x64 | windows-x86_64-cpu | 仅CPU |

| 自动识别 | auto | 根据系统判断 |

⚠️ 注意:若网络受限无法访问 Maven Central 下载大体积 native 包(通常 >1GB),可手动下载

.jar并安装至本地仓库,或使用私有镜像源进行代理。

环境变量与库路径设置

有时即使引入了正确的依赖,仍可能出现 UnsatisfiedLinkError 错误。此时需检查以下环境变量:

export DJL_PYTORCH_CUDA_VERSION=11.8

export PYTORCH_LIBRARY_PATH=/path/to/custom/libtorch

或者通过 JVM 参数强制指定:

java -Dai.djl.pytorch.lib.version=1.13.1 \

-Djava.library.path=/opt/djl/lib \

-jar my-ai-app.jar

该机制允许你在无外网的生产环境中预置 native 库,实现离线部署。

graph TD

A[启动Java应用] --> B{是否已加载Native库?}

B -- 是 --> C[正常初始化引擎]

B -- 否 --> D[尝试从Maven下载对应classifier]

D --> E{下载成功?}

E -- 是 --> F[解压至缓存目录~/.djl.ai/]

E -- 否 --> G[抛出UnsatisfiedLinkError]

F --> H[调用System.load()加载so/dll]

H --> C

图:DJL Native库自动加载流程

此流程体现了DJL“开箱即用”的设计理念,但也提醒我们在CI/CD流水线中应提前缓存 .djl.ai 目录,避免每次构建都重复下载大型二进制文件。

3.1.2 GPU加速支持(CUDA/cuDNN)在Java中的启用方式

充分利用GPU进行训练是提升深度学习效率的关键。DJL通过集成LibTorch(PyTorch的C++前端)实现了对NVIDIA GPU的全面支持,但启用过程涉及多个技术环节,包括驱动版本匹配、CUDA工具包安装及运行时检测逻辑。

CUDA与cuDNN版本兼容性要求

不同版本的PyTorch引擎依赖特定版本的CUDA和cuDNN。以下是常见组合对照表:

| PyTorch Version | CUDA Version | cuDNN Version | DJL Artifact Classifier |

|---|---|---|---|

| 1.13.1 | 11.8 | 8.6 | linux-x86_64-gpu |

| 1.12.1 | 11.6 | 8.5 | linux-x86_64-gpu |

| 1.11.0 | 11.5 | 8.2 | linux-x86_64-gpu |

| 1.9.1 | 11.1 | 8.0 | linux-x86_64-gpu |

必须保证主机已安装匹配的NVIDIA驱动。可通过

nvidia-smi验证:

+-----------------------------------------------------------------------------+

| NVIDIA-SMI 525.60.13 Driver Version: 525.60.13 CUDA Version: 12.0 |

|-------------------------------+----------------------+----------------------+

| GPU Name | Bus-Id | Disp.A | Volatile Uncorr. ECC |

| 0 Tesla T4 | 00000000:00:1E.0 | Off | 0 |

+-------------------------------+----------------------+----------------------+

尽管显示 CUDA 12.0,但只要其向前兼容(Forward Compatibility),仍可运行 CUDA 11.x 编译的应用程序。

在代码中检测GPU可用性

DJL提供了简洁的API用于查询当前设备状态:

import ai.djl.Device;

import ai.djl.engine.Engine;

public class GpuChecker {

public static void main(String[] args) {

Engine engine = Engine.getInstance();

System.out.println("Engine: " + engine.getEngineName());

Device gpu = Device.gpu(); // 获取第一个GPU

if (Device.isGpuAvailable()) {

System.out.println("GPU可用: " + gpu);

try (NDManager manager = NDManager.newBaseManager(gpu)) {

NDArray test = manager.ones(new Shape(2, 3));

System.out.println("在GPU上创建张量: " + test);

}

} else {

System.out.println("未检测到GPU,使用CPU");

}

}

}

代码逐行解析:

Engine.getInstance():获取当前激活的深度学习引擎实例(如PyTorch);Device.gpu():尝试获取第一个GPU设备对象;Device.isGpuAvailable():执行实际探测,返回布尔值;NDManager.newBaseManager(gpu):在指定设备上创建内存管理器;manager.ones(...):在GPU显存中分配并初始化张量。

若输出

"UnsatisfiedLinkError: Cannot find libnvrtc.so",说明缺少CUDA runtime组件,需安装cuda-toolkit-11-8。

强制启用GPU训练的配置建议

某些情况下,即使GPU存在,DJL也可能默认使用CPU。可通过以下方式干预:

// 设置系统属性优先使用GPU

System.setProperty("ai.djl.pytorch.use_gpu", "true");

// 或者在TrainingConfig中显式指定设备

TrainingConfig config = new DefaultTrainingConfig(loss)

.optDevices(Device.gpu()) // 显式绑定所有操作到GPU

.addEvaluator(new Accuracy());

此外,在Docker环境中,需配合 --gpus all 启动容器:

FROM ubuntu:20.04

ENV JAVA_HOME=/usr/lib/jvm/java-17-openjdk-amd64

ENV DJL_CACHE_DIR=/opt/djl/cache

RUN apt-get update && apt-get install -y openjdk-17-jdk wget

COPY target/my-djl-app.jar /app.jar

CMD ["java", "-Dai.djl.pytorch.lib.version=1.13.1", "-jar", "/app.jar"]

启动命令:

docker run --gpus all -v ~/.djl.ai:/root/.djl.ai my-djl-image

这样即可让Java应用在容器内安全访问GPU资源,实现云原生AI训练。

3.2 数据集准备与Dataset API高级用法

高质量的数据是深度学习成功的基石。DJL提供了一套灵活而强大的 Dataset 抽象接口,支持从本地文件、远程URL乃至数据库流式读取样本,并通过 Sampler 和 DataLoader 实现高效的批量加载与并行预处理。相比传统方式手动遍历文件夹,DJL的数据管道设计更贴近现代深度学习工程范式。

3.2.1 自定义RecordMapper实现结构化数据转换

在许多业务场景中,输入数据并非图像或文本,而是表格型结构化数据(如CSV、JSON)。此时需借助 RecordMapper 将原始记录转换为 (input, label) 形式的 Example 对象。

假设我们有一个鸢尾花分类任务,数据格式如下:

sepal_length,sepal_width,petal_length,petal_width,species

5.1,3.5,1.4,0.2,setosa

我们可以定义如下映射器:

import ai.djl.modality.ClassificationUtils;

import ai.djl.translate.TranslateException;

import ai.djl.util.RandomUtils;

public class IrisRecordMapper implements RecordMapper {

private List<IrisSample> samples;

public IrisRecordMapper(Path dataPath) throws IOException {

this.samples = Files.lines(dataPath)

.skip(1) // skip header

.map(line -> {

String[] fields = line.split(",");

float[] features = Arrays.stream(Arrays.copyOfRange(fields, 0, 4))

.mapToFloat(Float::parseFloat).toArray();

String label = fields[4];

return new IrisSample(features, label);

})

.collect(Collectors.toList());

}

@Override

public Example map(Iterator<Writable> iter) throws IOException, TranslateException {

Writable item = iter.next();

IrisSample sample = samples.get(Integer.parseInt(item.toString()));

NDManager manager = NDManager.newBaseManager();

NDArray input = manager.create(sample.features); // shape: (4)

NDArray label = ClassificationUtils.toZeroBasedLabel(manager, sample.getLabel(),

Arrays.asList("setosa", "versicolor", "virginica"));

return Example.of(input, label);

}

}

参数说明:

samples: 存储所有解析后的样本对象;IrisSample: 用户自定义POJO类,包含特征数组与标签字符串;ClassificationUtils.toZeroBasedLabel: 将类别字符串转为索引(0,1,2);Example.of(input, label): 构造标准训练样本单元。

该设计实现了数据与模型之间的解耦,便于后续更换数据源而不影响训练逻辑。

3.2.2 图像/文本数据的Pipeline构建技巧

对于非结构化数据,DJL提供了丰富的内置变换函数。以图像分类为例,典型的预处理流水线包括:

Transform transform = new Pipeline()

.add(new Resize(224, 224))

.add(new ToTensor())

.add(new Normalize(

new float[]{0.485f, 0.456f, 0.406f}, // ImageNet mean

new float[]{0.229f, 0.224f, 0.225f})); // ImageNet std

该流水线按顺序执行:

1. Resize : 统一分辨率为224×224;

2. ToTensor : 转换HWC→CHW并归一化到[0,1];

3. Normalize : 减均值除标准差,适配预训练模型输入分布。

flowchart LR

RawImage --> Resize --> ToTensor --> Normalize --> ModelInput

图:图像预处理Pipeline流程

对于文本任务,可结合BERT tokenizer 构建动态编码器:

private NDList bertTokenizer(NDManager manager, String text) {

BertTokenizer tokenizer = BertTokenizer.newInstance("bert-base-uncased");

TokenIds tokenIds = tokenizer.encode(text);

long[] inputIds = tokenIds.getIds();

long[] attentionMask = tokenIds.getAttentionMask();

NDArray ids = manager.create(inputIds);

NDArray mask = manager.create(attentionMask);

return new NDList(ids, mask);

}

此方法返回可用于BERT模型的双输入结构。

3.2.3 数据增强策略在Java中的编程实现

为防止过拟合,应在训练阶段引入数据增强。DJL支持多种在线增强方式:

new RandomResizedCrop(224)

.optScale(0.8f, 1.0f)

.optRatio(0.75f, 1.33f),

new RandomFlipTopBottom(0.5f),

new ColorJitter(0.2f, 0.2f, 0.2f, 0.1f)

上述配置将在每个epoch中随机裁剪、翻转和调整色彩,有效增加样本多样性。

| 增强方法 | 功能描述 | 推荐使用场景 |

|---|---|---|

| RandomResizedCrop | 随机缩放裁剪 | 图像分类 |

| RandomFlipLeftRight | 水平翻转 | 自然图像 |

| ColorJitter | 颜色抖动 | 跨域泛化 |

| RandomRotation | 随机旋转 | 医疗影像 |

通过组合这些变换,可在不增加存储成本的前提下大幅提升模型鲁棒性。

3.3 模型构建与训练流程编码

模型定义与训练是深度学习的核心环节。DJL通过 Block 接口实现了高度模块化的网络构造方式,允许用户以函数式风格堆叠层结构,并结合 Trainer 控制完整的训练生命周期。

3.3.1 使用Block接口定义CNN/RNN/Transformer网络结构

以LeNet-5为例,展示如何用DJL构建经典卷积神经网络:

public class LeNet5 implements Block {

private static final long serialVersionUID = 1L;

private Conv2d conv1, conv2;

private Dense dense1, dense2, dense3;

private SequentialBlock backbone;

public LeNet5() {

backbone = new SequentialBlock();

conv1 = Conv2d.builder().setKernelShape(new Shape(5, 5)).optStride(new Shape(1, 1))

.setFilters(6).build();

conv2 = Conv2d.builder().setKernelShape(new Shape(5, 5)).optStride(new Shape(1, 1))

.setFilters(16).build();

dense1 = Dense.builder().setUnits(120).build();

dense2 = Dense.builder().setUnits(84).build();

dense3 = Dense.builder().setUnits(10).build();

backbone.add(conv1).add(new Activation(Activation.Type.TANH))

.add(new MaxPool2d(new Shape(2, 2), new Shape(2, 2)))

.add(conv2).add(new Activation(Activation.Type.TANH))

.add(new MaxPool2d(new Shape(2, 2), new Shape(2, 2)))

.add(new Flatten())

.add(dense1).add(new Activation(Activation.Type.TANH))

.add(dense2).add(new Activation(Activation.Type.TANH))

.add(dense3);

}

@Override

public NDList forward(NDManager manager, NDList inputs, boolean training) {

return backbone.forward(manager, inputs, training);

}

@Override

public Shape[] getOutputShapes(Shape[] inputShapes) {

return backbone.getOutputShapes(inputShapes);

}

@Override

public void initialize(NDManager manager, DataType dataType, Shape... inputShapes) {

backbone.initialize(manager, dataType, inputShapes);

}

}

该实现展示了DJL中典型的组件化建模思想:通过 SequentialBlock 串联各层,并在 forward 方法中统一调度前向传播。

3.3.2 Trainer配置:损失函数、优化器、学习率调度器设定

训练配置通过 TrainingConfig 完成:

Loss loss = Loss.softmaxCrossEntropyLoss();

Optimizer optim = Optimizer.adam().optLearningRate(0.001f).build();

LearningRateTracker lrTracker = LearningRateTracker.fixed(0.001f);

TrainingConfig config = new DefaultTraining7Config(loss)

.optOptimizer(optim)

.optDevices(Device.gpu())

.addEvaluator(new Accuracy())

.optInitializer(new XavierInitializer(), ParameterType.WEIGHT)

.optProgress(new ProgressBar());

关键组件说明:

| 组件 | 作用 |

|---|---|

Loss |

定义目标函数(如交叉熵) |

Optimizer |

指定更新算法(Adam/SGD) |

Evaluator |

训练中实时评估指标 |

Initializer |

权重初始化策略 |

ProgressBar |

可视化训练进度 |

3.3.3 训练循环中的梯度更新与检查点保存逻辑

完整训练循环示例:

try (Model model = Model.newInstance("lenet5");

Trainer trainer = model.newTrainer(config)) {

model.setBlock(new LeNet5());

trainer.initialize(new Shape(1, 1, 28, 28));

for (int epoch = 0; epoch < 10; ++epoch) {

for (Batch batch : trainer.getDataLoader(trainDataset)) {

try (GradientCollector gc = trainer.newGradientCollector()) {

NDList predictions = trainer.forward(batch.getData());

NDArray lossValue = trainer.getLoss().apply(batch.getLabels(), predictions);

gc.backward(lossValue);

}

trainer.step();

batch.close();

}

trainer.notifyOnEpochEnd(epoch);

}

}

此循环涵盖前向传播、反向传播、梯度更新与周期回调,构成标准监督学习骨架。

3.4 超参数调优与实验管理

3.4.1 参数空间设计与网格搜索实现

支持自动化调参是提升模型性能的重要手段。可通过嵌套循环遍历学习率、批量大小等参数组合,记录最优结果。

3.4.2 利用TrainingConfig实现可复现训练过程

通过固定随机种子、日志记录和模型快照,确保每次实验均可追溯和对比分析。

4. 模型评估、持久化与高效推理机制

在深度学习系统从实验环境迈向生产部署的关键阶段,模型的评估、持久化和推理效率成为决定其能否稳定服务于真实业务场景的核心要素。Amazon开源的Deep Java Library(DJL)不仅为Java开发者提供了统一的深度学习接口,更在模型生命周期管理方面构建了一套完整的工具链。本章节将深入探讨如何基于DJL实现科学的模型性能评估体系,确保训练成果可量化、可对比;如何通过标准化的序列化机制保障模型在不同环境间的无缝迁移;并重点剖析推理会话(InferenceSession)层面的优化策略,以应对高并发、低延迟的线上服务需求。

随着企业级AI应用对稳定性、可观测性和资源利用率的要求日益提升,仅完成模型训练已远远不够。一个成熟的AI服务必须具备精确的评估能力来验证泛化表现,拥有可靠的存储机制支持版本迭代,同时在运行时展现出高效的推理吞吐与内存控制。DJL凭借其模块化设计,在 ai.djl.inference.Predictor 、 ai.djl.Model 、 ai.djl.translate.Translator 等核心组件中内置了丰富的扩展点,使得开发者可以在不牺牲可维护性的前提下进行深度定制。接下来的内容将从评估指标计算、模型保存加载规范、推理预热批处理机制到性能瓶颈分析,层层递进地揭示DJL在生产级AI系统中的关键实践路径。

4.1 模型性能评估体系构建

构建科学且可复用的模型评估体系是确保机器学习项目可持续演进的基础。在实际应用中,仅仅依赖准确率(Accuracy)往往无法全面反映模型的真实表现,特别是在类别不平衡或业务关注特定误判成本的场景下。DJL提供了一套灵活的评估框架,允许开发者结合Java原生数据结构与统计方法,实现包括精确率(Precision)、召回率(Recall)、F1分数以及混淆矩阵在内的多维度指标计算。更重要的是,该评估过程可以无缝集成至Spring Boot服务的测试流程或CI/CD管道中,形成闭环的质量保障机制。

4.1.1 准确率、精确率、召回率与F1分数的Java实现

在分类任务中,尤其是二分类或多分类问题中,单一的准确率指标容易掩盖模型在少数类上的缺陷。例如,在欺诈检测系统中,正常交易占比99%,即使模型将所有样本预测为“正常”,也能获得接近99%的准确率,但完全丧失了识别异常的能力。因此,引入更细粒度的评估指标至关重要。

DJL本身并不强制绑定特定的评估逻辑,而是鼓励用户根据 Predictor 输出结果自行组织评估流程。以下是一个基于真实标签与预测结果计算四大核心指标的完整Java实现:

import ai.djl.modality.Classifications;

import java.util.*;

public class ModelEvaluator {

public static Map<String, Double> evaluateClassification(

List<Integer> trueLabels,

List<Classifications> predictions) {

int classes = Collections.max(trueLabels) + 1;

int[][] confusionMatrix = new int[classes][classes];

// 构建混淆矩阵

for (int i = 0; i < trueLabels.size(); i++) {

int trueLabel = trueLabels.get(i);

int predLabel = predictions.get(i).bestClass().getProbability() > 0.5 ?

Integer.parseInt(predictions.get(i).bestClass()..getClassName()) : -1;

if (predLabel >= 0 && predLabel < classes) {

confusionMatrix[trueLabel][predLabel]++;

}

}

Map<String, Double> metrics = new HashMap<>();

double[] precision = new double[classes];

double[] recall = new double[classes];

double[] f1 = new double[classes];

int totalCorrect = 0;

int totalCount = trueLabels.size();

for (int i = 0; i < classes; i++) {

int tp = confusionMatrix[i][i];

int fp = 0;

int fn = 0;

for (int j = 0; j < classes; j++) {

if (i != j) {

fp += confusionMatrix[j][i]; // 被错误预测为i

fn += confusionMatrix[i][j]; // 实际为i却被预测为其他

}

}

precision[i] = tp + fp == 0 ? 0 : (double) tp / (tp + fp);

recall[i] = tp + fn == 0 ? 0 : (double) tp / (tp + fn);

f1[i] = precision[i] + recall[i] == 0 ? 0 :

2 * precision[i] * recall[i] / (precision[i] + recall[i]);

totalCorrect += tp;

}

metrics.put("accuracy", (double) totalCorrect / totalCount);

metrics.put("macro_precision", Arrays.stream(precision).average().orElse(0));

metrics.put("macro_recall", Arrays.stream(recall).average().orElse(0));

metrics.put("macro_f1", Arrays.stream(f1).average().orElse(0));

return metrics;

}

}

代码逻辑逐行解读与参数说明

- 第3–6行 :导入必要的类,其中

Classifications是DJL中表示分类结果的标准容器,包含多个PredictedClass对象。 - 第8–10行 :定义静态方法

evaluateClassification,接收两个参数:trueLabels为真实标签列表(整数形式),predictions为模型输出的分类结果集合。 - 第13–14行 :推断类别总数,并初始化混淆矩阵

confusionMatrix用于记录每个类别的预测分布。 - 第17–23行 :遍历每条样本,提取真实标签和最高概率的预测标签。注意这里加入了阈值判断(>0.5),防止低置信度预测干扰评估。

- 第26–39行 :针对每一类别计算TP(真正例)、FP(假正例)、FN(假反例),进而得出该类别的Precision、Recall和F1。

- 第41–43行 :计算整体准确率,并使用宏平均(macro-average)方式汇总各类别指标,避免类别不平衡带来的偏差。

- 返回值 :一个包含Accuracy、Macro-Precision、Macro-Recall和Macro-F1的Map,便于后续日志记录或可视化展示。

该实现适用于图像分类、文本分类等多种任务,且可轻松嵌入单元测试或批处理评估脚本中。通过将评估逻辑封装成独立组件,团队可在不同模型间进行横向比较,建立标准化的性能基线。

4.1.2 混淆矩阵可视化与分类报告生成

除了数值型指标外,直观的可视化手段对于调试模型尤为重要。混淆矩阵不仅能揭示哪些类别之间存在混淆现象,还能帮助识别数据标注质量问题或特征表达不足的情况。虽然DJL本身未提供图形绘制功能,但可通过集成如JFreeChart或通过后端API返回JSON供前端渲染的方式实现。

以下使用Mermaid语法生成一个典型的混淆矩阵流程图,模拟评估过程中数据流动与决策节点:

graph TD

A[原始测试集] --> B{加载模型并推理}

B --> C[获取预测结果 Classifications]

C --> D[构建混淆矩阵 int[ ][ ]]

D --> E[计算 Precision/Recall/F1]

E --> F[生成分类报告]

F --> G[输出JSON或CSV]

G --> H[前端图表渲染]

H --> I((可视化仪表盘))

此外,可进一步扩展 ModelEvaluator 类以生成类似scikit-learn风格的分类报告:

| 类别 | 支持数 | 精确率 | 召回率 | F1分数 |

|---|---|---|---|---|

| 0 | 120 | 0.92 | 0.88 | 0.90 |

| 1 | 85 | 0.85 | 0.91 | 0.88 |

| 2 | 95 | 0.89 | 0.86 | 0.87 |

| 加权平均 | 300 | 0.89 | 0.88 | 0.88 |

此表格可通过Java中的 StringBuilder 动态拼接,或利用Apache Commons CSV导出为文件。结合Micrometer或Prometheus客户端,还可将关键指标暴露为HTTP端点,供监控系统采集。

4.2 模型序列化与跨环境迁移

模型训练完成后,必须将其持久化以便在推理服务或其他环境中加载使用。DJL通过 Model.save() 和 Model.load() 方法实现了跨引擎、跨平台的模型序列化机制,极大简化了模型交付流程。然而,若缺乏规范的操作流程与元信息管理,极易导致版本混乱、兼容性断裂等问题。

4.2.1 Model.save()与Model.load()的使用规范

DJL的模型保存机制支持多种格式,具体取决于底层引擎(PyTorch、TensorFlow等)。以下是一个标准的模型保存与加载示例:

import ai.djl.Model;

import ai.djl.training.Trainer;

import java.nio.file.Paths;

// 保存模型

try (Model model = Model.newInstance("my-classifier")) {

model.setProperty("engine", "PyTorch");

model.setProperty("version", "1.0.3");

model.setProperty("description", "Image classifier for CIFAR-10");

// 假设已训练完毕,trainer已完成fit

try (Trainer trainer = model.newTrainer(config)) {

// ... 训练逻辑 ...

trainer.save(Paths.get("/models/cifar10-v1"), "epoch-100");

}

}

// 加载模型

try (Model model = Model.load(Paths.get("/models/cifar10-v1"), "epoch-100")) {

String engine = model.getProperty("engine"); // 获取引擎类型

System.out.println("Loaded model using: " + engine);

Translator<Image, Classifications> translator = ImageClassificationTranslator.builder().build();

Predictor<Image, Classifications> predictor = model.newPredictor(translator);

}

参数说明与执行逻辑分析

Model.newInstance("name"):创建具名模型实例,名称可用于日志追踪。setProperty(key, value):添加自定义元数据,建议包含引擎、版本、描述、训练时间等字段。trainer.save(path, prefix):将模型权重与配置保存至指定目录,文件名为prefix.params(参数)和prefix.model(结构)。Model.load(path, prefix):按路径与前缀恢复模型,自动识别引擎类型并初始化上下文。- 所有资源均通过try-with-resources管理,确保NDArray、NDManager等本地内存正确释放。

最佳实践中,应统一模型存储目录结构如下:

/models/

└── project-name/

├── v1.0.0/

│ ├── epoch-50.params

│ ├── epoch-50.model

│ └── metadata.json

└── latest -> v1.0.0 # 符号链接指向当前生效版本

并通过CI脚本自动注入Git Commit ID、构建时间等信息,提升可追溯性。

4.2.2 模型元信息存储与版本控制策略

为了实现模型的全生命周期管理,应在保存时额外写入元信息文件(如JSON),内容示例如下:

{

"model_name": "cifar10-resnet18",

"version": "1.0.3",

"engine": "PyTorch",

"input_shape": [3, 32, 32],

"output_classes": ["airplane", "automobile", ..., "truck"],

"training_dataset": "CIFAR-10-train-v2",

"trained_at": "2025-04-05T10:23:00Z",

"metrics": {

"accuracy": 0.912,

"f1_macro": 0.908

},

"author": "data-science-team"

}

此文件可由训练脚本自动生成,并上传至MinIO或S3等对象存储系统,配合MLflow或Weights & Biases等工具形成完整的MLOps闭环。

4.3 推理会话(InferenceSession)优化实践

在高并发服务场景中,推理延迟与吞吐量直接关系到用户体验与服务器成本。DJL通过 Predictor 抽象封装了推理会话的生命周期,但在默认配置下可能存在冷启动延迟、内存频繁分配等问题。需通过预热、批处理和资源复用等手段进行深度优化。

4.3.1 预热机制与批处理推理提升吞吐量

首次调用 predict() 时,DJL需初始化引擎上下文、加载CUDA内核、分配显存等,造成显著延迟(可达数百毫秒)。为此,应在服务启动后主动触发预热请求:

public void warmUpPredictor(Predictor<Image, Classifications> predictor, Image sample) {

for (int i = 0; i < 5; i++) {

predictor.predict(sample); // 触发JIT编译与内存池初始化

}

}

同时,启用批处理模式可大幅提升GPU利用率:

List<Image> batch = Arrays.asList(img1, img2, img3, img4);

List<Classifications> results = predictor.batchPredict(batch);

批处理通过合并多个输入张量为一个batch dimension,减少内核调用次数,典型情况下可使吞吐量提升3–5倍。

4.3.2 内存复用与NDManager资源管理最佳实践

DJL使用 NDManager 管理张量生命周期,不当使用会导致内存泄漏或性能下降。应始终遵循以下原则:

- 使用

NDManager.scope()自动回收临时张量; - 对固定尺寸输入复用

NDArray缓冲区; - 避免在循环中创建新manager。

try (NDManager manager = NDManager.newBaseManager()) {

NDArray reusableBuffer = manager.zeros(new Shape(1, 3, 224, 224));

for (Image image : stream) {

NDArray input = preprocess(image, reusableBuffer); // 复用buffer

try (NDArray output = model.forward(input)) {

// 处理输出

} // output自动释放

}

} // 所有相关NDArray被销毁

上述策略可有效降低GC压力,特别适合长时间运行的微服务。

4.4 性能监控与瓶颈定位

最后,要实现真正的生产级稳定性,必须建立完善的性能监控体系。DJL支持与Java生态主流工具集成,实现对推理延迟、内存占用和计算热点的精细化观测。

4.4.1 推理延迟统计与GC影响分析

通过Micrometer暴露直方图指标:

Timer inferenceTimer = Timer.builder("djl.inference.latency")

.register(meterRegistry);

inferenceTimer.record(Duration.ofNanos(startTime, System.nanoTime()));

结合VisualVM或Async-Profiler分析GC日志,发现Direct Memory过度申请问题时,可通过设置JVM参数限制:

-Xmx4g -XX:MaxDirectMemorySize=2g -Dorg.bytedeco.javacpp.maxbytes=1G

4.4.2 使用Profiler工具检测计算热点

DJL兼容Java Flight Recorder(JFR)与Async-Profiler,可捕获native层调用栈:

async-profiler/profiler.sh -e cpu -d 30 -f flame.html <pid>

生成的火焰图能清晰显示PyTorch算子耗时占比,指导模型剪枝或算子替换决策。

综上所述,本章系统阐述了DJL在模型评估、持久化与推理优化方面的关键技术路径,为构建高性能、高可用的Java AI服务奠定了坚实基础。

5. RESTful API封装与生产环境部署优化

5.1 微服务化AI能力输出

在企业级应用中,将训练完成的深度学习模型以服务形式对外暴露是实现AI能力复用的关键。通过构建基于Spring Boot的RESTful API接口,可以无缝集成到现有的微服务体系中,支持前端、移动端或其他后端服务调用。

5.1.1 设计标准化JSON请求/响应格式

为保证接口通用性和可维护性,需定义统一的数据交互结构。以下是一个推荐的JSON通信协议模板:

// 请求示例(图像分类)

{

"request_id": "req-20241005-001",

"timestamp": "2024-10-05T12:00:00Z",

"data": {

"image_base64": "/9j/4AAQSkZJR..."

},

"options": {

"top_k": 3,

"threshold": 0.5

}

}

// 响应示例

{

"status": "success",

"result": [

{ "label": "cat", "probability": 0.87 },

{ "label": "dog", "probability": 0.11 }

],

"inference_time_ms": 45,

"model_version": "resnet50-v2"

}

该设计具备扩展性, options 字段可用于传递推理参数,如置信度阈值、返回类别数等; request_id 便于链路追踪。

5.1.2 文件上传接口与Base64编码处理

对于图像或音频类模型,常采用Base64编码嵌入JSON中传输。在Spring MVC中可通过如下控制器处理:

@RestController

@RequestMapping("/api/v1/classify")

public class ImageClassificationController {

@Autowired

private ModelService modelService;

@PostMapping(consumes = "application/json")

public ResponseEntity<InferenceResponse> classify(@RequestBody InferenceRequest request) {

try {

byte[] imageBytes = Base64.getDecoder().decode(request.getData().getImageBase64());

NDArray input = ImageUtils.toNDArray(imageBytes); // 转换为DJL输入张量

List<PredictedResult> results = modelService.predict(input, request.getOptions());

InferenceResponse response = new InferenceResponse("success", results);

return ResponseEntity.ok(response);

} catch (IllegalArgumentException e) {

return ResponseEntity.badRequest().body(new InferenceResponse("invalid_base64"));

} catch (Exception e) {

return ResponseEntity.status(500).body(new InferenceResponse("internal_error"));

}

}

}

参数说明:

- InferenceRequest : 封装客户端输入,含Base64数据与配置项。

- ImageUtils.toNDArray() : 使用DJL内置 ImageFactory 解析并归一化图像。

- 异常分层捕获,区分客户端错误与服务端故障。

使用Base64虽简化传输,但增加约33%体积开销。高吞吐场景建议提供 multipart/form-data 上传路径作为替代方案。

5.2 高可用架构下的部署策略

5.2.1 Docker镜像构建与轻量化裁剪

为提升部署效率,需对DJL应用进行容器化打包。以下是优化后的Dockerfile示例:

# 使用GraalVM Native Image基础镜像(可选)

FROM amazoncorretto:17-alpine AS builder

WORKDIR /app

COPY .mvn .mvn

COPY mvnw pom.xml ./

RUN ./mvnw dependency:go-offline

COPY src src

RUN ./mvnw clean package -DskipTests

# 多阶段构建:运行时仅保留必要组件

FROM amazoncorretto:17-jre-alpine

RUN apk add --no-cache libc6-compat

WORKDIR /app

COPY --from=builder /app/target/djl-app.jar app.jar

# 只加载指定引擎(如PyTorch),避免全量依赖

ENV DJL_ENGINE_PRIORITY="PyTorch,TensorFlow"

ENV PYTORCH_MEMORY_POOL=1G

EXPOSE 8080

ENTRYPOINT ["java", "-XX:+UseContainerSupport", "-Xmx2g", "-jar", "app.jar"]

关键优化点:

- 多阶段构建减少镜像大小(典型大小从~1.2GB降至~450MB)。

- 显式设置 DJL_ENGINE_PRIORITY 避免自动探测所有引擎。

- 启用容器感知GC和内存限制。

5.2.2 Kubernetes中Pod资源限制与HPA弹性伸缩

在Kubernetes中部署时,应合理配置资源约束与自动扩缩容策略:

apiVersion: apps/v1

kind: Deployment

metadata:

name: djl-model-service

spec:

replicas: 2

selector:

matchLabels:

app: djl-service

template:

metadata:

labels:

app: djl-service

spec:

containers:

- name: predictor

image: registry.example.com/djl-app:latest

ports:

- containerPort: 8080

resources:

requests:

memory: "2Gi"

cpu: "500m"

limits:

memory: "4Gi" # 防止OOM

cpu: "2000m"

env:

- name: JAVA_OPTS

value: "-Dai.djl.pytorch.gpu.enabled=true"

apiVersion: autoscaling/v2

kind: HorizontalPodAutoscaler

metadata:

name: djl-hpa

spec:

scaleTargetRef:

apiVersion: apps/v1

kind: Deployment

name: djl-model-service

minReplicas: 2

maxReplicas: 10

metrics:

- type: Resource

resource:

name: cpu

target:

type: Utilization

averageUtilization: 70

此配置确保服务在负载上升时自动扩容,并结合CPU利用率维持SLA。

5.3 生产级问题排查方法论

5.3.1 日志分级采集与关键事件追踪

在Spring Boot中整合 Logback 实现精细化日志管理:

<configuration>

<appender name="FILE" class="ch.qos.logback.core.rolling.RollingFileAppender">

<file>logs/app.log</file>

<rollingPolicy class="ch.qos.logback.core.rolling.TimeBasedRollingPolicy">

<fileNamePattern>logs/app.%d{yyyy-MM-dd}.log</fileNamePattern>

<maxHistory>7</maxHistory>

</rollingPolicy>

<encoder>

<pattern>%d{ISO8601} [%thread] %-5level %logger{36} - %msg%n</pattern>

</encoder>

</appender>

<!-- 关键模块单独记录 -->

<logger name="ai.djl.inference" level="DEBUG" additivity="false">

<appender-ref ref="INFERENCE_LOG"/>

</logger>

<root level="INFO">

<appender-ref ref="FILE"/>

</root>

</configuration>

结合 MDC (Mapped Diagnostic Context)注入 request_id ,实现全链路日志追踪。

5.3.2 OOM异常诊断与Direct Memory使用监控

DJL大量使用堆外内存(Off-Heap),易引发 OutOfMemoryError: Direct buffer memory 。可通过以下方式监控:

- JVM启动参数添加:

-XX:MaxDirectMemorySize=2g -Dio.netty.maxDirectMemory=0

- 定期采样Netty池状态(DJL底层依赖Netty):

PlatformDependent.usedDirectMemory(); // 返回已用Direct内存字节数

PlatformDependent.maxDirectMemory();

- Prometheus暴露指标:

Gauge.builder("jvm.direct.memory.used", PlatformDependent::usedDirectMemory)

.register(meterRegistry);

当发现Direct Memory持续增长且未释放,需检查 NDManager 是否正确关闭。

5.4 性能优化终极方案

5.4.1 模型量化压缩与推理引擎选择权衡

为降低延迟与资源消耗,可在模型导出阶段执行量化:

| 量化类型 | 精度 | 推理速度提升 | 内存节省 | 适用场景 |

|---|---|---|---|---|

| FP32 | 高 | 基准 | 基准 | 开发调试 |

| FP16 | 中 | ~1.8x | ~50% | GPU推理 |

| INT8 | 较低 | ~3x | ~75% | 边缘设备 |

| PTQ(Post-Training Quantization) | 可接受 | 显著 | 显著 | 多数生产环境 |

DJL支持PyTorch的FX量化工具链导入INT8模型,亦可通过ONNX Runtime运行量化后的ONNX模型。

示例代码判断最优引擎:

Model model = Model.newInstance("classification");

try (ZooModel<Image, Classifications> zooModel =

ModelZoo.loadModel(criteria)) {

// 自动选择支持量化加速的最佳引擎

if (Engine.getEngine("OnnxRuntime").isGpuEnabled()) {

System.setProperty("ai.djl.default_engine", "OnnxRuntime");

}

}

5.4.2 缓存机制引入与高频请求降级处理

对重复性高、结果稳定的推理请求(如热门图片识别),可引入两级缓存:

@Cacheable(value = "inferenceCache", key = "#request.imageHash", condition = "#request.cacheable")

public InferenceResponse predict(InferenceRequest request) {

// 实际调用DJL推理逻辑

}

配合Caffeine本地缓存 + Redis分布式缓存,TTL设为5分钟。

同时,在系统压力过大时启用降级策略:

- 当CPU > 90%持续30秒,返回预设默认结果;

- 使用Hystrix或Resilience4j实现熔断控制。

graph TD

A[收到推理请求] --> B{缓存命中?}

B -->|是| C[返回缓存结果]

B -->|否| D{系统负载正常?}

D -->|是| E[执行真实推理]

D -->|否| F[返回默认响应/排队]

E --> G[写入缓存]

G --> H[返回结果]

简介:Fast Deep Java Library(DJL)是一个专为Java及JVM平台设计的高效开源深度学习库,支持无缝集成Spring等主流企业级框架,简化了在Java环境中进行深度学习开发的复杂性。本资源包涵盖DJL核心组件、模型构建、训练、评估、保存加载与推理全流程,并提供与Spring Boot/Spring Cloud集成方案,助力开发者快速实现图像识别、自然语言处理等智能服务。内容适合初学者和进阶开发者,通过实战示例掌握DJL在企业应用中的落地实践。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)