【跟我学YOLO】YOLO13(3)训练自己的数据集

YOLOv13 将超图计算与端到端信息协作无缝结合,提供更准确、更强大、更高效的实时检测解决方案。本节介绍使用用户自己的数据集训练 YOLO13 模型,建立特定任务的私有模型。创建自定义模型来检测对象,包括图像的采集和标注、训练模型、模型部署,以及使用部署的模型进行推理。

欢迎关注『跟我学 YOLO』系列

【跟我学YOLO】YOLOv13(1)基于超图增强的自适应视觉感知的实时物体检测

【跟我学YOLO】YOLOv13(2)模型下载、环境配置与检测

【跟我学YOLO】YOLOv13(3)训练自己的数据集

【跟我学YOLO】(3)YOLO13 训练自己的数据集

YOLOv13(You Only Look Once v13)是 2025 年 6 月最新发布的目标检测模型,是当前最先进的端到端实时目标检测器,以更低的计算复杂度实现了最先进的检测性能,能够实时检测图像中的目标对象并生成精确的边界框。

YOLOv13 的核心创新在于:

- 基于超图的自适应相关增强 (HyperACE),用于探索全局高阶相关性。

- 全流程聚合与分发范式 (FullPAD),用于促进全网络信息流。

- 基于深度可分离卷积的轻量化模块 (DSConv, DS-Bottleneck, DS-C3k, DS-C3k2)。

YOLOv13 将超图计算与端到端信息协作无缝结合,提供更准确、更强大、更高效的实时检测解决方案。

YOLOv13 的论文YOLOv13: Real-Time Object Detection with Hypergraph-Enhanced Adaptive Visual Perception及解读,详见 【跟我学YOLO】YOLOv13(1)基于超图增强的自适应视觉感知的实时物体检测。

上节介绍了 YOLO13 的下载、配置和推理,本节介绍使用用户自己的数据集训练 YOLO13 模型,建立特定任务的私有模型。创建自定义模型来检测对象,包括图像的采集和标注、训练模型、模型部署,以及使用部署的模型进行推理。

YOLO13 下载:Github-YOLOv13

1. 创建和配置 YOLO13 使用环境

说明:

- 本文所有内容都是基于 python 环境实现的,因此先要确保已经安装了 python 开发环境。

- YOLO13 的环境依赖与 YOLO12 完全相同。如果已经创建和配置好了 YOLO12 环境,可以直接使用 YOLO12 的环境,或克隆 YOLO12 环境。

YOLO13 环境创建和配置,本文只做简要介绍,详见 【跟我学YOLO】(2)YOLO13(2)模型下载、环境配置与检测。

- 创建名称为 YOLO13 的 Python 环境,注意推荐Python 版本为3.11。激活 YOLO13 环境。

# wget https://github.com/Dao-AILab/flash-attention/releases/download/v2.7.3/flash_attn-2.7.3+cu11torch2.2cxx11abiFALSE-cp311-cp311-linux_x86_64.whl

conda env list

conda create -n YOLO13 python=3.11

conda activate YOLO13

- 在所选择的 Python 环境下,安装 YOLO13 项目所需的依赖(安装项目所需的库)。

>cd C:\Python\Projects\YOLOv13 # YOLOv13 项目根目录

>conda activate YOLO13

>pip install -r requirements.txt

- 下载 FlashAttention

对于 Windows 系统,推荐从 Github 下载 FlashAttention:

FlashAttention Windows:https://github.com/bdashore3/flash-attention/releases

下载完成之后需要本地安装。将下载的 FlashAttention 的 .whl 文件,复制到 YOLOv13 项目的根目录下,pip 安装如下。

cd C:\Python\Projects\YOLOv13 # YOLOv13 项目根目录

conda activate YOLO13

pip install flash_attn-2.7.0.post2+cu124torch2.3.1cxx11abiFALSE-cp311-cp311-win_amd64.whl

-

安装 CUDA 和 PyTorch。

-

安装 YOLO13。

2. 准备 YOLO13 训练数据集

YOLO13 项目中提供了不同数据集转换的指南和例程,位于 “.\docs\en\datasets” 路径,例如在文件 coco.md 中介绍了使用 COCO 数据集来训练 YOLOv13 目标检测模型。YOLO13 项目没有提供数据集转换的指南和例程,但方法与 YOLO11 是一致的,可以参考使用。

2.1 YOLOv13 数据集的格式

1、数据集的组织

YOLOv13 数据集通常包含图像文件和标注文件。图像文件通常是 jpg、png 等图像格式,包含了待检测的目标。标注文件则是包含每张图像中目标对象的类别和位置信息的文本文件。

YOLOv13 默认使用 COCO2017 数据集进行训练,结构如下。

- images 目录包含 train、valid 文件夹,这两个文件夹下包含模型训练所需要的图片文件;

- labels 目录包含 train、valid 文件夹,这两个文件夹下包含模型训练图片所对应的标注文件;

- images 目录可以包含 test 文件夹,其中包含测试所用的图片文件。

dataset/

├── images/

│ ├── train/

│ └── val/

│ └── test/ # (option)

└── labels/

├── train/

└── val/

2、标注文件的格式

YOLO格式的标注文件通常是一个文本文件,每一行代表一个目标物体的标注信息。

标注信息通常包含类别编号、目标中心横坐标(相对于图像宽度)、目标中心纵坐标(相对于图像高度)、目标宽度(相对于图像宽度)和目标高度(相对于图像高度),具体格式如下:

<object-class-id> <x> <y> <width> <height>

其中:

<object-class-id>是目标对象的类别编号,整数表示。

<x>和<y>是目标中心位置的坐标,经过归一化处理(即目标的真实x、y值除以图像的宽度和高度),是小于1的浮点数。

<width>和<height>是目标的宽度和高度(同样经过归一化处理),也是小于1的浮点数。

例如,某一行的标注信息为 “2 0.3 0.6 0.25 0.40”,其中“2”表示类别编号,后面的 4个数字表示目标在图像中的位置 <x> <y> 和宽高 <width> <height>。

3、XML 标注文件的格式转换

对于 Pascal VOC数据集,常用XML格式的标注文件,需要将文件夹下的所有类别的 xml 格式的标注转换成为yolo格式。转换后的标签要保存在 labels文件夹文件夹下。

2.2 下载 YOLO 数据集

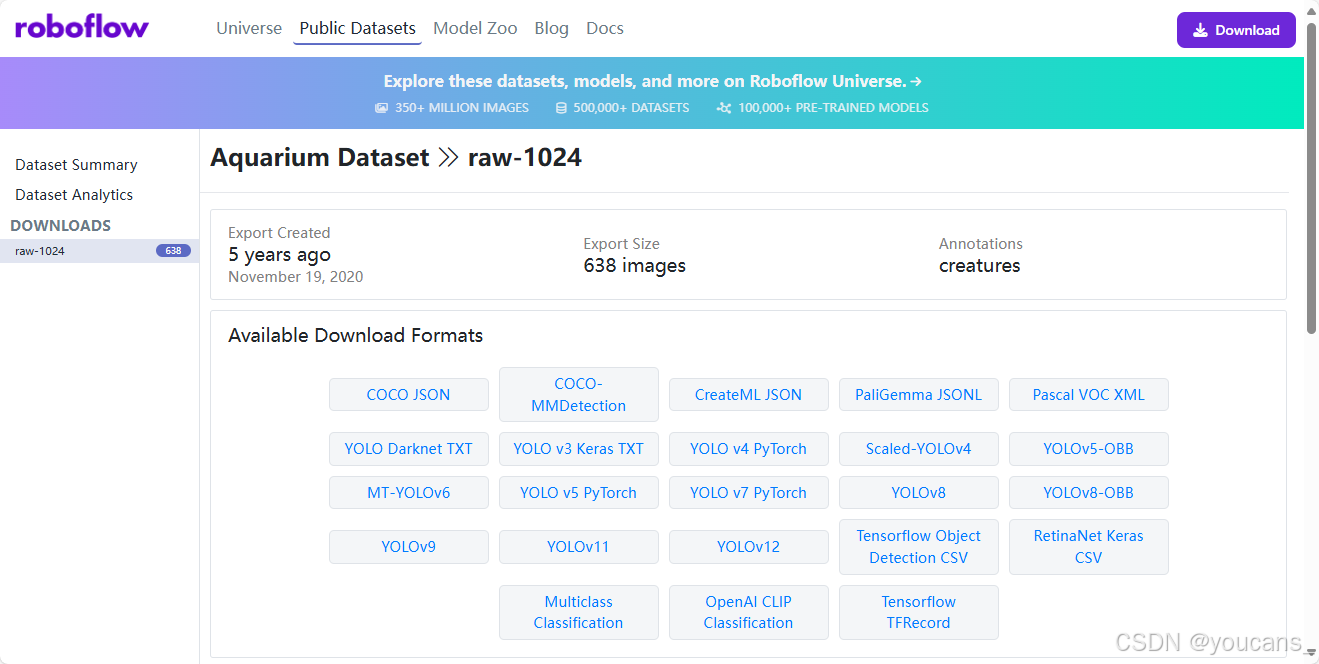

- 打开 Roboflow 网站,从Roboflow 公开数据集中选择一个数据集,下载到本地。

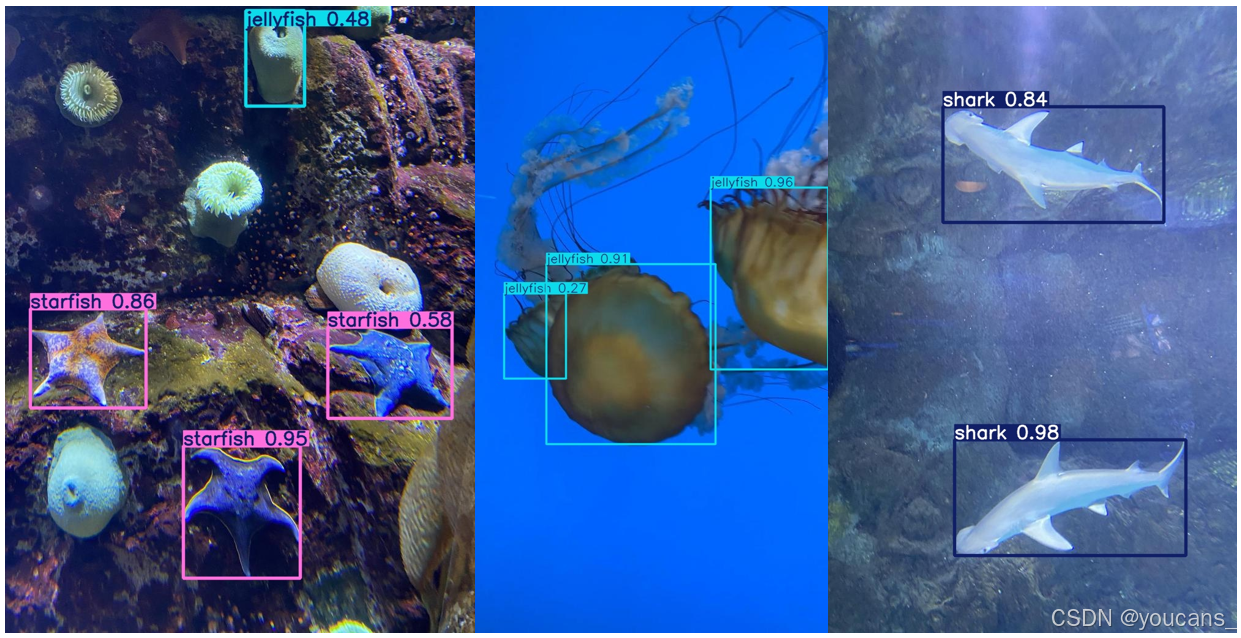

本文选择 “水族馆数据集(Aquarium Dataset)”。该数据集由 Roboflow 从美国两个水族馆收集的 638 张图像组成:Henry Doorly Zoo 和 National Aquarium in Baltimore。Roboflow对这些图像进行了标记,以便进行物体检测。图像和注释在知识共享署名许可下发布。

该数据集标记了 7 个类别:鱼类(fish)、水母(jellyfish)、企鹅(penguins)、鲨鱼(sharks)、海雀(puffins)、黄貂鱼(stingrays)和海星(starfish)。大多数图像包含多个边界框。

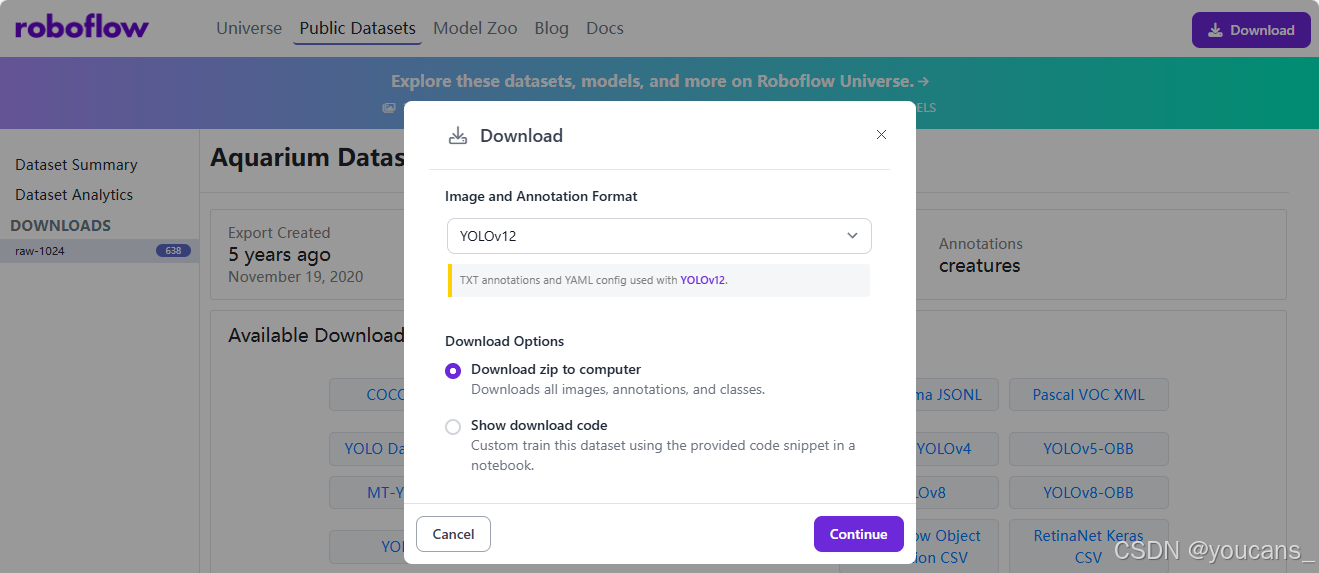

- Roboflow 提供了多种下载格式,主要是数据集组织和标注格式的区别。注意要以YOLOv12 格式(YOLO13 与 YOLO12 数据集格式相同)导出,如下图所示。

选择 YOLO12 格式,下载 水族馆数据集(Aquarium Dataset)。

- 下载后将数据集解压缩。

下载的 Aquarium 数据集的文件路径如下:

DatasetAquariumYolo/

├── train/

│ ├── images/

│ └── labels/

├── valid/

│ ├── images/

│ └── labels/

├── test/ (option)

│ ├── images/

│ └── labels/

└── data.yaml

下载的 Aquarium 数据集设有 test,train,valid 三个文件夹,分别用作测试、训练和检验。每个文件夹下设有 images,labels 两个文件夹,分别保存图像文件和标注文件。

一个典型的标注文件的内容如下。文件有 4 行,每行表示一个检测目标。每行有 5个参数,第 1 列是类别标签,后 4个参数是 BoundingBox 的坐标位置。

3 0.5 0.5361328125 0.08854166666666667 0.1142578125

3 0.30859375 0.3115234375 0.09244791666666667 0.103515625

3 0.71875 0.5859375 0.15104166666666666 0.0888671875

3 0.3072916666666667 0.494140625 0.10807291666666667 0.0693359375

如果自己收集和标注数据集,也要按照以上格式来组织数据集和标注文件。

- 数据集配置文件 .yaml

下载数据集配置文件中给出了数据集的路径,训练集、检验集和验证集的路径,分类任务的类别数量 nc 和类名列表 names。

Aquarium Dataset 数据集配置文件 data.yaml 位于数据集的根目录,内容如下:

train: ../train/images

val: ../valid/images

test: ../test/images

nc: 7

names: ['fish', 'jellyfish', 'penguin', 'puffin', 'shark', 'starfish', 'stingray']

roboflow:

workspace: brad-dwyer

project: aquarium-combined

version: 2

license: CC BY 4.0

url: https://universe.roboflow.com/brad-dwyer/aquarium-combined/dataset/2

其中,train 表示训练集图像文件夹的路径,val 表示验证集图像文件夹的路径,test 表示测试集图像文件夹的路径。nc:7 表示类别数为 7,names 表示类别名。

注意,nc 是由数据集的标注内容决定的,不能自行修改。

2.3 重新整理 YOLOv13 数据集

YOLO13 模型训练对于格式的要求非常严格,需要重新组织样本图片和标签。

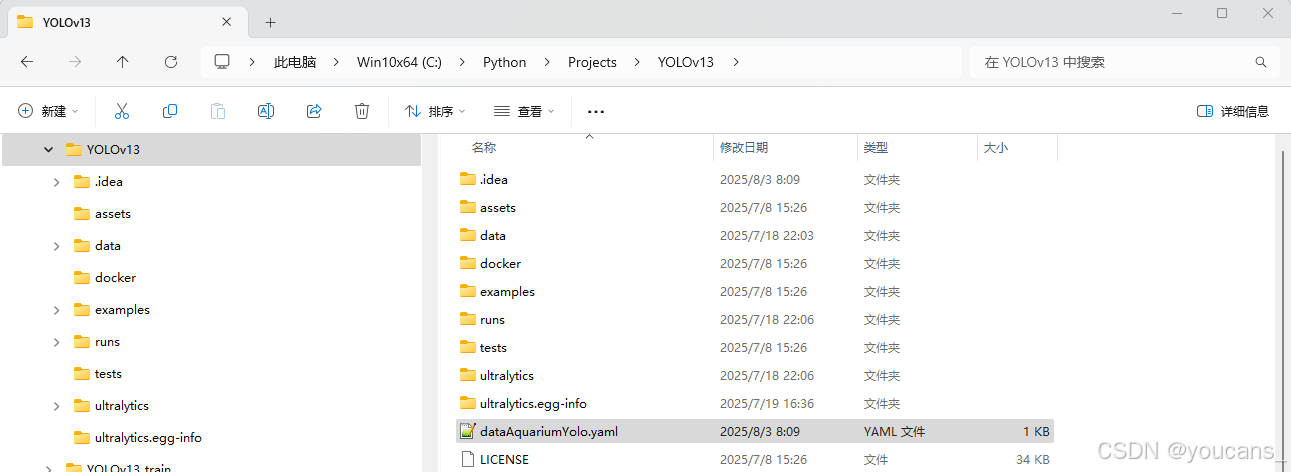

- 为了方便在不同项目中使用数据集,将 YOLO13项目和 DatasetAquarium数据集都保存在 Projects 目录下。

- Projects

- DatasetAquarium

- YOLO13

- 按照 YOLO13 的数据格式组织数据集的样本图片和标签。

- PyProjects

- DatasetAquarium

- test

- images

- labels

- train

- images

- labels

- valid

- images

- labels

- YOLO13

- dataAquariumYolo.yaml

- Yolo13_train.py

- 编写数据集配置文件 YAML(dataAquariumYolo.yaml )。

YOLO13 模型训练时,要调用数据集配置文件 YAML 文件,用于指定数据集的路径和分类类别。

在 YOLO13项目中,提供了多个数据集配置文件,例如:“\YOLOv13\ultralytics\cfg\datasets\coco8.yaml” 可供参考。现在,我们根据Aquarium Dataset 数据集配置文件 data.yaml ,编写本项目的数据集配置文件 dataAquariumYoLo.yaml,保存到 YOLO13项目的根目录,内容如下。

# Ultralytics YOLO 🚀, AGPL-3.0 license

# Train/val/test sets as 1) dir: path/to/imgs, 2) file: path/to/imgs.txt, or 3) list: [path/to/imgs1, path/to/imgs2, ..]

path: C:/Python/Projects/DatasetAquariumYolo # dataset root dir

train: images/train # train images (relative to 'path')

val: images/valid # val images (relative to 'path')

test: images/test # test images (optional)

# Classes

names:

0: fish

1: jellyfish

2: penguin

3: puffin

4: shark

5: starfish

6: stingray

3. 自有数据集的训练

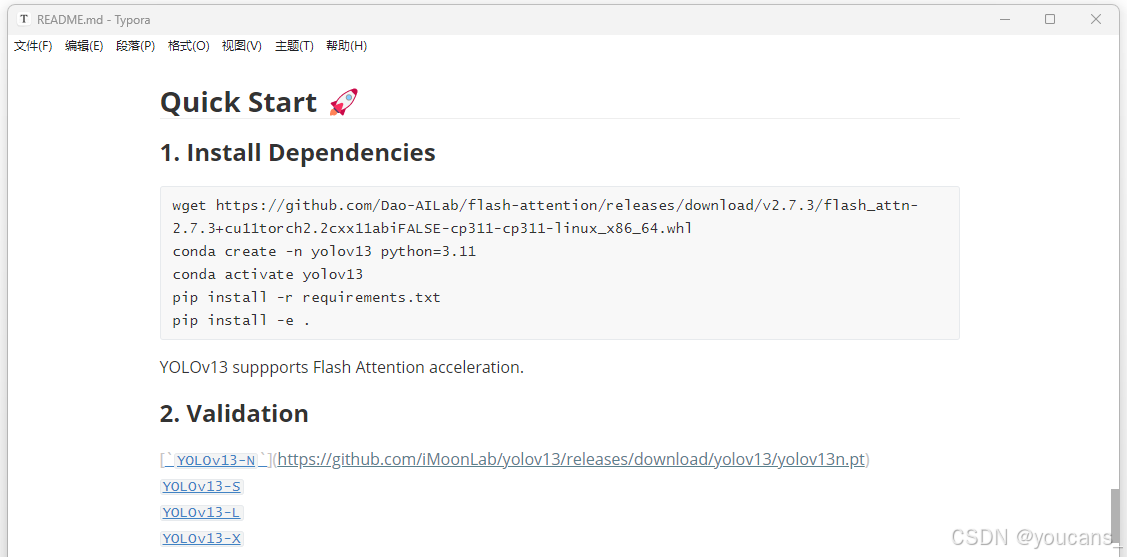

3.1 下载 YOLO13 预训练模型

使用 YOLO13 进行推理,首先要下载 YOLO13 预训练模型。使用 YOLO13 训练自己的模型,也常用 YOLO13 预训练模型作为初始模型。

YOLO13 有多个不同规模的模型,从小到大依次是:YOLO13N、YOLO13S、YOLO13L、YOLO13X。这些模型与各种操作模式兼容,包括推理、验证、训练和导出,便于在部署和开发的不同阶段使用。

在下载 YOLO13 项目 中的 Readme.md 文件中可以找到模型下载地址: YOLO13N , YOLO13S, YOLO13L,YOLO13X。

以检测任务为例,如下图所示,点击所需的模型即可下载相应的预训练模型。

说明:YOLO13在运行时如果在本地没有检测到预训练模型,,将会自动从网络下载并保存,但下载速度可能很慢甚至连接失败(视网络条件和限制),因此推荐先将 YOLO13 预训练模型下载到本地。

本文选择检测任务模型 YOLO13,参数约 2.5M。下载完成后,将模型文件保存在 YOLO13 项目的根目录路径下,即 “.\YOLO13\YOLOv13n.pt”。

3.2 使用 Python 接口的模型训练

YOLO13 提供了 Python 接口的调用方式。它提供了加载和运行模型以及处理模型输出的函数。该界面设计易于使用,以便用户可以在他们的项目中快速实现目标检测。

使用 Diabetic Retinopathy 数据集进行模型训练的 Python 参考例程如下。

from ultralytics import YOLO

if __name__ == '__main__':

# 创建 YOLO13 模型对象,加载指定的模型配置

model = YOLO('yolov13.yaml')

# 加载预训练的 YOLO13 权重文件

model.load('yolov13n.pt')

# 用指定数据集训练模型

results = model.train(data=r'dataAquariumYolo.yaml', # 指定训练数据集的配置文件路径

cache=False, # 是否缓存数据集以加快后续训练速度

workers=4, # 设置用于数据加载的线程数为4

device='0', # 运行设备, 指定使用的 CPU/GPU 设备

epochs=100, # 设置训练的总轮数为100轮

batch=64, # 设置每个训练批次的大小为16

imgsz=640, # 指定训练时使用的图像尺寸

scale=0.5, # S:0.9; L:0.9; X:0.9

mixup=0.0, # S:0.05; L:0.15; X:0.2

freeze=10, # 冻结模型前10层(backbone部分)

optimizer = 'SGD', # 设置优化器为SGD(随机梯度下降)

)

注意:

(1)本例程使用的 YOLOv13 项目的路径为 “C:\Python\Projects\YOLOv13” 。

(2)本例程使用的训练数据集配置文件路径为 “C:\Python\Projects\YOLOv13\dataAnimalYolo12.yaml” 。

(3)本例程运行后的训练模型及训练日志保存在 “C:\Python\Projects\YOLOv13\runs\detect\train” 目录下。

在 PyCharm 编译并运行程序,就实现对 Aquarium数据集进行模型训练。运行时在 PyCham 窗口中输出模型训练的信息如下。

C:\Users\Administrator\.conda\envs\YOLO13\python.exe C:\Python\Projects\YOLOv13\Yolo13_train1.py

WARNING ⚠️ no model scale passed. Assuming scale='n'.

Transferred 898/898 items from pretrained weights

New https://pypi.org/project/ultralytics/8.3.173 available 😃 Update with 'pip install -U ultralytics'

Ultralytics 8.3.63 🚀 Python-3.11.13 torch-2.3.1+cu121 CUDA:0 (NVIDIA GeForce RTX 3060, 12288MiB)

engine\trainer: task=detect, mode=train, model=yolov13.yaml, data=dataAquariumYolo.yaml, epochs=100, time=None, patience=100, batch=64, imgsz=640, save=True, save_period=-1, cache=False, device=0, workers=4, project=None, name=train2, exist_ok=False, pretrained=yolov13n.pt, optimizer=SGD, verbose=True, seed=0, deterministic=True, single_cls=False, rect=False, cos_lr=False, close_mosaic=10, resume=False, amp=True, fraction=1.0, profile=False, freeze=10, multi_scale=False, overlap_mask=True, mask_ratio=4, dropout=0.0, val=True, split=val, save_json=False, save_hybrid=False, conf=None, iou=0.7, max_det=300, half=False, dnn=False, plots=True, source=None, vid_stride=1, stream_buffer=False, visualize=False, augment=False, agnostic_nms=False, classes=None, retina_masks=False, embed=None, show=False, save_frames=False, save_txt=False, save_conf=False, save_crop=False, show_labels=True, show_conf=True, show_boxes=True, line_width=None, format=torchscript, keras=False, optimize=False, int8=False, dynamic=False, simplify=True, opset=None, workspace=None, nms=False, lr0=0.01, lrf=0.01, momentum=0.937, weight_decay=0.0005, warmup_epochs=3.0, warmup_momentum=0.8, warmup_bias_lr=0.0, box=7.5, cls=0.5, dfl=1.5, pose=12.0, kobj=1.0, nbs=64, hsv_h=0.015, hsv_s=0.7, hsv_v=0.4, degrees=0.0, translate=0.1, scale=0.5, shear=0.0, perspective=0.0, flipud=0.0, fliplr=0.5, bgr=0.0, mosaic=1.0, mixup=0.0, copy_paste=0.1, copy_paste_mode=flip, auto_augment=randaugment, erasing=0.4, crop_fraction=1.0, cfg=None, tracker=botsort.yaml, save_dir=runs\detect\train2

Overriding model.yaml nc=80 with nc=7

WARNING ⚠️ no model scale passed. Assuming scale='n'.

from n params module arguments

0 -1 1 464 ultralytics.nn.modules.conv.Conv [3, 16, 3, 2]

1 -1 1 2368 ultralytics.nn.modules.conv.Conv [16, 32, 3, 2, 1, 2]

2 -1 1 5792 ultralytics.nn.modules.block.DSC3k2 [32, 64, 1, False, 0.25]

...

Logging results to runs\detect\train2

Starting training for 100 epochs...

0%| | 0/7 [00:00<?, ?it/s]

Epoch GPU_mem box_loss cls_loss dfl_loss Instances Size

1/100 7.62G 1.47 4.431 1.39 807 640: 100%|██████████| 7/7 [00:05<00:00, 1.34it/s]

Class Images Instances Box(P R mAP50 mAP75 mAP50-95): 100%|██████████| 1/1 [00:00<00:00, 1.06it/s]

all 127 909 0.00171 0.0916 0.0045 0.00379 0.00374

...

Epoch GPU_mem box_loss cls_loss dfl_loss Instances Size

100/100 7.13G 1.04 0.7611 1.061 368 640: 100%|██████████| 7/7 [00:03<00:00, 2.07it/s]

Class Images Instances Box(P R mAP50 mAP75 mAP50-95): 100%|██████████| 1/1 [00:00<00:00, 1.20it/s]

all 127 909 0.729 0.659 0.706 0.41 0.423

...

Ultralytics 8.3.63 🚀 Python-3.11.13 torch-2.3.1+cu121 CUDA:0 (NVIDIA GeForce RTX 3060, 12288MiB)

YOLOv13 summary: 535 layers, 2,449,260 parameters, 0 gradients, 6.2 GFLOPs

Class Images Instances Box(P R mAP50 mAP75 mAP50-95): 100%|██████████| 1/1 [00:00<00:00, 1.09it/s]

all 127 909 0.725 0.67 0.718 0.433 0.437

fish 63 459 0.783 0.741 0.791 0.398 0.43

jellyfish 9 155 0.75 0.897 0.904 0.513 0.521

penguin 17 104 0.56 0.692 0.632 0.248 0.31

puffin 15 74 0.639 0.405 0.471 0.206 0.225

shark 28 57 0.684 0.632 0.68 0.448 0.447

starfish 17 27 0.839 0.63 0.764 0.538 0.552

stingray 23 33 0.821 0.697 0.784 0.68 0.575

Speed: 0.2ms preprocess, 3.0ms inference, 0.0ms loss, 0.8ms postprocess per image

Results saved to runs\detect\train2

3.4 训练日志

训练日志的图表对于评估和理解模型的性能非常重要,可以帮助我们分析模型的优势和不足。

训练结果保存在 runs\detect\train,训练日志的图表如下图所示。

- 训练完成后,训练的最优模型保存为文件: “./Projects/YOLO12_Animal/runs/detect/train/weights/best.py”。

- weights 文件夹

- best.pt:损失值最小的模型文件

- last.pt:训练到最后的模型文件

- args.yaml:模型训练的配置参数

- 混淆矩阵

- confusion_matrix.png 展示了分类模型的性能。图中的每一行代表模型预测的类别,每一列代表实际的类别。对角线上的数值表示模型正确预测的数量。对角线上较深的颜色表示该类别预测正确的数量较多。

- confusion_matrix_normalized.png:标准化混淆矩阵,显示每个类别的预测正确比例。

- F1-置信度曲线

- F1_curve.png:F1-置信度曲线,显示了F1得分随着置信度阈值的变化。

F1得分是精确度和召回率的调和平均值,曲线的峰值表示给定置信度阈值下精确度和召回率的最佳平衡点。

- 标签分布图和标签相关图

- labels.jpg:标签分布图和边界框分布图。

柱状图显示了不同类别的实例分布数量。散点图则展示了目标检测任务中边界框的空间分布情况,反映了常见的尺寸和长宽比。 - labels_correlogram.jpg:标签相关图

相关图提供了不同类别标签之间的关系,以及它们在图像中位置的相关性。这有助于理解模型在识别不同类别时可能出现的关联或混淆。

- P/PR/R 曲线

- P_curve.png:精确度-置信度曲线,展示了模型预测的精确度随着置信度阈值的变化。

精确度是模型预测正确正例与预测为正例总数的比值。 - PR_curve.png:精确度-召回曲线,展示了模型的精确度与召回率之间的关系。

理想情况下,模型应在精确度和召回率之间保持良好的平衡。 - R_curve.png:召回-置信度曲线,显示了模型的召回率随置信度阈值的变化。

召回率是模型正确预测的正例与实际正例总数的比值。

- 训练结果图表和数据

- results.png 和 results.csv:训练结果图表和数据

展示了模型在训练过程中的性能变化,包括损失函数的变化和评估指标(如精确度、召回率和mAP)的变化。

3.5 断点训练

YOLO13 提供了参数 “resume” 进行断点训练。

对于大型数据集,使用 YOLO13 进行模型训练所需的时间很长,如果训练中断或者出现异常,可以接着从上一次中断时的模型继续训练。

-

将 “resume” 参数修改为 “True”,则会加载上一次训练的模型权重和优化器状态,继续从断点开始训练。

-

加载预训练模型权重文件时,使用上次中断的模型或最后一次训练的权重(last.pt)。

from ultralytics import YOLO

if __name__ == '__main__':

# 创建 YOLO13 模型对象,加载指定的模型配置

model = YOLO('yolov13.yaml')

# 加载预训练的 YOLO13 权重文件

model.load('yolov13n.pt')

# 用指定数据集训练模型

results = model.train(data=r'dataAquariumYolo.yaml', # 指定训练数据集的配置文件路径

cache=False, # 是否缓存数据集以加快后续训练速度

workers=4, # 设置用于数据加载的线程数为4

device='0', # 运行设备, 指定使用的 CPU/GPU 设备

epochs=100, # 设置训练的总轮数为100轮

batch=64, # 设置每个训练批次的大小为16

imgsz=640, # 指定训练时使用的图像尺寸

scale=0.5, # S:0.9; L:0.9; X:0.9

mixup=0.0, # S:0.05; L:0.15; X:0.2

resume = 'True' # 设置断点训练

)

4. 模型验证与模型预测

4.1 模型验证

训练后验证。

- 将训练好的模型 best.pt 保存在项目的根目录,并将文件名改为 “yolo13n_Aquarium.pt”。

- 模型验证程序如下。

from ultralytics import YOLO

if __name__ == '__main__':

# 读取模型,传入训练好的模型

model = YOLO('yolo13n_Aquarium.pt')

# 验证模型

metrics = model.val() # 无需参数,使用 best.pt中的配置文件

- 运行模型验证程序,结果保存在 “.\runs\detect\val” 文件夹。

C:\Users\Administrator\.conda\envs\YOLO13\python.exe C:\Python\Projects\YOLOv13\Yolo13Aquarium_Val.py

Ultralytics 8.3.63 🚀 Python-3.11.13 torch-2.3.1+cu121 CUDA:0 (NVIDIA GeForce RTX 3060, 12288MiB)

YOLOv13 summary: 535 layers, 2,449,260 parameters, 0 gradients, 6.2 GFLOPs

val: Scanning C:\Python\Projects\DatasetAquariumYolo\labels\valid.cache... 127 images, 0 backgrounds, 0 corrupt: 100%|

Class Images Instances Box(P R mAP50 mAP75 mAP50-95): 100%|██████████| 8/8 [00:01<00:00, 4.57it/s]

all 127 909 0.724 0.674 0.718 0.431 0.436

fish 63 459 0.793 0.747 0.794 0.397 0.428

jellyfish 9 155 0.77 0.923 0.916 0.502 0.518

penguin 17 104 0.554 0.673 0.625 0.244 0.312

puffin 15 74 0.602 0.405 0.478 0.212 0.224

shark 28 57 0.731 0.632 0.673 0.497 0.458

starfish 17 27 0.854 0.65 0.757 0.502 0.521

stingray 23 33 0.764 0.687 0.783 0.662 0.594

Speed: 0.9ms preprocess, 7.9ms inference, 0.0ms loss, 1.0ms postprocess per image

Results saved to runs\detect\val

4.2 模型预测

训练后验证。

- 将训练好的模型 best.pt 保存在项目的根目录,并改名为 “yolo13n_Aquarium.pt”。

- 模型预测程序如下。

参数 source 可以是一个或多个图片文件,一个视频文件,也可以是一个文件夹,或视频采集设备。

from ultralytics import YOLO

if __name__ == '__main__':

# 读取模型,传入训练好的模型

model = YOLO('yolo13n_Aquarium.pt')

outputs = model.predict(source=f"C:\\Python\\Projects\\DatasetAquariumYolo\\images\\test", save=True)

- 运行模型预测程序,结果保存在 “.\runs\detect\predict” 文件夹。

【本节完】

版权声明:

欢迎关注『跟我学YOLO』系列

转发必须注明原文链接:

【跟我学YOLO】YOLO13(3)训练自己的数据集

Copyright by youcans@qq.com 2025

Crated:2025-08

如果您在研究中使用了 YOLO13,请引用原作:

@software{YOLO13,

author = {Tian, Yunjie and Ye, Qixiang and Doermann, David},

title = {YOLOv13: Attention-Centric Real-Time Object Detectors},

year = {2025},

url = {https://github.com/sunsmarterjie/YOLOv13},

license = {AGPL-3.0}

}

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献19条内容

已为社区贡献19条内容

所有评论(0)