机器学习-stacking

目标是降低偏差和方差降低偏差方差计算消耗并行化baggingYnnboostingYn1stackingYnnk折多层stackingYYn* l *kn*k。

·

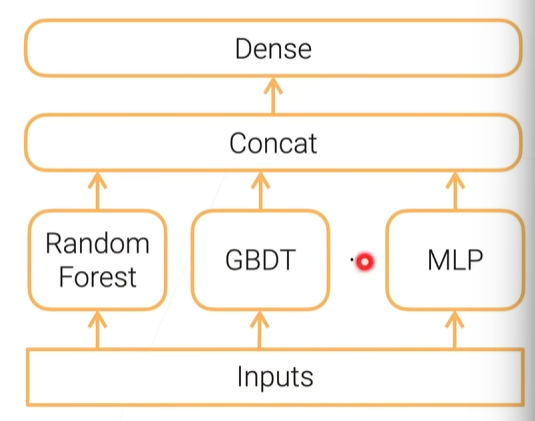

Stacking

- 将多个base learner结合来减少方差

特点:

base learners可以有不同的模型类别

通过学习参数将base learner的输出线性结合

- bagging特点:

使用相同类型的模型

使用bootstrap获得多元性

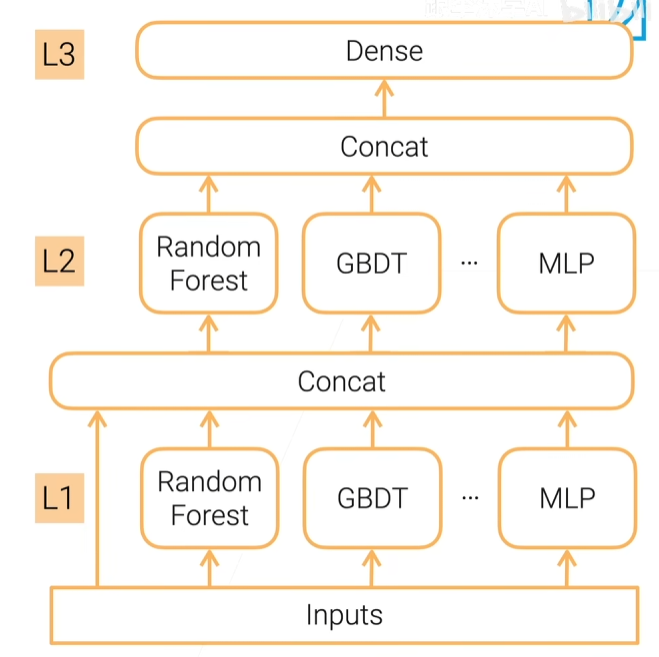

多层stacking

- 在多层中stacking base learner来减少偏差

每层可使用不同的base learner

- 上一层基于下一层的输出进行训练

可将原始输入加入

多层Stacking中的过拟合

- 训练不同层的learner学习不同的数据来减轻过拟合

将训练数据分为A和B,L1的learner用A训练,在B上做预测,以产生给L2的learner的输入 - 重复的k折bagging

1、像k折交叉验证一样训练k个模型

2、将每个模型在折外数据(验证集)的预测进行连接

重复上述两步n次,平均每个模型这n次的预测结果

集成模型总结

- 目标是降低偏差和方差

| 降低 | 偏差 | 方差 | 计算消耗 | 并行化 |

|---|---|---|---|---|

| bagging | Y | n | n | |

| boosting | Y | n | 1 | |

| stacking | Y | n | n | |

| k折多层stacking | Y | Y | n* l *k | n*k |

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)