安全多方计算 & 联邦学习 & 同态加密

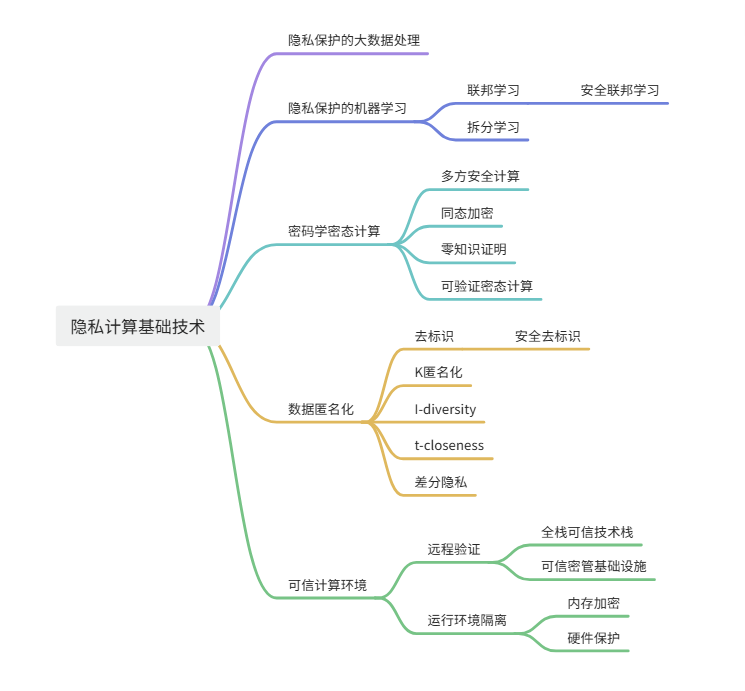

隐私计算技术路线主要包括三种核心方法:安全多方计算(MPC)、联邦学习和同态加密。MPC允许多方在不泄露原始数据的前提下联合计算,分为半诚实和恶意模型,采用秘密分享、混淆电路等技术实现。联邦学习通过分布式协作训练模型,保护数据隐私,分为横向、纵向和迁移学习三种类型。同态加密支持对加密数据直接计算,包括部分、完全和层级同态加密。这些技术共同构建了隐私保护计算的完整框架。

一、安全多方计算

1.1 安全多方计算(MPC)概述:

安全多方计算(Multi-Party Computation,MPC)可以允许多个参与方在保证各方输入安全性的前提下,共同执行某个预先设定好的函数。

安全多方协议本质上是一种交互式密码协议。

- 协议正确性:通常指协议最终的计算结果应当与明文计算结果保持一致。

- 协议安全性:通常衡量了协议在攻击者存在情况下所受到的影响。

1.2 MPC分类方式

- 威胁模型

- 半诚实模型:攻击者会监听其收到的所有信息,不会主动破坏协议

- 恶意模型:攻击者会主动拒绝执行协议、甚至破坏协议

- 参与方数量:根据实际计算场景以及性能考虑,选用不同的协议

- 两方MPC

- 三方MPC

- 任意多方MPC

- 通用/专有MPC

- 通用MPC可以实现任意计算

- 专有MPC只支持特定的某类运算(如隐私求交)

1.3 MPC关键技术

- 秘密分享(SS)是一个非常基础的安全计算原语以及密码学工具。

- 混淆电路(Garbled Circuit(GC))通过加密和扰乱电路的值来掩盖数据信息。

- 不经意传输(Oblivious Transfer,OT)协议是一类特殊的隐私计算协议。

- 同态加密(Homomorphic Encryption,HE):对数据进行加密后,他人可以不经解密,直接对加密数据进行处理,并且保证数据处理结果经解密后是正确的。

二、联邦学习

1.1 联邦学习的优势:

- 数据隐私保护

- 打破数据孤岛

- 合规性高

- 激励多方合作

1.2 联邦学习的定义:

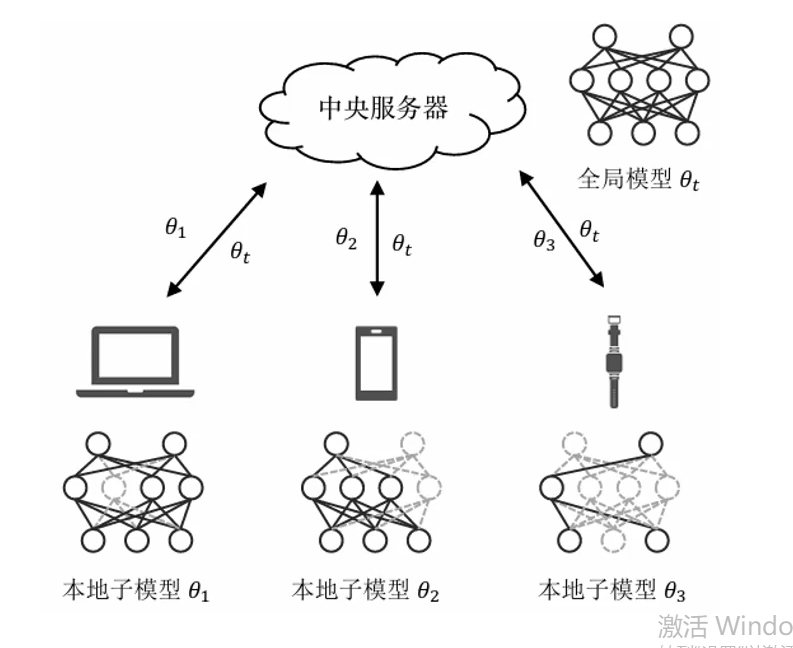

联邦学习是一种分布式机器学习范式,允许多个数据持有者在不共享他们的原始数据的情况下协同训练机器学习模型。通过联邦学习,各参与方不再需要共享原始数据本身,而是交换模型信息和更新数据,就可以提升模型的性能。

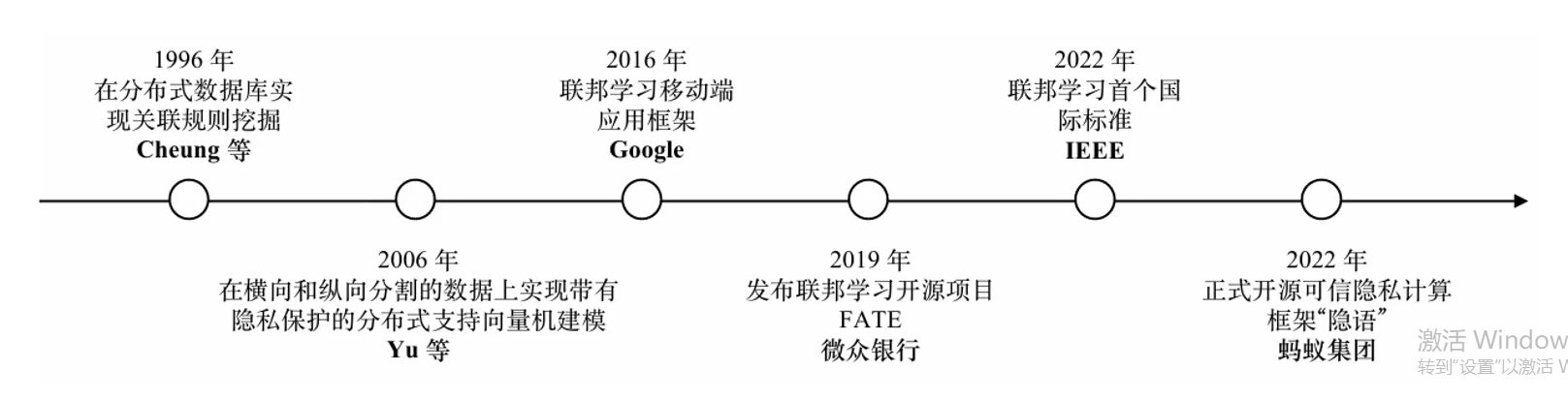

1.3 联邦学习发展历程

1.4 联邦学习分类

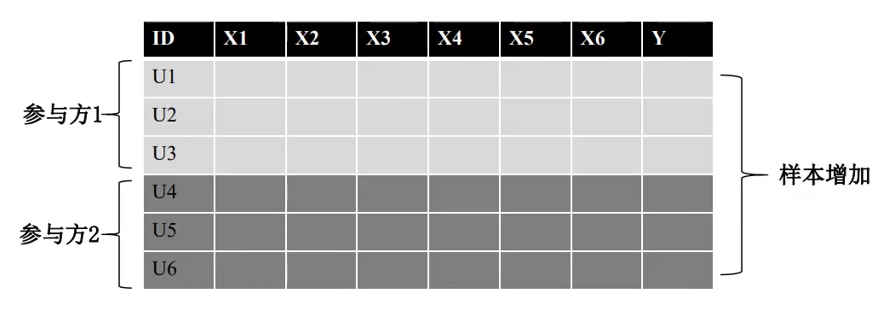

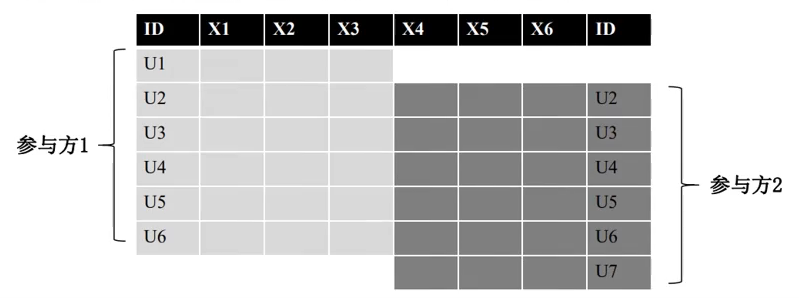

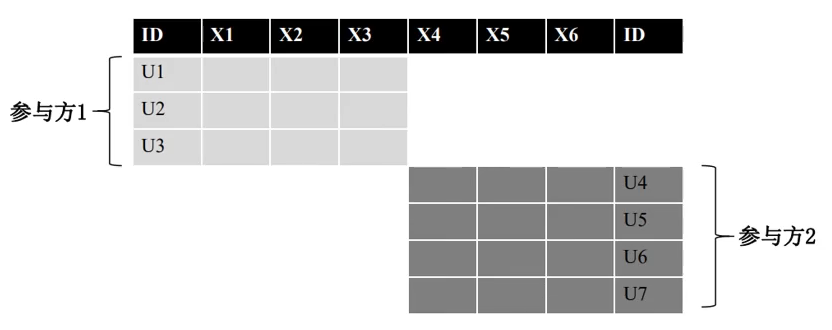

1、按照数据特征

- 横向联邦学习又被称为水平联邦学习,是最常见的联邦学习类型,适用于各个客户端的本地数据集具有高度一致的特征空间,但具体样本并不相同的场景中。

- 纵向联邦学习又被称为垂直联邦学习,针对的是客户端拥有相同的数据样本,但各自数据对应的特征空间不完全相同的情况。

- 联邦迁移学习处理数据样本和特征都不同的复杂场景。

2、按照客户端类型

- 跨设备(cross-device)联邦学习:是指参与计算的设备数量众多且设备通常为个人用户所有,如智能手机、平板电脑或其他移动设备。

- 跨孤岛(cross-silo)的联邦学习:涉及的是较少数量的客户端,但每个客户端(通常是组织或企业)掌握着大量的数据资源和强大的计算能力。

3、按照系统拓扑结构

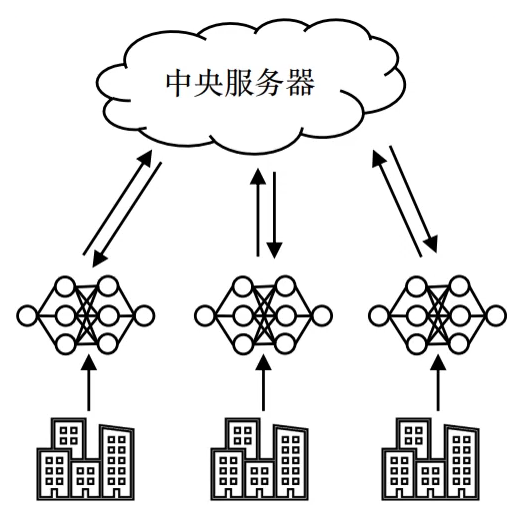

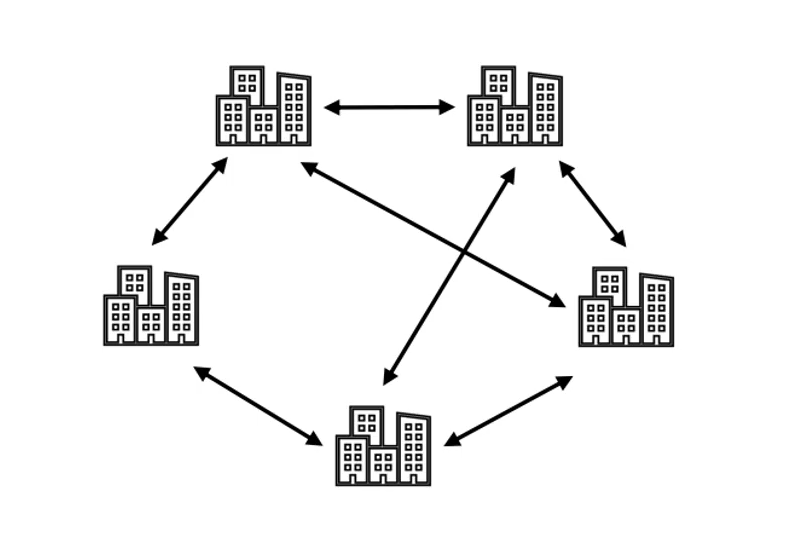

- 中心化联邦学习:是目前最常见的一种拓扑结构,其中包含一个中央服务器作为协调节点,负责管理所有客户端(或节点)的模型更新。

- 去中心化联邦学习:去除了中央服务器,客户端直接相互交换信息和模型更新。

1.5 联邦学习面临的挑战及其解决方案

1.5.1 数据异质性

数据异质性指的是在联邦学习中,各客户端之间的数据分布不一致,不能遵循同一采样分布,呈现出非独立同分布(Non-Independent and Identically Distributed,Non-IID)的现象。即,x 和 y 分别代表数据样本的特征和标签。

1.5.2 模型异质性

模型异质性反映了参与学习过程的各个客户端在模型需求、能力或优先级方面的差异。

- 结构异质性:涉及到客户端使用的模型结构不同。

- 参数异质性:即使是同一种模型结构,不同客户端可能会根据自身的数据特征调整模型参数,如学习率、正则化系数等,以优化本地模型的性能。

- 功能异质性:不同客户端可能针对不同的任务目标选择不同类型的模型。

解决方法:

- 知识蒸馏:出发点是模型压缩。

- 部分训练:旨在根据每个客户端上的计算资源能力,自适应地从全局模型中提取一个与客户端资源相匹配的子模型作为本地模型,从而避免了知识蒸馏对代理数据集的要求。

1.5.6 通信挑战

由于客户端可能分布在不同的地理位置,且网络环境各异,通信成本和延迟成为了制约联邦学习实用性的重要因素。通信效率是联邦学习中的一个重要挑战,其主要受以下因素所影响:

- 网络带宽限制:参与联邦学习的设备或机构可能分布在不同的地理位置,它们之间的通信需要依赖于网络传输。由于网络带宽有限,传输大量的模型参数更新可能会导致通信成本高昂,甚至网络拥塞。

- 通信延迟:在某些情况下,参与方之间的通信可能需要经过长距离或者通过不稳定的网络连接,这会导致传输数据的延迟增加,影响到联邦学习的效率和实时性。

- 隐私和安全考虑:联邦学习不共享原始数据然而,模型参数的传输仍然可能涉及敏感信息,因此需要确保通信过程是安全可靠的,这增加了通信的复杂性和开销。

- 能源消耗 :在移动设备等资源受限的环境中,通信过程可能会消耗大量的电量和计算资源。因此,高效的通信方式不仅可以降低通信成本,还可以延长设备的续航时间和提高性能。

目前联邦学习中解决通信效率挑战的优化算法主要可以分为基于量化压缩的优化算法、基于稀疏化压缩的优化算法和基于客户端选择的优化算法等。

量化压缩:

- 随即量化

- 旋转量化

- 符号量化

稀疏化压缩:

在联邦学习中,Top-k 稀疏化和Rand-k 稀疏化是两种常用的方法。

- Top-k 稀疏化:保留元素的子集包括具有最大绝对值的k个百分比作为稀疏化的目标。

- Rand-k 稀疏化:保留值是随机选择的。

根据改进的方式不同,联邦学习中的稀疏化技术主要可以分为自适应稀疏化、双向稀疏化和分层稀疏化等几种优化方式。

联邦学习的目的:希望各个数据持有者不共享原始数据的情况下,协同训练一个高性能的全局模型。

三、同态加密

1.1 同态加密定义:

同态加密:是一种加密技术,它允许对加密数据进行计算而不需要解密。在同态加密中,加密数据可以被传递给其他方,并且可以在不解密数据的情况下执行各种计算,比如加法、乘法等。

1.2 同态加密分类

- 部分同态加密(Partially HE,PHE):仅支持一种同态运算(加法或乘法)的加密方案,又称为半同态加密方案。

- 同态加密(Fully HE,FHE):同时支持加法、乘法同态运算的加密方案。

- 层级同态加密(Somewhat/Level HE):支持一种同态运算的同时,还支持另一种次数受限的同态运算的加密方案,又称为Somewhat。

隐私计算的技术路线

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)