综述:从物理模拟器和世界模型中学习具身智能(上)

25年7月来自南京大学、香港大学、中南大学、地平线机器人公司、中科院计算所、上海交大、慕尼黑工大和清华大学的论文“A Survey: Learning Embodied Intelligence from Physical Simulators and World Models”。对通用人工智能 (AGI) 的追求已将具身智能 (embodied intelligence) 置于机器人研究的前沿。

25年7月来自南京大学、香港大学、中南大学、地平线机器人公司、中科院计算所、上海交大、慕尼黑工大和清华大学的论文“A Survey: Learning Embodied Intelligence from Physical Simulators and World Models”。

对通用人工智能 (AGI) 的追求已将具身智能 (embodied intelligence) 置于机器人研究的前沿。具身智能关注的是能够在物理世界中感知、推理和行动的智体。实现强大的具身智能不仅需要先进的感知和控制能力,还需要将抽象认知应用于现实世界交互的能力。物理模拟器和世界模型这两项基础技术已成为实现这一目标的关键推动因素。物理模拟器为训练和评估机器人智能体提供受控的高保真环境,从而能够安全高效地开发复杂行为。相比之下,世界模型赋予机器人对其周围环境的内部表征,使其能够进行超越直接感官输入的预测性规划和自适应决策。本综述系统地回顾通过整合物理模拟器和世界模型来学习具身人工智能的最新进展。其分析它们在增强智能机器人的自主性、适应性和泛化能力方面的互补作用,并讨论外部模拟和内部建模在弥合模拟训练与现实世界部署之间差距方面的相互作用。

随着智能机器人越来越多地应用于现实世界,例如老年人护理 [7]、医疗救助 [8]、灾难救援 [9] 和教育 [10]。它们在动态、不确定的环境中自主安全运行的能力变得至关重要。然而,应用的多样性和技术进步的快速步伐迫切需要一个系统的框架来评估和比较机器人的能力。建立科学合理的机器人智能分级体系,不仅可以明确技术发展路线图,而且可以为监管、安全评估和伦理部署提供必要的指导。

为了满足这一需求,最近的研究探索了各种量化机器人能力的框架,例如 DARPA 机器人挑战赛评估方案 [11]、服务机器人安全的 ISO 13482 标准 [12] 以及自主性水平的评估 [13], [14]。然而,仍然缺乏一个整合智能认知、自主行为和社交互动等维度的综合分级体系。

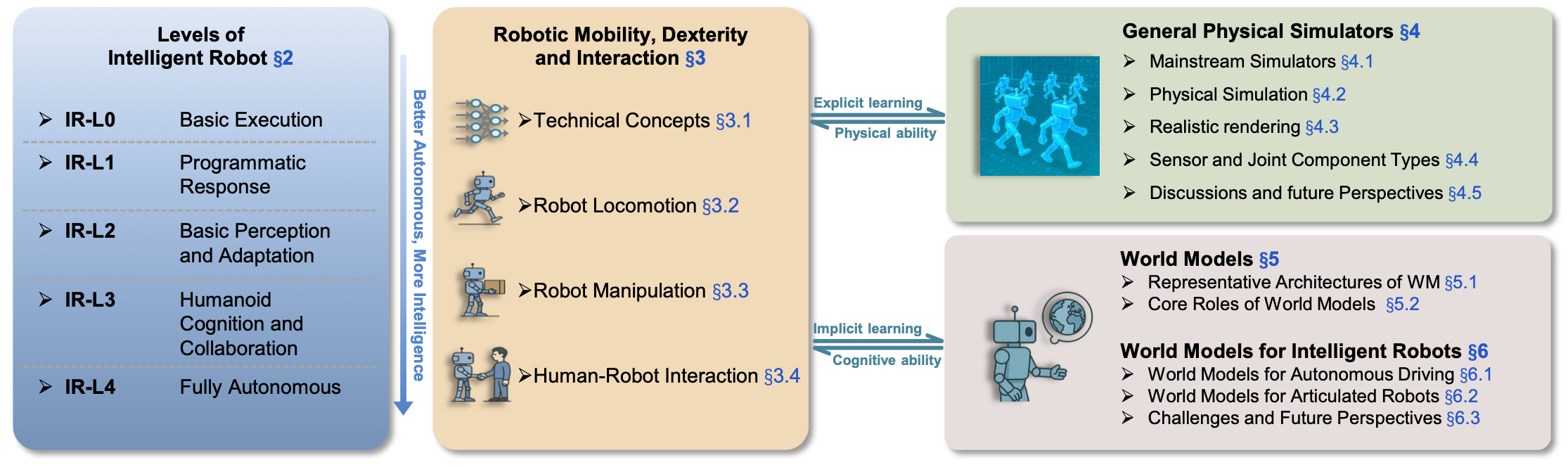

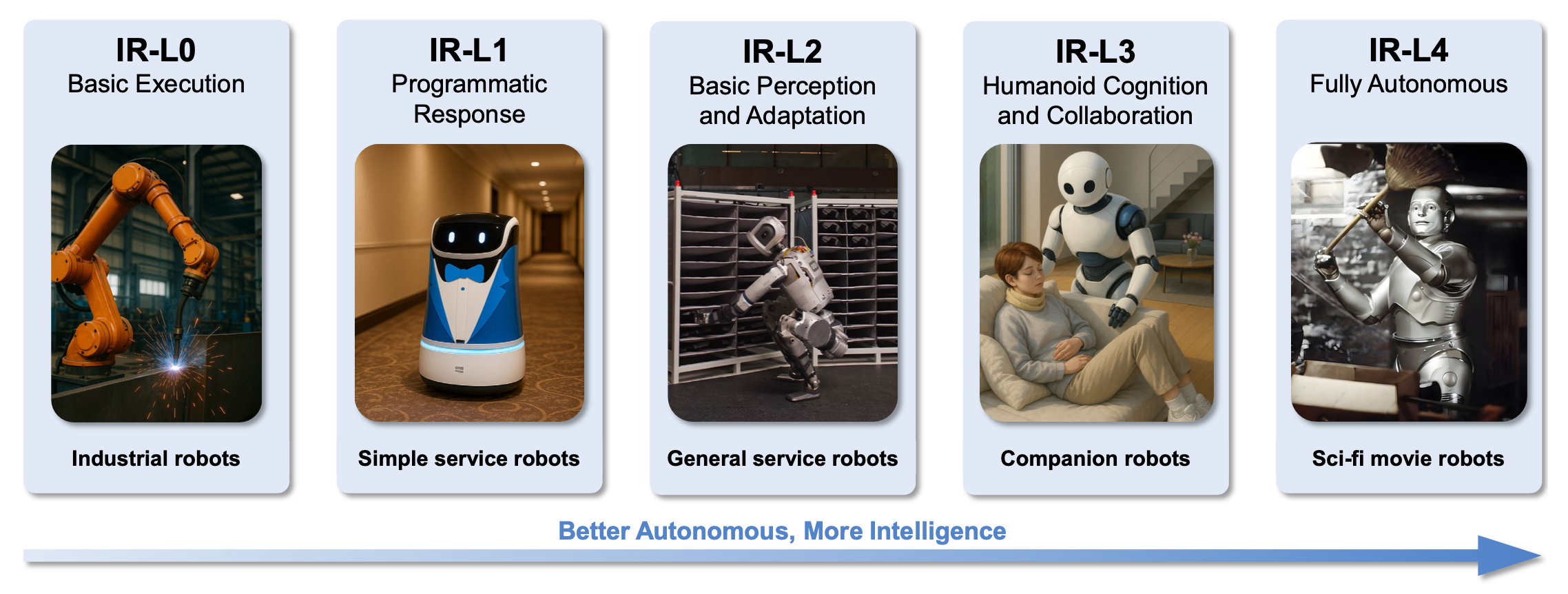

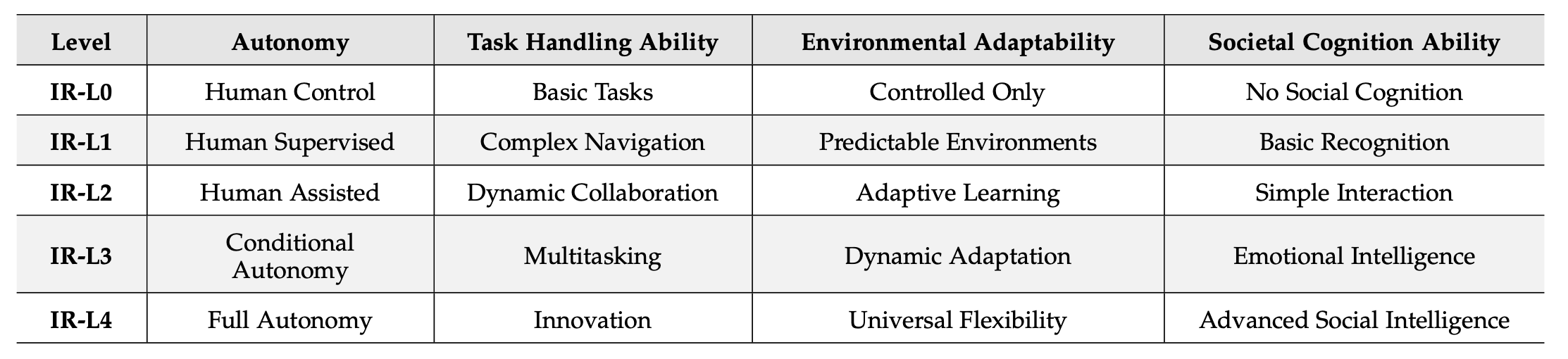

本文提出一个智能机器人能力分级模型,系统地概述了从基本机械执行到高级、完全自主的社会智能共五个递进级别(IR-L0 至 IR-L4)。该分类涵盖了自主性、任务处理能力、环境适应性和社会认知等关键维度,提供了一个统一的框架来评估和指导智能机器人在整个技术演进过程中的发展。

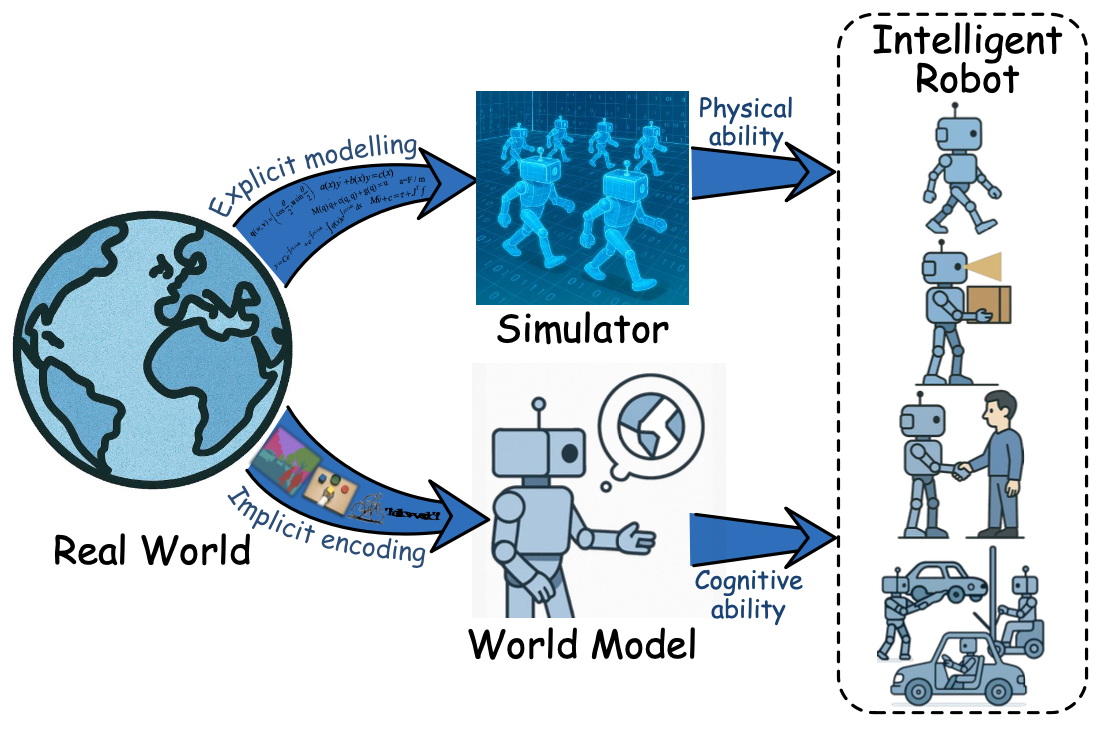

实现机器人智能行为的关键技术是两项关键技术:物理模拟器和世界模型。这两项技术在提升机器人的控制能力和拓展其潜力方面都发挥着至关重要的作用。诸如 Gazebo [15] 或 MuJoCo [16] 之类的模拟器提供了物理世界的明确建模,提供了一个受控环境,机器人可以在部署到真实场景之前在此训练、测试和改进其行为。这些模拟器充当训练场,可以预测、测试和微调机器人的动作,而无需承担真实世界实验的高成本和风险。如图所示:

与模拟器不同,世界模型提供环境的内部表征,使机器人能够在其认知框架内自主模拟、预测和规划动作。根据英伟达 (NVIDIA) 的定义,世界模型是“能够理解现实世界动态(包括物理和空间属性)的生成式人工智能模型”[17]。这一概念因 Ha & Schmidhuber 的开创性研究 [18] 而备受关注,他们展示了智体如何学习紧凑的环境表征以进行内部规划。

模拟器与世界模型之间的协同作用增强了机器人在不同场景中的自主性、适应性和任务执行能力。本文将探讨机器人控制算法、模拟器和世界模型之间的相互作用。通过研究模拟器如何为训练提供结构化的外部环境,以及世界模型如何创建内部表征以实现更具适应性的决策,旨在全面理解这些组件如何协同工作以增强智能机器人的能力。

整个综述的内容结构如图所示:

该分级标准根据机器人在各种环境下执行任务的能力、自主决策的深度、交互复杂性以及伦理认知对机器人进行分类。涵盖以下核心维度:

• 机器人独立完成任务的能力,范围从完全依赖人类控制到完全自主。

• 机器人可处理的任务难度,范围从简单的重复性劳动到创新性的问题解决。

• 机器人在动态或极端环境下工作的能力。

• 机器人理解、互动和响应人类社会中社会情境的能力。

机器人的智能等级基于以下五个因素进行分级,其直观的演进如图所示:

• 自主性:该因素基于机器人在各种任务中自主决策的能力。

• 任务处理能力:该因素基于机器人可执行任务的复杂性。

• 环境适应性:该因素基于机器人在不同环境中的表现。

• 社会认知能力:该因素基于机器人在社交场景中展现的智能水平。

下表列出分级级别与级别因素之间的关系。

机器人技术

全身控制 (WBC)

人形机器人中的全身控制 (WBC) 是一个综合框架,使机器人能够同时协调所有关节和肢体,以实现不同的运动。全身控制的基本方法通常包括将机器人的运动和力目标制定为一组优先任务,例如保持平衡、遵循期望轨迹或用手施加特定的力。然后,这些任务被转化为数学约束和目标,并使用优化技术或分层控制框架进行求解 [32]。

在实施过程中,WBC 通常采用动力学建模、逆运动学求解和优化算法等技术,以确保机器人在满足物理约束的同时实现期望的运动行为。21 世纪初,Oussama Khatib 及其同事提出了用于控制冗余机械手的操作空间公式,后来将其扩展到人形机器人 [33]。基于优化的全身运动控制(WBC)具有很强的灵活性,允许模块化地添加或删除约束,并通过设置不同的任务层次结构或软任务权重来解决冲突的约束 [34]– [36]。近年来,随着强化学习等人工智能的发展,研究者提出了 ExBody2 [37] 和 HugWBC [38] 等框架,在模拟环境中训练控制策略并将其迁移到实际机器人上,实现更自然、更具表现力的全身运动控制。

机器人运动

机器人运动的目标是实现自然的运动模式,包括行走、跑步和跳跃。通过整合感知、规划和控制等多个领域,具有运动能力的机器人可以归类为 IR-L2级别。这种整合使机器人能够动态适应变化的地形、外部干扰和不可预见的事件,从而实现稳健流畅的双足运动。此外,从意外事件中自主恢复的能力减少了对人类干预的依赖,为实现更高的智能和自主性铺平了道路。

腿部运动

双足机器人在复杂地形导航、模拟人类行为以及无缝融入以人为中心的环境方面展现出独特的优势。双足运动控制领域的研究可分为两大类:非结构化环境适应,强调在复杂、未知或动态环境中保持稳定行走的能力;以及高动态运动,侧重于在高速动态运动(例如跑步和跳跃)中实现稳定性与灵活性之间的平衡。

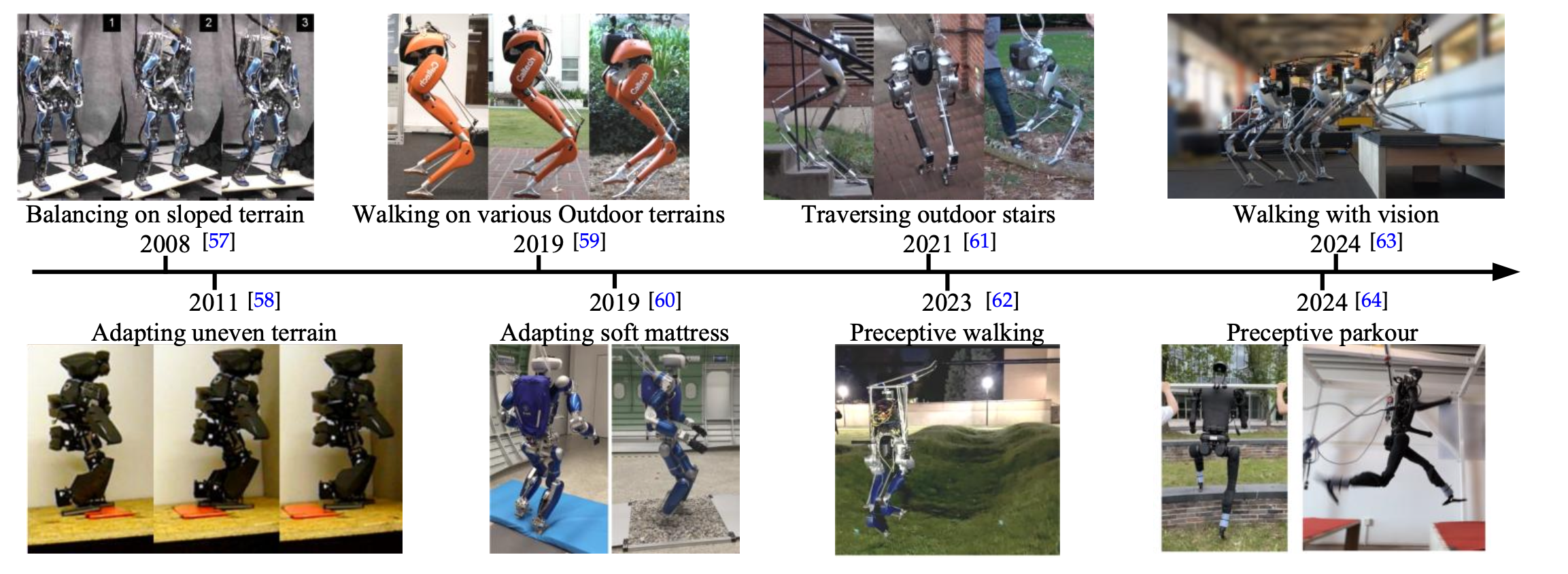

非结构化环境适应。“非结构化环境”通常指复杂的自然或人造地形,例如崎岖的山路、遍布碎石的地面、湿滑的草地、楼梯以及其他不可预测的障碍物。早期双足步行稳定性研究主要采用位置控制的人形机器人。 2008 年,Sang-Ho Hyon [57] 提出了一种基于被动性的接触力控制框架,使 SARCOS 人形机器人 [73] 能够在不同高度和随时间变化倾斜度的室内地形上保持主动平衡。后续进展探索了多种提高运动稳定性的策略,包括地形适应的在线学习 [74]、结合地形估计的柔顺性控制 [58] 以及线性倒立摆模型 (LIPM) 与足部力控制的集成 [75],正如 Kajita 于 2010 年在 HRP-4C 人形机器人上所展示的那样。

如图所示:人形机器人非结构化环境适应域发展的时间表。

上述方法仅使人形机器人具有有限的地形适应性,例如在细梁、人行道或平坦但倾斜的坡道上行走。这是由于位置控制机器人关节的传动比较高。这些关节阻抗较高,在输出轴或末端执行器(手和脚)受到较大冲击时很容易造成损坏 [76]。为了在未知环境中获得更好的适应性,现代人形机器人和四足机器人使用低齿轮比的力控关节,在较大冲击下提供更好的柔顺性和更平稳的响应 [77],[78]。随着力控人形机器人的发展和计算能力的提高,研究人员能够开发和实现更复杂的控制算法 [85]。这进一步增强了机器人对不同环境的适应性。Jacob Reher [59] 提出了一种全面的全身动态控制器,明确考虑 Cassie 双足机器人中的被动弹簧机构。他们的方法成功地实现在各种地形(包括室外草地)上稳定的双足行走。George Mesesan [60] 将发散运动分量 (DCM) 与基于被动性的全身控制器 (WBC) 相结合,用于质心轨迹规划,并计算关节扭矩。其演示了 TORO 机器人在柔软健身垫上的动态行走。

除了本体感受盲走之外,研究人员还探索了整合外部感受感知和路径规划模块,以应对更复杂的环境。Jiunn-Kai Huang [62] 将低频路径规划器与高频反应控制器相结合,可生成平滑的、反馈驱动的运动指令。这使得 Cassie Blue 机器人能够自主穿越更复杂的地形,例如密歇根大学的 Wave Field。

基于学习的方法在户外复杂环境下也表现出良好的稳定性。2020 年,Joonho Lee [86] 首次成功展示了强化学习在现实世界中应用于腿部运动,其在户外环境中的表现优于传统方法 [87]。 Jonah Siekmann [61] 利用 Cassie 机器人实现盲爬楼梯。他们使用域随机化方法来改变楼梯尺寸和机器人动力学,从而使学习的策略能够成功迁移到实际场景中。研究人员还利用深度摄像头和激光雷达构建高度图 [63]、感知内模型 (PIM) [88] 或端到端策略 [64],显著提高了机器人在不同地形上的机动性。现在,机器人可以爬楼梯、越过障碍,甚至跳过宽度达 0.8 米的缝隙。

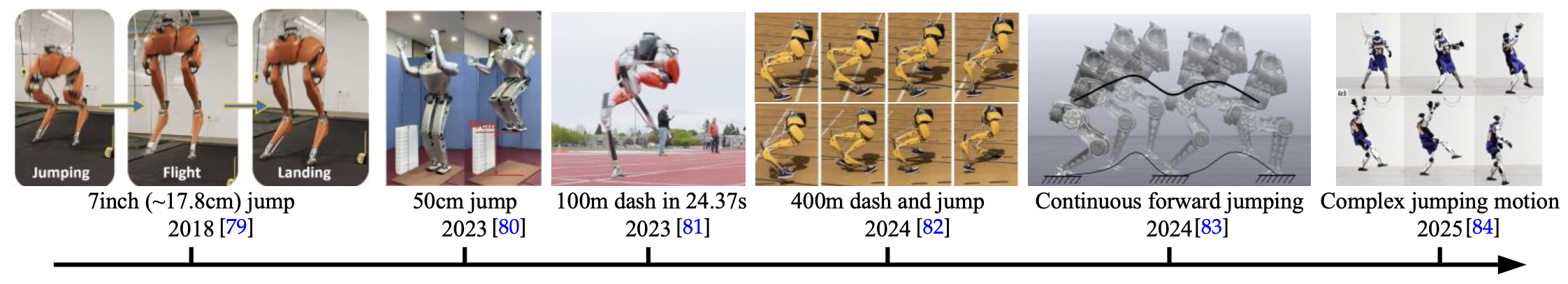

高动态运动。跑步和跳跃等高动态运动对双足机器人的控制系统提出了更高的要求。在快速运动过程中,机器人必须在很短的时间内完成快速的支撑转换、姿态调整和精确的力控制。如图所示:人形机器人高动态运动发展的时间表。

早期研究采用了简化的动力学模型,例如弹簧加载倒立摆 (SLIP) [89]、线性倒立摆模型 (LIPM) [90] 和单刚体模型 (SRBM) [91],以降低计算复杂度并实现实时控制。Xiaobin Xiong & Aaron D. Ames 开发了一种简化的弹簧质量模型,该模型通过基于控制李亚普诺夫函数的二次规划 (CLF-QP) [79] 进行控制,并成功使 Cassie 机器人实现了 18 厘米的垂直跳跃。基于 LIPM ,Qi [80] 提出一种压力中心 (CoP) 制导角动量控制器,通过在飞行过程中稳定角动量,实现高达 0.5 米的垂直跳跃。最近,He [83] 提出一种质心动力学模型 (CDM) 与 MPC 框架相结合,称为 CDM-MPC,用于在 KUAVO 人形机器人上实现连续跳跃运动。

基于 RL 的方法也已应用于动态任务。学习的隐式机器人动力学在跑步 [81]、跳跃 [82] 和在离散地形上跑酷 [92] 等活动中表现出良好的效果,显著拓展了双足运动的能力。

从头开始训练高动态运动通常需要繁琐的奖励函数设计和参数调整。模仿学习利用大量的人类运动数据集 [93],已被用来实现富有表现力和动态的机器人行为。对抗性运动先验 (AMP) [94] 从动作捕捉数据中获得基于风格的奖励,增强了机器人运动的自然度。Exbody [37]、[95]、OmniH2O [96] 和 ASAP [84] 等框架实现了自然敏捷的全身运动。ASAP 专门解决了模拟与现实之间的差距,实现了像后仰跳投这样复杂的动作。

跌倒保护与恢复

人形机器人容易失稳和跌倒,这可能导致硬件损坏或运行中断。因此,人形机器人的跌倒保护以及跌倒后高效恢复站立姿势已成为人形机器人领域的主要研究课题。

基于模型的方法。早期基于模型的人形机器人跌倒保护与恢复控制主要借鉴生物力学,模拟人类跌倒过程的生物力学特征,并结合优化控制方法,生成能够减少跌倒损伤并实现稳定站立恢复的运动轨迹。

UKEMI [97] 控制机器人跌倒时的姿势,以分散冲击力并减少关键部件的损坏。他们还设计了特定的关节运动模式和控制策略,以实现机器人跌倒恢复 [98]。Meng [99] 通过对人体跌倒的生物力学分析,提出了一种跌倒运动控制方法,实现了适应不同跌倒方向的冲击保护控制。Dong [100] 提出了一种柔性控制框架,使机器人能够根据外部干扰调整其刚度和阻尼特性,类似于人类调节肌肉刚度以保持平衡的方式。

基于学习的方法。基于学习的方法对高精度模型不敏感,且具有强大的泛化能力,可以更好地解决这一任务。HiFAR [102] 通过一种逐步增加场景难度的多阶段课程学习方法训练人形机器人从跌倒中恢复,并在真实机器人的各种场景中取得了很高的跌倒恢复成功率。HoST [101] 通过平滑正则化和隐式动作速度限制,使 Unitree G1 机器人能够在各种环境下做出稳健自然的站立动作。Embrace Collisions [103] 扩展了机器人通过全身接触与环境交互的能力,而不仅仅局限于手脚。该方法通过模仿人类的翻滚站立、侧卧等多接触行为,扩展了人形机器人在现实场景中的运动范围和适应性。

机器人操作

单手操作任务

单手操作是指使用单个末端执行器与物体交互并进行操作,例如平行夹持器或灵巧的机械手。此类任务涵盖从基本的拾取和放置操作到更复杂的动作,例如推动、插入、使用工具以及操作可变形或铰接的物体。这些任务的复杂性取决于末端执行器的功能及其与之交互的环境。

基于夹持器的操作。平行双指夹持器 [104] 是最常见的末端执行器,用于执行抓取、放置和使用工具等操作任务,依赖于简单的开合动作。早期研究侧重于精确的物理模型和预编程 [105],这些方法在结构化环境中有效,例如具有预定轨迹的工业自动化或用于反馈的视觉伺服 [106]。这些方法在非结构化环境中的适应性、物体多样性以及复杂的交互(例如摩擦、变形)方面存在困难。

基于学习的方法克服了这些局限性。在感知领域,PoseCNN [107] 实现了实例级 6D 姿态估计,而 NOCS [108] 则推进了类别级估计以实现泛化。功能 affordance 学习取得了进展,如 AffordanceNet [109] 通过监督学习识别可操作区域,Where2Act [110] 则利用自监督模拟交互。模仿学习也得到了发展,神经描述子场 (NDF) [111] 增强了策略泛化能力,扩散策略 [3] 利用扩散模型实现多模态动作,RT-2 [112] 则集成了基础模型来解释复杂的指令。

随着这些进步,面向任务的操作得到了扩展。除了基本的抓取 [3] 之外,机器人还能通过防撞技术(例如 CollisionNet [113] 和 PerAct [114])处理杂乱环境,操纵可变形体和铰接体 [115]–[118],并执行双手协调 [49]、灵巧手操作 [54] 和全身控制 [119]。这种发展突显了基于夹持器的操作在执行各种复杂任务方面日益增强的能力。

灵巧手操作。灵巧操作旨在使机器人能够以类似于人手的复杂、精确的方式与物理世界交互,这是机器人技术几十年来的核心挑战 [120]。该领域力求实现类似人类的多功能性和精确性,以解决需要复杂控制和适应性的任务。

灵巧操作的早期工作集中在硬件设计和理论基础上。犹他/麻省理工学院的“Hand”[121]和“Shadow Hand”[122]等先驱设计探索了高自由度和仿生结构(例如,肌腱驱动机构),而 BarrettHand [123]则展示了用于自适应抓取的欠驱动设计。同时,Napier 对人类抓取模式进行分类的理论贡献[124],以及Salisbury和Craig对多指力控制和运动学进行分析的理论贡献[125],为未来的研究奠定了基础。传统的基于模型的控制方法难以处理高维状态空间和复杂的接触问题。

两-阶段方法首先生成抓取姿势,然后控制灵巧手实现这些姿势。关键挑战在于如何从视觉观测中生成高质量的姿势,这可以通过基于优化的[126]–[128]、基于回归的[129]、[130]或基于生成的[131]–[140]策略来解决,这些策略通常与运动规划结合使用。例如,UGG [136]使用扩散模型来统一姿势和物体几何的生成,而SpringGrasp [141]则通过对部分观测中的不确定性进行建模来提升姿势质量。虽然这些方法受益于感知与控制以及模拟数据的解耦,但由于缺乏闭环反馈,它们仍然对扰动和校准误差敏感。

端到端方法使用强化学习或模仿学习直接建模抓取轨迹。强化学习在模拟中训练策略以实现现实世界的迁移 [142]–[144],例如 DexVIP [145] 和 GRAFF [146] 将视觉可供性线索与强化学习相结合。DextrAH-G [147] 和 DextrAH-RGB [148] 通过大规模模拟实现了现实世界的泛化,尽管模拟与现实的差距和样本效率带来了挑战。由人类示范驱动的模仿学习 [54]、[146]、[149] 在复杂任务中表现出色,但在泛化方面却举步维艰。SparseDFF [150] 和神经注意场 (NAF)[151] 等创新技术利用三维特征场增强了泛化能力,而 DexGraspVLA [152] 则采用了视觉-语言-动作框架:将预训练的视觉-语言模型与基于扩散的动作控制器相结合。在零样本设置中,它对 1,287 个看不见的物体、灯光和背景组合实现了 90.8% 的成功率。

双手操作任务

双手操作是指需要协调使用双臂的机器人任务,使机器人能够执行复杂的操作,例如协作运输、精确装配以及搬运柔性或可变形体[155]。与单臂操作相比,这些双手操作任务本身就面临着更大的挑战,包括高维状态-动作空间、手臂间和环境碰撞的可能性,以及有效的双手协调和动态角色分配的必要性。

该领域的早期研究通过引入归纳偏差或结构分解来简化学习和控制,从而解决了这些挑战。例如,BUDS [156] 将双手操作任务分解为稳定器和执行器功能角色,这不仅降低双臂动作空间的复杂性,还实现了手臂之间的有效协作。该框架在切蔬菜、拉拉链和盖上记号笔等任务上表现出了稳健的性能。与此同时,SIMPLe [157] 利用图高斯过程 (GGP) 来表示双手操作的运动基元,确保轨迹稳定性,并使系统能够借助运动反馈从单臂演示中学习双臂协调。

随着大规模数据收集和模仿学习的进步,端到端方法在双手操作研究中日益突出。ALOHA 系列 [49]、[153]、[158] 体现了这一趋势,它利用现成的硬件和定制的 3D 打印组件,高效收集用于高精度双手任务的多样化、大规模演示数据。这些数据集促进了具有强大泛化能力的端到端神经网络的训练。具体来说,ACT [49] 将动作分块与条件变分自编码器 (CVAE) 框架相结合,使机器人能够从短短 10 分钟的演示数据中学习有效策略,并在诸如插入电池和打开杯盖等具有挑战性的任务中实现高成功率。在此基础上,Mobile ALOHA [153] 引入了移动基座,进一步简化了 ACT 流程,从而能够高效完成移动双手任务。此外,RDT-1B [50] 提出了一种基于扩散 DiT 架构的双手操作基础模型,统一了异构多机器人系统中的动作表示。这种方法通过实现对新任务和平台的零样本泛化来解决数据稀缺问题。虽然这些研究显著推动了双手操作领域的发展,但它们主要关注的是配备平行爪夹持器的系统。相比之下,使用灵巧机械手进行双手操作则带来了额外的挑战,尤其是在细粒度协调和高维控制方面。最近,一些研究 [140]、[159]、[160] 探索了基于强化学习的方法,将人类的双手操作技能迁移到机械灵巧手,从而实现更复杂的操作能力。

总而言之,双手操作研究已经从依赖于强任务特定先验和结构简化的方法发展到利用大规模演示的数据驱动、端到端框架。这些进展显著提高了双手机器人系统的鲁棒性、通用性和多功能性,使其能够应对日益多样化的复杂操作任务。此外,正在进行的旨在将这些方法应用于灵巧机械手的研究正在扩展双手操作的能力,使机器人能够执行日益复杂且更像人类的任务。

全身操作控制

全身操作是指人形机器人运用其整个身体(包括双臂[155]、躯干[161]、轮式或腿式基座[162]以及/或者其他部件[163])与物体进行交互和操控的能力。

近年来,基于学习的人形机器人全身操控技术取得了显著进展,重点是增强机器人的自主性、适应性和在复杂环境中的交互能力。其中的一个趋势是利用大型预训练模型(例如LLM、VLM和生成模型)来增强语义理解和泛化能力。例如,TidyBot [164] 利用LLM的归纳能力,从少量示例中学习个性化的家居整理形式。MOO [165] 通过VLM将物体描述从语言指令映射到视觉观察,实现了对未知物体类别的零样本操作泛化。 HARMON [166] 将人体运动生成先验与 VLM 编辑相结合,通过自然语言生成多样且富有表现力的类人动作。

视觉演示也能指导学习操作技能。OKAMI [167] 提出了一种物体-觉察重定向方法,使类人机器人能够模仿单个人类 RGB-D 视频中的技能,并适应不同的物体布局。iDP3 [168] 通过改进的 3D 扩散策略,实现了从单场景遥操作数据训练的多场景任务执行策略。为了实现稳健而灵巧的全身控制,OmniH2O [96] 采用强化学习 Sim-to-Real 方法,训练协调运动和操作的全身控制策略,并设计了一个兼容 VR 遥操作和自主智体的通用运动学接口。 HumanPlus [6] 系统将基于 Transformer 的低级控制策略与视觉模仿策略相结合,仅使用单目 RGB 摄像头即可实现人形机器人的全身动作演示和复杂技能的自主学习。该系统可以学习现实世界中的全身操控和运动技能,例如穿鞋、站立和行走。WB-VIMA [119] 通过自回归动作去噪,对全身动作的层次结构以及特定人形机器人形态内各组件之间的相互依赖关系进行建模,预测协调的全身动作,并有效地学习全身操控,以完成具有挑战性的现实世界家务任务。

人形机器人操作中的基础模型

基础模型 (FM) 是指基于互联网规模数据预训练的大规模模型,包括大型语言模型 (LLM)、视觉模型 (VM) 和视觉语言模型 (VLM)。这些模型在语义理解、世界知识集成、逻辑推理、任务规划和跨模态表示方面拥有强大的能力,可直接部署或微调用于各种下游任务。

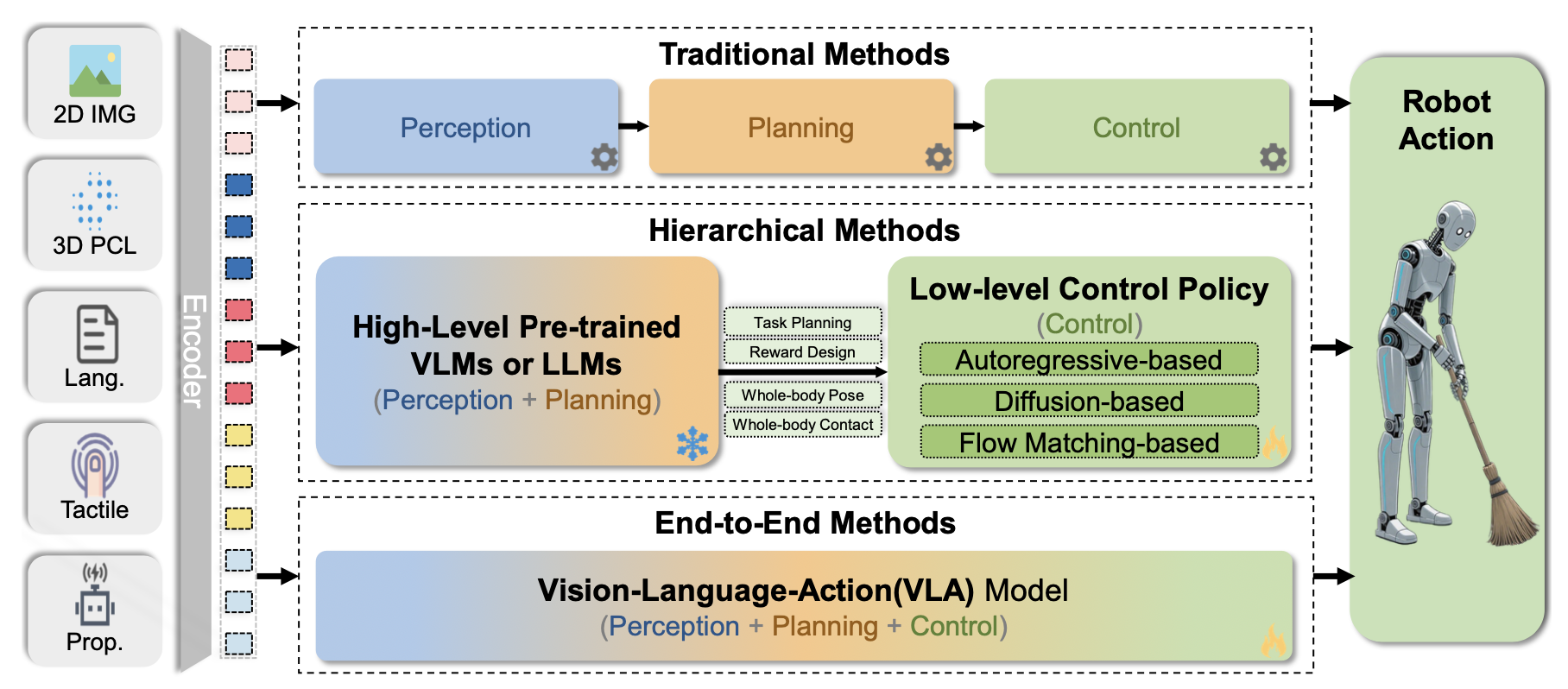

基础模型使人形机器人能够在复杂、动态和非结构化的环境中执行操作任务,通常涉及复杂的环境感知和建模、抽象任务理解以及长序列和多步骤任务的自主规划。如图展示了利用基础模型驱动人形机器人操作的两种主要技术范式。

分层方法利用预训练的语言或视觉语言基础模型作为高级任务规划和推理引擎,以理解用户指令、解析场景信息并将复杂任务分解为一系列子目标。这些高级输出(通常是可操作的知识或图像语言token)随后被传递给低级动作策略(通常是通过模仿学习或强化学习训练的专家策略),以执行物理交互动作。由于其可扩展性,Transformer 已成为此类低级策略的常见选择。

这种分层架构利用基础模型强大的语义和逻辑推理能力,同时结合低级策略在具体动作执行中的效率,使机器人能够在多任务处理和跨场景泛化方面表现出色 [169]–[173]。这种方法的优势在于其模块化和可解释性,但它也面临着与信息瓶颈和高级与低级之间的语义差距相关的挑战。例如,Figure AI 展示了 Helix,这是一个用于两个人形机器人之间灵巧操作和协作的分层 VLA 模型 [174],而 NVIDIA 开发了 GR00T N1,这是一个用于人形机器人的通用基础模型 [175]。 π0 模型 [176] 将预训练的视觉语言模型与流匹配架构相结合,实现跨各种机器人平台的通用控制,高效执行衣物折叠和物体分类等复杂灵巧任务。

端到端方法将机器人操作数据直接纳入基础模型的训练或微调过程,构建端到端的视觉-语言-动作 (VLA) 模型 [4], [68], [177], [178]。这些模型直接学习从多模态输入(如图像和语言指令)到机器人动作输出的映射。通过对大量机器人交互数据进行预训练或微调,VLA 模型可以在没有显式层次结构的情况下隐式学习任务规划、场景理解和动作生成。这种端到端方法可以针对下游部署任务对模型进行整体优化,从而可能实现卓越的性能和更快的响应时间,但通常需要大量特定于机器人的数据,并且模型可解释性相对较弱。例如,Google DeepMind 的 RT (Robotics Transformer) 系列 [112],[177] 代表了典型的 VLA 操作模型。

人机交互

人机交互 (HRI) 致力于使机器人能够理解并响应人类的需求和情感,促进机器人高效合作、陪伴并提供个性化服务,广泛应用于家庭、医疗保健、教育和娱乐领域 [179]。为了准确地解释和适应人类的各种行为,机器人需要具备类似人类的能力,例如多模态感知、自然语言处理和协调控制。

人机交互的研究可以分为三个主要维度:认知协作、物理可靠性和社会嵌入性。这些维度分别关注机器人如何感知和理解人类的认知模式、协调物理动作以及如何有效地融入人类的社会环境。

以在拥挤环境中导航的机器人为例,认知协作涉及机器人识别行人的潜在紧急程度;物理可靠性体现在机器人调整速度和轨迹以避免碰撞;社会嵌入性体现在机器人主动利用语言提示或肢体语言协商通行权,建立临时社交协议。这些综合能力使机器人能够无缝融入人类的日常活动,提升交互的自然性和效率。

认知协作:理解并契合人类认知

人机交互中的认知协作是指机器人与人类之间双向认知的契合,实现自然直观的沟通与合作。这种协作不仅强调机器人对人类行为的被动响应,更强调深度认知理解和动态自适应,形成类似于人类高效协作的模式。其核心目标是使机器人不仅能够理解人类的显性指令,例如语音命令和手语指令[181],还能理解隐性意图(例如情绪和语境),并动态调整其行为以匹配人类的认知模式和期望。实现这一能力对于提升机器人在复杂场景中的适应性和自然交互体验至关重要。

研究表明,实现认知协作依赖于复杂的认知架构和多模态信息处理能力。例如,Lemaignan [182] 探索机器人认知在社会人机交互中所需的关键技能,包括几何推理、情境评估和多模态对话。机器人需要理解人类意图,并通过这些技能与人类协作完成联合任务 [180]。

此外,多模态意图学习被认为是实现认知协作的关键因素 [183]。例如,整合面部表情和肢体动作来解读口头指令的情绪基调和潜在意图,可以大大减少误解,增强人机交互的自然性 [184]。

同时,认知协作要求机器人对环境和交互情境有深入的语义理解。Laplaza [185] 的研究展示了如何通过对人类行为进行上下文语义分析来推断交互意图。他们提出一种基于动态语义分析的模型,可以实时解析人类动作的潜目标,并结合环境信息进行预测,使机器人能够更准确地协作完成任务。

在无需人类直接参与的交互任务中,认知协作也发挥着重要作用。例如,在家庭服务机器人场景中,机器人可以通过对环境的语义理解来解决面向目标的导航任务。这项任务要求机器人在未知环境中定位特定的目标物体(如杯子、沙发或电视)或指定区域(如卧室和浴室)。L3mvn [186]、Sg-Nav [187]、Trihelper [188]、CogNav [189] 和 UniGoal [190] 等研究通过利用大语言模型 (LLM) 模拟人类的各种认知状态(如广泛搜索和上下文搜索),提高了机器人在面向目标的导航任务中的表现。

总而言之,人机交互中认知协作的进步依赖于跨学科的努力,涵盖认知科学、语义理解以及涉及语言、视觉和音频感知的大型多模态模型的开发。随着认知协作能力的不断提升,机器人将越来越擅长于支持现实场景中的各种任务。

物理可靠性:物理动作的协调与安全性

人机交互中的物理可靠性是指人与机器人之间力、时间和距离的有效协调,以确保安全、高效且与人类兼容的任务执行。其核心目标是使机器人能够动态响应人类动作的实时变化,包括调整运动策略、避免物理冲突,并确保交互过程中的人类安全。为此,研究主要集中在两个方向:物理交互的实时控制和基于仿真平台的大规模生成数据集构建。

尽管当前的研究取得了令人鼓舞的进展,但确保人机交互的物理可靠性仍然面临着诸如计算成本高、在复杂场景下鲁棒性有限等挑战。未来需要探索开发更高效的算法并增强其适应性,从而在多样化和动态的环境中实现可靠的人机交互。

社会嵌入性:与社会规则和文化规范的融合

人机交互中的社会嵌入性是指机器人识别和适应社会规范、文化期望和群体动态的能力,从而能够无缝融入人类环境。这不仅局限于完成任务,还包括谈判、礼仪和情感表达等行为。如图所示,机器人正在与人类伙伴进行谈判。为了促进机器人无缝融入社交场景,近期研究探索了一系列策略,旨在解决社会空间理解和行为理解问题。这两个互补的方面对于在人机交互中实现有效的社会嵌入至关重要。

尽管取得了这些进步,但稳健的社会嵌入仍然充满挑战。机器人必须精准地平衡任务效率和社会适应性,这需要提升多模态感知、长期适应能力,并将社会知识融入决策制定。

当前智能机器人的数据采集仍然面临以下挑战:1)成本和安全问题:基于遥操作 [55]、[153] 或通用操作界面 (UMI) [238] 的数据采集策略对硬件提出了要求,并要求操作员具备一定的熟练程度,这给数据采集过程带来了财务问题。此外,物理实验还引发了与危险场景或机器人动作有关的安全问题。2)控制和可重复性问题:数据采集过程受光照、背景和传感器噪声等多种因素的影响,这些因素会影响数据质量。

为了控制所有这些因素,必须精心设计采集场景。此外,由于场景无法完全控制,因此重复使用相同设置进行验证的实验变得具有挑战性。

为了解决上述瓶颈问题,模拟-到-现实 (Sim2Real) 的传输已成为克服数据限制的关键方法。该范式构建高保真虚拟环境以生成多模态合成数据,具有以下几个关键优势:1)显著提高数据生成效率:在模拟器中使用 GPU 加速物理引擎和分布式渲染可以快速生成大量模拟数据,从而使数据收集过程既经济高效又安全;2)自动注释和可控语义标记:模拟器可以直接输出像素级真值,包括语义分割图、深度图和 6D 目标姿势,从而可以精确控制模拟环境。此外,模拟器还为调试、验证和优化机器人感知、控制和规划算法提供了高效、安全和可重复的试验场,增强了它们在实际部署期间的鲁棒性和可靠性。

主流模拟器

随着机器人技术、强化学习和逼真度仿真的日益融合,对可扩展的 GPU 加速仿真平台的需求激增。NVIDIA Isaac 系列通过为机器人技术开发和具身化 AI 研究建立闭环技术生态系统来满足这一需求。它的演变反映了从孤立的加速工具到全面的全栈仿真基础架构的转变。Isaac Gym [242] 于 2021 年推出,通过同时并行训练数千个环境,开创了大规模 GPU 加速物理模拟的先河。它基于 NVIDIA 的 PhysX 引擎构建,显著提高了运动控制和足式机器人策略学习等任务的采样效率。然而,由于缺乏光线追踪支持,Isaac Gym 在渲染保真度方面受到限制,并且不提供流体或激光雷达模拟功能。

随后,NVIDIA 推出了集成 Omniverse 平台 [244] 的 Isaac Sim [243],这是一款基于 Omniverse 构建的功能齐全的数字孪生模拟器。它集成了 PhysX 5 物理引擎和基于 RTX 的实时光线追踪,可实现毫米级精度的高保真激光雷达 (LiDAR) 模拟。通过采用 USD(通用场景描述)[245] 标准,Isaac Sim 支持对多模态传感器(包括 RGB-D 摄像头和 IMU)进行物理精确模拟。2025 年发布的 Isaac Sim 5.0 进一步改进了刚体动量守恒,增加了关节可视化工具,并引入了模拟数据分析模块,使机械臂抓取精度达到 0.1 毫米以内。Isaac Lab [246] 是一个基于 Isaac Sim 构建的模块化强化学习框架,旨在简化和优化机器人学习流程。它采用平铺渲染技术高效处理多摄像头输入,将训练吞吐量提高约 1.2 倍。Isaac Lab 同时支持模仿学习和强化学习范式,能够从 HDF5 格式的演示数据集快速构建策略。Isaac Gym 的并行计算能力现已深度集成到 Isaac Sim 的底层架构中。Isaac Lab 基于 Isaac Sim 构建,采用模块化设计将模拟环境抽象为可配置的任务单元。这个不断发展的软件堆栈正在朝着支持异构物理引擎(包括刚体和软体动力学)、模拟-到-现实的迁移和生成式 AI 驱动的场景合成(例如 Cosmos 世界模型)的方向发展,从而为具身智能研究提供统一的基础架构——从低级物理到高级行为学习。然而,它继承了 Isaac Sim 的高硬件要求,这可能会限制资源受限用户的可访问性。 Isaac Sim 和 Isaac Lab 均已发布早期开发者预览版,预计将逐步开源。

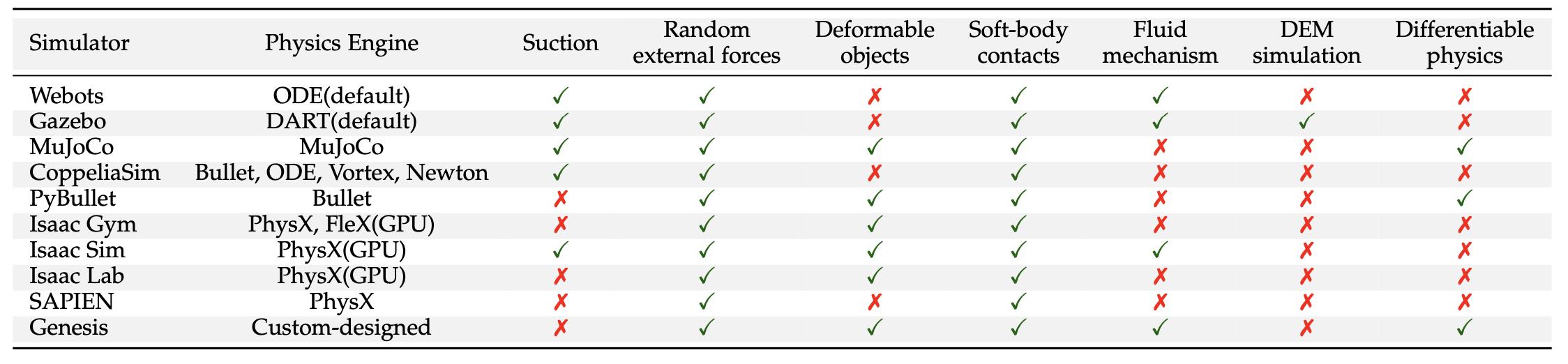

模拟器的物理特性

智能机器人需要在复杂动态的环境中执行类似人类的行为,例如抓取、行走和协作。在此背景下,模拟器的物理建模能力直接决定了生成数据的真实度和策略迁移的有效性。高保真物理特性模拟不仅可以增强环境交互的真实度(例如,软体变形、流体动力学引起的质心偏移),还可以通过引入随机扰动来防止策略过拟合模拟环境,从而提高算法的泛化能力。这反过来又拓宽了人形机器人算法在更广泛场景中的适用性。按照[21]中的分类,选择对人形机器人和世界模型尤为重要的物理属性,并比较不同的模拟器如何支持这些属性。下表总结不同模拟器对各类物理模拟的支持。

渲染能力

仿真渲染能力在现代机器人研发中至关重要。它们不仅为研究人员提供了高效的虚拟实验环境,还能确保机器人的外观和行为更加逼真,预测也更加准确。高保真渲染在缩小仿真-到-现实 (sim-to-real) 之间的差距方面发挥着至关重要的作用。这对于机器人开发的各个阶段(包括设计、验证和优化)都至关重要,并且能够显著提升感知、控制和同步定位与地图构建 (SLAM) 算法在实际部署过程中的鲁棒性和可靠性。

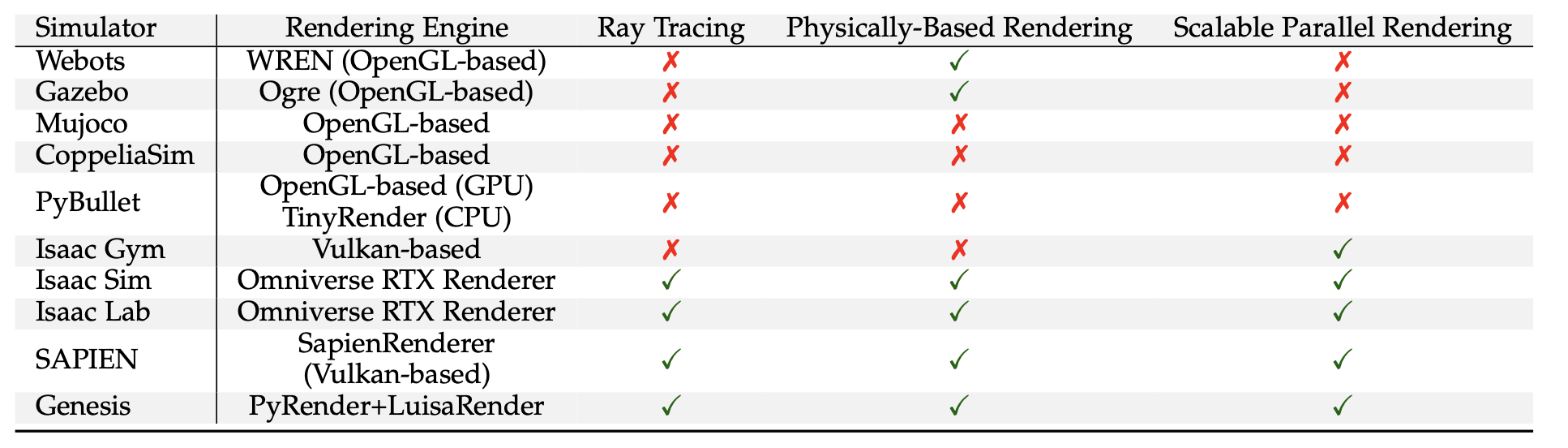

对上述模拟器的渲染能力进行比较分析,重点关注四个关键技术方面:底层渲染引擎、光线追踪支持、基于物理的渲染 (PBR) 实现以及并行渲染能力。结果如表所示。

传感器和关节组件类型

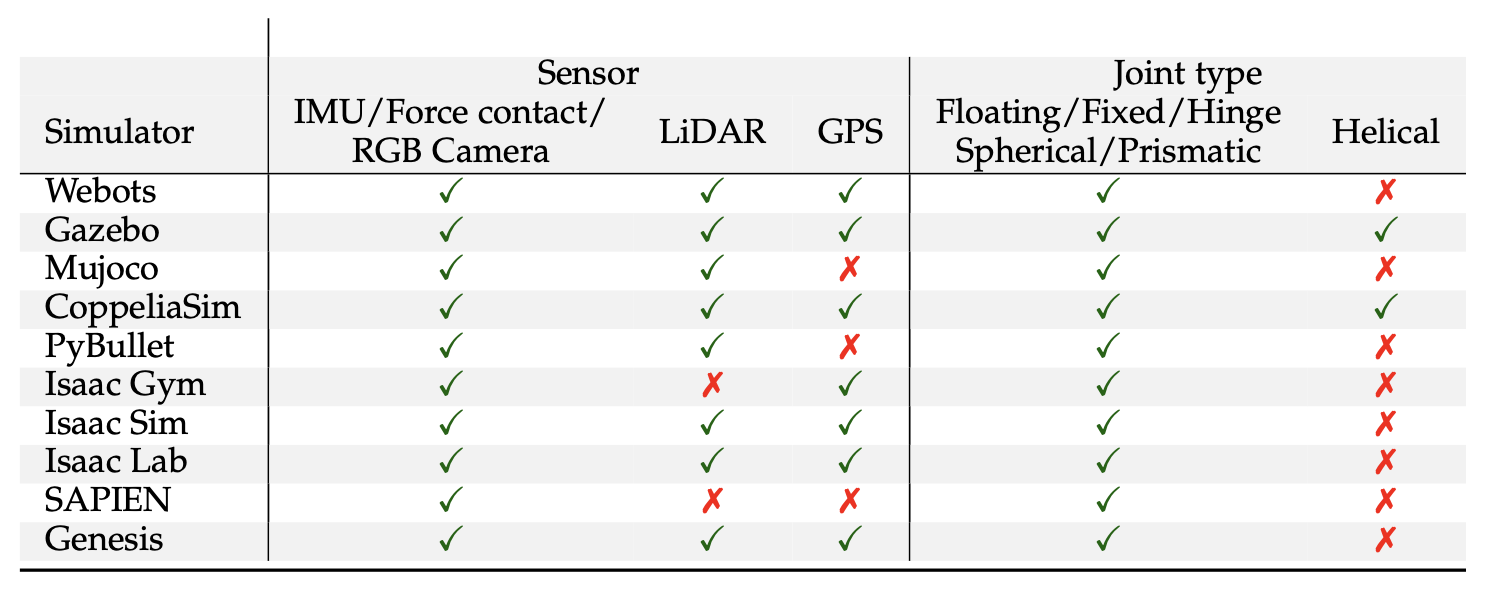

传感器是机器人感知的重要组成部分,通过捕获视觉、力和惯性等多模态信息,为运动控制和环境理解奠定基础。在仿真平台中,真实可靠的传感器模型为机器人感知算法的调试、验证和数据收集提供了高效、安全且可重复的测试基础。我们调查了主流仿真平台对各种传感器的支持情况。具体而言,考虑的传感器包括惯性测量单元 (IMU)、力接触、RGB 摄像头、激光雷达和 GPS。

如表所示,大多数主流仿真平台都为常用传感器提供标准支持,包括视觉 (RGB)、IMU 和接触力传感。例如,Isaac Sim 和 Isaac Lab 提供全面的高保真传感器仿真。Isaac Gym 支持 IMU 状态和接触信息输出,但其视觉功能在运行效率和并行处理方面相对有限。在实践中,它通常与 Isaac Sim 或 Omniverse 结合使用,以实现高质量的视觉感知和处理。Genesis 提供全面的多模态传感器支持,使其适用于复杂的感知任务。除此之外,不同平台对其他传感器的支持也存在差异。具体而言,Isaac Gym 和 SAPIEN 不提供对 LiDAR 传感器的原生支持,而 MuJoCo、PyBullet 和 SAPIEN 则缺乏对 GPS 的支持。

除了传感器建模之外,准确模拟各种关节类型(例如浮动关节、铰链关节、球形关节、棱柱关节、固定关节和螺旋关节)对于在仿真平台中重现机器人的结构和运动特性至关重要。这些关节的组合决定了机器人的自由度 (DOF) 和灵活性,进而影响其在复杂任务中的表现。通过在仿真中对这些关节进行精确建模,开发人员可以在虚拟环境中测试和优化机器人设计和控制策略,从而提高系统性能和可靠性。

模拟器具备诸多关键优势,使其在研究和实际应用中极具价值:

成本效益:通过减少或消除物理实验的需求,模拟器可以显著降低测试和开发相关的财务负担。

安全性:它们能够模拟危险场景(例如核反应堆故障或极端天气条件),而不会带来实际风险。

控制性:模拟器能够精确控制变量和实验条件,使研究人员能够分离特定因素并研究其影响。

可重复性:在模拟器中进行的实验可以精确重复,确保一致性并便于结果验证。

然而,模拟器并非没有挑战,这些局限性往往会限制其有效性:

准确性:模拟器可能无法完全捕捉现实世界系统的复杂性,导致其预测不准确。模型设计过程中的简化或近似可能会导致模拟结果与实际结果之间的差异。

复杂性:现实世界系统通常非常复杂,包含众多相互作用的组件和变量。创建一个能够准确反映这种复杂性的模拟器需要耗费大量的计算资源,在某些情况下甚至不可行。

数据依赖性:有效的模拟器通常需要大量高质量的数据来校准和验证其模型。在数据稀缺或难以获取的情况下,模拟器的性能可能会受到严重影响。

过拟合:模拟器可能会过度适应特定场景或数据集,从而降低其泛化到新情况或未知条件的能力。这限制了它们在动态或不断发展的环境中的应用。

准确性、复杂性和数据依赖性的局限性凸显了对更复杂、适应性更强的建模框架需求。这推动了世界模型的发展,旨在提供一种更全面、更灵活的方法来理解和预测现实世界的动态。与传统的模拟器不同,世界模型利用机器学习和人工智能的进步来创建能够适应新数据、更高效地处理复杂系统并减少对海量数据集依赖的表征。因此,世界模型的研究代表人们追求更稳健、更通用的现实世界现象建模工具的自然演变。

。。。。。。待续。。。。。。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献203条内容

已为社区贡献203条内容

所有评论(0)