推荐系统 理论笔记 四(机器学习基础—线性回归)

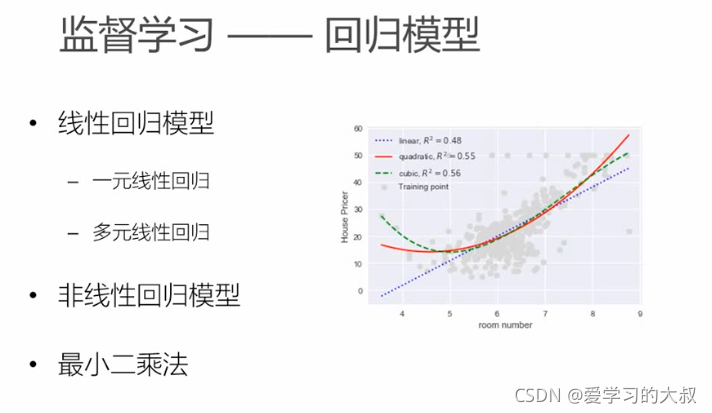

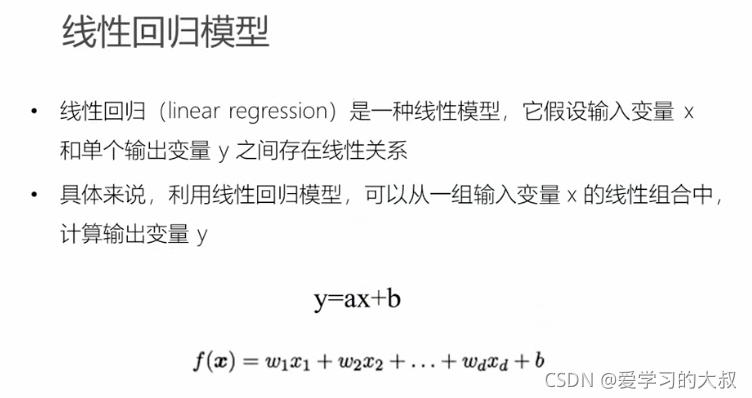

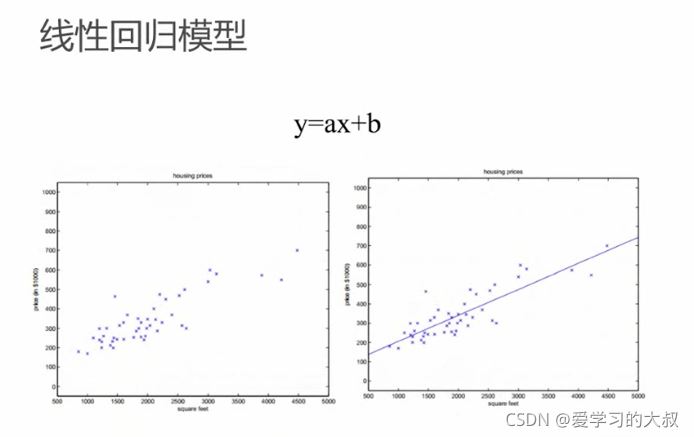

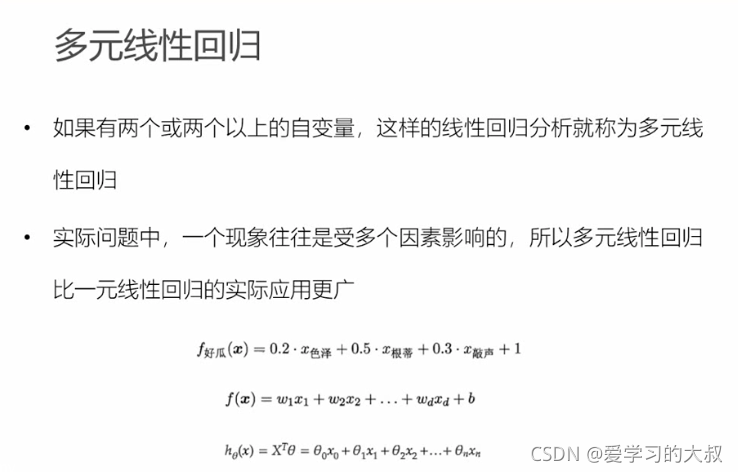

f(x)=w1x1+w2x2,是三维空间的一条直线。MSE均方误差(平方求和再平均)。最小二乘(least square mehtod)。英文是最小平方的方法。就是求误差平方的最小值问题。注意,因为是线性回归模型,而且损失函数是凸函数,所以可以通过将损失函数求导,2阶凸函数的导数为0的点,就是最小值点。w**2是正数,就是一饿抛物线。开口向上。为什么多元线性回归不用最小二乘法,因为那样的话,计算的

·

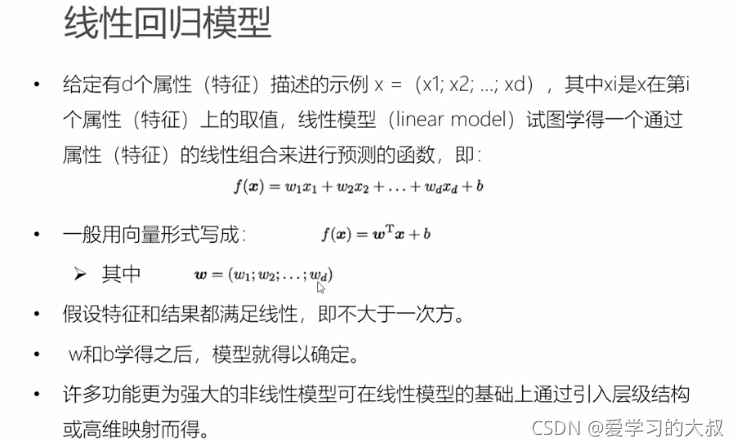

f(x)=w1x1+w2x2,是三维空间的一条直线。

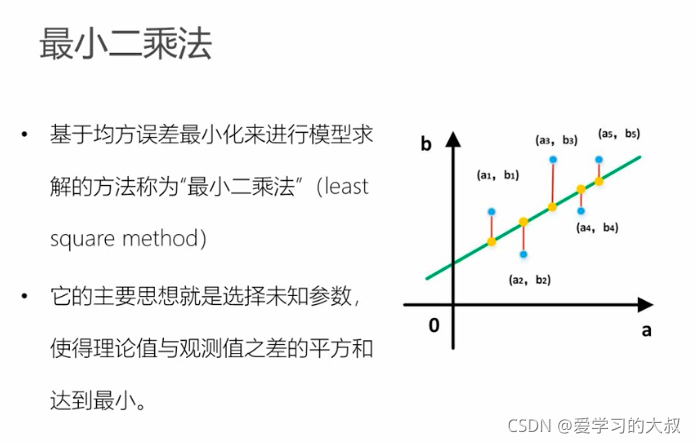

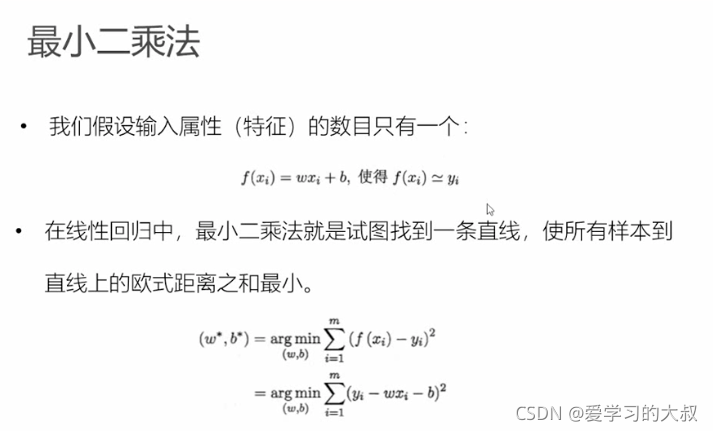

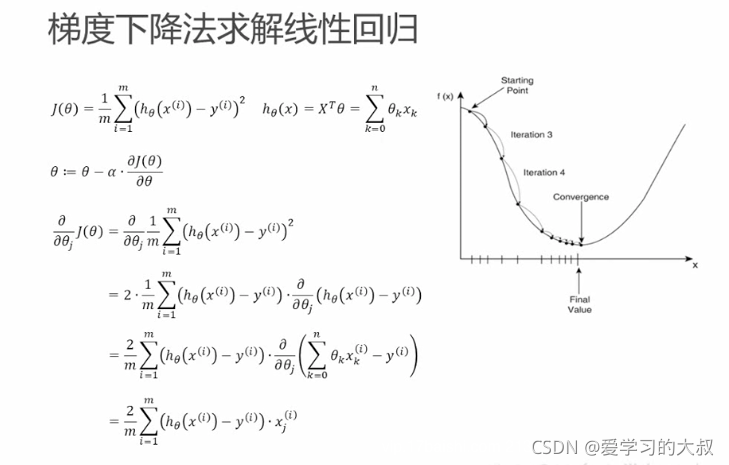

MSE均方误差(平方求和再平均)。最小二乘(least square mehtod)。英文是最小平方的方法。就是求误差平方的最小值问题。

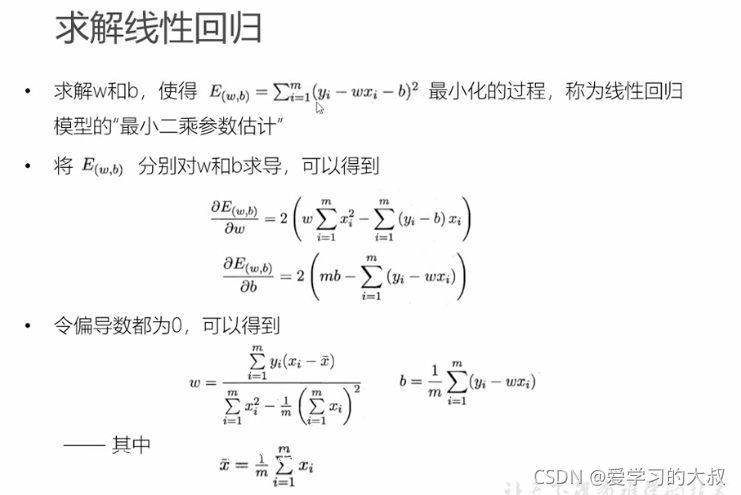

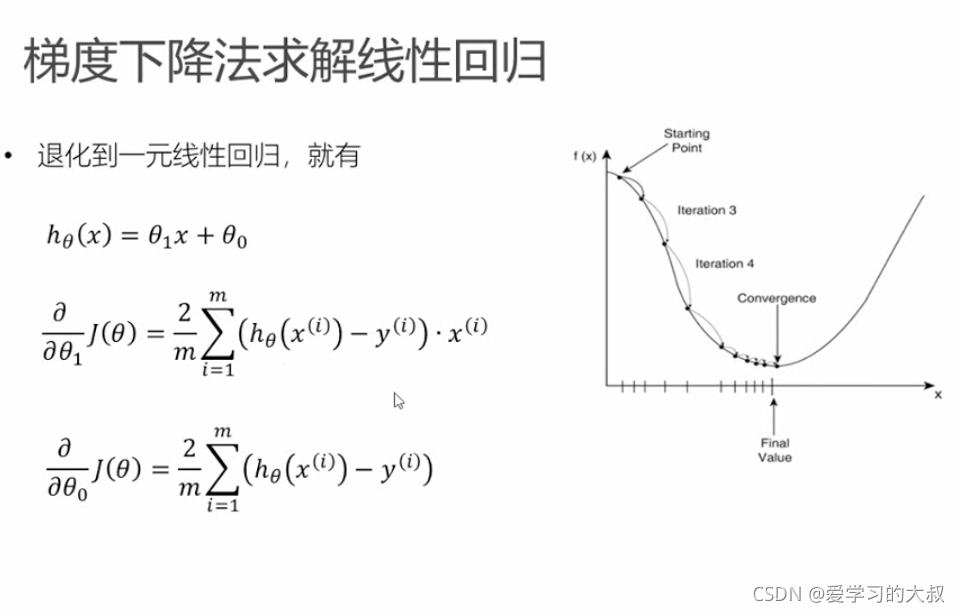

注意,因为是线性回归模型,而且损失函数是凸函数,所以可以通过将损失函数求导,2阶凸函数的导数为0的点,就是最小值点。w**2是正数,就是一饿抛物线。开口向上。

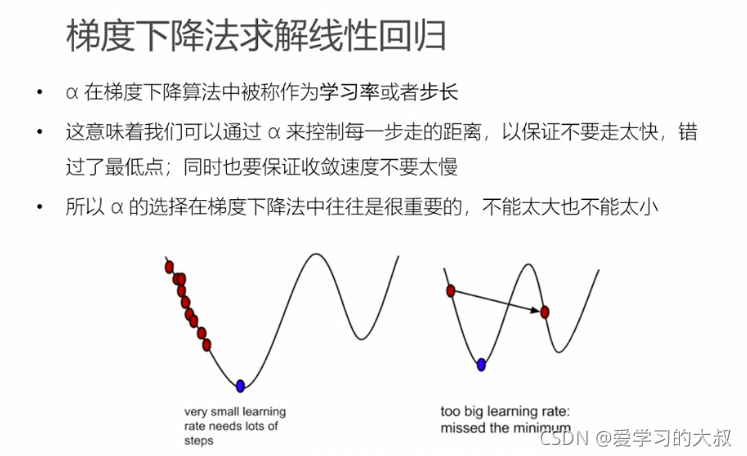

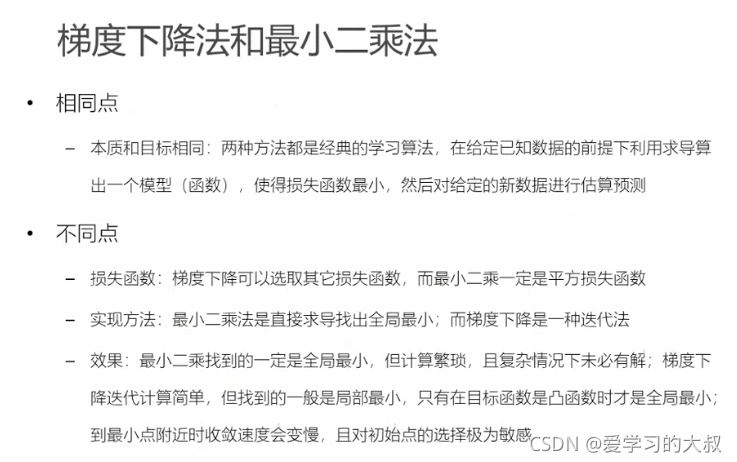

为什么多元线性回归不用最小二乘法,因为那样的话,计算的公式太复杂了。所以我们使用了梯度下降的算法来求解。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)