人工智能-机器学习

·

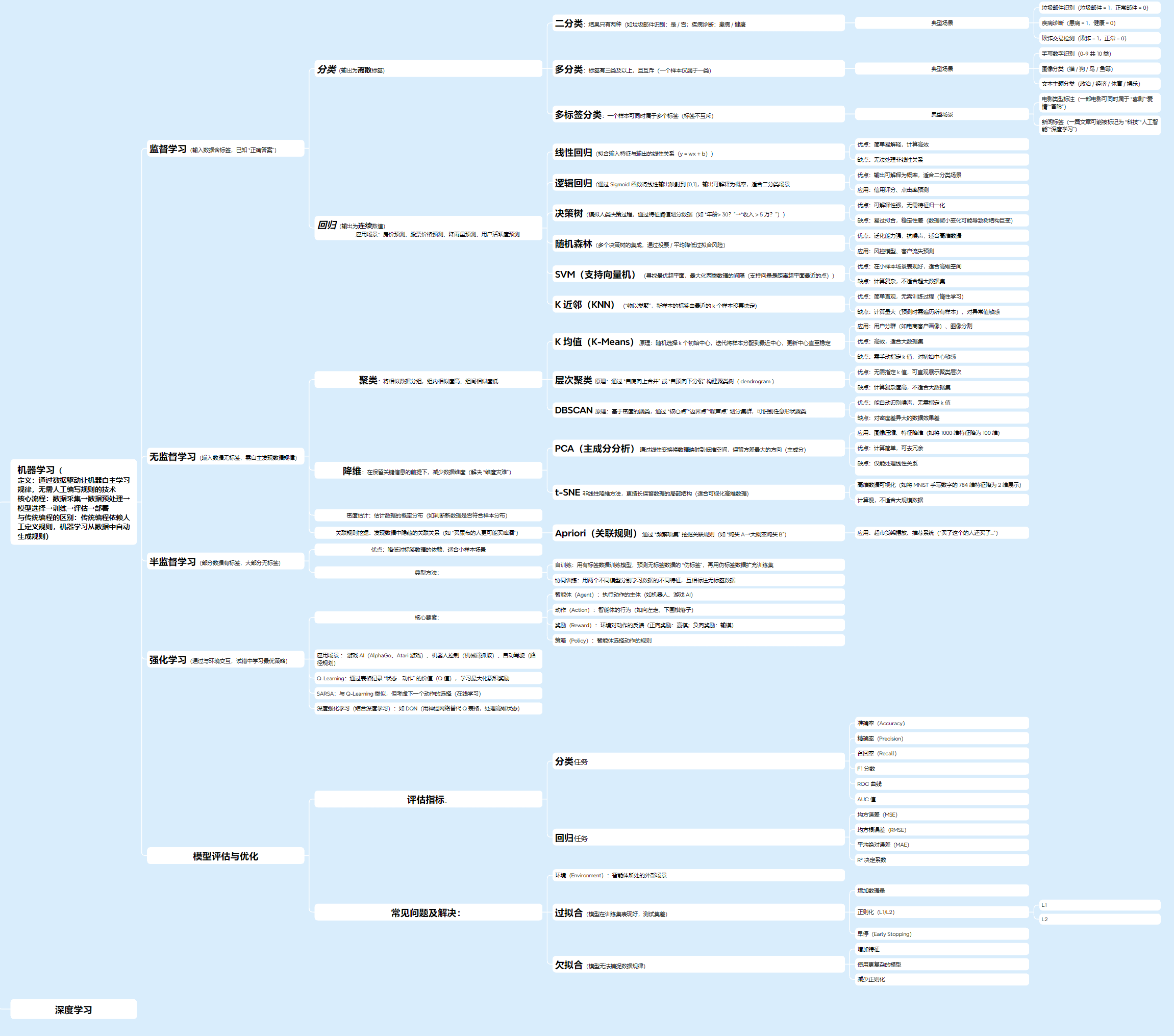

中心主题:机器学习

1. 基础概念

- 定义:通过数据驱动让机器自主学习规律,无需人工编写规则的技术

- 核心流程:数据采集→数据预处理→模型选择→训练→评估→部署

- 与传统编程的区别:传统编程依赖人工定义规则,机器学习从数据中自动生成规则

2. 核心分支(按学习方式)

2.1 监督学习(输入数据含标签,已知 “正确答案”)

- 核心目标:学习输入到输出的映射关系,用于预测新数据

- 细分任务:

- 分类(输出为离散标签)

- 二分类:结果只有两种(如垃圾邮件识别:是 / 否;疾病诊断:患病 / 健康)

- 多分类:结果有多种(如手写数字识别:0-9;动物分类:猫 / 狗 / 鸟)

- 多标签分类:一个样本对应多个标签(如文本分类:一篇文章可能同时属于 “科技” 和 “教育”)

- 回归(输出为连续数值)

- 应用场景:房价预测、股票价格预测、降雨量预测、用户活跃度预测

- 分类(输出为离散标签)

- 典型算法及细节:

- 线性回归

- 原理:拟合输入特征与输出的线性关系(y = wx + b)

- 优点:简单易解释,计算高效

- 缺点:无法处理非线性关系

- 逻辑回归

- 原理:通过 Sigmoid 函数将线性输出映射到 [0,1],用于二分类

- 应用:信用评分、点击率预测

- 优点:输出可解释为概率,适合二分类场景

- 决策树

- 原理:模拟人类决策过程,通过特征阈值划分数据(如 “年龄> 30?”→“收入 > 5 万?”)

- 优点:可解释性强,无需特征归一化

- 缺点:易过拟合,稳定性差(数据微小变化可能导致树结构巨变)

- 随机森林

- 原理:多个决策树的集成,通过投票 / 平均降低过拟合风险

- 优点:泛化能力强,抗噪声,适合高维数据

- 应用:风控模型、客户流失预测

- SVM(支持向量机)

- 原理:寻找最优超平面,最大化两类数据的间隔(支持向量是距离超平面最近的点)

- 优点:在小样本场景表现好,适合高维空间

- 缺点:计算复杂,不适合超大数据集

- K 近邻(KNN)

- 原理:“物以类聚”,新样本的标签由最近的 k 个样本投票决定

- 优点:简单直观,无需训练过程(惰性学习)

- 缺点:计算量大(预测时需遍历所有样本),对异常值敏感

- 线性回归

2.2 无监督学习(输入数据无标签,需自主发现数据规律)

- 核心目标:挖掘数据内在结构(如相似性、分布模式)

- 细分任务:

- 聚类:将相似数据分组,组内相似度高、组间相似度低

- 降维:在保留关键信息的前提下,减少数据维度(解决 “维度灾难”)

- 密度估计:估计数据的概率分布(如判断新数据是否符合样本分布)

- 关联规则挖掘:发现数据中隐藏的关联关系(如 “买尿布的人更可能买啤酒”)

- 典型算法及细节:

- K 均值(K-Means)

- 原理:随机选择 k 个初始中心,迭代将样本分配到最近中心,更新中心直至稳定

- 应用:用户分群(如电商客户画像)、图像分割

- 优点:高效,适合大数据集

- 缺点:需手动指定 k 值,对初始中心敏感

- 层次聚类

- 原理:通过 “自底向上合并” 或 “自顶向下分裂” 构建聚类树( dendrogram )

- 优点:无需指定 k 值,可直观展示聚类层次

- 缺点:计算复杂度高,不适合大数据集

- DBSCAN

- 原理:基于密度的聚类,通过 “核心点”“边界点”“噪声点” 划分集群,可识别任意形状聚类

- 优点:能自动识别噪声,无需指定 k 值

- 缺点:对密度差异大的数据效果差

- PCA(主成分分析)

- 原理:通过线性变换将数据映射到低维空间,保留方差最大的方向(主成分)

- 应用:图像压缩、特征降维(如将 1000 维特征降为 100 维)

- 优点:计算简单,可去冗余

- 缺点:仅能处理线性关系

- t-SNE

- 原理:非线性降维方法,更擅长保留数据的局部结构(适合可视化高维数据)

- 应用:高维数据可视化(如将 MNIST 手写数字的 784 维特征降为 2 维展示)

- 缺点:计算慢,不适合大规模数据

- Apriori(关联规则)

- 原理:通过 “频繁项集” 挖掘关联规则(如 “购买 A→大概率购买 B”)

- 应用:超市货架摆放、推荐系统(“买了这个的人还买了…”)

- K 均值(K-Means)

2.3 半监督学习(部分数据有标签,大部分无标签)

- 核心场景:标签获取成本高(如医学影像标注、罕见病数据)

- 典型方法:

- 自训练:用有标签数据训练模型,预测无标签数据的 “伪标签”,再用伪标签数据扩充训练集

- 协同训练:用两个不同模型分别学习数据的不同特征,互相标注无标签数据

- 优点:降低对标签数据的依赖,适合小样本场景

2.4 强化学习(通过与环境交互,试错中学习最优策略)

- 核心要素:

- 智能体(Agent):执行动作的主体(如机器人、游戏 AI)

- 环境(Environment):智能体所处的外部场景

- 动作(Action):智能体的行为(如向左走、下围棋落子)

- 奖励(Reward):环境对动作的反馈(正向奖励:赢棋;负向奖励:输棋)

- 策略(Policy):智能体选择动作的规则

- 典型算法:

- Q-Learning:通过表格记录 “状态 - 动作” 的价值(Q 值),学习最大化累积奖励

- SARSA:与 Q-Learning 类似,但考虑下一个动作的选择(在线学习)

- 深度强化学习(结合深度学习):如 DQN(用神经网络替代 Q 表格,处理高维状态)

- 应用场景:游戏 AI(AlphaGo、Atari 游戏)、机器人控制(机械臂抓取)、自动驾驶(路径规划)

3. 模型评估与优化

- 评估指标:

- 分类任务:准确率(Accuracy)、精确率(Precision)、召回率(Recall)、F1 分数、ROC 曲线、AUC 值

- 回归任务:均方误差(MSE)、均方根误差(RMSE)、平均绝对误差(MAE)、R² 决定系数

- 常见问题及解决:

- 过拟合(模型在训练集表现好,测试集差):增加数据量、正则化(L1/L2)、早停(Early Stopping)、简化模型

- 欠拟合(模型无法捕捉数据规律):增加特征、使用更复杂的模型、减少正则化

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)