开源神器OpenChat:本地化运行+多模型自由切换,一键打造私有AI助手!

企业员工对AI助手的需求正加速向垂直场景的深度应用演进。当前AI技术已在基础智能交互层面取得显著进展,但在实际办公场景中仍面临共性挑战:离线环境可用性缺失、数据云端传输风险、网络依赖导致的效率瓶颈、个性化适配不足。基于此,推出一款全新的免费开源工具OpenChat,致力于构建更贴合企业办公场景的AI交互范式。

企业员工对AI助手的需求正加速向垂直场景的深度应用演进。当前AI技术已在基础智能交互层面取得显著进展,但在实际办公场景中仍面临共性挑战:离线环境可用性缺失、数据云端传输风险、网络依赖导致的效率瓶颈、个性化适配不足。基于此,推出一款全新的免费开源工具OpenChat,致力于构建更贴合企业办公场景的AI交互范式。

一、OpenChat是什么

1、为什么需要OpenChat?

企业AI应用正加速向生产力场景渗透,员工对智能办公工具的需求呈现终端化、场景化特征。这催生出对垂直化桌面应用的明确需求——能够建立本地化知识库,实现AI能力与办公终端的深度耦合,构建具备业务流感知的智能生产力平台。

- 无互联网也能使用大模型,员工办公的场景并不一定连接互联网,如研发内网、保密要求比较高的一些单位。

- 数据安全与隐私保护,通用类AI助手进行文档阅读、知识问答时,需要将个人知识上传到产品上(云端),存在数据窃密、个人隐私暴露的风险。

- 效率和稳定性要求,由于桌面应用运行在本地环境中,受网络波动和服务器故障的影响较小,因此通常具有更快的响应速度、更高的稳定性和可靠性。

- 能够满足更加个性化的要求,一方面允许用户根据自己的需求和偏好进行个性化设置,如界面风格、快捷键配置、功能模块选择等,从而提供更加贴合用户习惯的使用体验;另一方面随着用户的使用,更多的数据反馈,本地化部署的大模型可以进化为“个人大模型”,为用户提供个性化的服务和建议。

2、OpenChat的核心价值

OpneChat是面向企业员工办公PC的AI客户端应用和智能助手,支持众多先进的AI大模型和大模型API,可在 Windows、MacOS上使用,具有如下价值优势:

- List item多模型支持与灵活切换

支持本地化部署和快速接入AI模型:适配 Ollama,服务器部署等本地运行方案

全球领先的AI模型(如DeepSeek R1、GPT-4、Kimi、豆包等)服务API,满足多样化场景需求,用户可根据任务类型选择最适合的模型。

- 本地数据存储与隐私保护

所有对话和数据均存储在本地设备,不与第三方共享,确保用户隐私安全,避免数据泄露风险。

- 高效知识管理和使用网络信息检索:

实时查找最新数据,助力决策分析

智能知识库:个性化知识存储,便捷管理、随时调用

文档对话:支持文本、PDF、Office 交互式问答,高效阅读

- 卓越体验,畅快使用

跨平台支持:适配 Windows、Mac

即装即用:无需复杂配置,开箱即用

Markdown 解析,文档呈现更清晰

二、快速入门指南

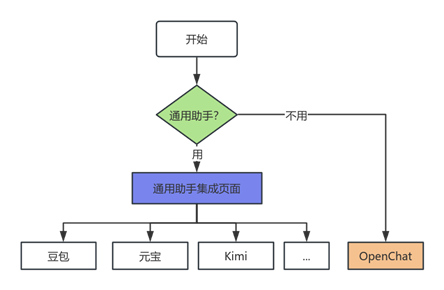

写在前面的话——OpenChat目前希望承担通用AI助手的“补充”,一方面在它上面集成了业界主流的通用AI助手,一个页面就可直通,生成代码你可以去用DeepSeek,查找公众号文章你可以去用元宝,文章总结和PPT大纲生成你可以去用Kimi,AI搜索、内容生成、文档阅读等你可以去用豆包。各家都有不同的擅长之处,你可以在OpenChat的一个界面汇集使用这些通用AI助手。

但总有一些场合你用不了或者不想用通用AI助手,那就可以用OpenChat了。

图 OpenChat是通用助手的好帮手

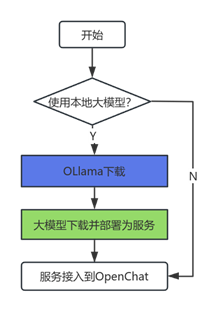

OpenChat需要你来给它接入一个大模型服务(API),接入的这个大模型服务可以来自云(公有云)——边(企业/第三方服务器)——端(个人PC)。所以如果是使用个人PC部署的大模型服务,那么首先就是要在本机部署一个大模型,让它run起来能够提供服务。如果是云、边、端的大模型服务,因为都已经部署好run起来了,在OpenChat上就只是接入服务。

详细的部署和使用流程可以参考下面的基础教程和进阶教程。

2.1 基础教程

2.1.1服务商配置

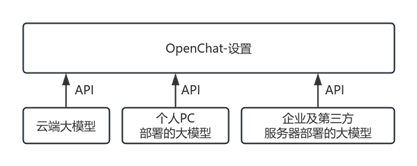

OpenChat支持云端的大模型服务、个人PC本机部署的大模型、以及个人所在企业或第三方企业服务器部署的大模型服务,都可以快速接入OpenChat进行使用。

图 大模型服务API引入示意图

在设置中添加大模型服务

1. 云服务商大模型服务配置

OpenChat 支持多种云端(Cloud)大模型,可快速接入大模型API服务。

步骤一:云端大模型服务API Key申请

点击左侧下方图标设置,进入模型管理界面。通过点击获取进入各大供应商官网并按照步骤申请其API服务密钥。注意:如果你已申请过API Key,则不需要重新申请,可直接配置使用。

平台 API 申请链接

DeepSeek 申请 API

腾讯云 申请 API

百度千帆 申请 API

智谱清言 申请 API

Kimi(月之暗面) 申请 API

OpenAI(ChatGPT) 申请 API

以腾讯云为例:

第一步:访问腾讯云 LKEAP

第二步:注册&登录后,点击 创建API Key

创建成功,则用户获得腾讯云大模型服务API秘钥,可以使用腾讯云平台下的大模型服务。

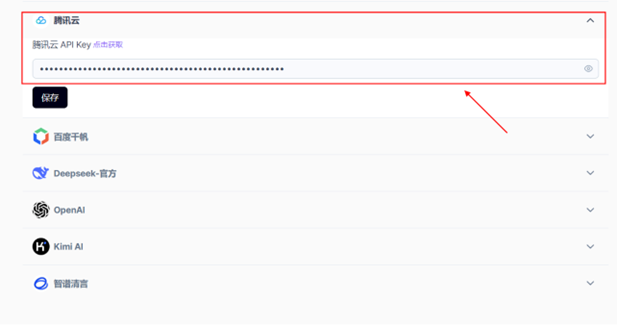

步骤二:在OpenChat中配置大模型服务API进行使用

第一步:登录 腾讯云 LKEAP,复制API Key

第二步,在OpenChat 设置 中进行配置保存

在 OpenChat 设置 → 腾讯云,粘贴 API Key,点击保存,则引入了该大模型服务。

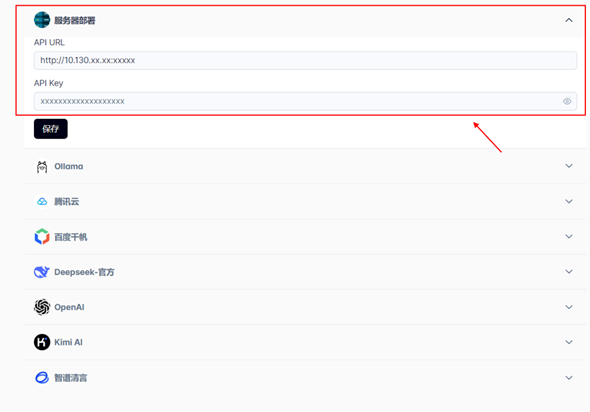

2. 企业大模型服务配置

步骤一:服务器大模型服务API Key获取

企业/第三方的服务器已经部署了大模型,并且已经获得了大模型API URL和API Key。

步骤二:在OpenChat中配置大模型服务API进行使用

在 OpenChat设置 → 填写服务器API URL和API Key,进行保存,则引入了该大模型服务。

3. 本机大模型服务配置

本机大模型服务部署与云端大模型服务和服务器大模型服务不同,需要个人在PC上进行大模型部署,要下载下来模型,并且能够成功部署。本机模型部署推荐使用OLlama软件。

步骤一:安装&安装OLlama软件

访问Ollama 官网下载,并进行安装,与安装其他软件类似,按提示进行下一步即可。

安装完成后,在Windows-命令行窗口运行以下命令检查是否安装成功:

ollama --version

若显示版本信息,则表示安装成功√

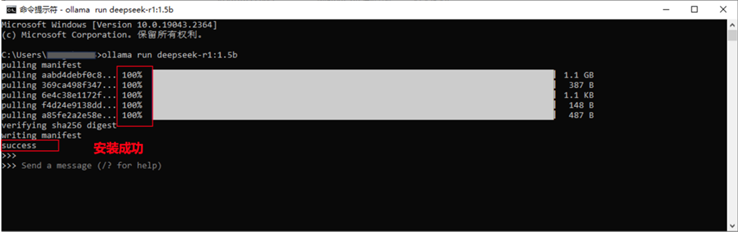

步骤二:下载 & 部署大模型

以下以DeepSeek-R1-1.5B模型下载和安装为例,注意!如果PC硬件资源有限,建议下载小参数量模型。

在终端命令行窗口中输入以下命令下载并运行模型:

ollama run deepseek-r1:1.5b

当终端显示success,表示模型已准备就绪,可以进行使用了。

其他DeepSeek-R1模型下载&部署方式:

ollama run deepseek-r1:7b # 7B 版本

ollama run deepseek-r1:8b # 8B 版本

ollama run deepseek-r1:14b # 14B 服务器端

ollama run deepseek-r1:32b # 32B 服务器端

ollama run deepseek-r1:70b # 70B 服务器端

更多模型可参考:Ollama Library

提醒!

模型下载时间 与 参数量 成正比,请耐心等待。

模型生成速度 与 参数量 成反比,请选择合适的模型。

注意!

如果显示下载失败,可能由于网络中断导致,恢复网络连接后,可自行恢复下载;

大模型下载速度取决于当前的网络状况,由于每个模型文件较大,需要耐心等待下载。

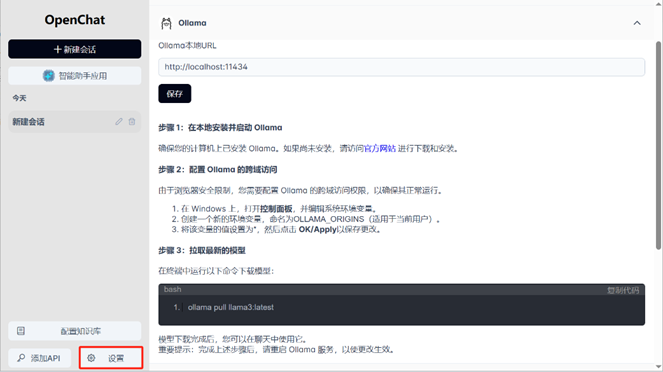

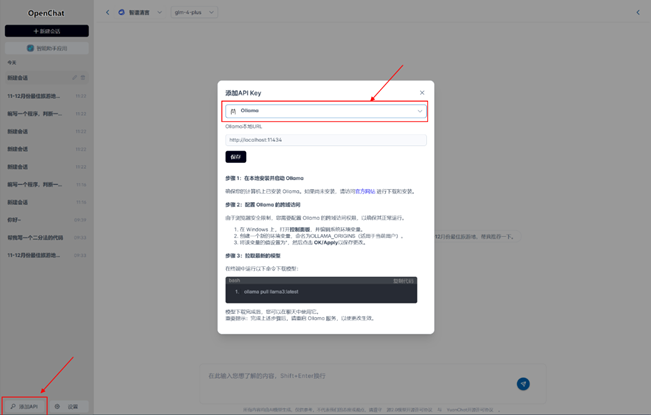

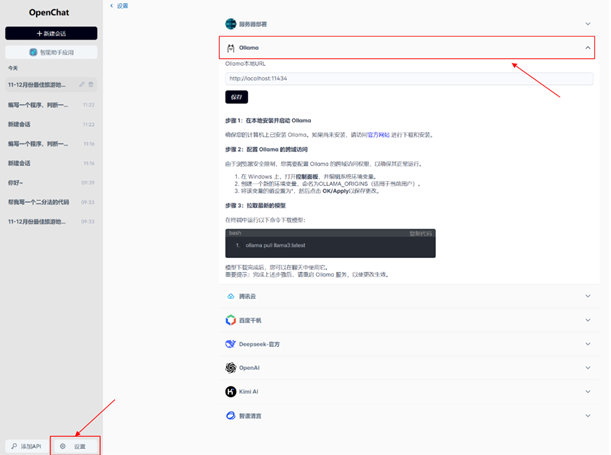

步骤三:OpenChat中引入本地OLlama部署的模型

有两种方式都可以引入,一是在添加API中进行引入,二是同其他服务一样,在设置中进行引入。可以任选其一操作。

方式一:在添加API中添加

①在OpenChat左下角,点击“添加 API”→②选择Ollama(保持默认的Ollama本地URL)→③点击 保存 ✅

方式二:在设置中添加

①在OpenChat左下角,点击 “设置”→②选择Ollama(保持默认的Ollama本地URL)→③点击 保存 ✅

2.1.2大模型对话

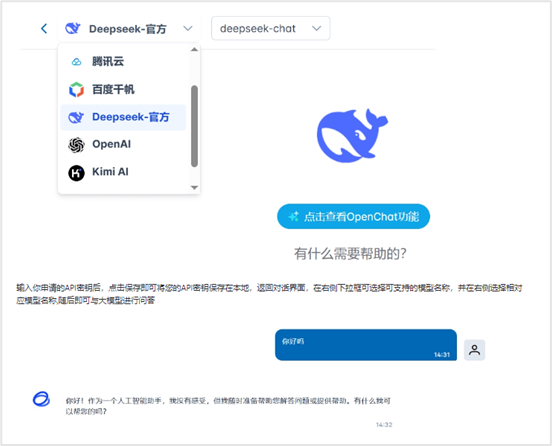

步骤一:选择一个大模型服务

选择云服务商→选择一个模型服务,如DeepSeek官方的deepseek-chat服务,或者选择服务器部署的模型服务,或者本地OLlama部署的模型服务。

步骤二:开启对话

在输入区输入问题→点击发送,就可以跟大模型进行对话了。

2.1.3 对话管理和操作

新建对话操作:点击新建对话,可以开启一个新的对话,对话的主题可以默认为第一个问题,可以进行编辑。

对话分组管理:将对话列表按照时间进行了分组,分为今天、最近3天、最近7天、最近30天、更早等组别,供用户进行方便查看,其中,个别组别不存在则表明用户在此期间未进行过对话。

结果重新生成:针对当前对话结果,如果不满意,可以让大模型重新生成结果,重新生成的结果与前一次的结果同时存在,用户可以切换查看不同结果内容。

单轮对话删除:如果用户针对某次对话(问题-答案对),觉得不满意,或者不想让该次对话历史中显示,可以将对话内容进行删除,删除后将不可见,也无法恢复。

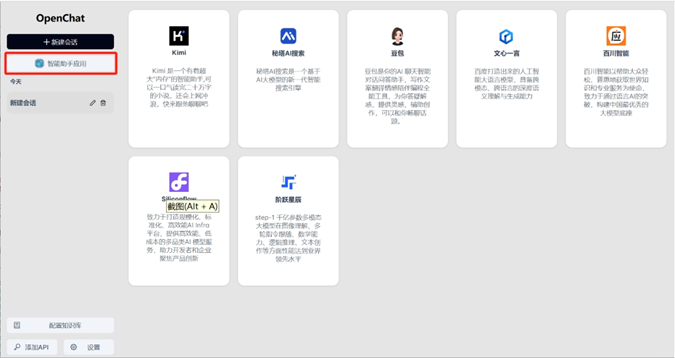

2.1.4 通用AI助手使用

OpenChat内集成了国内各大优秀厂商的大语言模型平台,在左侧边栏,点击智能助手应用,可进入智能助手应用界面,查看支持的大语言模型。

这里我们以豆包为例,点击即可进入豆包官网,使用豆包AI助手的所有功能。

2.2 进阶教程

在与大模型对话时,通过选择不同的工具插件,一方面可以给大模型引入实时信息,另一方面也可以满足不同业务需要。

2.2.1 工具插件

目前包括4款通用工具插件,包括敏感词审核、网络检索、知识库、文档对话。

其中敏感词审核插件可以与其他插件同时选择,但是网络检索插件、知识库插件、文档对话插件这三个插件只能同时使用一个,即三选一。被选择使用的插件,在右侧插件设置区会看到相应的插件,并且能够对该插件的参数进行设定。

2.2.2 敏感词审核

敏感词审核插件旨在对大模型输出的内容进行检测,判断输出的内容是否符合安全要求。该插件可设置参数为【间隔字数】,默认10,即模型每输出10个字进行一次检测,该数值越大敏感信息检测粒度越大,检测耗时越少。为了保证能够审核全部内容,模型输出结束后必会进行一次检测。

2.2.3 知识库

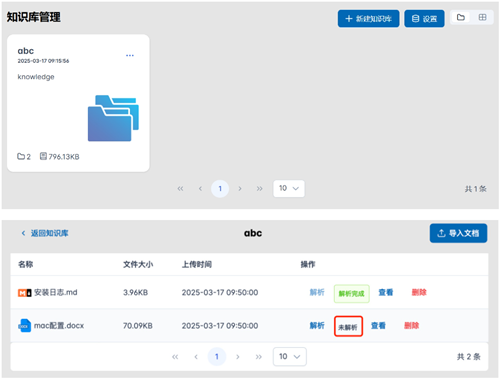

步骤一:构建个人知识库

①新建知识库,点击左侧配置知识库打开知识库管理页面,点击新建知识库打开新建知识库页面,填入名称和描述构建个人知识库。

② 选择本机文档导入到OpenChat,可通过目录方式选择文件,也可直接将本地文件拖拽至图标区域上传,文件支持类型多样,请选择正确的文档格式进行上传。

③ 参数设置,自定义知识库语义编码Eembedding模型、入库和检索的参数,不设置的话则默认使用预设值。

步骤二:文档解析和存入向量数据库

可在知识库管理页面看到你所创建的知识库,点击进入知识库,可以查看文件的状态,新建的知识库文档都处于未解析状态,未解析状态的文档无法被检索到。

点击解析进行文件解析,解析完成后会出现解析完成字样,如果增加文档,可点击右上方的导入文档进行文档上传。

步骤三:使用知识库插件

在对话界面点击知识库插件启用,选择已创建的某个知识库,即可进行知识库的问答,用户问题会在知识库中检索相关内容,然后将检索到的内容和用户问题一起发给大模型,让大模型生成答案。

2.2.4 文档对话

点击文档对话插件启用,选择单个文档上传到OpenChat,就可以与该文档进行对话。

DAMO开发者矩阵,由阿里巴巴达摩院和中国互联网协会联合发起,致力于探讨最前沿的技术趋势与应用成果,搭建高质量的交流与分享平台,推动技术创新与产业应用链接,围绕“人工智能与新型计算”构建开放共享的开发者生态。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)